5 minute read

Expertos aportan claves para detectar imágenes creadas con inteligencia artificial

by La Jornada

AFP

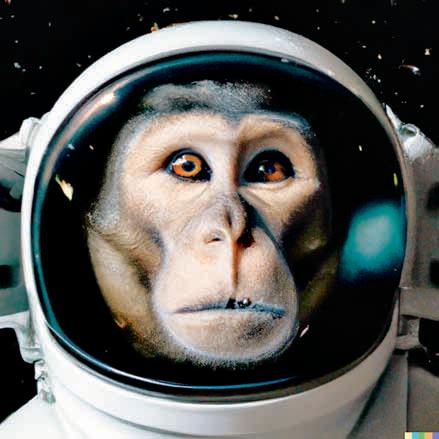

El progreso de la inteligencia artificial (IA) en los últimos meses originó un fenómeno nuevo: compartir de manera masiva a través de las redes sociales imágenes generadas artificialmente. Algunas, ultrarrealistas y asociadas con noticias políticas, han causado confusión al ser presentadas como auténticas. Si bien hasta la fecha no hay una herramienta capaz de identificar con certeza este tipo de imágenes, recontextualizar e identificar inconsistencias visuales puede ser una manera de detectarlas, explicaron expertos a la AFP.

Con algunas palabras descriptivas muchas plataformas de inteligencia artificial, como Midjourney, DALL-E, Stable Diffusion o Craiyon, generan una imagen a partir de un enorme banco de datos, constantemente alimentado por las solicitudes de los usuarios, estas herramientas son capaces de crear una infinidad de representaciones.

Muchos usuarios utilizan la tecnología con fines humorísticos y artísticos, mientras otros optan por vincular esas imágenes con noticias políticas.

Una avalancha de imágenes producidas por IA, por ejemplo, circuló en Twitter para ilustrar eventos auténticos, como el encuentro entre Vladimir Putin y Xi Jinping el 20 de marzo de 2023, o para visualizar situaciones ficticias, como el papa Francisco usando una chaqueta acolchada gigante.

Aunque la mayoría de los autores especifican que las imágenes son falsas, se han difundido fuera de contexto e incluso se han presentado como auténticas.

Se han creado, o se siguen desarrollando, herramientas para intentar detectar estos montajes, pero los resultados aún no son concluyentes, según pruebas realizadas por Afp.

“Cuando una IA genera completamente una imagen, no suele tomar partes de una sola foto. Se utilizan miles o hasta millones de fotos para tener en cuenta miles de millones de parámetros”, dijo a la Afp David Fischinger, ingeniero del

Instituto Tecnológico Austriaco y especialista en IA.

“Una IA fusiona estas imágenes de su banco de datos, las deconstruye y luego reconstruye una foto pixel a pixel; esto significa que en el renderizado final ya no notamos la diferencia entre las imágenes originales”, comentó a la Afp Vincent Terrasi, cofundador de Draft & Goal, empresa que lanzó un detector de contenido generado por IA para universidades.

Los metadatos de una foto, que son como el carnet de identidad digital de un archivo y que a veces puede revelar el origen de una imagen generada por IA, tampoco son útiles. “Por desgracia, no te puedes fiar porque las redes sociales eliminan sistemáticamente esta información”, señaló Annalisa Verdoliva, profesora de la Universidad Federico II de Nápoles y especialista en IA.

Volver a la fuente de la imagen

Expertos señalan que una forma de detectar la creación de una imagen generada por IA es encontrar su contexto original. En algunos casos, el creador destaca el uso de la tecnología y la herramienta empleada.

Para ello hay que intentar identificar la primera vez que la foto se publicó en Internet.

Una búsqueda inversa de imágenes puede ayudar a identificar si un contenido ha sido indexado en plataformas de búsqueda. De esta manera es posible rastrear publicaciones antiguas con una misma foto.

Este método permite, por ejemplo, conocer el origen de unas imágenes que han circulado ampliamente en las redes sociales y que muestran un enfrentamiento entre el ex presidente de Estados Unidos, Donald Trump, y la policía.

Una búsqueda reversa en Google a partir de una de esas fotos llevó a un tuit de Eliot Higgins, fundador del sitio de investigación Bellingcat, publicado el 20 de marzo de 2023.

En la continuación del hilo de Twitter, Higgins explica que creó la serie de imágenes utilizando la última versión de la plataforma Midjourney.

Incluso sin encontrar el registro original, la búsqueda inversa puede llevar a una versión de mejor calidad si la imagen ha sido recortada, modificada o ha perdido calidad con el paso del tiempo. Entre mejor calidad tenga la imagen, más fácil será analizarla para encontrar errores que revelen la edición.

La búsqueda inversa de imágenes tiene la ventaja de revelar fotos semejantes. Eso puede ser útil para comparar una foto sospechosa con fotos de fuentes confiables.

En el contexto de la reunión entre Vladimir Putin y Xi Jinping, circuló por la red una foto sin fuente que mostraba al presidente ruso arrodillado ante el líder chino. Sin embargo, el periodista italiano David Puente señaló que la decoración del salón era muy diferente a la que se puede observar en la cobertura del evento, lo que levantó dudas sobre la autenticidad de la imagen viral.

La descripción de una foto y los comentarios de los usuarios también pueden ser útiles para identificar un montaje o para reconocer el estilo de una IA. En el caso de DALL-E, por ejemplo, se le conoce por sus diseños ultrarrealistas, mientras Midjourney se enfoca más en personas famosas.

Eso puede ser útil para buscar una imagen en la herramienta usada para crearla. En algunas plataformas, como Midjourney, una búsqueda detallada entre los intercambios de los usuarios y el programa automatizado puede localizar las imágenes. Si no se pudo encontrar el origen y no hay indicios de su contexto, hay que fijarse en la propia imagen.

Biden: empresas tecnológicas deben garantizar que la IA es segura

inteligencia artificial plantean para los usuarios y la seguridad nacional.

El presidente estadunidense, Joe Biden, dijo el martes pasado que aún está por verse si la inteligencia artificial es peligrosa, pero que cree que las empresas tecnológicas deben garantizar que sus productos sean seguros antes de lanzarlos al mercado.

Biden se reunió con su consejo de asesores sobre ciencia y tecnología para hablar de los riesgos y oportunidades que los rápidos avances en

“La IA puede ayudar a afrontar algunos retos muy difíciles, como las enfermedades y el cambio climático, pero también tiene que abordar los riesgos potenciales para nuestra sociedad, nuestra economía y nuestra seguridad nacional”, comentó Biden al grupo, que incluye académicos, así como ejecutivos de Microsoft y Google.

En los últimos meses, la inteligencia artificial ha saltado al primer plano de la conversación mundial tras el lanzamiento del popular

ChatGPT, que ha contribuido a desencadenar una carrera entre los gigantes tecnológicos para desarrollar herramientas similares, al tiempo que ha suscitado preocupaciones éticas y sociales sobre la tecnología capaz de generar una prosa convincente o imágenes que parezcan obra de seres humanos. Aunque las empresas tecnológicas siempre deben ser responsables de la seguridad de sus productos, el recordatorio de Biden refleja algo nuevo: la aparición de herramientas de IA fáciles de usar que pueden generar contenidos manipulables y medios sintéticos de aspecto realista conocidos como deepfakes, dijo Rebecca Finley, directora ejecutiva de Partnership on AI, respaldada por la industria.

La Casa Blanca señaló que el presidente aprovechó la reunión sobre IA con el fin de “discutir la importancia de proteger los derechos y la seguridad para garantizar una innovación responsable y salvaguardias adecuadas”, además de reiterar su llamamiento al Congreso a que apruebe leyes que protejan a los niños y limiten la recopilación de datos por parte de las empresas tecnológicas.

La semana pasada, Italia bloqueó temporalmente ChatGPT por motivos de privacidad de los datos y los legisladores de la Unión Europea han estado negociando la aprobación de nuevas normas para limitar los productos de IA de alto riesgo en los 27 países del bloque.

En cambio, “Estados Unidos ha adoptado un enfoque de no intervención respecto al desarrollo comercial de la IA”, comentó Russell Wald, director ejecutivo de política y sociedad del Stanford Institute for Human-Centered Artificial Intelligence.

REGRESA AL CUADRILÁTERO EN DESPEDIDA A JULIO CÉSAR CHÁVEZ