WWW.DATACENTER-INSIDER.DE 09/2025

DATACENTER INSIDER DATACENTER INSIDER

ALLES IM DATACENTER MUSS EFFIZIENTER

LAUFEN – VOM CODE ÜBER DIE HARDWARE

BIS ZUR LETZTEN PUMPE. DOCH FÜR EIN ABHEBEN

IN DIE KI-ÄRA REICHT DAS NICHT.

LANDEPLATZ OPTIMIERUNG?

NEIN, EINE STARTRAMPE FÜR DATACENTER

ANATOMIE EINES KI-RECHENZENTRUMS

Künstliche Intelligenz fordert technische Leistung auf olympischem Niveau.

EIN AUFRUF ZUR RADIKALEN TRANSFORMATION

Klassische Optimierung reicht nicht mehr. Jetzt werden die Schrauben am Verhandlungstisch nachjustiert.

ENORME RECHEN-POWER FÜR DAS DATACENTER

Aktuelle Entwicklungen beim High Performance Computing im Überblick.

Nutzen Sie unser KI-Know-how, um Ihr Fachwissen auszubauen!

GlassWorks AI™ gestaltet den Prozess der Planung, Konzeption und Bereitstellung neu, damit Sie Ihr individuelles KI-Netzwerk aufbauen können. Innovation leicht gemacht –QR-Code scannen und KI entdecken!

EDITORIAL

Alles im Datacenter muss effizienter laufen – vom Code über die Hardware bis zur letzten Pumpe. Doch für ein Abheben in die KI-Ära reicht das nicht. Klar ist:

• Die Zukunft wird in erheblichem Maße von Künstlicher Intelligenz bestimmt, sei sie generativ oder nicht, ob sie als ERP-System, ESG-Anwendung, Datenbank, Cloud-native oder Prozessautomatisierung daherkommt.

• Neue Arbeitslasten schaffen Anforderungen, die bislang so nicht existierten.

• Die Hardware ändert sich beständig: Sollen Anwender GPUs, FPGAs, Neuromorphes oder Qubits nutzen?

• Die Leistungselektronik muss mit 350 kW und mehr pro Rack sowie rasanten Wechseln zurechtkommen.

• Die Kühlung per Luftstrom wird um Flüssigkeiten ergänzt und soll gleichzeitig nutzbare Abwärme produzieren.

Es braucht also neue Technik und andere Denke. Optimierung muss sein, um Platz und Strom, Hardware und Manpower zu sparen. Doch wer darin stecken bleibt, hat keine Chance auf Zukunft. Es geht nicht „einfach“ um höhere Performance, schnellere Netze, mehr Strom, neue Rechenzentren, stärkere Kühlmechanismen. Innovationen müssen her!

Viel Spaß beim Lesen dieses Sonderheftes!

Ulrike Ostler Chefredakteurin DataCenter-Insider

DA TA CEN TER

Grundlagen:

Allianzen, Alternativen, Aufbruch

Ein Aufruf zur radikalen Transformation

Grundlagen: Infrastrukturen für KI-Agentik Anatomie eines KI-Rechenzentrums

Grundlagen: High Performance Computing Enorme Rechen-Power für das Datacenter

Grundlagen: Datacenter-Klimatisierung Die Zukunft der Kühlung von IT-Komponenten

Anschrift: Vogel IT-Medien GmbH

Max-Josef-Metzger-Str. 21, 86157 Augsburg

Telefon +49 (0) 821/2177-0

Web www.DataCenter-Insider.de

Geschäftsführer: Tobias Teske, Günter Schürger

Konzept & Gestaltung: Alexander Preböck, AD

Chefredakteurin: Ulrike Ostler, V.i.S.d.P., ulrike.ostler@vogel.de

Chef vom Dienst: Jürgen Paukner

Sales: Brigitte Bonasera, Key Account Manager

Sales: insider.sales@vogel.de

Erscheinungstermin: September 2025

Titelbild: A. Preböck (M) / stock.adobe.com

Haftung: Für den Fall, dass Beiträge oder Informationen unzutreffend oder fehlerhaft sind, haftet der Verlag nur beim Nachweis grober Fahrlässigkeit. Für Beiträge, die namentlich gekennzeichnet sind, ist der jeweilige Autor verantwortlich.

Copyright: Vogel IT-Medien GmbH. Alle Rechte vorbehalten. Nachdruck, digitale Verwendung jeder Art, Vervielfältigung nur mit schriftlicher Genehmigung der Redaktion

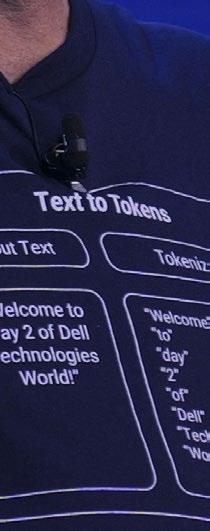

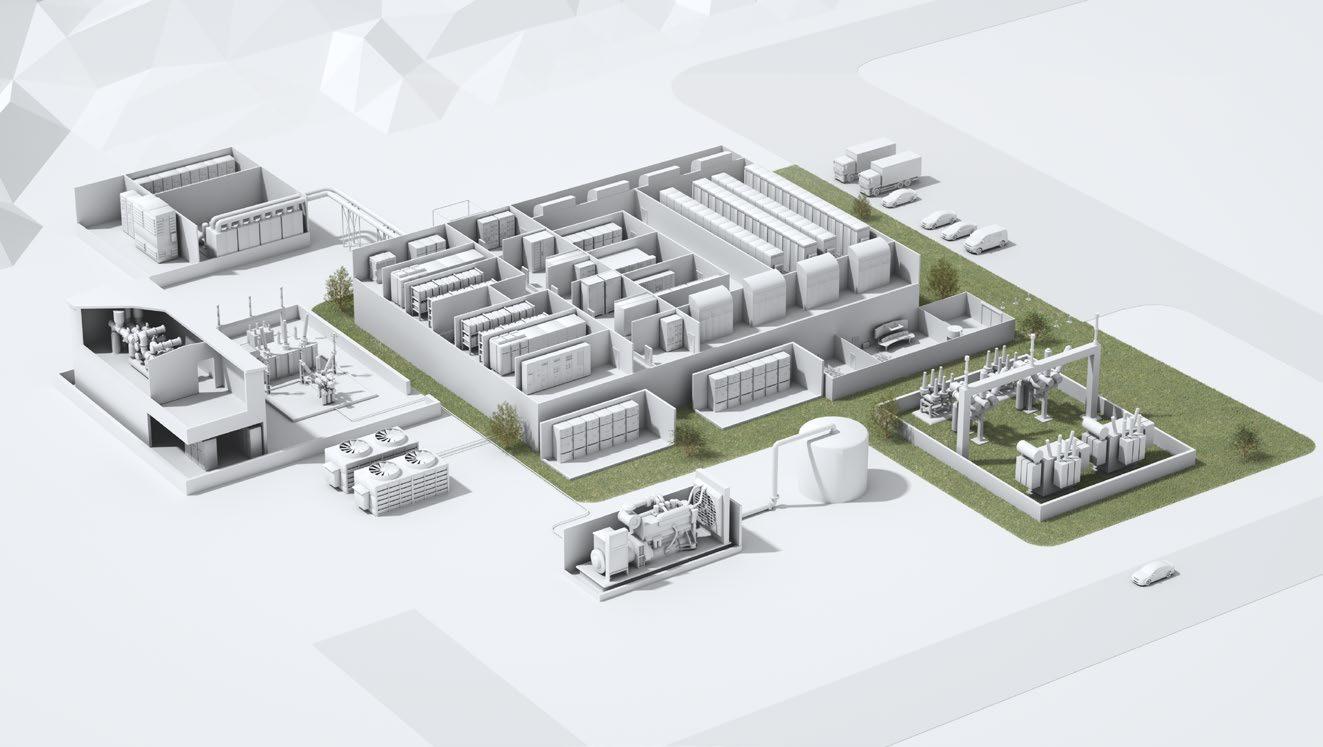

BIS 2028 SOLL EIN DRITTEL ALLER INTERAKTIONEN MIT GENERATIVER KI AUF AUTONOME AGENTEN ZURÜCKGREIFEN, SO JEFF CLARKE, VICE CHAIRMAN UND COO BEI DELL TECHNOLOGIES. BILD: DELL TECHNOLOGIES

Grundlagen: Infrastrukturen für KI-Agentik

Anatomie eines KI-Rechenzentrums

KÜNSTLICHE INTELLIGENZ FORDERT TECHNISCHE

LEISTUNG AUF OLYMPISCHEM NIVEAU. OB TRAINING

KOMPLEXER MODELLE ODER ECHTZEITNAHE INFERENZ: ZU DEN GRUNDVORAUSSETZUNGEN ZÄHLEN HOCHPARALLELES DENKVERMÖGEN, THERMISCHE

„Die Zukunft des Geschäftsbetriebs liegt in autonomen Systemen, die in der Lage sind, analytisch zu denken, sich anzupassen und Handlungen im großen Maßstab auszuführen“, glaubt Ken Durazzo, Vice President von Dell Research Office bei Dell

Technologies. Kurz auf den Punkt gebracht: in KI-Agentik. Bis 2028 soll laut Jeff Clarke, Vice Chairman und COO bei Dell Technologies, ein Drittel aller Interaktionen mit generativer KI auf diese autonomen Agenten zurückgreifen. Die Entwicklung von

agentischen KI-Systemen und Reasoning-Engines treibt den Bedarf an Compute- und Dateninfrastruktur massiv nach oben.

KI-Token sind die neue Währung. In den KI-Fabriken fließen sie wie Lebensblut durch die neuronalen Adern, die Währung der synthetischen Intelligenz – messbar, zählbar, handelbar. In 2024 dürften weltweit 25 Billionen Token erzeugt worden sein, schätzt Clarke. In drei Jahren soll diese Zahl 35.000 Billionen erreichen – ein Anstieg in kürzester Zeit um drei Größenordnungen. Clarke hält diese Prognose sogar noch für zu konservativ. Die Modellkomplexität, die Inferenzintensität und das Token-Volumen wachsen exponentiell. Moderne KI-Modelle seien laut Clarke deutlich rechenintensiver als noch vor einem Jahr angenommen. Sie würden mindestens 100-mal mehr ComputeLeistung verschlingen als ursprünglich gedacht.

Doch wer die Leistung einer KI-Fabrik in Tokens kalkuliert, sieht nicht nur die Kosten, sondern auch das Potenzial: für personalisierte KI-Interaktion, für modulare Logiksysteme, für dezentrale Wissensmärkte. Token sind der Taktgeber einer Denkfabrik, die neue Währung vernetzter Systeme. Willkommen in der Ära maschineller Intelligenz – ausgerechnet jetzt. Ausgerechnet.

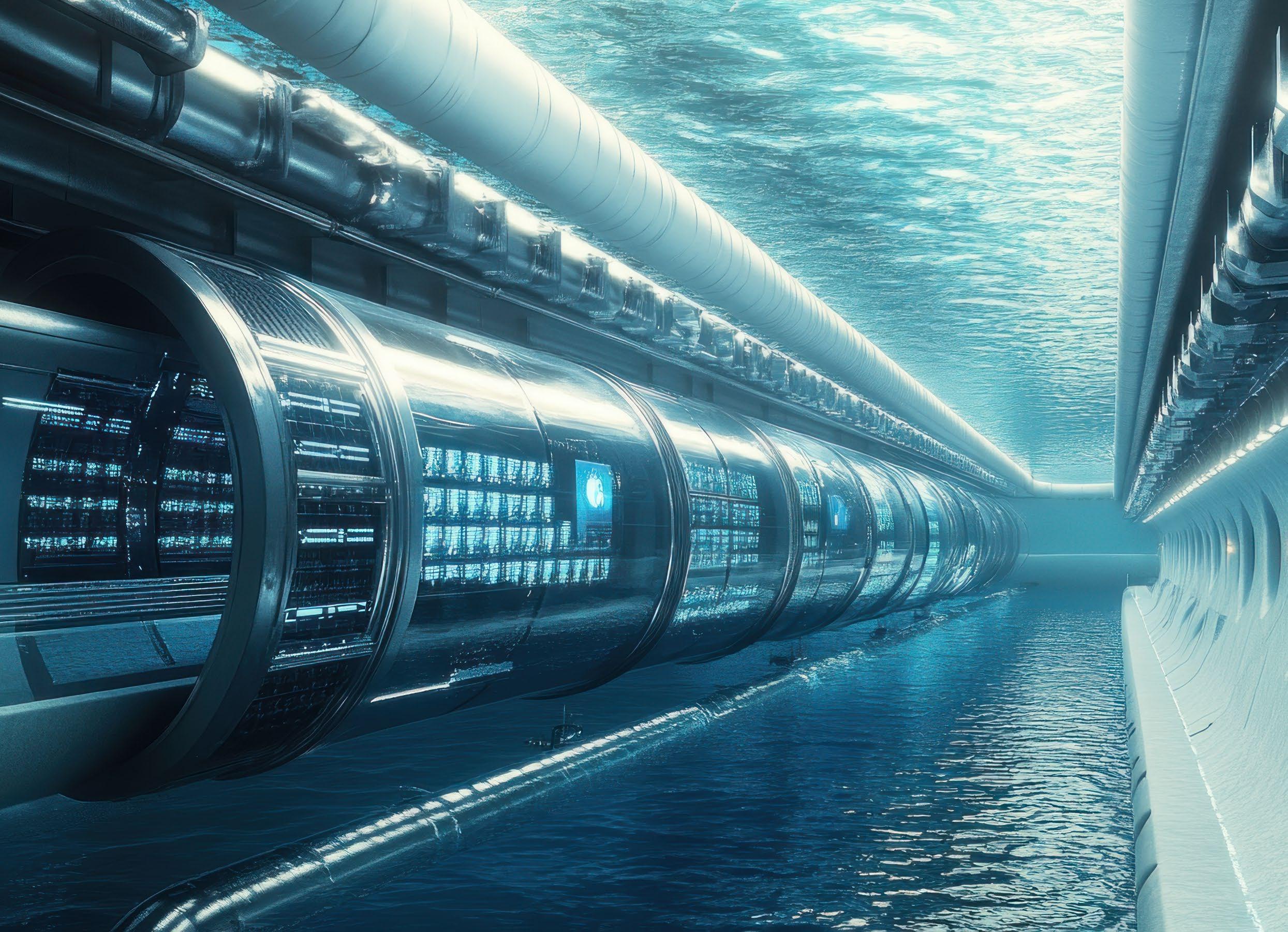

MUSKELKRAFT UND DENKVERMÖGEN

KI-Modelle krempeln das klassische Rechenzentrumsdesign fundamental um. Die Leistung pro Rack verzehnfacht sich, die Kühlung wird zur immersiven Hochleistungsdisziplin. Die Netze sprinten in die 800-G-Klasse und NVMe-oF soll die Daten aus dem Speicher entfesseln.

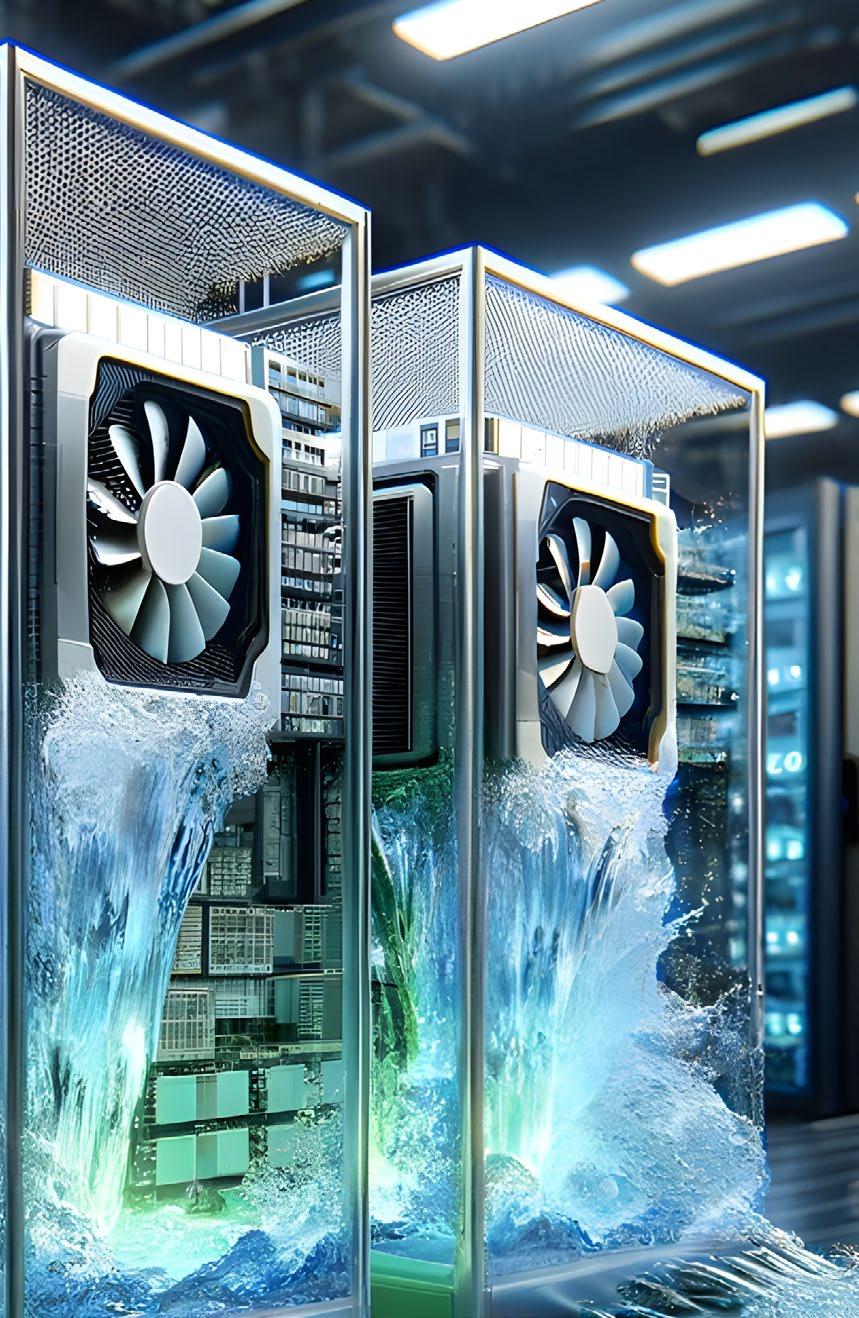

KI-Fabriken folgen einem grundlegend anderen Aufbau als klassische Rechenzentren. Während herkömmliche IT-Infrastrukturen primär auf CPU-zentriertes Rechnen ausgelegt sind – etwa für transaktionale Datenbanken oder Virtualisierung –, dominieren in KI-zentrierten Umgebungen spezialisierte Beschleuniger. Zur Auswahl stehen GPUs von Nvidia oder AMD, TPUs (Tensor Processing Units), Wafer-Scale Engines von Cerebras oder dedizierte AI-AcceleratorASICs, etwa von Graphcore oder Tenstorrent. Diese Chips und Subsysteme sind auf hochgradig parallele Matrix- und Vektoroperationen optimiert – die Grundbausteine moderner Deep-Learning-Modelle. Beschleuniger wie die Nvidia B200/ GB200 verschlingen 700 bis 1.000 W pro GPU. Trainingscluster verdichten bis zu 8-fach B200 pro 6U-Node; klassische 15-kW-Racks sind damit chancenlos. Pro Rack braucht es 60 bis 120 kW. Ambitionierte Referenzdesigns reichen bis in die 132-kW-Klasse.

Bereits ab etwa 30 kW pro Rack scheidet die Luftkühlung aus. Directto-Chip-Kühlung (D2C) mit Kühlplatten führt die Abwärme über eine Kühlflüssigkeit von Hotspots wie CPUs und GPUs ab. Alternativ oder ergänzend kommen Rear-Door Heat Exchanger ins Spiel, also Wärmetauscher in der Rack-Rücktür, die die Warmluft durch Wasser tauschen und indirekt abführen.

ZWEI REIHEN HOCHMODERNER DELL POWEREDGE SERVERRACKS MIT DELL ERDHX-RÜCKKÜHLERN; ÜBER KOPF VERLAUFEN ZWEI EBENEN VON KÜHLWASSER- UND STROMVERSORGUNGSTRASSEN. DIE LUFTDICHTEN EINHAUSUNGEN SORGEN FÜR PRÄZISES AIRFLOWMANAGEMENT – EIN ENTSCHEIDENDER EFFIZIENZFAKTOR BEI DER BEREITSTELLUNG VON KI-INFRASTRUKTUREN.

BILD: DELL TECHNOLOGIES

DIESE KI-FABRIK

VON DELL TECHNOLOGIES

BIETET WERKZEUGFREIEN ZUGANG ZUM RÜCKTÜR-WÄRMETAUSCHER.

BILD: DELL TECHNOLOGIES

Bei der Immersionskühlung werden die Server komplett in Becken mit dielektrischer Flüssigkeit getaucht. So fließt die Wärme direkt von allen Komponenten – statt nur von den Hotspots – ab. Immersionskühlung ermöglicht Leistungsdichten jenseits von 100 kW pro Rack und eliminiert Lüftergeräusche, erfordert jedoch spezielle Tanks und Handhabung. Für die zentralen Kühlsysteme bedeutet dies: Moderne KI-Rechenzentren haben große Wasserkühlkreisläufe mit Pumpen und allem Drum und Dran. Häufig wird mit Warmwasser bei etwa 30 °C gekühlt, um effiziente freie Kühlung

zu ermöglichen. Dadurch entfallen mechanische Kältemaschinen, da die Verdunstungskühlung in Kühltürmen ausreicht. Die rücklaufende warme Kühlflüssigkeit bei Temperaturen ab etwa 37 °C kann in manchen Fällen weiterverwendet werden, typischerweise als Nahwärme zum Heizen von Bürogebäuden (Stichwort: Wärmerückgewinnung). Dennoch ist die Luftkühlung nicht gänzlich obsolet. Viele Rechenzentren fahren hybride Konzepte. Flüssigkühlung wirft neue Herausforderungen auf, nicht zuletzt LeckageRisiken. Die Durchflussraten und den Pumpendruck muss man mit Sensorik überwachen.

VERNETZT FÜR TRAINING UND INFERENZ

Das Training großer KI-Modelle erfordert massive Rechenkapazitäten mit hoher Bandbreite zwischen Speicher, Compute und Netzwerk. Die KI-Inferenz hingegen ist oft weniger rechenintensiv, stellt aber erhöhte Anforderungen an Latenz, Durchsatz und Datenverfügbarkeit – und verschiebt so die Flaschenhälse in Richtung Netzwerk- und Speichersubsystem.

Bei groß angelegten KI-Trainings laufen die Berechnungen verteilt über viele GPUs, die ständig Zwischenergebnisse untereinander austauschen müssen. Um Latenzen zu minimieren und Engpässe auszuräumen, kommen spezialisierte Hochgeschwindigkeitsnetzwerke ins Spiel. Netzwerkkomponenten sind energiehungrig: Ein einzelner 400-Gbit/sSwitch (ob Ethernet oder InfiniBand) kann über 1 kW an Leistung aufnehmen, High-End-Modelle verschlingen bis zu 1,7 kW pro Switch. In einem KI-Cluster werden dutzende solcher Switches benötigt – ein Nvidia DGX SuperPOD etwa umfasst bis zu 36 InfiniBand/Ethernet-Switches. Allein das Netzwerk zieht also weit über 30 kW und erzeugt entsprechende Abwärme. Das „Nervensystem“ der KI muss daher genauso gut gekühlt und mit Strom versorgt werden wie die Server selbst. Das alles erfordert eine durchdachte Verkabelung. Best Practices umfassen neben Kabeltrassen über den Racks u. a. getrennte Wege für Strom- und Datenkabel (um Störungen zu minimieren) sowie klare Beschriftung und Bündelung, um Hitzestau zu minimieren. Oft wird ein KI-Rechenzentrum so entworfen, dass

ein zentrales Netzwerk-Rack (Spine) mehrere Server-Racks sternförmig anbindet, um Kabellängen unter dem Limit – etwa unter 50 m bei InfiniBand – zu halten.

Zusätzlich zur internen Vernetzung der Rechenfarm darf man die Anbindung nach außen nicht vergessen:

Gerade wenn das KI-Rechenzentrum als Service – wie im Falle von Cloud/ Colocation – dient oder große Da tenmengen von außen beziehen muss, sind hochkapazitative InternetUplinks und redundante Provideran schlüsse einzuplanen. Deshalb gilt: Wer heute neu plant oder erweitert, denkt nicht mehr vom Rack oder vom Einschub im Schrank aus – son dern vom Anwendungsfall her. Denn erst das konkrete Szenario entschei det darüber, ob GPU-Cluster, Infe renz-Fabriken, On-Premises-LLMs oder Edge-Inferenz zum Tragen kommen – und welches Maß an Skalierbarkeit, Redundanz und Datenhoheit erfor derlich ist. Die IEA rechnet mit dem Zehnfachen des AI-Stromverbrauchs von 2023 bis 2026; ohne Last-Management explodieren die Betriebskosten. KI-optimierte Designs von Schneider Electric und Nvidia sparen so um die 20 Prozent der Kühlenergie.

KI-READY: DIESES NVIDIA DGX SUPERPOD-RACK VEREINT ACHT H100-SYSTEME MIT NVLINK UND INFINIBAND-TOPOLOGIE – BEREIT FÜR KI-TRAINING IM PETAFLOPMASSSTAB. BILD: DELL TECHNOLOGIES

DREI WEGE ZUR PRODUKTIVEN MASCHINENINTELLIGENZ

Was bleibt übrig, wenn man den Hype aus dem Schlagwort „AI Factory“ herausfiltert? Pure Technik, echte Anwendungsfälle – und ein gewaltiger Unterschied zwischen Edge, Core und Enterprise-Cluster. Auf der Dell Technologies World 2025 wurde es konkret: In einer bemerkenswert nüchternen Breakout-Session präsentierten drei Branchenvertreter ihre produktiven KI-Fabriken – gebaut auf der Dell AI Factory with Nvidia. Die US-amerikanische Güterbahn CSX Transportation kontrolliert jährlich Tausende Gleisabschnitte auf strukturelle Defekte, loses Material und Vandalismus. Seit dem KI-Rollout läuft das vollautomatisch.

Thomas Webber, Vice President Technology, erklärte, wie CSX mit Edge-Deployments auf Basis von Dell PowerEdge XR-4520c und Nvidia L4 GPUs arbeitet. Die Systeme sind so robust, dass sie entlang der Strecke unter extremen klimatischen Bedingungen betrieben werden – für 360-Grad-Videoanalyse in Echtzeit. Die Objekterkennung läuft auf eigens trainierten Vision-Transformer-Modellen, die über RAG (Retrieval-Augmented Generation) an Streckendokumentationen und Materialdatenbanken angeschlossen sind. Ergebnis: Die KI prüft mit dem Achtfachen der DELL AI FACTORY

menschlichen Genauigkeit – und das 120-mal schneller. Statt punktueller Inspektionen ermöglicht die Lösung durchgängige Überwachung: mit Edge-Intelligenz auf Schiene. Das renommierte US-Gesundheitsnetzwerk Northwestern Medicine verfolgt einen anderen Ansatz: Im Rechenzentrum des Krankenhauses kommt ein 4-Node-Cluster mit Dell PowerEdge XE9680 zum Einsatz – ausgestattet mit jeweils acht Nvidia H100 Tensor Core GPUs, 2 TB RAM und NVMe-Ultra-Fast-Storage. Dr. Madhu Ranganathan, Chief Innovation Officer, betonte die Bedeutung von Datenkontrolle: Die LLMs werden on-premises betrieben und ausschließlich intern gehostet.

Die australische Worley Group, Spezialistin für Engineering-Projekte in der Energie- und Rohstoffindustrie, hat mit ihrer IT-Tochter Worley Digital eine hochsichere KI-Fabrik geschaffen. Die Herausforderung: Angebotsunterlagen, technische Dokumente, Materialpläne und Pfadoptimierung – alles wollte man projekt- und kontextbezogen automatisieren.

Brendan Pearson, Director Digital Engineering bei Worley Digital, erklär te, wie autonome KI-Agenten aus mehreren GenAI-Bausteinen entstehen. RAG ist Pflicht: Technische Parameter, Preislisten, Normen und Ausschreibungsvorgaben werden dynamisch eingebunden. Die KI vergleicht Angebotsunterlagen, schlägt Alternativen vor und optimiert Fertigungsprozesse – mit bemerkenswert hoher Präzision. Der Infrastruktur liegt Dells Plattform PowerEdge XE9680 (Compute) mit acht Nvidia H100 Tensor Core GPUs zu Grunde, ausgestattet mit Dell PowerScale F710, einem All-Flash Scale-Out NAS mit NVMe und bis zu 125 GB/s Datendurchsatz und Dell AI Optimized Networking Fabric mit SmartFabric Director und NDR-Lösungen. Die KI-Fabrik wurde vollständig on-premises gebaut – mit Support durch Dell Professional Services und Nvidia DGXperts. Für Pearson ist klar: „Diese KI ist kein Assistent – sie ist ein Multiplikator, der auch noch skaliert.“ Was alle drei Kunden eint: RetrievalAugmented Generation (RAG) als strategisches Rückgrat, nicht als Add-on. Und die Überzeugung, dass echte KI-Fabriken nicht „vom Himmel fallen“ (im Doppelten Sinne: sie wohnen nicht in den Wolken). Man muss sie vielmehr im eigenen Haus „aus dem Boden stampfen“ – dort nämlich, wo das Wissen wohnt.

explizit von „KI-Agenten“, doch unter der Oberfläche kristallisiert sich ein klarer Bauplan für eine neue Generation produktiver KI heraus: die Agentik. Im Zentrum steht die Idee, spezialisierte GenAI-Module – etwa für Dokumentanalyse, Diagnosevorschläge, visuelle Inspektionen oder Planungsszenarien – nicht als monolithische LLMs zu betreiben, sondern als orchestrierte, aufgabenbezogene KI-Agenten, die miteinander interagieren.

KI-Agenten arbeiten kollaborativ. Ein Vision-Agent bei Worley Digital erkennt technische Zeichnungen. Ein RAG-Agent greift auf Projektwissen zu. Ein Analyse-Agent untersucht Alternativen. Ein Entscheidungsmodul schlägt Handlungsoptionen vor. Das gesamte System läuft auf einer Dell AI Data Platform mit PowerEdge XE9680, PowerScale und AI-optimiertem Netzwerk – on-premises, abgesichert und hochverfügbar. Die Dell KI-Agentik steht für eine neue Architekturform – nicht nur für Rechenzentren, sondern für organisierte

KI-Handlungsfähigkeit in verteilten Infrastrukturen. Dells AI Factory ist nämlich ein modulares Konzept –bestehend aus abgestimmter Hardware, validierten Workflows, professioneller Integration und fein orchestrierter Governance. Die technologische Basis bildet eine Reihe von

Technologien von Dell und Ökosys-

Nvidia NIM und NeMo erlauben agentenartige Kapselung von Modellen als APIs (Inference-as-aService), optimiert für Dell-Hard-

PowerEdge R770/XE9680 liefern die Rechenbasis – disaggregiert, GPUoder CPU-basiert, je nach Agententyp.

• PowerScale und PowerFlex sorgen für die nötige Datenverfügbarkeit – skalierbar und softwaredefiniert.

• Automation Layer (CloudIQ, iDRAC9, Ansible-Module) übernimmt die Orchestrierung und Lifecycle-Steuerung der AgentenInfrastruktur.

INTEGRIERT UND DOCH DISAGGREGIERT

Ein KI-Rechenzentrum funktioniert als ein integriertes Orchester aus modularen Einzelteilen – funktional aufeinander abgestimmt, strukturell jedoch disaggregiert. Hinter dem Begriff „Disaggregated Infrastructure“ verbirgt sich eine Architektur, bei der Rechenleistung, Speicher, Netzwerk und Beschleuniger nicht mehr fix in einem Serverschrank verankert sind, sondern als einzeln skalierbare Ressourcenpools zur Verfügung stehen. Disaggregierte Infrastrukturen sind für KI-Trainings- und Inferenzsysteme mit wachsendem Ressourcenbedarf

zunehmend alternativlos – insbesondere wenn es um Skalierbarkeit, Austauschbarkeit und energieeffizientes Kapazitätsmanagement geht.

Denn unterschiedliche Teile der Infrastruktur entwickeln sich unterschiedlich schnell weiter.

Während GPU-Generationen heute im Jahresrhythmus wechseln, halten sich Netzwerk-Backbones oft über mehrere Jahre; die Speicherlösungen entwickeln sich in Zyklen dazwischen. Disaggregierte Architekturen erlauben den gezielten Austausch einzelner Module, das Pooling von Ressourcen und die präzise Abstimmung auf den jeweiligen Workload.

Auch die Energieeffizienz, Wartbarkeit und CAPEX-Optimierung hängen am modularen Design.

Dell bietet vorkonfigurierte, getestete und validierte Architekturen für bestimmte KI-Anwendungsfälle auf Basis von VxRail, VMware Cloud Foundation und Nvidia AI Enterprise. Dell Technologies hat mit seiner AI Data Platform, den disaggregierten Power-Edge-Systemen und der modularen Private Cloud bereits starke Pfeiler für KI-Infrastrukturen gelegt. Doch wer tiefer gräbt, stößt auf weitere strategisch wichtige Bausteine im Dell-Portfolio.

Für Unternehmen, die keine eigene KI-Architektur entwerfen wollen, bietet Dell vorkonfigurierte und validierte Lösungen für spezifische KI-An-

wendungsfälle an – etwa auf Basis von VxRail und VMware Cloud Foundation. Diese sogenannten „Validated Designs for AI“ ermöglichen einen beschleunigten Einstieg in produktive Workloads wie Bildanalyse, Natural Language Understanding oder Empfehlungsmodelle, ohne dass die Kunden eigene Integrationsarbeit leisten müssen. Alles ist bereits abgestimmt, getestet – und wird mit Lifecycle-Support ausgeliefert.

Mit Dell APEX erweitert Dell sein Portfolio in Richtung Pay-per-Use: Unternehmen können GPU-Ressourcen –etwa für Trainingsläufe oder Inferenz-Bursts – as-a-Service buchen, ohne eigene Hardware anzuschaffen. Die KI-Plattformen lassen sich on-premises oder in Colocation-Rechenzentren betreiben, beispielsweise bei Equinix oder bei Partnern mit APEX-Integration.

Ein strategischer Meilenstein ist die Integration der Nvidia Inference Microservices (NIM). Dell liefert nun fertige, optimierte Runtimes für bekannte Foundation Models – etwa

Meta Llama, Mistral, Mixtral, Google Gemma oder Nvidia GPT – direkt in der eigenen Infrastruktur. Diese Modelle lassen sich per API in eigene

L WIE LIQUID: DER DELL POWEREDGE XE9785L IST IN EINER AMD- UND EINER NVIDIA-VARIANTE ALS AI FACTORY IN EINER FLÜSSIGGEKÜHLTEN RACKSKALIERTEN ARCHITEKTUR VERFÜGBAR.

BILD: DELL TECHNOLOGIES

Anwendungen einbinden. Zusammen mit Nvidia NeMo Retriever entsteht ein durchgängiger Stack für unternehmensinterne Suchsysteme und kontextbezogene KI-Antworten. Mit seiner Edge AI Factory, basierend auf PowerEdge-XR-Systemen wie dem XR5610 oder XR8000 adressiert Dell spezifische Szenarien im Mobilfunk-, Industrie- und Versorgungsbereich. Kombiniert mit Nvidia Jetson oder Intel-Edge-AI-Beschleunigern lassen sich Bildanalyse, Edge-Inferenz oder Open-RAN-Steuerung realisieren – dort, wo die Daten entstehen.

FAZIT

Während hyperskalierte Cloud-Modelle auf zentrale, meist externe LLMs setzen, verfolgt Dell einen entgegengesetzten Ansatz: Die Intelligenz bleibt im Unternehmen – verteilt, orchestriert und eingebettet in reale Prozesse. Dell Technologies liefert mit der KI-Agentik keine einzelne Lösung – sondern ein Betriebsmodell für das KI-Zeitalter. Wer KI produktiv einführen möchte, findet hier in Dells KIAgentik eine durchdachte und resiliente Architekturform für den produktiven Einsatz.

KI ALS SCHLÜSSELTECHNOLOGIE FÜR EFFIZIENZ, VERFÜGBARKEIT UND ZUKUNFTSSICHERHEIT

KÜNSTLICHE INTELLIGENZ REVOLUTIO-

NIERT DEN BETRIEB VON RECHENZENTREN – VON DER VORAUSSCHAUENDEN

WARTUNG ÜBER DAS ENERGIEMANAGEMENT BIS HIN ZUR AUTOMATI-

SIERUNG GANZER BETRIEBSABLÄUFE.

ABB UNTERSTÜTZT BETREIBER MIT

INTELLIGENTEN LÖSUNGEN DABEI, EFFIZIENZPOTENZIALE ZU NUTZEN, AUSFALLRISIKEN ZU MINIMIEREN UND NACHHALTIGKEITSZIELE ZU ERREICHEN.

Rechenzentren sind das Rückgrat der digitalen Wirtschaft, stehen jedoch unter Druck: Die digitale Transformation treibt den Energiebedarf in die Höhe, während Gesetzgeber, Kunden und Investoren gleichzeitig einen geringeren ökologischen Fußabdruck fordern. Um diesen Herausforderungen zu begegnen, rücken vier zentrale Zukunftstrends in den Fokus: Nachhaltigkeit und Dekarbonisierung, Modularität und Skalierbarkeit, Cybersicherheit und Resilienz sowie insbesondere der Einsatz von Automatisierung und Künstlicher Intelligenz.

KI ist dabei kein Selbstzweck, sondern ein zentrales Werkzeug, um Betrieb und Infrastruktur effizienter, zuverlässiger und ressourcenschonender zu gestalten. Ein wichtiges Anwendungsfeld ist die vorausschauende Instandhaltung. Anstatt reaktiv oder nach festen Intervallen zu warten, ermöglichen KI-basierte Systeme eine zustandsabhängige Wartung. Sensoren überwachen kontinuierlich Anlagen wie unterbrechungsfreie StromversorgungsSysteme (USV), Klimageräte oder Leistungsschalter und erkennen

frühzeitig Abweichungen vom Normalbetrieb. Studien zeigen, dass die vorausschauende Wartung (Predictive Maintenance) die Instandhaltungskosten um 25 bis 35 Prozent reduzieren und die Ausfallzeiten um fast 45 Prozent verringern kann. ABB bietet in diesem Bereich digitale Services im Rahmen von ABB Ability™, die Betriebsdaten analysieren und Empfehlungen zur Optimierung liefern.

Auch digitale Zwillinge kommen verstärkt zum Einsatz. Sie bilden Systeme oder ganze Rechenzentren virtuell ab und erlauben Simulationen, beispielsweise zur Optimierung des Luftstroms oder zur Stromverteilung bei Ausfallszenarien. KI kann solche Modelle nutzen, um Potenziale aufzuzeigen oder Erweiterungen zu planen. Parallel dazu arbeitet die Branche an standardisierten digitalen Produktpässen, die Integration und Automatisierung in Zukunft erleichtern sollen.

AUTOMATISIERUNG ALS BASIS FÜR DEN RECHENZENTRUMSBETRIEB VON MORGEN

Die Automatisierung erstreckt sich auch auf den laufenden Betrieb. Intelligente Steuerungen regeln Klimaanlagen bedarfsgerecht oder

leiten bei Störungen Notfallprozesse ein. Das Ziel ist ein teil- oder vollautomatisierter Betrieb mit minimalem manuellem Aufwand. Gleichzeitig verändert sich das Anforderungsprofil: Data-Center-Techniker benötigen zunehmend Kompetenzen in den Bereichen Software, Datenanalyse und KI-Nutzung. Viele Betreiber investieren daher gezielt in Schulungen. Die zunehmende Automatisierung zielt direkt auf zentrale Ziele: ein effizienterer Betrieb durch einen optimierten Anlagenbetrieb, eine höhere Verfügbarkeit durch frühzeitige Fehlererkennung und spürbar geringere Betriebskosten durch gezielte Wartung.

Als globaler Ansprechpartner mit einem weltweiten Netzwerk unterstützt ABB diese Entwicklungen mit einem breiten Lösungsportfolio im Bereich Energie- und Automatisierungstechnik – skalierbar für jede Anwendung.

Die Mittelspannungs-USV HiPerGuard verbindet einen hohen Wirkungsgrad mit maximaler Versorgungssicherheit. Der ABB S800 Hochleistungssicherungsautomat sichert auch hohe Kurzschlussströme zuverlässig ab. Die kompakten Energiezähler D11 ermöglichen die präzise und nachhaltige Überwachung des Energieverbrauchs. Und der ABB SACE Infinitus,

der weltweit erste IEC 60947-2 zertifizierte Halbleiter-Leistungsschalter, legt die Basis für neue, verlustarme DC-Architekturen im Rechenzentrum. Das Portfolio von ABB erstreckt sich von Mittelspannungs- und Niederspannungsschaltanlagen über Leistungsschalter und Unterbrechungsfreien Stromversorgungen bis hin zu Lösungen mit Remote Power Panel und SMISSLINE als Schnittstelle in den Serverraum. ABB Ability™-Anwendungen und -Automatisierungslösungen komplettieren das Portfolio.

Die KI-Ära erfordert ein Umdenken im Betrieb von Rechenzentren. Wer auf intelligente, vernetzte und effiziente Systeme setzt, sichert nicht nur seine Wettbewerbsfähigkeit, sondern legt auch den Grundstein für eine nachhaltige digitale Infrastruktur.

GRUNDLAGEN: ALLIANZEN, ALTERNATIVEN, AUFBRUCH

EIN AUFRUF ZUR RADIKALEN TRANSFORMATION

Das altbekannte Motto „Höher, schneller, weiter“ hat als Ziel ausgedient. Wer heute noch meint, Rechenzentren allein mit klassischer Optimierung in isolierter Denkweise zukunftssicher aufstellen zu können, unterschätzt die tektonischen Verschiebungen, die den Markt gerade umgestalten: Partnerschaften, Konsortien und strategische Allianzen. Diesmal muss man die Schrauben am Verhandlungstisch nachjustieren.

Gerade im Rechenzentrumsumfeld zeigt sich mit aller Deutlichkeit: Die Herausforderungen sind schlicht zu komplex, zu kapitalintensiv und zu technologiegetrieben, als dass sie sich im Alleingang bewältigen ließen.

Darum treten klassische Standortfaktoren leise in den Hintergrund; an ihrer Stelle entstehen Kooperationen – erstmals vollumfänglich sektorengekoppel.

Rechenzentrumsprojekte sind in ihrer Komplexität in der Tat ein Kraftakt –erst recht in Zeiten knapper Stromnetze, volatiler Energiepreise und wachsender Nachhaltigkeitsanforderungen.

Europa hat entschieden: Bis 2030 sollen alle Rechenzentren klimaneutral betrieben werden – und sei es bilanziell. Daraus ergeben sich allerdings neue Herausforderungen: Wind und Solar liefern wetterabhängig; die Netze sind unterdimensioniert und überlastet. Blackout-Resilienz wird zur Überlebensfrage. Dieselaggregate haben längst ausgedient. Neue Konzepte setzen stattdessen auf Microgrids und Inselnetz-Fähigkeit, Lastanpassung, Batteriespeicher und Strompuffer. Rechenzentren der Zukunft brauchen intelligente Stromsysteme. Darum muss man Allianzen schmieden. Wer sein Rechenzentrum zukunftssicher aufstellen will, muss es radikal neu denken: im Schulterschluss mit Partnern unkonventionelle Wege gehen, auf neuartige Energiequellen setzen und sogar bei Bau- und IT-Materialien Neues wagen.

Eine zentrale Erkenntnis lautet: Kein Akteur kann die Zukunftsherausforderungen allein bewältigen. Deshalb entstehen derzeit bemerkenswerte Partnerschaften quer über Branchen hinweg, wie die Allianz zwischen dem Rechenzentrumsbetreiber CyrusOne und dem Energieversorger E.ON.

ERSTER SPATENSTICH FÜR FRA7 VON CYRUSONE IN FRANKFURT MIT

MINISTERPRÄSIDENT BORIS RHEIN (4. V. R.). DIE ERSTEN 9 MW

SOLLEN BIS ZUM ZWEITEN QUARTAL 2026 FERTIG WERDEN. BILD: CYRUSONE

WENN BETREIBER UND VERSORGER AN EINEM STRANG ZIEHEN: DATACENTER ALS

ENERGIE-HUBS

CyrusOne, ein weltweit führender Eigentümer, Entwickler und Betreiber von Rechenzentren, und E.ON, eines der größten Energieunternehmen Europas, haben Anfang Juni 2025 eine Zusammenarbeit angekündigt. In einem gemeinsamen Vorzeigeprojekt wollen sie ein drängendes Problem der Branche lösen: die Versorgung neuer Rechenzentren mit Energie sichern, beginnend am größten Datacenter-Standort Europas. Frankfurt leidet nämlich unter Netzengpässen und Anschlussverzögerungen.

Im Rahmen der Partnerschaft entwickelt E.ON Energy Infrastructure Solutions (EIS) sein innovatives Stromerzeugungssystem E.ON IQ Energy Center gemeinsam mit CyrusOne weiter. Das System kombiniert klassische und erneuerbare Energien mit digitaler Steuerung und KI-gestützter Optimierung. Es soll ab 2029 zusätz-

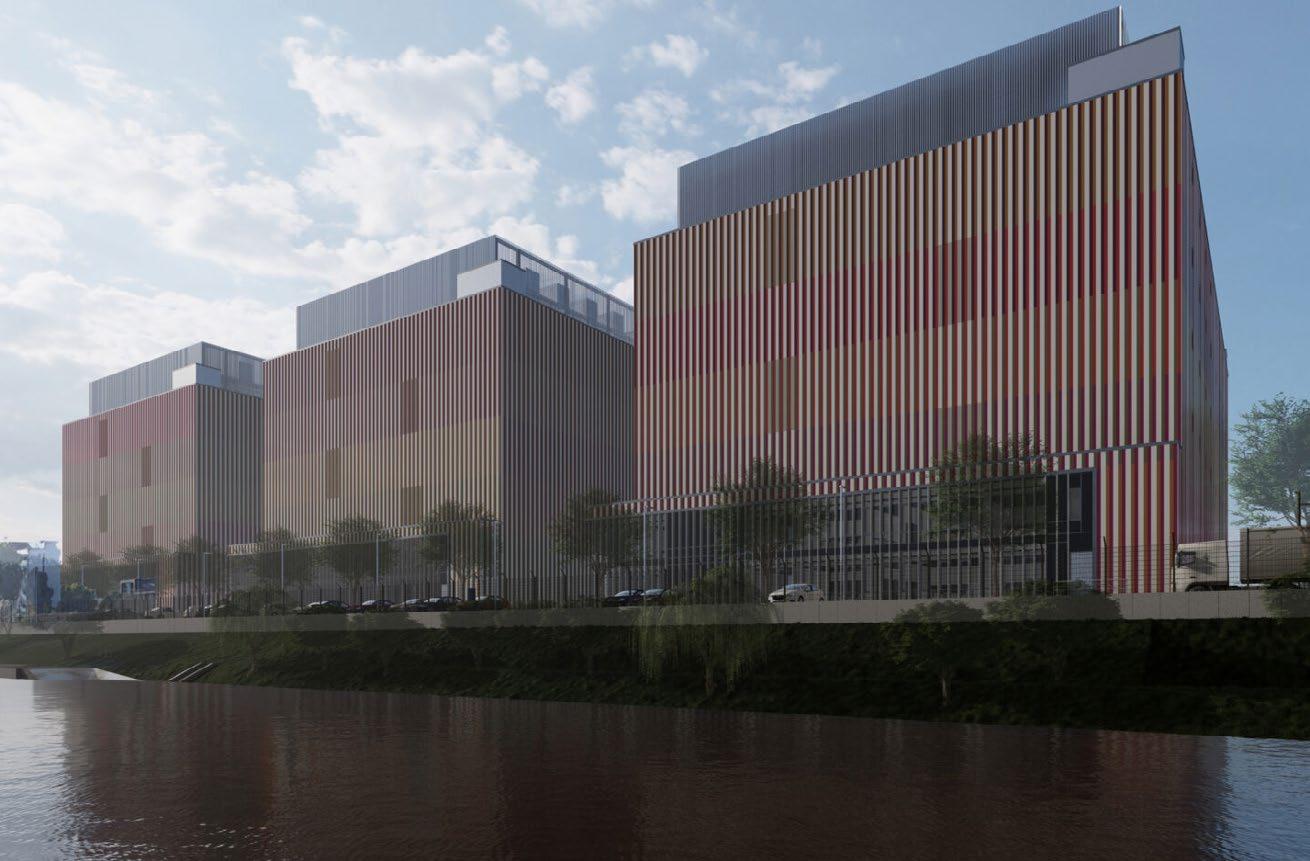

LEUCHTTURMPROJEKT IN MAINZ: GREEN MOUNTAIN UND KMW BAUEN GEMEINSAM EINEN HOCHMODERNEN DATACENTERCAMPUS (FLUSSWASSERGEKÜHLT, IN UNMITTELBARER NÄHE ZU BESTEHENDEN KRAFTWERKSANLAGEN VON KMW) UND KÖNNEN DADURCH AUF DIESELGENERATOREN VERZICHTEN.

BILD: KMW

liche 61 Megawatt elektrische Leistung für das hochmoderne Hyperscale-Rechenzentrum CyrusOne FRA7 in Frankfurt Griesheim bereitstellen. Das erweitert den Campus um weitere 45 Megawatt an IT-Kapazität auf insgesamt 126 Megawatt. Durch die lokale Stromerzeugung entlastet die Anlage das öffentliche Netz – und eröffnet Potenziale für höhere Gesamteffizienz. So ist vorgesehen, die Abwärme der Stromerzeugung per Absorptionskältemaschine direkt wieder fürs Kühlen der Server zu nutzen. Außerdem wird das E.ON/ CyrusOne-Kraftwerk „hydrogen-

ready“ ausgelegt. Versorgt wird es zunächst mit Erdgas; perspektivisch ist H2-Betrieb zu 100 Prozent möglich. Darüber hinaus planen die Partner Netzdienstleistungen und Power Purchasing Agreements (PPA) für erneuerbare Energien, um anderen Rechenzentrumsbetreibern schnell zusätzliche Kapazitäten bereitzustel-

len, wo sich der öffentliche Netzanschluss verzögert. Die Lösung soll „ein reproduzierbares Modell für zukünftige Rechenzentren“ schaffen und „das Tempo für europäische Innovationen im Bereich nachhaltiger Infrastruktur vorgeben“, so Marten Bunnemann, CEO von E.ON Energy Infrastructure Solutions.

Nicht nur große Konzerne, auch Städte und kommunale Versorger entdecken Allianzen mit der Rechenzentrumsbranche. Ein eindrucksvolles Beispiel liefert die Stadt Mainz: Dort bauen die kommunalen Kraftwerke Mainz-Wiesbaden (KMW) gemeinsam mit dem norwegischen Rechenzentrumsinvestor Green Mountain einen hochmodernen DatacenterCampus mit 54 MW IT-Leistung. Windkraftanlagen der Stadtwerke übernehmen die Hauptversorgung. Die Nähe zu bestehenden Kraftwerken ermöglicht den Verzicht auf Diesel. Stattdessen soll ab 2028 ein wasserstofffähiges Gasturbinen-Kraftwerk einspringen soll, wenn Sonne und Wind mal nicht genug Energie liefern.

Das Besondere: Flusswasser-Kühlung und Abwärme-Nutzung wurden von Anfang an mit geplant. Der Rhein liefert Kühlwasser und das erwärmte Wasser wird ins Mainzer Fernwärmenetz eingespeist, wo es rechnerisch den Wärmebedarf von rund 20.000 Haushalten decken könnte. Mithilfe

von Hochtemperatur-Wärmepumpen wird die Serverabwärme von 30 °C auf etwa 110 °C angehoben und so direkt nutzbar gemacht.

Siemens Energy und Eaton – der eine ein Schwergewicht der Energietechnik, der andere Spezialist für elektrische Systeme – haben im Juni 2025 eine Kooperation gestartet, um den Bau von Rechenzentren mit integrierter, netzunabhängiger Stromversorgung zu beschleunigen. Konkret bietet Siemens Energy ein modulares Gas-Kraftwerkspaket an, basierend auf hocheffizienten SGT-800-Gasturbinen. In Standardausführung liefern mehrere dieser Turbinen zusammen bis zu 500 MW Leistung – genug für einen großen Campus. Die Idee dahinter: Wenn die Stromerzeugung vor Ort erfolgt, umgeht man langwierige Netzanschlussprozesse. So fahren neue Facilities ihre Server bis zu zwei Jahre schneller hoch. Zwei Jahre früher am Markt bedeutet bei einem großen 500-MWCampus so um die zwei bis drei Milliarden US-Dollar zusätzliches Einkommen, wie Siemens Energy vorrechnet. Eaton steuert das komplette elektrische Nervensystem bei: vom Mittelspannungs-Schaltgear über USV-Anlagen bis zu Racks und Busbars –alles, was nötig ist, um das Rechenzentrum zügig ans Laufen zu bringen. Die Anlage ist skalierbar, mit eingebauter Redundanz und Batteriespei-

chern für die Ausfallsicherheit, für den Betrieb mit Wasserstoff ausgelegt. Ein Rechenzentrum mit eigenem Kraftwerk ist politisch eine heikle Sache. Doch wenn dieses Kraftwerk als „Brückentechnologie“ perspektivisch auf „Grün“ umstellbar und kurzfristig sogar netzstützend ist, steigen die Chancen auf Akzeptanz. Die Turbinen können als rotierende Reserve dienen, Frequenz und Spannung stabilisieren und so sogar zur Netzstabilität beitragen. Man dreht also den Spieß um – weg vom Image des „Stromfressers“ hin zum aktiven Netzstabilisator. Hier zeigt sich visionäres Denken. Rechenzentren als Energie-Hubs der Gemeinde? Warum eigentlich nicht. So wichtig Optimierungsmaßnahmen wie effiziente Kühlung oder bessere Auslastung auch sind – ohne fundamentalen Wandel in der Energieversorgung bleiben Rechenzentren verwundbar. Die Diskussion um Energie geht dabei längst über klassische Pfade hinaus.

DIE PRIVATWIRTSCHAFT BAUT (ALLIANZEN AUF)

Die unternehmerische Realität ist der politischen Vision enteilt. E.ON plant gemeinsam mit einem noch ungenannten Colocation-Anbieter ein „intelligentes Rechenzentrumsquartier“ direkt angrenzend an bestehende Windparks. Mit dabei: Rhede,

Neudersum und Borsum – Anlagen, die bereits zehntausende Haushalte versorgen und in ein leistungsstarkes Umspannwerk einspeisen. Die Vision folgt dem Gigafactory-Prinzip: lokale Energie, kurze Wege, Effizienzmaximierung. Anders als beim CyrusOneProjekt in Frankfurt Westside, das auf Gas-Wasserstoff-Hybridtechnik setzt, soll hier primär Windkraft die digitale Infrastruktur speisen. Partner, Zeitrahmen und technische Details sind noch nicht offiziell bestätigt – doch die Richtung steht fest.

Die Transformation der Rechenzentrumsbranche hin zu KI-Hubs ist bereits im Gange. Unternehmen von Dell Technologies, über Equinix, IONOS, Deutsche Telekom bis hin zu SAP investieren in eigene AI-Factory-Projekte – vom Proof-of-Concept bis hin zu vollwertigen Produktionsumgebungen. Dell Technologies eröffnet gemeinsam mit dem IT-Distributor TD Synnex drei neue KI-Kompetenzzentren – in München, Paris und Großbritannien. Das Münchener Labor entsteht in enger Partnerschaft mit der AppliedAI-Initiative, um Unternehmen

TIM VAN WASEN, MANAGING DIRECTOR, DELL TECHNOLOGIES DACH:

„IN DEN DELL AI LABS VERKNÜPFEN WIR UNSERE INFRASTRUKTUR MIT EINEM AKTIVEN ÖKOSYSTEM.“

BILD: DELL TECHNOLOGIES

bei der Entwicklung und Erprobung von KI-Lösungen auf die Sprünge zu helfen. Technisch ist das Lab mit hochmoderner GPU-Infrastruktur für den Einsatz mit dem Agentic RAG Framework für wissensgestützte KIAgenten ausgestattet. Dazu zählen Dell PowerEdge R760 Server mit Nvidia Hopper H100 GPUs, BlueField-3 DPUs, Spectrum-X-Hochleistungsnetzwerk und PowerScale F210 Speichersysteme. Kunden und Partner können so ihre KI-Projekte in einem sicheren Rechenzentrumsumfeld auf die Probefahrt nehmen und KI-Workflows im Pilotstadium praxisnah mit EchtzeitUnternehmensdaten validieren.

Seit Anfang 2025 baut Hewlett Packard Enterprise (HPE) ein neues AI Center of Excellence in Zentraleuropa auf. Dieses strategische Kompetenzzentrum soll dem Mittelstand helfen, KI-Technologien aus der Experimentierphase in den produktiven Einsatz zu überführen. Das Zentrum versteht sich als Eisbrecher für produktive KI und als Katalysator für nachhaltige Wettbewerbsvorteile. Unter der Leitung des KI-Strategen

Stefan Brock, einem Experten für datenzentrische Architekturen und digitale Transformation, verfolgt das Zentrum einen klaren Auftrag: KI greifbar, skalierbar und wirtschaftlich nutzbar zu machen. HPE bündelt hierzu ein interdisziplinäres Netzwerk aus Technologiepartnern, Forschungsein-

ALLIANZEN SCHMIEDEN: VERTRETERINNEN UND VERTRETER VON MERCEDES, SIEMENS, BECKHOFF, ARBURG, HAWE, KSB, SICK SOWIE WEITEREN INNOVATIONSFÜHRERN VERBRACHTEN DREI TAGE IN ZUG AM ARLBERG AUF EINLADUNG DER HANNOVER MESSE UND DES INDUSTRIAL AI PODCAST, UM GEMEINSAM ÜBER DIE ZUKUNFT ZU BERATEN.

BILD: HANNOVER MESSE

richtungen und Industrievertretern. Das neu gegründete AI Center of Excellence Central Europe von HPE stützt sich auf zwei Hubs: Customer Technology Center Böblingen (Hauptschwerpunkt: Automobilindustrie) und Customer Innovation Center Genf (Hauptschwerpunkt: Finanzsystem).

Die KI-Wirtschaft baut, die Politik flankiert – so ließe sich die europäische KI-Szene im Jahre 2025 auf den Punkt bringen. Während privatwirtschaftliche Marktakteure Allianzen schmieden, um KI-Fabriken mit eigenen Kräften auf die Beine zu stellen,

setzt die EU mit den KI-Gigafactories auf eine staatlich koordinierte Rückversicherung in Form von überregionalen Anker-Infrastrukturen. Dieses massive Vorhaben soll rechtskonforme Rechen- und Datenräume dort schaffen, wo der Markt zögert. Wenn es nach der EU geht, braucht Europa nicht bloß die eine oder andere moderne KI-Hochburg, son-

dern ein souveränes Gewebe aus KI-Fabriken im EU-gerechten Maßstab, das alle Aspekte der Wirtschaft durchdringen soll – ein Aufruf zur radikalen Transformation?

Der Begriff „Gigafactory“ entstand im Zusammenhang mit der Batterieproduktion. Doch im Jahre 2025 steht er sinnbildlich für gigantische KI-Rechenzentren. Diese Facilities sollen Europas digitale Zukunft anstoßen. Getrieben von dreistellig milliardenschweren Förderprogrammen der EU und einem neu entflammten PublicPrivate-Engagement formieren sich überall Allianzen aus Industrie, Forschung und Politik.

REGULIERTE RECHENRÄUME: DIE KI-GIGAFACTORIES DER EU

Die Europäische Kommission macht ernst: Mit einem „massiv skalaren“ Investitionspaket von rund 200 Milliarden Euro will Brüssel den Bau von mindestens fünf KI-Gigafactories anstoßen. Die EU stellt anfangs bis zu 20 Milliarden Euro an direkten Fördermitteln als Anschubfinanzierung bereit. Diese Gelder sollen dann zusätzliche private und national Investitionen aktivieren, sodass das Gesamtinvestitionsvolumen auf bis zu 200 Milliarden Euro anwachsen könnte. Das Ziel: Europas digitale Souveränität sichern. Resiliente Rechenzentrumsinfrastrukturen für das KI-Zeitalter auf die Beine

„DIE ENTWICKLUNG STEHT AN EINEM KRITISCHEN PUNKT: JETZT ENTSCHEIDET SICH, WER DIE CHANCEN VON GENERATIVER KI NUTZEN KANN, UM NACHHALTIGE WETTBEWERBSVORTEILE ZU SCHAFFEN“, SO STEFAN BROCK, HEAD OF THE AI CENTER OF EXCELLENCE IN CENTRAL EUROPE BEI HEWLETT PACKARD ENTERPRISE (HPE).

BILD: HPE

stellen. Gemeinsam das KI-Zeitalter einläuten. Innovieren. Jenes vollbringen, was die private Wirtschaft nicht will, nicht darf oder nicht kann.

Diese Infrastrukturen sollen von Grund auf für KI-Berechnungen, Training großer Sprachmodelle und inferenzintensive Workloads konzipiert sein: modular im Exaflop-Maßstab, vernetzt über hochleistungsfähige Glasfaserstrukturen, souverän, EU-konform und nicht zuletzt nachhaltig betrieben.

Die erste Generation dieser Anlagen wird auf Compute-Leistungen von jeweils über 500 PFlops zielen – unter

Einhaltung der EU-Leistungskennzahlen zur Redundanz und Nachhaltigkeit.

Die technischen Eckdaten sind nicht ohne. Sie umfassen Anforderungen wie:

• mindestens 100 MW IT-Last aufrüstbar auf 300 MW;

• 100 % KI-fähige Hardware, mindestens 40 % davon für Inferenz-Workloads optimiert;

• mindestens zwei nationale Stromnetzanbindungen (Redundanzklasse ≥ Tier IV);

• Integration mit Wasserstoff- oder Hybridenergiequellen;

• Nutzung freier Software für das Betriebsmanagement (z. B. DCIM, Scheduler);

• verbunden mit mindestens zwei EU-weiten Forschungsnetzwerken (z. B. GÉANT, EuroHPC).

Im Hintergrund laufen bereits Verhandlungen mit mehreren europäischen OEMs – darunter Atos, Eviden, ParTec – sowie aufstrebenden FPGAund RISC-V-Spezialisten wie SiPearl. In der Softwareinfrastruktur könnten Projekte wie Gaia-X, Sovereign

Cloud Stack oder Eclipse OpenDCIM eine tragende Rolle spielen. Ein Bestandteil der Architektur: HighDensity Liquid Cooling auf Basis offener Standards wie OCP NIC 4.0 und Advanced Cooling Solutions. Der Energiebedarf pro Anlage liegt zwischen 80 und 120 MW. Die Betreiber werden verpflichtet, mindestens 50 Prozent ihres Energiebezugs aus lokal erzeugten erneuerbaren Quel-

len zu decken. Nach bisherigen Informationen aus dem EU-Rat kommen für das Projekt Regionen infrage, die sich durch drei Merkmale auszeichnen:

• Netzkapazitäten mit 220-kV-Zugang und bestehenden Umspannwerken;

• Abwärmeabnehmer aus kommunaler Fernwärme oder Industrie;

• bestehende HPC-Infrastruktur (z. B. Forschungszentren, Universitäten, Supercomputing-Zentren).

Favorisiert werden Standorte wie Jülich (NRW), Bologna (Italien), Ostrava (Tschechien) oder das katalanische Lleida. In Deutschland gilt insbesondere das Umfeld des Jupiter-Projekts als aussichtsreich. Das Helmholtz-Zentrum Jülich, in enger Zusammenarbeit mit ParTec und Eviden, hat hier bereits eine europäische Exascale-Architektur entwickelt, die sich modular in eine Gigafactory integrieren ließe. Das Projekt Jupiter ist ein hybrides Modell zwischen Supercomputing und AI Factory – mit EuroHPC-Geldern und privaten Technologiepartnern.

EIN AUFRUF ZUR SOUVERÄNITÄT

Die europäischen KI-Gigafactories setzen andere Schwerpunkte als die Hyperscaler. Sie sind nicht primär größer – sie sind fokussierter, dichter, strategischer. Hyperscaler sind auf

generalisierte, hochverfügbare Cloud-Services ausgelegt und global orchestriert. In der Gigafactory geht es um die souveräne KI auf europäischem Boden. Während Hyperscaler aus geschäftlichem Eigeninteresse im Takt des Börsentickers wachsen, fußen die Gigafactories auf einer teilöffentlichen, kofinanzierten Trägerschaft. Die Standorte werden nicht allein nach Wirtschaftlichkeit, sondern auch nach strategischer Versorgungssicherheit und regulatorischer Durchsetzbarkeit ausgewählt. Es gibt Gewinner und Verlierer. Anders als Hyperscaler-Campuslösungen sind die Gigafactories der EU als öffentlich-private Partnerschaften (PPP) angelegt – unter Beteiligung europäischer Energiekonzerne, Telekommunikationsunternehmen, Hardwareanbieter, Softwarehäuser und Kommunen. Die EU übernimmt die Kofinanzierung.

Die EU verfolgt für den Aufbau europäischer KI-Gigafactories einen gezielt kooperativen und vielschichtigen Finanzierungsansatz. Kern der Initiative ist das Programm InvestAI, das insgesamt bis zu 50 Milliarden Euro an öffentlichen Mitteln mobilisiert. Davon sind 20 Milliarden Euro direkt vorgesehen, um vier bis fünf hochskalierbare KI-Gigafactories zu finanzieren. Ziel dieser Großanlagen ist es, die Infrastruktur für große gene-

rative KI-Modelle in Europa aufzubauen und so technologische und digitale Souveränität zu gewährleisten. Diese öffentlichen Mittel stammen aus unterschiedlichen EU-Finanzierungsinstrumenten – darunter Digital Europe, Horizon Europe, InvestEU sowie von europäischen Kohäsionsfonds.

Ergänzend werden erhebliche private Investitionen erwartet: Die sogenannte AI Champions Initiative soll zusätzliche 150 Milliarden Euro aus privater Hand generieren, etwa von Industriekonsortien, Tech-Unternehmen und Investoren. Diese Kombination aus öffentlichem Startkapital und privater Kofinanzierung ergibt ein beachtliches Gesamtinvestitionsvolumen von rund 200 Milliarden Euro für KI-Technologien in Europa.

Darüber hinaus flankiert die EU diese Strategie mit dem European Chips Act, der bis 2030 mindestens weitere 43 Milliarden Euro mobilisieren soll, um die europäische Chipproduktion auszubauen und damit Lieferkettenrisiken für die KI-Infrastrukturen zu reduzieren. Diese zusätzliche Förderung soll die europäische Selbstver-

CHRISTINA RAAB, CHEFIN VON ACCENTURE DEUTSCHLAND UND VIZEPRÄSIDENTIN VON BITKOM:

„DA

KOMMT

EIN ENORMER ENERGIEBEDARF AUF DIE EUROPÄISCHE UNION ZU.“

BILD: BITKOM

sorgung mit Hochleistungschips verbessern und gilt als ein Schlüsselfaktor für die Effizienz und Wettbewerbsfähigkeit der KI-Gigafactories.

Hinter dem öffentlichkeitswirksam betonten Ziel der technologischen Unabhängigkeit verbirgt sich eine tiefgreifende gesellschaftliche Neuausrichtung, deren Folgen für die demokratische Kontrolle der Ressourcen und Institutionen bislang kaum öffentlich diskutiert werden. KI-Gigafactories in öffentlicher Hand bringen mit sich eine gigaskalare Verschiebung der Machtverhältnisse. Rechenleistung wird zu einer Form politischer Gestaltungsmacht. Ist die Demokratie bereit dafür?

Die Frage ist nicht, ob sie gebraucht werden, sondern: Wer bekommt dazu den Zugang? Wer kontrolliert sie? Wie tief greifen die Erkenntnisse in das Gewebe der Wirtschaft und Gesellschaft ein? Werden die Handlungsempfehlungen verpflichtend sein?

Die EU will sich durch diese Rechenzentren unter dem Mantel der digitalen Souveränität vom Oligopol der Hyperscaler befreien. Doch diese Umgehung schafft auch neue Abhängigkeiten: Statt marktgetriebener Plattformen dominieren künftig einheimische EU-gestützte PublicPrivate-Konsortien. Transparenz, Mitbestimmung und Rechenschaftspflichten werden bisher noch

kaum diskutiert. Es droht ein neues Machtungleichgewicht – nicht mehr zwischen Europa und den USA, sondern zwischen Bürgern und Institutionen. (Darum prüfe, wer sich binden lässt!)

Eine dieser KI-Gigafabriken will ein Konsortium um SAP, Deutsche Telekom (T-Systems), IONOS und der SchwarzGruppe (Cloud-Sparte Stackit) bauen. „Es geht nur im Schulterschluss – jetzt ist die Gelegenheit, eine eigene unabhängige Infrastruktur zu schaffen“, erklärte T-Systems-CTO Christine Knackfuss-Nicolic zur Motivation. In Walldorf und Bonn erproben SAP, Deutsche Telekom (T-Systems) und IONOS ein gemeinsames Projekt zur Entwicklung einer souveränen GenAIInfrastruktur – bekannt unter dem Arbeitstitel „AI Sovereignty Cloud“ –für generative KI-Anwendungen. Es dient als ein Proof-of-Concept für eine vertrauenswürdige europäische KI-Infrastruktur, die sich von US-Hyperscalern abgrenzt. SAP bringt dabei seine Expertise in Business-Software und Datenmanagement ein, Telekom die Infrastruktur und Netzkompetenz, IONOS die Cloud-Plattform. Trotz aller Euphorie mahnen Experten zur Vorsicht. „Da kommt ein enormer Energiebedarf auf die Europäische Union zu“, beobachtet nüchtern

Christina Raab, Chefin von Accenture Deutschland und Vizepräsidentin von Bitkom.

FAZIT

Der Wettbewerb um die Trainingsund Inferenzkapazitäten der Zukunft hat begonnen – und wer zu spät kommt, den bestrafen nicht Gesetze, sondern Latenzen, Energiepreise und Innovationszyklen. Die Rechenzentrumsbranche in Europa steht vor einem Paradigmenwechsel. KI-Gigafactories bündeln politische Vision, industrielle Kooperation und technologische Höchstleistung. Für die Branche bedeutet das neue Chancen, aber auch neue Anforderungen – an Größe, Schnelligkeit, Effizienz. Unternehmens-IT-Abteilungen bereiten sich parallel auf eine Ära vor, in der HPC und KI-Workloads zum Alltag gehören. Kooperation ist das Gebot der Stunde.

Zukunftssicherheit gibt es nicht zum Nulltarif und nicht mit angezogener Handbremse. Jetzt ist die Zeit, mutig neue Allianzen zu schmieden, in frische Ideen zu investieren und gemeinsam Probleme zu lösen.

BILD: JANITZA ELECTRONICS GMBH

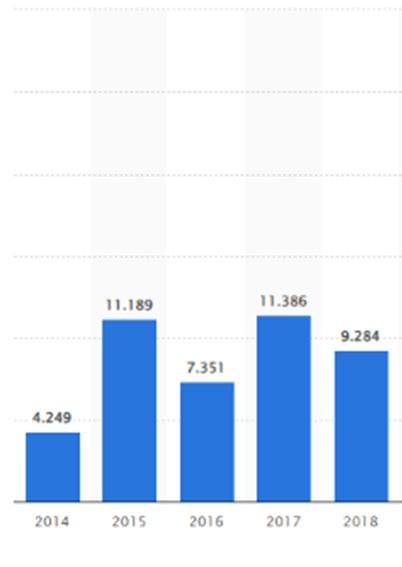

NETZSTABILITÄT IN DEUTSCHLAND

Spannungsstabilität im Kontext des Ausbaus erneuerbarer Energien, Redispatch und eines stark wachsenden Datacenter-Markts

Die Energiewende und die fortschreitende Digitalisierung fordern das deutsche Stromnetz in zweifacher Hinsicht: Durch den Zubau erneuerbarer Energien nimmt die Volatilität der Einspeisung zu, was zu vermehrten Redispatch-Maßnahmen führt. Zusätzlich wächst mit der steigenden Zahl energieintensiver Rechenzentren der Anspruch an Netzqualität und Versorgungssicherheit.

30 -

ÜBERSICHT DER MESSPUNKTE

BILD: JANITZA ELECTRONICS GMBH

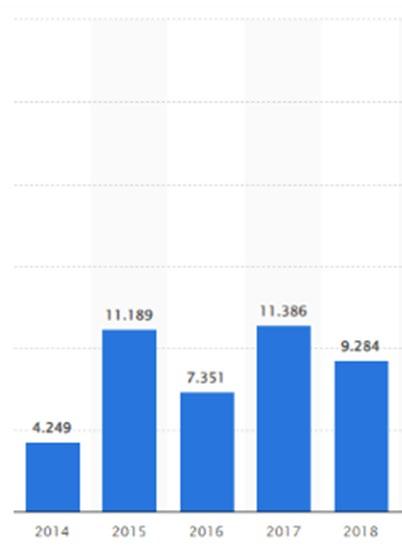

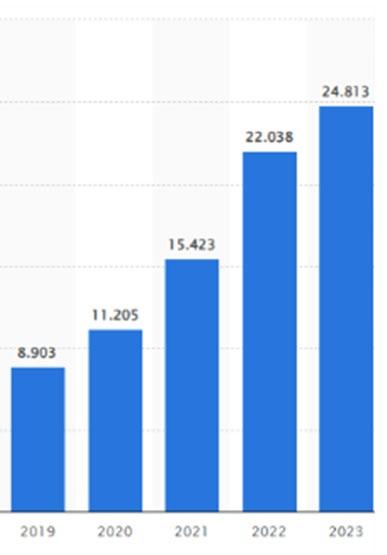

ZUNAHME VON REDISPATCH-MASSNAHMEN ZUR VERMEIDUNG VON NETZENGPÄSSEN BILD: STATISTA

FOLGENDE FRAGEN MÖCHTE ICH ANHAND VON

MESSDATEN BEANTWORTEN:

Wie verhalten sich Rechenzentren als Großverbraucher im deutschen Stromnetz hinsichtlich der Netzqualität? Wie ist die allgemeine Netzstabilität bzw. Spannungsverfügbarkeit? Bietet das deutsche Netz eine solide Grundlage für den Betrieb von Rechenzentren?

Grundlage der Analyse ist eine dreijährige Untersuchung an fünf Standorten in deutschen Ballungszentren. Alle Geräte arbeiten mit einer Abtastfrequenz von 25,6 kHz pro Phase, sind zeitsynchron, USV-gestützt, Klasse-Azertifiziert und zeichnen Strom-, Spannungs- und Frequenzanomalien auf. Dank der hohen Abtastrate können sehr schnelle Schwankungen ab 39 µs erfasst werden.

ANFORDERUNGEN AN DIE SPANNUNGSQUALITÄT

Die Betriebssicherheit von Rechenzentren hängt unmittelbar von der Qualität der Spannungsversorgung ab. Normative Grundlage bildet die DIN EN 506002-2. Sie fordert die Einhaltung folgender Netzqualitätsnormen:

• Primär- und Sekundärversorgung gemäß EN 50160

• Zusätzliche netzunabhängige Versorgung gemäß EN 61000-2-4:2002, Klasse 2

• Versorgung hinter USV-Systemen gemäß EN 61000-2-4:2002, Klasse 1

Durch kontinuierliche Netzqualitätsmessungen wird überprüft, ob die Verträglichkeitspegel zu 100 % eingehalten werden. Ein guter Indikator zur Bewertung der Netzqualität ist die Spannungsverzerrung (THDU). Der THDU-Grenzwert liegt im Bereich Netzbetreiber z. B. bei maximal 8 %.

Alle untersuchten Rechenzentren verfügen über moderne USV-Systeme, die mit aktiver Filtertechnik ausgestattet sind. Diese verhindern, dass Netzstörungen z. B. durch IT-Verbraucher ins öffentliche Netz getragen werden.

• Kein untersuchtes Rechenzentrum hat die Grenzwerte nach EN 61000-2-4 bzw. EN 50160 überschritten.

• Der durchschnittliche THDU lag bei lediglich 1,4–1,5 %, mit einem Maximum von etwa 2,3 %.

Rechenzentren sind „gutmütige“ Großverbraucher und verschlechtern die Netzqualität nicht. Das war in der Vergangenheit anders. Hier mussten USVAnlagen zum Teil über eigene Trafos versorgt werden und die Rückwirkungen ließen keine direkte Nachbarschaft zu anderen elektrischen Betriebsmitteln zu. Entsprechend alte Systeme sollten erneuert und gegen neue Systeme mit hohem Wirkungsgrad (bis 98 %) ersetzt werden. Sie amortisieren sich meist innerhalb weniger Jahre und auch der PUE verbessert sich.

FREQUENZSTABILITÄT

Die Stabilität wird im Wesentlichen anhand der Frequenz und der Spannung festgemacht. Die Netzfrequenz muss möglichst konstant gehalten werden. Kleine Schwankungen sind normal, sollten jedoch in engen Toleranzen bleiben. Beobachtung:

• Die Frequenz schwankt, aber Extrembereiche werden nur selten erreicht.

• Die zunehmenden Redispatch-Maßnahmen greifen wirksam und sorgen für Stabilität.

Redispatch sind Notmaßnahmen, um Engpässe im Übertragungsnetz zu vermeiden, und sollten langfristig reduziert werden. Dafür muss im Bereich der

FREQUENZVERLAUF 2022-2024

BILD: JANITZA ELECTRONICS GMBH

AUFZEICHNUNG VON EREIGNISSEN IN DEN STANDORTEN BILD: JANITZA ELECTRONICS GMBH

erhöhten Frequenz mehr Energie gespeichert und im unteren Bereich mehr gespeicherte Energie abgegeben werden – und das möglichst lokal und ortsnah beim Erzeuger/Verbraucher, damit überschüssige Energie erst gar nicht die systemrelevanten Haupttrassen überlastet.

Fazit zum Frequenzverlauf:

• Trotz zunehmender Engpässe bleibt das Netz stabil und die Regelmaßnahmen funktionieren zuverlässig.

• Keine offensichtliche Zunahme kritischer Frequenzschwankungen.

SPANNUNGSSTABILITÄT UND EREIGNISANALYSE

Als nächstes betrachten wir zeitgleiche Ereignisse an den verschiedenen Standorten und wie viele Anomalien insgesamt auftraten. Alle Daten wurden in einer Matrixtabelle erfasst.

• Es traten keine zeitgleichen Spannungsereignisse an verschiedenen Standorten auf.

• Die Ereignisse waren lokal begrenzte VNB-Ereignisse.

• Meist handelte es sich um sehr kurze Spannungseinbrüche.

• In den Sommermonaten wurden tendenziell mehr Ereignisse festgestellt.

BEWERTUNG DER EREIGNISSE MITTELS CBEMA-KURVE

Als nächstes werden Ereignisart und die Schwere der einzelnen Ereignisse betrachtet. Dazu eignet sich die CBEMA-Kurve, welche sehr verständlich kritische Unter- oder Überspannungen zusammenfasst. Die CBEMA in Begleitung von weiteren Auswertungen wurde für jeden Standort über drei Jahre aufbereitet.

• Es gab keine kritischen Überspannungen (z. B. >253 V), die Kaskadenausfälle an Kleinerzeugern verursachen könnten.

• Die Anzahl kritischer Unterspannungen ist grundsätzlich und übers Jahr gesehen sehr gering.

• Es gibt keine nennenswerten Standortunterschiede.

SCHLUSSWORT

ERGEBNISSE DER DREIJÄHRIGEN AUSWERTUNG

BILD: JANITZA ELECTRONICS GMBH

Deutschland ist weiterhin ein attraktiver Standort mit sehr hoher Spannungsverfügbarkeit. Dennoch können größere Ausfälle, wie z. B. in Spanien, nicht ausgeschlossen werden. Wir befinden uns jedoch in der komfortablen Situation, von Nachbarländern umgeben zu sein, die einen Energietransport in beide Richtungen ermöglichen. Rechenzentren der Zukunft bieten ein sehr großes Potenzial an Regelenergie – mit Größenordnungen, die definitiv nicht mehr zu vernachlässigen sind. Hierzu fehlt es dem EnEfG an Technologieoffenheit. Zudem müssen Genehmigungen für Regelenergie-Netzanschlüsse beschleunigt werden. Neben Abwärme-Nutzung ist die Bereitstellung aktiver Regelenergie naheliegend. Vielleicht werden die Rechenzentren der Zukunft wie Kraftwerke betrieben? Die Technik dafür existiert schon lange.

AUTOR UND KONTAKT VERTRIEB

Dipl.-Ing. (FH) Gerald Fritzen

Business Development Manager

Rechenzentren und RCM

35633 Lahnau – Germany

Telefon: +49 (0) 162 4269928

E-Mail: gerald.fritzen@janitza.de

Web: https://www.janitza.com/de-de

BILD: JANITZA ELECTRONICS GMBH

GRUNDLAGEN:

HIGH PERFORMANCE COMPUTING

ENORME RECHEN-POWER FÜR DAS DATACENTER

CLOUD-, KI-, IOT- UND EDGE-TECHNOLOGIEN ERHÖHEN ALLERORTEN DEN BEDARF AN RECHENLEISTUNG. DIE HERSTELLER VON HIGHPERFORMANCE-COMPUTING-TECHNIK

ARBEITEN FLEISSIG AN NEUEN ENTWICKLUNGEN. WIR GEBEN EINEN ÜBERBLICK.

PHOTONISCHES COMPUTING VON Q.ANT

Eine dieser neuen Technologien ist das so genannte Photonische Computing. Michael Förtsch, CEO von Q.ANT, erläutert DataCenter-Insider die neueste Entwicklung: ein Dünn-

schicht-Lithiumniobat-Photonikchip (TFLN) als Herzstück eines 19″ Rack Native Processing Servers (NPS). Dabei handelt es sich um einen Prozessor, der komplexe, nichtlineare mathematische Operationen direkt im optischen Bereich ausführt.

DER Q.ANT NATIVE PROCESSING SERVER LÄSST SICH NAHTLOS IN DIE BESTEHENDE RECHENZENTRUMSINFRASTRUKTUR INTEGRIEREN.

BILD: Q.ANT

Das Verfahren hat das Potenzial, herkömmliche CMOS-Chips und ihre Produktion zu revolutionieren. Auf der Supercomputing- und HPC-Messe ISC 2025 konnten Messeteilnehmer erstmals mit analogem Photonischem Computing interagieren, indem sie dem Server per „iPad“ eine Frucht zu „sehen“ gaben und dieser sie daraufhin korrekt identifizieren konnte. So wurde erlebbar, wie Licht einen Durchbruch in der Energie- und Berechnungseffizienz für KI, physikalische Simulationen und andere komplexe wissenschaftliche Aufgaben ermöglichen kann. „Unser Prozessor ist ideal für die Bilderkennung“, kommentiert Dr. Michael Förtsch, CEO von Q.ANT.

Die Technologie verspricht eine bis zu 30-mal höhere Energieeffizienz im Vergleich zu konventionellen Technologien und wird damit neue Leistungs-Benchmarks und Meilensteine für die Funktionalität von KI in HPCSystemen setzen: 16-Bit-FloatingPoint-Präzision mit 99,7 Prozent Genauigkeit für alle Rechenoperationen auf dem Chip sowie 40 bis 50 Prozent weniger Rechenoperationen für gleichwertige Ergebnisse.

Für Betreiber von Rechenzentren dürfte auch die Tatsache, dass für die Technologie keine aktive Kühlungsinfrastruktur erforderlich ist, was Kosten und Energie spart, von größtem Interesse sein. Laut Aussagen von Förtsch wird Ende des Jahres eine Prozessor-Reihe vorgestellt, die die Leistung von heutigen GPUs übertreffen wird. Darüber hinaus eigne sich die Technologie, bestehende Chip-Werke aufzurüsten. Die Neuromorphic Processing Units (NPUs) lassen sich nämlich über PCI-Express integrieren und unterstützt Industriestandard-Frameworks wie TensorFlow, PyTorch und Keras. Dadurch wird die Integration in heutige HPCund Rechenzentrumsumgebungen ermöglicht.

„Photonik verändert die Wirtschaftlichkeit von High-Performance-Computing grundlegend, insbesondere für immer komplexere KI, physikalische Simulationen und wissenschaftliche Aufgabenbereiche“, sagt Förtsch. „Wir haben den Overhead der digitalen Abstraktion eliminiert, indem wir mathematische Transformationen nativ mit Licht ausführen und damit einen Weg zu rechenintensiverem Computing eröffnen, das zudem skalierbar und nachhaltiger ist.“

KI-BESCHLEUNIGER VON AMD

AMD befeuert weiterhin die Nummer 1 und Nummer 2 der weltweit schnellsten Supercomputer. Für Mark Papermaster, AMD Chief Technology Officer und Executive Vice President in den USA, sind HPC und Künstliche Intelligenz (KI) durch ihre Hardware, Software und die Art ihrer Problemstellungen untrennbar miteinander verbunden. Er bezeichnet neuere Verfahren wie Frontier und El Capitan in den USA sowie LUMI und HPC6 in Europa als Meilensteine, weil sie die Leistungsgrenzen erweitern und zudem die Energieeffizienz verbessern. Gleichzeitig betont er den dringenden Bedarf an energieeffizientem Computing im großen Maßstab.

nen pro Sekunde ausführen und ist damit auf dem besten Weg, Europas erster Exascale-Supercomputer zu werden. Das System mit fast 24.000 Nvidia GH200 Grace Hopper Superchips und Anschluss an die Quantum-2-InfiniBand-Netzwerkplattform von Nvidia wird für Simulation, Training und Inferenz großer KI-Modelle – unter anderem für Klimamodellierung, Quantenforschung, Strukturbiologie, Computertechnik und Astrophysik – eingesetzt.

AMD präsentierte den lange angekündigten KI-Beschleuniger Instinct MI355X. MI355X soll in bestimmten Anwendungsfällen um bis zu 35-fach schneller agieren als der aktuelle MI300.

NVIDIA UND DIE EUROPÄISCHE FORSCHUNG

Der Nvidia-unterstützte Jülicher Supercomputer mit der Bezeichnung „Jupiter“ wurde gerade zum schnellsten Rechner in Europa und weltweit gesehen zur Nummer 4 gekürt. Er kann bald eine Trillion FP64-Operatio-

„Jupiter ist ein Meilenstein für die europäische Wissenschaft und Technologie“, erläutert Thomas Lippert, Co-Direktor des Jülich Supercomputing Centre (JSC). „Angetrieben von Nvidias beschleunigten Rechen- und KI-Plattformen erweitert er die Grenzen des grundlegenden Modelltrai-

nings und der Hochleistungssimulation und ermöglicht es Forschern in ganz Europa, Herausforderungen von beispielloser Komplexität zu bewältigen.“

Kristel Michielsen, JSC-Co-Direktorin, sieht in Nvidias CUDA-Q-Plattform und dem zugehörigen cuQuantum Software Development Kit die entscheidenden Werkzeuge, um hybrides Quanten-HPC-Computing weltweit voranzutreiben.

Auch das Leibniz-Rechenzentrum (LRZ) erhält bald einen neuen Supercomputer, der im Vergleich zum aktuellen LRZ-Hochleistungsrechner SuperMUC-NG rund 30-mal mehr Rechenleistung bietet. Er heißt Blue Lion und basiert auf der Vera-RubinArchitektur von Nvidia.

In Jülich sind der Jupiter-Booster und alle zugehörigen Speichersysteme vollständig aufgebaut und können über das Jupiter Research and Early Access Program mit mehr als 100 ausgewählten nationalen und internationalen Anwendungen, den GCS Exascale Pioneer Call sowie die ausgerufene Gauss AI Compute Competition für KI-Projekte genutzt werden.

Vera Rubin befeuert auch „Doudna“, das letzten Monat vom Lawrence Berkeley National Lab vorgestellt

wurde. Es handelt sich um einen neuen Superchip, der als Nachfolger von Blackwell die Rubin GPU und die Vera CPU, Nvidias erste kunden spezifische CPU, die im Gleichschritt mit der GPU arbeitet, vereint. Er kom biniert zudem Speicher, kohärente Rechenleistung und Netzwerkbe schleunigung und startet in der zwei ten Jahreshälfte 2026.

MITAC MIT NEUER SERVERPLATTFORM

MiTAC spielt gleich mit einer ganzen Reihe seiner Advanced Server Platforms beim High Performance Computing mit. Beim R2520G6 auf Basis der Intel-Xeon-6-Architektur handelt sich um einen 2U-Compute-Server mit zwei Sockeln und mit bis zu 8 TB DDR5-Speicher, vier PCIe-5.0-x16Steckplätzen und flexiblen U.2- und E1.S-Speicheroptionen.

Das 2U-2-Knoten-System M2710G6 richtet sich an Cloud-Serviceprovider und Hyperscaler. Jeder Knoten unterstützt einen einzelnen IntelXeon-6900P-Prozessor mit bis zu 128 Kernen pro Knoten.

Die GPU-beschleunigte Rechenplattform G4520G6 kommt mit zwei IntelXeon-6700P-Prozessoren und acht

Zu den Plattformen der AMD EPYC 9005 Series zählen der 1U-SingleSocket-Server TYAN GC68C-B8056, der speziell für High-Density-Cloudund KI-Umgebungen entwickelt wurde. Er ist ausgestattet mit 24 DDR5-DIMM-Steckplätzen, zwölf werkzeuglosen 2,5“-NVMe-U.2Hot-Swap-Einschüben und einem optimierten thermischen Design.

Ein 2U-4-Knoten-Single-Socket-System namens M2810Z5 unterstützt AMDEPYC-9005-Prozessoren. Jeder Knoten ist mit 12 DDR5-DIMM-Steckplätzen (bis zu 3 TB Speicher pro Knoten) ausgestattet und unterstützt vier E1.S-Laufwerke.

MSI SETZT AUF NVIDIA

Mit MSI stellt ein weiterer HardwareSpezialist High-Performance-Serverlösungen speziell für KI vor, die auf der Nvidia-MGX-Architektur basieren.

neral Manager of Enterprise Platform Solutions, nutzen diese modulare Architekturen, um KI- und Accelerated-Computing-Workloads verarbeiten zu können.

center Modular Hardware System) und kommt mit zwei Intel-Xeon-6-Prozessoren, 32 DDR5-DIMM-Steckplätzen und bis zu 24 PCIe-5.0-U.2-NVMeEinschüben.

Der 4U-KI-Server CG480-S5063 ist speziell für Hochleistungsaufgaben wie Large Language Model Training (LLM), Deep Learning und Feinabstimmung konzipiert. Er unterstützt zwei Intel-Xeon-6-Prozessoren und verfügt über acht FHFL-GPU-Steckplätze mit doppelter Breite, die mit Nvidia H200 NVL und Nvidia RTX PRO 6000 Blackwell Server Edition kompatibel sind und GPUs mit bis zu 600 W unterstützen. Zusätzlich ist er mit 32 DDR5-DIMM-Steckplätzen und 20 PCIe-5.0-E1.S-NVMe-Steckplätzen ausgestattet.

Der CG290-S3063 ist eine 2U-KI-Serverplattform und unterstützt einen Intel-Xeon-6-Prozessor mit einem Sockel, bis zu 16 DDR5-DIMM-Steckplätze und vier FHFL-GPU-Steckplätze mit doppelter Breite und eine Leistung von bis zu 600 W. Er bietet darüber hinaus eine PCIe-5.0-Erweiterung, vier rückwärtige 2,5“-NVMe-Laufwerksschächte und zwei M.2-NVMeSteckplätze.

Der 2-HE-Server CX270-S5062 basiert auf dem DC-MHS-Standard (Data-

Für Hyperscale-Cloud-Umgebungen bietet MSI den Open Compute CD281-S4051-X2 an – einen 21“-ORv3-kompatiblen 2OU-Server mit zwei Knoten, wovon jeder von einem einzelnen AMD-EPYC-9005Series-Prozessor angetrieben wird, der bis zu 500 W TDP unterstützt und mit zwölf DDR5-DIMM-Steckplätzen und bis zu zwölf PCIe-5.0-E3.SNVMe-Schächten ausgestattet ist. Zu den weiteren Leistungsmerkmalen gehören EVAC-CPU-Kühlkörper (Extended Volume Air Cooling) und die Kompatibilität mit der ORv3-48VDCStromversorgungsarchitektur.

NEUE STORAGE-ANSÄTZE FÜR HPC

Wen die Rechenleistung exponentiell wächst, muss auch die Speicherinfrastruktur mithalten können. Herkömmliche Speicherlösungen sind zu einem Engpass geworden. Aus diesem Grund haben viele HPC-Implementierungen eines gemeinsam: eine massiv skalierbare Speicherplattform, die auch leistungsstärkste Systeme versorgen kann.

Pure Storage hat mit FlashBlade//EXA eine von Grund auf neu konzipierte Speicherarchitektur im Köcher. Die Plattform bietet eine Lesegeschwindigkeit von über 10 TB/s und eine Schreibleistung von bis zu 50 Prozent der Lesegeschwindigkeit. Rob Lee, Chief Technology Officer bei Pure Storage, erklärt: „FlashBlade//EXA bietet eine massiv parallele Architektur, die eine unabhängige Skalierung von Daten und Metadaten ermöglicht. Storage beschleunigt nun das Tempo der Entwicklung von groß angelegten HPC- und KI-Anwendungen.“

Pure Storage kann zudem mit einer frischen Partnerschaft mit dem CERN openlab aufwarten. Ziel ist es, die Entwicklung modernster ICT-Lösungen für den Large Hadron Collider voranzutreiben. Das CERN generiert durch seine hochenergetischen Physikexperimente bekanntlich riesige Datenmengen. Im Rahmen der auf mehrere Jahre ausgelegten Vereinbarung soll untersucht werden, wie die DirectFlash-Technologie die Anforderungen der zukünftigen wissenschaftlichen Forschung unterstützen kann. Zudem geht es um die Optimierung der Flash-Infrastruktur im Exabyte-Bereich für Grid-Computingund HPC-Workloads.

„Wir gehen davon aus, dass diese Partnerschaft einige wichtige Vorteile für die Zukunft der Speicherung wissenschaftlicher Versuchsdaten bringen wird. Erstens erwarten wir, diese Technologie in unser groß angelegtes verteiltes Speichersystem zu integrieren und Daten effektiver bereitzustellen, wodurch die Speicherleistung über das heute Mögliche hinaus skaliert werden kann“, so Luca Mascetti, Storage CTO bei CERN openlab. „Zweitens hoffen wir, die nächste Generation bahnbrechender Entdeckungen in der Hochenergiephysik am CERN zu ermöglichen. Wir wollen der breiteren wissenschaftlichen Community das Potenzial für die Verbesserung der Speicherkapazitäten aufzeigen.“

BILD: GORODENKOFFSTOCK.ADOBE.COM

RECHENZENTREN

Die digitale Transformation schreitet rasant voran, und mit ihr steigen die Anforderungen an Rechenzentren. Künstliche Intelligenz, datenintensive Anwendungen und die Notwendigkeit, Daten in Echtzeit zu verarbeiten, stellen Unternehmen vor neue Herausforderungen. Genau hier setzt nConnect von nLighten an: Die europaweite Netzwerkservice-Plattform verbindet aktuell 18 Edge-Rechenzentren in vier Ländern und ebnet Unternehmen den Weg in eine neue Ära der digitalen Infrastruktur.

VERNETZT, FLEXIBEL, ZUKUNFTSSICHER

nConnect ist mehr als nur ein Netzwerkdienst, es ist die Antwort auf die

steigenden Anforderungen moderner IT-Landschaften. Unternehmen profitieren von ultraschneller Bereitstellung, flexiblen Bandbreitenoptionen und einer hochmodernen Netzwerkarchitektur, die speziell für die Anforderungen von KI-Workloads und kritischen Anwendungen entwickelt wurde. Die Plattform bietet vier zentrale Services: Cloud Connect (direkter Zugang zu führenden Cloud-Anbietern wie AWS, Azure und Google Cloud), DC Connect (direkte Verbindungen zwischen Rechenzentren und Carriern), Direct Internet Access (sichere, latenzarme Internetanbindung mit integriertem DDoS-Schutz) und IP Transit (Internet-Zugang mit eigenen IP-Adressen und AS-Nummern). Alle Services sind mit Bandbreiten bis zu 10 Gbit/s verfügbar und lassen sich flexibel kombinieren.

KI-WORKLOADS AM EDGE: EFFIZIENZ UND SICHERHEIT

Effizienz und senkt die Kosten für Datenübertragungen. Gleichzeitig sorgt die Plattform mit privaten Ethernet-Netzwerken, geschützten IP-Services und modernster Segmentierung für höchste Datensicherheit und Compliance. Unternehmen können so hybride und Multi-Cloud-Strategien umsetzen, ohne Kompromisse bei Datenschutz oder Performance eingehen zu müssen.

EUROPÄISCHE PRÄSENZ: VIER LÄNDER, ACHTZEHN

STANDORTE – UND ES WERDEN MEHR

Gerade für KI-getriebene Anwendungen ist die Nähe zum Nutzer entscheidend. nConnect ermöglicht es, Daten am Edge verarbeiten, also genau dort, wo sie entstehen. Das reduziert Latenzzeiten, erhöht die

Aktuell ist nConnect in vier der sieben nLighten-Märkte verfügbar: Deutschland (Frankfurt), Niederlande (Amsterdam), Frankreich (Paris) und Großbritannien (u.a. Birmingham, Bristol, Chester, Leeds, Liverpool, Milton Keynes, Nottingham und Swindon). Die Plattform verbindet 18 Edge-Rechenzentren und wird kontinuierlich ausgebaut, um noch mehr Unternehmen in ganz Europa Zugang zu leistungsstarker, resilienter und nachhaltiger digitaler Infrastruktur zu ermöglichen.

NACHHALTIGKEIT UND ZUKUNFTSFÄHIGKEIT IM FOKUS

nLighten setzt auf nachhaltige Lösungen: Die Rechenzentren sind eng mit lokalen Energie- und Wärmenetzen gekoppelt, nutzen erneuerbare Energien und bieten innovative Konzepte wie Abwärmenutzung. Mit transparenten Nachhaltigkeitsmetriken und der Integration in lokale Energiesysteme unterstützt nLighten Unternehmen dabei, ihre digitale CO2-Bilanz zu verbessern und regulatorische Anforderungen zu erfüllen.

DIE STARTRAMPE FÜR DIE

DIGITALE ZUKUNFT

Mit nConnect bietet nLighten eine Plattform, die weit über klassische Netzwerkdienste hinausgeht. Sie ist die Startrampe für Unternehmen, die ihre digitale Infrastruktur fit für die KI-Ära machen wollen – flexibel, sicher, nachhaltig und europaweit skalierbar. Wer heute nur optimiert, bleibt stehen. Wer auf nConnect setzt, startet durch.

https://www. nlighten .com/de/

GRUNDLAGEN:

DIE ZUKUNFT

DER KÜHLUNG VON

IT-KOMPONENTEN

EIN BLICK IN AKTUELLE RECHENZENTREN FÜHRT SCHNELL

ZU DER ERKENNTNIS, DASS DIESE MEHRHEITLICH MIT LUFT

GEKÜHLT WERDEN. UND DAS BEI STETIG STEIGENDEN ANFORDERUNGEN AN DIE LEISTUNGSFÄHIGKEIT UND DER IMMER HÖHEREN ENERGIEDICHTE. SELBST WENN DIE IT-KOMPONENTEN AUCH BEI HÖHEREN ZULUFTTEMPERATUREN NOCH BETRIEBSSICHER UND PERFORMANT ARBEITEN, IST DIESE ART DER KÜHLUNG AUF ETWA ACHT BIS ZEHN KILOWATT (KW) WÄRMEENERGIE BZW.

ELEKTRISCHE LEISTUNG JE RACK BEGRENZT. DIESE LEISTUNGSFÄHIGKEIT BEI DER LUFTKÜHLUNG WIRD NUR UNTER BEACHTUNG ALLER VORAUSSETZUNGEN ERREICHT.

DAZU GEHÖRT Z. B. DIE STRIKTE TRENNUNG VON ZU- UND ABLUFT.

DATACENTER-KLIMATISIERUNG

ASHRAE-VORGABEN

Als Maß aller Dinge für die Umgebungsbedingungen der IT-Komponenten (Lufttemperatur und -feuchtigkeit) gelten die Grenzwerte des ASHRAE Technical Committee (ashrae.org) 9.9, das in ihrem „Data Center Power Equipment Thermal Guidelines and Best Practices“ zwischen empfohlenen und erlaubten Grenzwerten unterscheidet. Für ITKomponenten der Klasse A1 sind empfohlene Grenzwerte von 18°C bis

27°C definiert. Die erlaubten Grenzwerte für diese IT-Komponenten liegen bei 15°C bis 32°C. Sollen nun aufgrund der steigenden Leistungsanforderungen einzelne oder mehrere Racks deutlich stärker belastet werden, können diese Grenzwerte nicht mehr eingehalten werden. Es muss also eine andere Art der Kühlung vorgesehen werden.

… DER EINE SAGT SO, DER ANDERE SO

Auf die Frage, was man unter Wasserkühlung im Rechenzentrum versteht, bekommt man die unterschiedlichsten Antworten. Ein Datacenter-Betreiber verwendet Luft-Wasser-Wärmetauscher an den Rücktüren seiner Racks und sagt, sein Rechenzentrum wäre wassergekühlt. Ein Hersteller aus dem DatacenterAusrüstungsbereich stattet seine Racks mit Luft-Wasser-Wärmetauscher, Ventilatoren, Ventilen und Regelung (also allen wesentlichen

BILD: JEONGUN JOSTOCK.ADOBE.COM / KI-GENERIERT

BILD: MGD - STOCK.ADOBE.COM / KI-GENERIERT

Komponenten eines UmluftKühlgerätes) aus und sagt, damit wäre das Rechenzentrum wassergekühlt. Die Wärmeenergie wird jedoch am Ort ihrer Umwandlung erst einmal der Luft zugeführt.

WASSERKÜHLUNG

Einige Server-Hersteller gehen schon einen Schritt weiter und nutzen die höhere spezifische Wärmekapazität von

te des Modells RI2208 an, wie sie auch bei Cloud&Heat

BILD: ANUSASTOCK.ADOBE.COM / KI-GENERIERT

IT-Komponenten immer noch zusätzlich mit Ventilatoren ausgestattet. Bauteile, welche nicht in die Wasserkühlung einbezogen werden können (z. B. die Netzteile), geben somit ihre Abwärme an die Raumluft ab. Zum anderen muss „noch“ heutzutage davon ausgegangen werden, dass Hersteller von aktiven IT-Komponenten gänzlich auf die Möglichkeit der Wasserkühlung verzichten. Daher muss immer noch ein Anteil der Wärmeenergie eines Rechenzentrums luftgekühlt werden. Dabei bietet die DLC-Kühlung die Möglichkeit, den PUE (Power Usage Effectiveness)-Wert „ehrlicher“ zu ermitteln. Die Leistung zum Betrieb der Ventilatoren in den IT-Komponenten gehört eigentlich zur Infrastruktur-Leistung, wird aber als ITLeistung erfasst. Im Normalfall wird deren Leistung durch Pumpen substituiert, welche sich definitiv als Infrastrukturleistung ermitteln lassen.

BILD: FORTUNE228STOCK.ADOBE.COM / KI-GENERIERT

Zur individuellen Bewertung dieser Lösungen müssen verschiedene Aspekte betrachtet werden.

1. WIRTSCHAFTLICHKEIT

Die Herstellungs- und Betriebskosten müssen herangezogen werden. So kann es ein großer Unterschied sein, ob die Lösung aus Standard-Bauteilen besteht, welche vom einfachen Kältetechniker vor Ort erstellt und instandgehalten werden kann oder ob es sich um ein patentiertes Produkt eines Herstellers handelt, mit welchem man dann über die Nutzungsdauer „verheiratet“ ist.

2. EFFIZIENZ UND NACHHALTIGKEIT

Unter diesem Aspekt zählen alle Maßnahmen zur Energieeinsparung. Unter dem Strich muss eine Zahl stehen, welche mir sagt, wie viel Energie mein Rechenzentrum braucht, um alle erforderlichen Aufgaben zu erledigen. Dabei muss der gesamte Lebenszyklus von der Produktion über die Nutzung bis zum Abriss betrachtet werden. Stichwort CO2-Abdruck, aber bitte vollständig und ehrlich.

3. VERFÜGBARKEIT

Der Service bzw. die Anwendung bestimmen die Verfügbarkeit konsequent top-down nach dem OSI-7-Schichtenmodell. Darunter stellt das Design der Stromversorgung, der Kühlung sowie der Bau- und Sicherheitstechnik das Fundament der gesamten IT-Infrastruktur dar. Dieses Fundament muss Normen-konform nach EN 50600 einer Geschäfts-Risikoanalyse entsprechen. Nicht mehr (sonst wird es zu teuer) und nicht weniger (sonst wird es zu anfällig). Server mit DirektHeißwasserkühlung verfügen über einen einzigen Anschluss (bestehend aus Vor- und Rücklauf) zum Kühlkreislauf. Falls an diesem Anschluss das Wasser nicht in der erforderlichen Menge und Temperatur zur Verfügung steht, gibt der Server seine Wärmeenergie von ca. 500 Watt an den Raum ab. Fällt die Kühlung aller 20 Server eines Racks aus, wird der Raum mit 10.000 Watt erhitzt. Falls das nicht passieren darf, müssen sich Redundanz gebende Server (z. B. die einzelnen Knoten eines Hochverfügbarkeits-Clusters) an verschiedene Kühlkreisläufe angeschlossen werden. Aus Sicht der Rechenzentrumsnorm DIN EN 50600 entspricht ein DLC-Server maximal der Verfügbarkeitsklasse VK2. Um hier die Konformität nach VK3 oder höher festzustellen, muss ebenfalls der Nachweis geführt werden, dass sich Redundanz gebende Server an verschiedene Kühlkreisläufe angeschlossen werden.

PUE ALS REALER WERT

DLC-Server sind leiser, benötigen weniger elektrische Leistung, verstauben nicht so stark und korrigieren den PUE-Wert eines Rechenzentrums. Die Direkt-Heißwasserkühlung ermöglicht einen Schritt zur Einhaltung des Energieeffizienzgesetzes. Wie groß dieser Schritt wird, hängt mit der Verbreitung dieser Technik zusammen. Einer raschen und weiten Verbreitung der Direkt-Heißwasserkühlung wäre eine Hersteller-neutrale Standardisierung der Anschluss- und Verteilungskomponenten innerhalb eines Racks dienlich. Es sollte eine Standardisierung ähnlich wie bei den Strom-Anschlüssen der IT-Komponenten (C13 oder C19 nach IEC 60320) herbeigeführt werden.

ÜBER DEN AUTOR: OLIVER WOLL

Oliver Woll ist Sicherheitsberater der VZM GmbH mit den Spezialgebieten Sicherheitskonzepte und Schwachstellenanalysen, Beratungen zum Neubau, zur Sanierung oder Auslagerung von IT-Infrastrukturen.

Atlantic Hotel, Heidelberg

Jetzt Ticket sichern unter www.dc-strategy-summit.de/anmeldung-2026

MITTELSTÄNDISCHE UNTERNEHMEN

STEHEN VOR EINEM DILEMMA:

AUCH SIE WOLLEN VON DEN

NEUEN ENTWICKLUNGEN WIE

KI UND CONTAINERISIERUNG

PROFITIEREN, IHNEN FEHLEN

JEDOCH DIE MITTEL UND DAS

PERSONAL. EINEN AUSWEG

AUS DIESEM DILEMMA LIEFERN

CO-LOCATION-RECHENZENTREN.

Mittelständische Unternehmen müssen seit jeher mit begrenzten IT-Ressourcen auskommen. Dass Geschäftsführer nebenbei die IT verwalten, ist in kleineren Unternehmen keine Seltenheit. Und auch im gehobenen Mittelstand müssen die IT-Verantwortlichen mehrere Themen und Gebiete auf einmal abdecken und betreuen, wobei der Schwerpunkt in der Regel auf dem ERP-System liegt. In den vergangenen Jahren versprachen Cloud und Hyperscaler, diese Engpässe im Mittelstand aufzulösen und die Unternehmen von Innovationen profitieren zu lassen. Lange hat es funktioniert.

In jüngster Zeit jedoch überfordert die technische, demografische und politische Entwicklung dieses Modell.

Im Mittelpunkt stehen die Herausforderungen Datensouveränität und Künstliche Intelligenz. Wie lassen sich Daten aus der Public Cloud zurückholen, ohne auf die notwendigen Anwendungen und Dienste zu verzichten? Wie können auch mittelständische Unternehmen von generativer Künstlicher Intelligenz profitieren, ohne Geschäftsgeheimnisse preiszugeben und Datenschutzbestimmungen zu verletzen?

Selbst wenn es ihnen gelänge, hätten sie nur den halben Weg geschafft. Datensouveränität, Contai-

nerisierung und Künstliche Intelligenz machen Investitionen in die bestehende Rechenzentrumsinfrastruktur unumgänglich. Hinzu kommt der Aufwand, sich in die neuen Technologien und Lösungen einzuarbeiten, Zertifizierungen zu erwerben und neue Prozesse einzuführen, um alle relevanten Regulierungen zu erfüllen. Wer die dafür nötigen Experten nicht einstellen kann, muss sie extern teuer einkaufen.

VORTEIL FACHPERSONAL, EFFIZIENZ UND REGIONALE NÄHE

Doch es gibt eine Alternative: Betreiber von Co-Location-Rechenzentren und deren Partner, die aktuell massiv in Deutschland in den Ausbau ihrer Kapazitäten investieren. Sie verfügen über das notwendige Personal, Fachwissen und die erforderlichen Zertifizierungen. Sie bieten aber noch einen weiteren Vorteil, der für mittelständische Unternehmen von besonderer Bedeutung ist: regionale Nähe.

Sie ist nicht nur für die alltägliche Zusammenarbeit wichtig – deutschsprachige Ansprechpartner und dieselbe Zeitzone –, sondern auch und vor allem für die Einsatzorte Künstlicher Intelligenz mit dem höchsten Wertschöpfungspotenzial: Produktions- und Lagerstandorte, wo es auf die Latenz ankommt.

www.northcdatacenters.de

Darüber hinaus profitieren mittelständische Unternehmen von den besseren Werten bei Energieverbrauch und Emissionen, was sich nicht nur positiv auf die Betriebskosten auswirkt, sondern auch auf die eigene Umweltbilanz. Letztere wird gerade für Zulieferer immer wichtiger, deren Kunden ihnen immer häufiger Auflagen dazu machen.

Ob sie ihre IT-Umgebung in Co-Location-Rechenzentren in ihrer Nähe betreiben lassen oder sich von dort zu Cloud-Anbietern verbinden: Als Belohnung winkt mittelständischen Unternehmen größere Effizienz, unterbrechungsfreier Geschäftsbetrieb, höhere Sicherheit und volle Selbstbestimmung über ihre Daten.

GRUNDLAGEN: INVESTOREN IM KÄFIG!

KOFINANZIERUNG IN COLOCATION & CO.

DIE NACHFRAGE NACH KI-FABRIKEN TREIBT NEUE

INVESTITIONSREKORDE. WER SCHNELLER BAUT, KANN SCHNELLER HOCHFAHREN. DER MARKT

DRÄNGT, DIE UHR TICKT. COLOCATION-BETREIBER GERATEN BESONDERS STARK UNTER DRUCK.