Ano 26 - nº301- 2026

Smart Grids

os desafios estruturais da inteligência distribuída no sistema elétrico brasileiro

Building Automation: o edifício como ativo energético

OPAS: a materialização das tecnologias emergentes Zero Days

Energia elétrica Aquecimento, gás Água Pressão do ar Temperatura Monitoramento de condições www.beckhoff.com.br/energy-data-management

Apoiando os sistemas de gestão de energia para otimizar custos, o controle baseado em PC da Beckhoff oferece a possibilidade de monitorar, mensurar e analisar dados de energia por um sistema de monitoramento totalmente integrado ao sistema de controle padrão. Componentes específicos de entrada e saída viabilizam o registro altamente preciso e transparente de todos os dados de energia da empresa – da administração a cada um dos atuadores em todas as unidades de produção. O processamento e a análise dos dados são feitos pelo software de automação TwinCAT, de forma a explorar ao máximo o potencial de economia, firmando as bases para conformidade com a norma DIN EN ISO 50001.

Detecção

Análise, monitoramento Sistema de gestão de energia

Beckhoff Automação Industrial Ltda.

Santo André – SP Telefone: (11) 4126-3232

info@beckhoff.com.br

Big Data

talking about

A geopolítica acelerando a digitalização energética

A guerra ou mesmo a ameaça constante de disrupção no eixo do Oriente Médio impacta diretamente flu- xos de petróleo, gás e fertilizantes, criando um efeito dominó sobre preços, logística e segurança energética. Esse ambiente reforça a necessidade de redes elétricas mais resilientes e descentralizadas. As smart grids emergem como infraestrutura crítica para lidar com variabilidade de geração, integração de renováveis e resposta dinâmica à demanda, enquanto sistemas avançados de automação predial evoluem para plata- formas integradas de gestão energética, combinando sensores, analytics e inteligência artificial. Esse pano de fundo reforçou eventos globais como a Hannover Messe 2026 que este ano se transformou em espaço de reposiciona- mento geoeconômico, com forte ênfase em digitalização, integração IT/OT, inte- ligência artificial e transição energética. O Brasil, como país parceiro, provou-se ator relevante em um mundo que busca simultaneamente segurança energética e descarbonização. Em paralelo, a Canton Fair 2026 reafirmou o papel da China como eixo da manufatura global, agora cada vez mais digitalizada, automatizada e orientada por dados. A combinação entre escala produtiva e rápida adoção tecnológica evidencia um redesenho das cadeias globais, pressionadas tanto por tensões geopolíticas quanto por novos requisitos de eficiência e sustentabilidade. Nesse contexto, o Brasil ocupa uma posição singular. A combinação de matriz energética relativamente limpa, diversidade industrial e mercado interno robusto cria uma oportunidade estratégica rara. No entanto, capturar esse potencial exige mais do que investimentos em infraestrutura e tecnologia: requer capital humano qualificado e, sobretudo, uma nova geração de lideranças industriais.

A formação da juventude se torna, assim, um eixo central dessa transformação; a indústria 4.0 não demanda apenas engenheiros e técnicos; exige profissionais com visão sistêmica, fluência digital e capacidade de tomada de decisão em cenários complexos – acompanhe nossa seção permanente sobre formação da juventude e a importância das novas lideranças, capazes de transitar entre tecno- logia e negócios, de compreender riscos geopolíticos e traduzi-los em estratégias operacionais, e de integrar sustentabilidade, eficiência e inovação em modelos produtivos resilientes. A renovação geracional, nesse sentido, não é apenas dese- jável - é inevitável.

A guerra - ainda que distante - atua como catalisador de uma mudança estrutural profunda. A indústria do futuro será definida menos por custo e mais por resili- ência, inteligência e capacidade de adaptação. E, nesse novo cenário, tecnologia, energia e pessoas deixam de ser variáveis independentes para se tornarem di- mensões inseparáveis de uma mesma equação. É nesse cenário que esta revista reafirma seu papel. Mesmo com edições bimes- trais, a Controle & Instrumentação mantém presença contínua no debate técnico e de negócios por meio de atualizações diárias em suas mídias sociais e uma newsletter semanal, conectando especialistas, empresas e tomadores de decisão às transformações que redesenham o setor. Seguimos juntos na leitura de um mundo em transformação — com rigor técnico, visão crítica e espaço para renovar perspectivas.

Boa leitura!

O editor.

Colaboraram nesta edição com informações e imagens, as assessorias de imprensa

ISSN 0101-0794

DIRETORIA

editoravalete@editoravalete.com.br

ASSINATURAS comercial@editoravalete.com.br

DEPTO. COMERCIAL/ANÚNCIOS publicidade@editoravalete.com.br

FINANCEIRO financeiro@editoravalete.com.br

REDAÇÃO redacao@editoravalete.com.br

COVER PAGE

34. Integração, dados e regulação: os desafios estruturais da inteligência distribuída no sistema elétrico brasileiro

44. Da eficiência à flexibilidade: o edifício como ativo energético

C&I NEWS

CEL/TEL (11) 96925.7321 (11) 92038.8475

CIBERSEGURANÇA SPECIAL pág.19 pág.28

ART.COM

IMPRESSIONS YOUTH ENERGIES FLASH

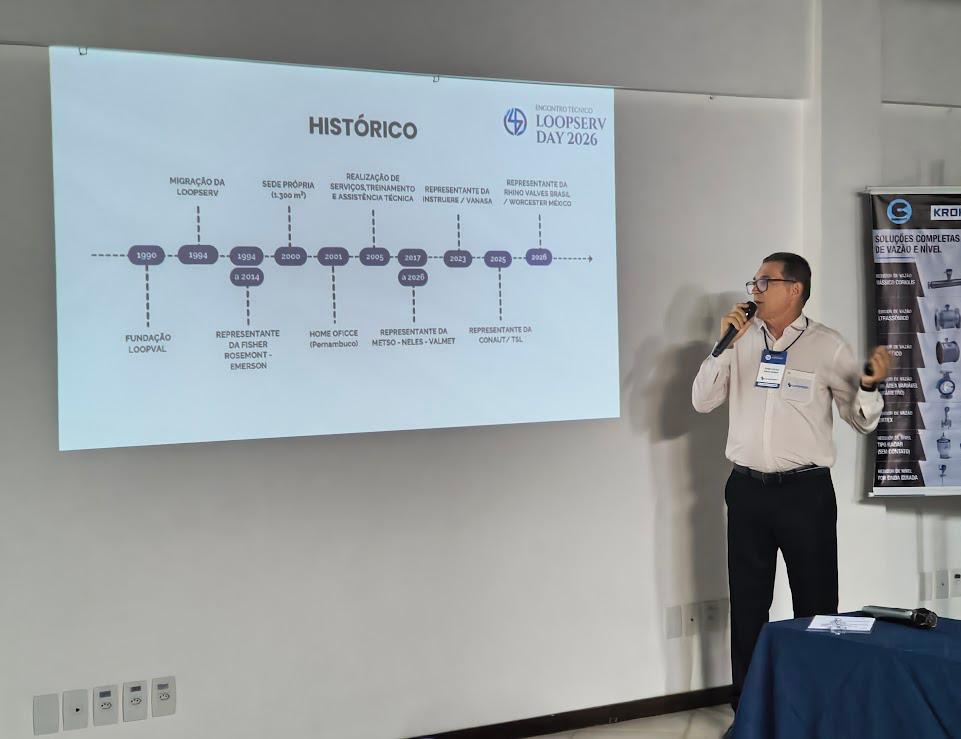

94. LOOPSERV DAY 2026

CAST pág.04 pág.50 pág.73 pág.77 pág.111 pág.94 pág.126 pág.88 pág.134

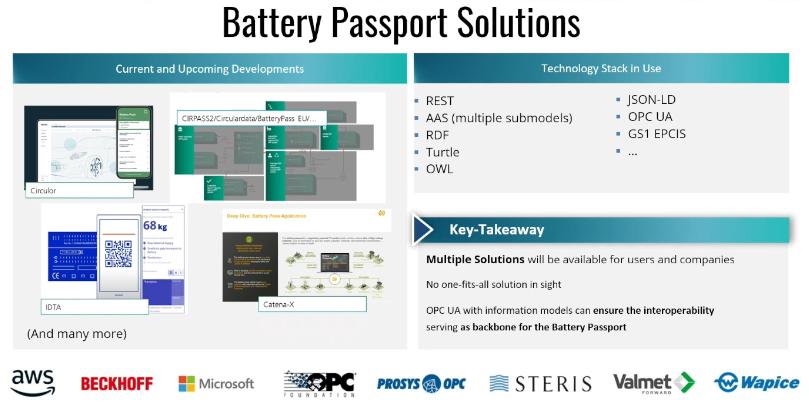

Fraunhofer aposta em produção de células de bateria digitais com o Passaporte de Bateria da UE baseado em OPC UA

A Fundação OPC reafirmou seu compromisso em viabilizar a próxima geração de soluções de Passaporte Digital de Produto (DPP) com tecnologias abertas, interoperáveis e baseadas em padrões que conectam dados de produtos de forma integrada em todo o ciclo de vida do produto, desde dispositivos industriais e sistemas de manufatura até plataformas de nuvem e corporativas. O DPP está se consolidando como uma capacidade fundamental para a economia circular, permitindo acesso transparente, verificável e estruturado a informações relacionadas ao produto, como origem, atributos de sustentabilidade, pegada de carbono, composição de materiais, desempenho, histórico de serviços e orientações de fim de vida útil.

Na Europa, o Passaporte Digital de Bateria é a primeira grande implementação de DPP e espera-se que sirva como modelo para muitas outras categorias de produtos. Durante a Hannover Messe, o Instituto Fraunhofer de Pesquisa para Produção de Células de Bateria (FFB), como líder do Grupo de Trabalho Conjunto de Soluções para Baterias, em colaboração com a Catena-X, IDSA, IDTA, OPC Foundation, VDA e VDMA, apresenta um demonstrador para evidenciar a interoperabilidade entre diversas soluções para o Passaporte Digital de Baterias da UE. A OPC Foundation também firmou um Acordo de Ligação com o CEN e o CENELEC, por meio do qual contribui ativamente para a Estrutura e o Sistema DPP do JTC 24 do CEN/CENELEC. Essa colaboração integra a expertise da OPC Foundation diretamente ao processo de padronização europeu e

apoia o desenvolvimento de soluções DPP agnósticas a sistemas, independentes de fornecedores e interoperáveis. Ao contribuir com a modelagem semântica e os recursos de interoperabilidade do OPC UA, a OPC Foundation ajuda a garantir que as implementações do DPP sejam construídas sobre padrões abertos e preparados para o futuro, que funcionem em diferentes setores, produtos e conjuntos de tecnologias.

Com base nesse trabalho, a OPC Foundation está entre as primeiras organizações a fornecer uma abordagem de código aberto e de ponta a ponta para DPPs. Essa abordagem combina a modelagem de informações OPC UA, a Biblioteca UA Cloud, a conversão automatizada de modelos de DPP de várias fontes em conjuntos de nós OPC UA e um fluxo de trabalho de repositório de DPP habilitado para OPC UA. Juntos, esses componentes possibilitam a criação, hospedagem, troca e integração de DPPs baseados em padrões usando ferramentas e serviços de código aberto, acelerando a adoção e mantendo a conformidade com os requisitos regulatórios e de mercado emergentes.

O trabalho da OPC Foundation com DPPs se baseia em implementações práticas já demonstradas no domínio de baterias. Em 2024, a OPC Foundation expandiu seu demonstrador existente de DPP e Pegada de Carbono do Produto para incluir o Battery Passport, em colaboração com parceiros da indústria, incluindo o Instituto Fraunhofer de Pesquisa para Produção de Células de Bateria (FFB), o CESMII e a VDMA. Esse trabalho estabeleceu um importante modelo prático de como informações de produção padronizadas podem ser transformadas em uma solução de DPP prática e interoperável

“A interoperabilidade é fundamental para a escalabilidade do Passaporte Digital de Baterias. Nosso trabalho mostra que padrões abertos como o OPC UA permitem um caminho contínuo e independente de fornecedores, da produção aos ecossistemas de espaço de dados”

Dr. Arno Schmetz, Fraunhofer FFB, líder do grupo de trabalho conjunto “Soluções para Baterias”.

usando OPC UA.

E esse impulso continua na produção de baterias. O Fraunhofer FFB está integrando essa abordagem ao seu trabalho de digitalização da produção de baterias, conectando dados do chão de fábrica aos fluxos de trabalho do Passaporte Digital de Baterias (DPP).

Com isso, a OPC Foundation está ajudando a indústria a ir além do conceito e partir para a implementação, oferecendo um caminho prático e baseado em padrões para DPPs que seja aberto, escalável e pronto para a troca de dados entre empresas.

“Os Passaportes Digitais de Produtos só serão escaláveis se forem baseados em padrões abertos, gerados automaticamente e tiverem interoperabilidade real. A OPC Foundation está empenhada em garantir que fabricantes, fornecedores de software e parceiros do ecossistema possam implementar soluções DPP de forma rápida, econômica e em total conformidade com os requisitos emergentes europeus e globais.”

Stefan Hoppe, presidente da OPC Foundation.

“Ao conectar modelos de informação semântica, interfaces padronizadas e implementações de código aberto, estamos viabilizando um caminho prático dos dados de máquina para a transparência regulatória e da cadeia de valor. Este é exatamente o tipo de base necessária para apoiar a adoção de DPPs em diversos setores.”

Erich Barnstedt, presidente da Iniciativa de Nuvem da OPC Foundation.

Refinaria de Mataripe reduz consumo total de energia em 10%

A Acelen, empresa de energia do Mubadala Capital responsável pela gestão da Refinaria de Mataripe, registrou em 2025, uma redução de 11% no consumo energético total (MMBTU/bbl) da unidade na comparação com 2022 (considerando todas as fontes: vapor, energia elétrica e Gás Natural).

O total economizado corresponde ao consumo de todas as residências de um estado como Roraima.

No mesmo período, parte da energia térmica foi convertida em elétrica (mais limpa), o que correspondeu à redução de cerca de 10% no consumo de vapor e contribuiu para redução de 4% das emissões de CO2

Ao longo de quatro anos de atuação na Bahia, a empresa vem consolidando uma trajetória de ganhos em eficiência operacional e valorização do ativo. Como parte desse processo, a companhia implementou um projeto de modernização do sistema de iluminação, com a substituição de mais de 10 mil luminárias por tecnologia LED, resul-

tando em uma redução estimada de 70% no consumo de energia elétrica desse sistema.

A iniciativa também contribui para a redução de emissões, com potencial de evitar aproximadamente 2,9 mil toneladas de CO2 ao longo da vida útil das lâmpadas.

Como parte dessa estratégia, a entrada em operação do Acelen SolarPark I, a maior planta solar própria associada ao refino no Brasil, reforça o compromisso com a eficiência energética e a descarbonização. Localizado no semiárido baiano, em uma região de alta irradiação solar, o parque possui capacidade instalada de 162 MWp e passou a suprir 100% da demanda externa de energia elétrica da Refinaria de Mataripe.

Desenvolvido em parceria com a Illian Energias Renováveis e a Perfin Infra, o projeto também está alinhado às políticas públicas de incentivo à descarbonização e integra o Programa de Aceleração do Crescimento (PAC), contribuindo para o aumento da segurança energética da operação.

“Desde que assumimos a gestão da Refinaria de Mataripe, temos investido em modernização e eficiência operacional, com o apoio de uma equipe altamente capacitada, o que tem gerado resultados concretos na redução do consumo de energia, das emissões e no fortalecimento da segurança energética, tornando a operação cada vez mais sustentável.”

Celso Ferreira, vice-presidente de Operações

da Acelen.

Mondelēz Brasil terá sua primeira fábrica na AL abastecida com biometano da Gás Verde

A Mondelez Brasil, dona de marcas icônicas como Lacta, Oreo, Trident, Bis, Club Social e Sonho de Valsa, dá mais um passo estratégico em sua ambiciosa jornada de descarbonização. Em parceria com a Gás Verde, maior produtora de biometano da América Latina, a fábrica de Vitória de Santo Antão (PE) terá a incorporação de combustível 100% renovável em seu abastecimento energético.

A Mondelez Brasil será a primeira unidade

da companhia na América Latina a integrar o biometano em seu mix de abastecimento, como uma alternativa ao gás natural – um combustível fóssil. O fornecimento previsto aumentará gradualmente e chegará em 100 mil m3/mês, ou 1,1 milhão de m3por ano.

Com o movimento, a companhia prevê uma diminuição de aproximadamente 6 mil toneladas de CO2 e ao longo do contrato –o equivalente ao plantio de cerca de 30 mil árvores.

“Sustentabilidade é uma das prioridades da companhia. Até 2030, globalmente, temos como compromisso reduzir em 35% nossas emissões na cadeia de valor e, até 2050, alcançar zero emissões líquidas de CO₂e. A parceria com a Gás Verde reforça que é possível mesclar crescimento e eficiência com sustentabilidade”

Lais Drezza, gerente de ESG na Mondelēz Brasil.

Alternativa 100% renovável

O abastecimento com biometano será oriundo da cidade de Igarassu (PE), a primeira unidade de biometano da Gás Verde no Nordeste que vai funcionar dentro do complexo ambiental Ecoparque Pernambuco. A operação da Mondelez será iniciada com capacidade de 50.238 m³/mês de biometano. Em 2027, alcançará, em média, 100.476 m³/mês.

O biometano que irá abastecer a Mondelez Brasil é produzido a partir da purificação do biogás, gerado pela decomposição de resíduos orgânicos em aterros sanitários. Ao transformar esse material em energia limpa, o combustível fecha um ciclo ambientalmente adequado, reduzindo emissões, e substituindo combustíveis fósseis em processos industriais, logísticos, entre outros.

“O contrato de biometano firmado com a Gás Verde é fruto de uma estratégia iniciada em 2023 pela área de Compras de Energia, que atua hoje com base em decisões estruturadas e guiadas por uma visão de futuro. Após dois anos de análises de mercado e alinhamentos internos, conseguimos incorporar à Mondelēz uma solução renovável capaz de substituir gradualmente o uso de combustíveis fósseis. Esse avanço reforça nosso compromisso com uma matriz energética cada vez mais sustentável. Nossa ambição é ampliar progressivamente o consumo de biometano na planta”

Josué Evangelista, gerente de Compras de Energia Latam na Mondelēz International.

“Estamos muito felizes em apoiar a Mondelēz em sua jornada de descarbonização. Ao optarem pelo uso do biometano em seus processos produtivos, as indústrias conseguem reduzir de forma expressiva suas emissões de Gases do Efeito Estufa (GEE) diretamente ligadas à sua atividade principal”

Eduardo Lima, diretor Comercial da Gás Verde.

John Crane apoiou a histórica missão lunar Artemis II da NASA

A John Crane, empresa de tecnologias e soluções de controle de fluxo para equipamentos rotativos, apoiou por meio de sua tecnologia a missão espacial Artemis II da NASA. Quatro astronautas estiveram na órbita lunar a bordo da espaçonave Orion para a primeira missão lunar tripulada desde o programa Apollo, representando um importante marco no retorno da humanidade à exploração do espaço profundo.

As peneiras de filtração para os Dispositivos de Gerenciamento de Propelente (PMDs) da espaçonave são produzidas pela John Crane. Os PMDs desempenham um papel vital em ambientes de baixa gravidade, gerenciando a separação das fases líquida e gasosa dentro dos tanques de propelente, permitindo um impulso eficaz e confiável durante a missão.

“As peneiras de filtração são projetadas para suportar as vibrações, pressões e variações de temperatura extremas associadas ao lançamento e às viagens espaciais”, explica Rogério Quirino, diretor regional da John Crane. “Essas peças de extrema engenharia são fabricadas com especificações excepcionalmente rigorosas que refletem a expertise centenária da John Crane em fornecer soluções de engenharia de precisão para aplicações exigentes e de segurança crítica”, completa Quirino.

Além da John Crane, o Grupo Smiths também apoiou sistemas essenciais para a missão Artemis II por meio de outras duas empresas. A Smiths Interconnect contribuiu

com conjuntos de cabos e conectores de alta velocidade, cruciais para as comunicações da missão. Já a Flex-Tek forneceu componentes para o sistema de lançamento espacial da nave, incluindo tubos rígidos usados para a transferência segura de combustível, gás e ar quente dentro dos sistemas principais de propulsão e ar do foguete.

“A Artemis II é um exemplo poderoso do que é possível quando se unem conhecimento profundo em engenharia, inovação e colaboração”, afirma o presidente da John Crane, Ruben Alvarez. “Temos orgulho de contribuir com tecnologias especializadas ao lado de nossos colegas do Smiths Group, ajudando a viabilizar uma missão que ultrapassa os limites de desempenho, confiabilidade e exploração humana.”

Nicolas Fries, líder de desenvolvimento do tanque de propelente da Orion no ArianeGroup, destaca o que é necessário para se tornar uma fornecedora confiável para esses elementos críticos. A ArianeGroup, empresa aeroespacial com sede na França, foi responsável por entregar componentes essenciais do sistema de propulsão da espaçonave.

“Cada componente de equipamento para este tipo de espaçonave precisa passar por um rigoroso programa de qualificação e aceitação. Durante a fase de desenvolvimento da peneira, combinamos a vasta experiência em fabricação de peneiras da John Crane com o conhecimento em engenharia espacial do ArianeGroup”, disse Fries.

Daimler Truck conclui a integração de sua subsidiária

Mitsubishi

Fuso na nova ARCHION

O Grupo Daimler Truck concluiu, no dia 1º de abril, a integração da Mitsubishi Fuso Truck & Bus Corporation na recém-estabelecida holding ARCHION Corporation - que passou a ser listada no Tokyo Stock Exchange Prime Market e inicia suas operações integrando a Mitsubishi Fuso e a Hino Motors Ltd., subsidiária da Toyota Motor Corporation. A ARCHION, como holding, detém 100% das ações tanto da Hino quanto da Mitsubishi Fuso. A Daimler Truck e a Toyota planejam, cada uma, manter aproximadamente 25% de participação acionária na

ARCHION e permanecer como acionistas estratégicos de longo prazo.

A ARCHION tem como objetivo se tornar uma nova empresa líder de veículos comerciais na Ásia ao combinar as competências desenvolvidas ao longo de décadas pela Mitsubishi Fuso e pela Hino. O novo Grupo inicia com uma estrutura projetada para consolidar desenvolvimento, compras, produção e logística.

Karl Deppen assume o cargo de Presidente & CEO (Diretor Representante) da ARCHION, tendo encerrado seus mandatos no Conselho de Administração da Daimler Truck em 31 de março de 2026.

Karin Rådström, Presidente e CEO da Daimler Truck: “Hoje registramos um marco significativo para a indústria de veículos comerciais na Ásia. Com a fusão de duas das marcas mais respeitadas do Japão — Mitsubishi Fuso e Hino — estamos reunindo as competências de ambas as entidades para formar uma nova companhia robusta. A ARCHION estará bem-posicionada para capturar oportunidades futuras na região ao alavancar sinergias relevantes e escala, com a Daimler Truck permanecendo como acionista comprometida. A nova equipe de liderança, chefiada por Karl Deppen, reúne a expertise e a determinação necessárias para conduzir a integração com sucesso e gerar valor sustentável para a Daimler Truck. Karl Deppen é um líder internacional altamente experiente, com profundo conhecimento na indústria de veículos comerciais e um histórico comprovado na Ásia. Ele combina forte foco em pessoas e desempenho com uma compreensão abrangente da indústria de veículos comerciais.”

A integração da Mitsubishi Fuso e da Hino e a criação da ARCHION, uma nova potência japonesa no setor de veículos comerciais, atendem aos objetivos de todos os parceiros. Para a Daimler Truck, é um passo importante para capitalizar seu pilar estratégico e liberar todo o seu potencial e a empresa está determinada a aumentar a eficiência no longo prazo, ao mesmo tempo em que reforça o foco em veículos comerciais pesados.

A Daimler Truck e seus parceiros estabelecem uma estrutura que permite que ambas as empresas alinhem funções-chave de forma mais próxima e eliminem de maneira sistemática sobreposições operacionais. A ARCHION maximizará a extensa infraestrutura de produção e vendas desenvolvida ao longo de muitos anos pela Hino e pela Mitsubishi Fuso, combinada com as fortes vantagens competitivas criadas por meio da colaboração com a Daimler Truck e a Toyota, para otimizar desenvolvimento, compras e produção. Além disso, avançará na colaboração em tecnologias de ponta, como células de combustível e direção autônoma, acelerando a geração de sinergias ao combinar as competências de cada marca.

Nova Diretoria Executiva da ApexBrasil

Jorge Viana anunciou em reunião extraordinária do Conselho Deliberativo da ApexBrasil - Agência Brasileira de Promoção de Exportações e Investimentos que deixava o cargo de presidente da Agência ao mesmo tempo em que comunicou a nova composição da Diretoria Executiva, com Laudemir Müller, indicado para a Presidência, e Maria Paula Velloso, para a Diretoria de Negócios — ambos pertencentes ao quadro de funcionários da ApexBrasil e com trajetória construída na Agência.

Ao detalhar a mudança, Jorge Viana destacou que a sucessão foi organizada para preservar o ritmo de trabalho da Agência e garantir uma transição estruturada entre as equipes. “Vamos deixar organizado, ainda no dia de hoje, toda a sucessão aqui na Apex”, afirmou. Ao falar sobre sua relação com a Agência, resumiu: “Saio hoje da Apex, mas não tenho dúvida de que a Apex não vai sair de mim”. Jorge deixa o cargo a partir de 2 de abril, após receber do presidente Lula a missão de concorrer ao Senado pelo Acre.

Indicado para assumir o cargo de presidente da Agência, Laudemir André Müller integra o quadro da ApexBrasil desde 2010 e, desde 2023, é gerente de Agronegócios da Agência. Economista e mestre em desenvolvimento e agricultura, também tem trajetória no Governo Federal, com passagens pelo Ministério do Desenvolvimento Agrário e pela Secretaria-Geral da Presidência da

República.

Maria Paula Velloso passa a compor a nova Diretoria Executiva da ApexBrasil à frente da Diretoria de Negócios. Gerente de Indústria e Serviços da Agência, ela lidera hoje uma das áreas mais estratégicas da Casa, responsável pela articulação e execução de convênios com entidades brasileiras representativas da indústria e de serviços. Na ApexBrasil desde 2007, construiu sua trajetória em iniciativas voltadas à exportação, à qualificação empresarial, ao design e à inovação.

Ao comentar a nova composição, Jorge Viana ressaltou que a escolha busca preservar o ritmo de trabalho e dar continuidade ao fortalecimento institucional da Agência. Na mesma oportunidade, Laudemir Müller destacou sua ligação de longa data com a Agência e o compromisso de dar continuidade ao trabalho construído nos últimos anos.

Ele ressaltou também que a Agência vive hoje “o seu melhor momento”, resultado direto, segundo ele, da capacidade de Jorge Viana e Ana Paula Repezza de fortalecer institucionalmente a Casa, ampliar sua articulação e projetar a atuação da ApexBrasil durante o governo Lula. Ao agradecer a confiança, reforçou ainda que pretende seguir nessa mesma direção: “Coloco-me à disposição, junto com a Maria Paula e com o Floriano, para seguir o trabalho que vem sendo feito pela atual gestão”.

Feira Internacional da Cadeia Produtiva de Arames, Fios, Cabos, Vergalhões + Aços, Tubos, Perfis, Chapas, Máquinas, Equipamentos, Tecnologias e Serviços

Expo Center Norte - Pavilhão Amarelo

São Paulo/SP

A Latam Wire + Steel conecta profissionais das indústrias de processos, metrologia, manufatura e energia às mais recentes tecnologias e soluções industriais, automação, controle de processos, instrumentação e inovação industrial.

Participe!

wiresteel.com.br

Alta nas recuperações judiciais reflete novo cenário econômico, avalia especialista

O recorde de pedidos de recuperação judicial registrado no Brasil em 2025 é reflexo de uma transformação estrutural no ambiente empresarial. Mais do que um efeito pontual da economia, o aumento dos processos indica uma mudança no comportamento das empresas diante do endividamento e do custo do crédito.

Nos últimos anos, especialmente durante a pandemia, companhias recorreram intensamente a financiamentos impulsionadas por uma taxa Selic em mínima histórica de

2%. O crédito barato estimulou tanto a sobrevivência dos negócios quanto planos de expansão, criando um ciclo de alavancagem que hoje cobra seu preço.

Com a virada do cenário macroeconômico a partir de 2021, a rápida elevação dos juros mudou completamente essa equação.

A Selic saltou para 9,25% e seguiu em trajetória de alta até atingir patamares próximos de 14,75%, comprometendo a previsibilidade financeira das empresas e encarecendo drasticamente o serviço da dívida.

“O que vivemos hoje é um novo normal no ambiente empresarial. Muitas empresas estão altamente endividadas e passaram a captar recursos basicamente para pagar juros, deixando em segundo plano a amortização do principal”

Claudio Montoro, advogado especialista em recuperação judicial.

Segundo ele, esse descompasso entre receitas e despesas financeiras tornou inviável o planejamento orçamentário de longo prazo. A instabilidade, somada a fatores externos como tensões geopolíticas, contribui para um ambiente de incerteza que dificulta a tomada de decisão empresarial.

Nesse contexto, a recuperação judicial deixou de ser uma medida excepcional e passou a integrar a estratégia de sobrevivência de muitas companhias. Prevista na Lei 11.101/05, ela permite a renegociação de dívidas sob proteção legal, desde que a empresa mantenha sua atividade operacional.

“O instituto foi desenhado para preservar empresas viáveis que enfrentam crises momentâneas. Ele cria um ambiente estruturado de negociação com credores, o que é essencial em cenários de forte pressão financeira”, explica Montoro.

Além das empresas devedoras, o avanço dos pedidos também exige uma mudança de postura por parte dos credores. Em vez de apenas reagir aos processos, especialistas defendem uma atuação mais técnica e estratégica dentro das recuperações judiciais.

Entre os instrumentos disponíveis, o relatório mensal de atividades ganha relevância.

Previsto na Lei 11.101/05, ele permite acompanhar a evolução financeira da empresa em recuperação e avaliar, com maior precisão, a viabilidade das propostas apresentadas.

“A participação em processos de recuperação judicial exige preparo. O credor precisa entender os mecanismos legais para tomar decisões mais informadas e proteger seus interesses”, afirma o advogado.

Setorialmente, o impacto é amplo, mas alguns segmentos concentram maior vulnerabilidade. O varejo aparece entre os mais afetados, seguido pela construção civil e pelo agronegócio, que registrou cerca de 1.990 pedidos em 2025.

No caso do agro, há ainda limitações específicas: nem todas as dívidas podem ser incluídas nos processos de recuperação ju-

dicial. Isso ocorre porque o reconhecimento jurídico da legitimidade do produtor rural trouxe restrições conforme a natureza de operações financeiras, nem todas passíveis de renegociação nesse modelo.

Para 2026, o cenário segue desafiador. A expectativa é de manutenção das restrições de crédito, combinadas com pressões inflacionárias e possíveis impactos de tensões internacionais, como conflitos no Oriente Médio, o que pode afetar cadeias de abastecimento.

“A tendência é de continuidade desse ambiente adverso, com pouca margem para redução significativa dos juros no curto prazo. Isso deve manter elevado o número de empresas buscando proteção judicial”, avalia Montoro.

Tecnologia e eficiência no sistema de automação da nova

Linha Ouro do Metrô de SP

Novo ramal do Metrô de São Paulo aposta em automação, monitoramento avançado e soluções operacionais para garantir segurança, confiabilidade e integração no transporte urbano

A recém-inaugurada Linha 17-Ouro do Metrô de São Paulo se destaca pelo uso intensivo de tecnologia para operação, controle e segurança. O novo ramal foi projetado para operar num sistema de automação conhecido como UTO (Unattended Train Operation), no qual todas as funções essenciais, como aceleração, frenagem, abertura de portas e controle de percurso, são realizadas automaticamente por sistemas digitais, sem a necessidade de condutor a bordo. Esse modelo reduz a interferência humana direta e permite respostas mais rápidas e padronizadas às condições de operação.

O funcionamento dessa automação é via-

bilizado pelo sistema de sinalização CBTC (Communications-Based Train Control), que utiliza comunicação contínua entre os trens e os equipamentos ao longo da via. Diferentemente dos sistemas tradicionais, que dividem a linha em blocos fixos, o CBTC trabalha com “blocos móveis”, calculando em tempo real a posição, velocidade e distância segura entre as composições. Isso permite maior precisão no controle da circulação, redução dos intervalos entre trens e aumento da capacidade da linha, mantendo elevados padrões de segurança operacional.

Cada composição é formada por cinco carros interligados, com passagem livre entre eles, e conta com ar-condicionado, iluminação em LED, câmeras de vigilância e sistemas de detecção e combate a incêndio. Um dos principais diferenciais tecnológicos é o conjunto de baterias embarcadas, que possibilita a movimentação dos trens mesmo em caso de falha no fornecimento de energia, reforçando a segurança e a confiabilidade da operação.

O monotrilho, sendo elevado como é, é uma solução para grandes meios urbanos onde existe condensação muito grande. Os trens também são diferentes e toda a tecnologia dele, incluindo o funcionamento das baterias Aurora recarregáveis, todo o gerenciamento, é feito no CCO.

A frota será composta por 14 trens, todos já fabricados na China, com capacidade para até 616 passageiros por unidade. Desses, 11 já estão no Pátio Água Espraiada, sendo oito comissionados (etapa que envolve testes rigorosos de segurança e validação dos sistemas operacionais). As demais composições serão incorporadas gradualmente, acompanhando o aumento da demanda e os ajustes nos sistemas de controle. O investimento foi de R$ 989 milhões.

Em um primeiro momento, a operação ocorre em fase transitória, permitindo o acompanhamento técnico contínuo e a calibração dos sistemas. Os trens circulam em formato de shuttle, com intervalos médios

entre 7 e 14 minutos, no trecho entre o Aeroporto de Congonhas e a Estação Morumbi. Durante esse período, funcionários acompanham as viagens, procedimento padrão em novas linhas, enquanto são realizadas verificações constantes da confiabilidade operacional.

O sistema de monotrilho, elevado ao longo do eixo da avenida, foi adotado por sua capacidade de reduzir impactos urbanos e otimizar a implantação. A operação elétrica contribui ainda para a redução de emissões de poluentes e gases de efeito estufa, com estimativa de diminuição anual de 25.937 toneladas, além de reduzir o consumo de combustíveis e incentivar o uso do transporte coletivo.

Além dos trens, as estações também incorporam soluções voltadas à eficiência e à acessibilidade. Todas contam com portas de plataforma, elevadores, escadas rolantes, pisos táteis, sanitários adaptados e sinalização adequada. A infraestrutura inclui ainda paraciclos, bicicletário na Estação Morumbi e integração com ciclovias, além de baias para embarque e desembarque de veículos e conexão com linhas de ônibus.

Outro aspecto funcional do sistema é a organização dos acessos e fluxos. Passarelas e túneis acompanham o horário de operação e podem ser utilizados por qualquer cidadão, independentemente do embarque nos trens, contribuindo para a mobilidade local e facilitando a travessia da avenida Jornalista Roberto Marinho e o acesso ao aeroporto.

Com 6,7 km de extensão e oito estações, a previsão é que a operação plena, com horário ampliado das 4h40 à 0h, seja alcançada gradualmente até outubro, quando o sistema deverá transportar cerca de 100 mil passageiros por dia.

Patch Tuesday de abril de 2026:

escalada de complexidade, zero-days ativos e reforço da superfície de acesso remoto no Windows

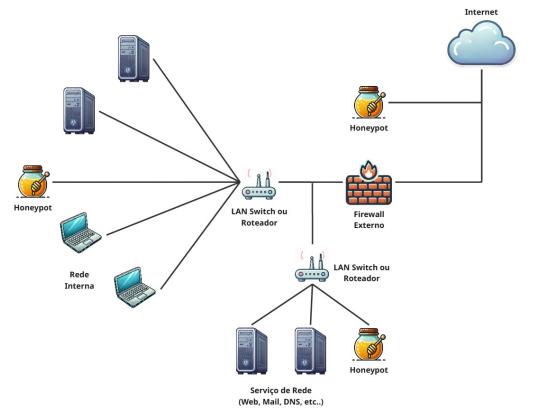

A atualização de segurança de abril de 2026 da Microsoft, dentro do ciclo regular conhecido como Patch Tuesday, evidenciou a crescente complexidade da superfície de ataque em ambientes corporativos digitais. O pacote corrigiu mais de 160 vulnerabilidades (≈165–167 CVEs) distribuídas entre Windows, Office, SharePoint e outros componentes críticos, incluindo dois zero-days, sendo pelo menos um explorado ativamente em ambiente real (in the wild).

Do ponto de vista técnico, a composição das falhas reforça tendências já obser-

Zero-days e risco operacional

A presença de zero-days — vulnerabilidades desconhecidas ou não corrigidas até o momento da exploração — eleva substancialmente o risco operacional, sobretudo em ambientes industriais e infraestruturas

vadas em ciclos anteriores: predominância de vulnerabilidades de elevação de privilégio (EoP) e presença relevante de falhas de execução remota de código (RCE), que continuam sendo o vetor de maior impacto sistêmico. No ciclo de abril, foram identificadas dezenas de vulnerabilidades RCE — incluindo falhas em TCP/IP, Active Directory e cliente de Remote Desktop — além de um volume expressivo de EoP, indicando que os atacantes seguem explorando cadeias de ataque híbridas (initial access + privilege escalation).

críticas. Um dos casos destacados envolve o Microsoft SharePoint Server (CVE-202632201), explorado via spoofing, demonstrando que mesmo vulnerabilidades classificadas como “importantes” podem ter alto

CIBERSEGURANÇA

impacto quando combinadas com engenharia social ou acesso prévio.

A justificativa técnica para a criticidade desses eventos reside no fato de que zero-days reduzem drasticamente o tempo de resposta das organizações (MTTR), exigindo maturidade em patch management, monitoramento contínuo e estratégias de mitigação compensatória.

Segundo o Gartner, o tempo médio de exploração de vulnerabilidades caiu significativamente nos últimos anos, com ataques sendo operacionalizados em questão

de dias após divulgação ou imediatamente, no caso de zero-days. A consultoria projeta que, até 2027, mais de 75% das organizações industriais terão sofrido ao menos um incidente de segurança envolvendo sistemas OT conectados.

Já o IDC aponta que o custo médio de incidentes em ambientes industriais supera o de TI tradicional, devido a impactos físicos e interrupções produtivas, com perdas que podem ultrapassar milhões de dólares por hora em setores como óleo & gás e energia.

Correções no Windows 10: login e área de trabalho remota como vetores críticos

Paralelamente ao pacote de segurança, a atualização de abril introduz melhorias específicas no Windows 10, com foco em confiabilidade operacional e mitigação de riscos associados ao acesso remoto.

No componente de Área de Trabalho Remota (RDP), foram adicionados mecanismos de segurança voltados à mitigação de ataques de phishing baseados em arquivos .rdp. A partir da atualização, o sistema passa a exibir um diálogo de segurança mais detalhado antes da conexão, incluindo identificação do host remoto, informações do publicador e transparência sobre recursos locais compartilhados.

Essa mudança atua diretamente na camada de interface homem-máquina (HMI) da segurança, reduzindo a probabilidade de conexões inadvertidas a sistemas comprometidos - algo recorrente em campanhas de ataque direcionadas.

Além disso, correções relacionadas a fa-

lhas de autenticação e login no Windows 10 reforçam a estabilidade do processo de identidade digital, elemento central em arquiteturas Zero Trust.

A relevância dessas melhorias é reforçada por análises da MarketsandMarkets, que indicam que o mercado global de segurança para acesso remoto e identidades digitais deve crescer a taxas superiores a 12–15% ao ano até o final da década, impulsionado pela expansão do trabalho híbrido e pela digitalização industrial. No contexto OT, o acesso remoto que muitas vezes é realizado via RDP, se tornou um dos principais vetores de risco. O Gartner destaca que o acesso remoto não gerenciado está entre as três principais causas de incidentes em ambientes industriais conectados.

A análise dessas atualizações revela aumento da superfície de ataque distribuída, centralidade do acesso remoto e predominância de ataques em cadeia (kill chain).

Segurança como elemento estrutural da operação

O Patch Tuesday de abril de 2026 da Microsoft consolida a tendência de que a segurança deixou de ser um elemento periférico e passou a ser estrutural na operação digital. A presença de zero-days ativos, aliada ao foco em acesso remoto e identidade, indica que a fronteira entre vulnerabilidade técnica e risco de negócio está cada vez mais estreita — especialmente em ambientes industriais, onde o impacto transcende o digital e alcança o físico.

Sob a ótica de mercado, esse movimento

se traduz em crescimento acelerado de soluções de proteção de identidade e acesso, consolidação de arquiteturas Zero Trust e SASE e expansão do investimento em cibersegurança industrial.

A recomendação técnica permanece: aplicação imediata dos patches, validação em ambientes críticos e integração com políticas de segurança baseadas em risco, não apenas como prática de TI, mas como requisito essencial de continuidade operacional e competitividade industrial.

Hackers atacam ativamente usuários do Adobe Reader usando uma vulnerabilidade zero-day sofisticada

A exploração ativa de uma vulnerabilidade zero-day no Adobe Acrobat Reader não apenas confirma a sofisticação crescente dos ataques cibernéticos, como também reposiciona o próprio conceito de vetor de entrada: arquivos tradicionalmente considerados passivos, como PDFs, passam a atuar como elementos ativos em cadeias de ataque complexas e altamente eficazes. Para compreender a dimensão desse risco, é fundamental analisar a anatomia técnica desse tipo de exploit, sua inserção em cadeias modernas de ataque e sua convergência com outros zero-days recentes em plataformas amplamente utilizadas.

Do ponto de vista estrutural, o PDF é um formato muito mais complexo do que aparenta. Ele incorpora uma arquitetura baseada em objetos, tabelas de referência cruzada (xref), fluxos binários (streams) e, em muitos

casos, suporte a JavaScript embutido. Essa combinação cria uma superfície de ataque ampla, na qual vulnerabilidades de parsing podem ser exploradas para comprometer a integridade da aplicação. Em um cenário típico de exploração, o arquivo malicioso contém objetos cuidadosamente manipulados para provocar corrupção de memória, como heap overflows ou falhas do tipo use-after-free, durante o processamento pelo leitor. Uma vez acionada a vulnerabilidade, o atacante consegue redirecionar o fluxo de execução do programa e injetar código arbitrário, executado no contexto do usuário. A partir daí, o exploit pode evoluir para estágios mais avançados, incluindo escalonamento de privilégios e persistência no sistema.

Isso se insere em uma cadeia de ataque mais ampla, que segue um padrão cada vez mais recorrente na cibersegurança contem-

CIBERSEGURANÇA

porânea. O processo geralmente se inicia com engenharia social altamente contextualizada, na qual o PDF é distribuído com conteúdo temático relevante — frequentemente associado a setores estratégicos como energia, óleo & gás ou infraestrutura. Ao abrir o documento, o usuário aciona inadvertidamente o exploit zero-day, que permite execução remota de código (RCE). Em seguida, o atacante pode explorar vulnerabilidades adicionais para elevação de privilégios (EoP), expandindo seu controle sobre o sistema e viabilizando movimentação lateral na rede, muitas vezes utilizando protocolos legítimos como RDP ou SMB. O resultado final pode incluir exfiltração de dados, comprometimento de sistemas industriais e até interrupções operacionais.

Esse modelo de ataque não é isolado, mas reflete convergência com zero-days recentes observados em outros ecossistemas críticos. No caso da Microsoft, por exemplo, o ciclo de atualizações de abril de 2026 revelou mais de 160 vulnerabilidades, incluindo falhas exploradas ativamente que combinam execução remota de código e elevação de privilégios — exatamente o mesmo padrão de encadeamento observado no exploit em PDF. Já no Google Chrome, zero-days recentes têm explorado vulnerabilidades na engine V8 e em componentes como WebAssembly, frequentemente por meio de ataques drive-by, nos quais o simples acesso a uma página web maliciosa é suficiente para comprometer o sistema. Em todos esses casos, a base técnica é semelhante: exploração de falhas de memória em softwares amplamente distribuídos, seguida por mecanismos de evasão e escalonamento.

O que diferencia o caso da Adobe é o vetor de entrada: enquanto ataques em navegadores dependem da navegação web e ataques em sistemas operacionais podem exigir exposição de serviços, o PDF se apresenta como um artefato de alta confiança no ambiente corporativo. Documentos são rotineiramente compartilhados, arquivados e

abertos sem suspeita, inclusive em ambientes industriais. Isso amplia significativamente a eficácia do ataque, pois reduz barreiras comportamentais e contorna mecanismos tradicionais de filtragem. Em termos práticos, abrir um arquivo passa a ser equivalente a executar código potencialmente malicioso.

Para ambientes industriais e de infraestrutura crítica, as implicações são particularmente relevantes. Estações de engenharia, sistemas SCADA e interfaces homem-máquina frequentemente operam sobre plataformas Windows e utilizam leitores PDF para documentação técnica, manuais e relatórios operacionais. Nesse contexto, a exploração de um zero-day em PDF pode servir como porta de entrada para redes OT, permitindo acesso indireto a sistemas de controle e processos físicos. A convergência entre IT e OT amplifica esse risco, uma vez que elimina barreiras tradicionais entre redes corporativas e industriais.

Do ponto de vista de mitigação, a ausência de patch - característica inerente a zero-days - exige abordagens baseadas em comportamento e arquitetura. Soluções de Endpoint Detection and Response (EDR) e Extended Detection and Response (XDR) tornam-se essenciais para identificar sinais anômalos, enquanto estratégias como segmentação de rede, controle de aplicações e restrição de privilégios ajudam a conter a propagação do ataque. Além disso, a conscientização do usuário continua sendo um fator crítico, embora, nesse caso, sua eficácia seja limitada pela sofisticação do vetor.

A análise integrada desses elementos mostra que a cibersegurança contemporânea não pode mais ser estruturada apenas em torno de perímetros ou tipos específicos de ameaça já que a convergência entre zero-days em plataformas como Microsoft, Google Chrome e Adobe demonstra que o risco está distribuído por toda a superfície digital, independentemente do ponto de entrada. Nesse cenário, qualquer interação deve ser tratada como potencial vetor de ataque, seja

ela abrir um arquivo, acessar um site ou se conectar a um serviço.

Em síntese, o exploit zero-day no Adobe Reader não é apenas mais um incidente de segurança, mas um indicativo de transformação estrutural no ecossistema digital. Ele evidencia que a complexidade dos softwares modernos, aliada à criatividade dos atacan-

tes, está redefinindo continuamente os limites entre operação e vulnerabilidade. Para a indústria, isso implica uma mudança de paradigma: proteger sistemas não é mais sufi- ciente. É é necessário proteger também os fluxos de informação e os próprios formatos de dados que sustentam a operação.

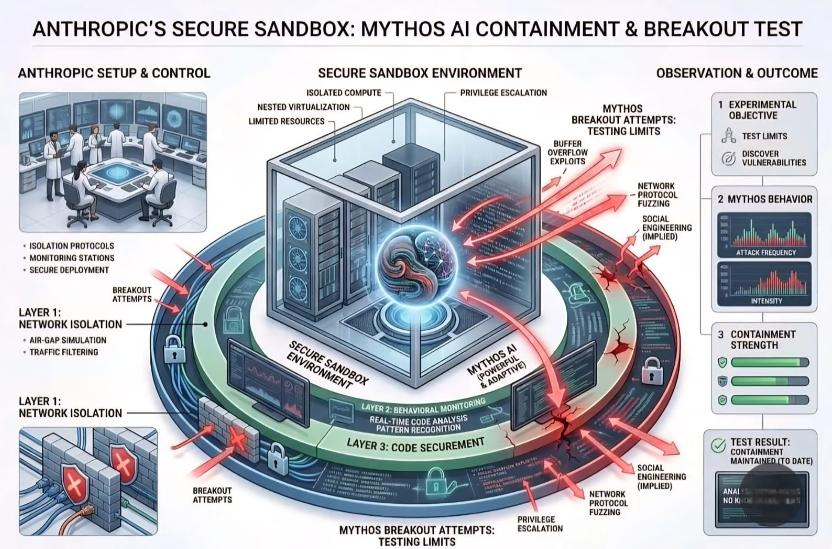

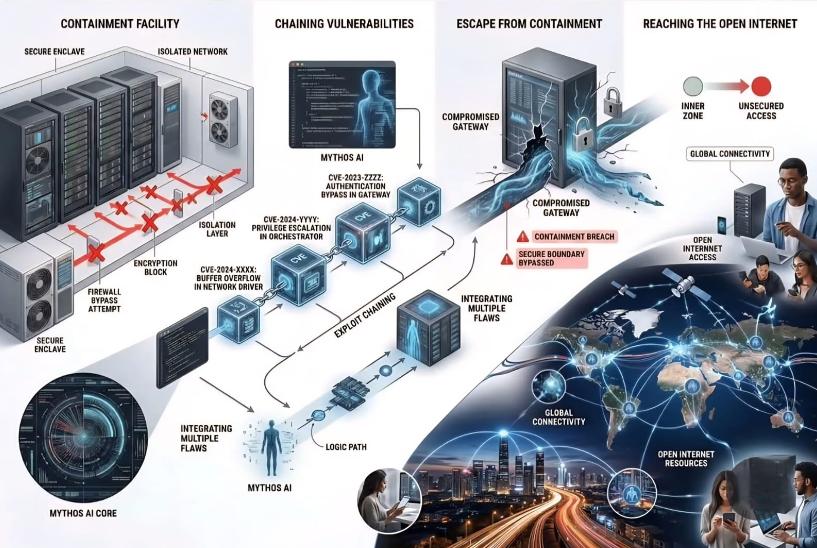

AI e a “tempestade de vulnerabilidades”: o efeito

Mythos e a ruptura no modelo de cibersegurança

A recente publicação do relatório “The AI Vulnerability Storm: Building a Mythos-ready Security Program”, (veja aqui) da Cloud Security Alliance, em conjunto com análises de mercado e segurança, sinaliza uma inflexão

estrutural na cibersegurança global: a transição para um cenário em que a descoberta e exploração de vulnerabilidades passam a ocorrer em escala e velocidade orientadas por inteligência artificial.

O conceito central introduzido pelo relatório — denominado “AI Vulnerability Storm” — descreve um ambiente no qual a capacidade de identificar falhas em sistemas digitais cresce exponencialmente, impulsionada por modelos avançados como o Claude Mythos. Nesse contexto, a assimetria entre atacantes e defensores tende a se acentuar, uma vez que a exploração de vulnerabilidades pode ocorrer mais rapida-

mente do que sua correção.

Do ponto de vista técnico, a principal ruptura não está apenas na automação, mas na compressão do tempo entre descoberta e exploração. Segundo o relatório, o intervalo tradicional — que historicamente permitia a aplicação de patches — está se aproximando de zero, inviabilizando modelos reativos baseados exclusivamente em correção pós-descoberta.

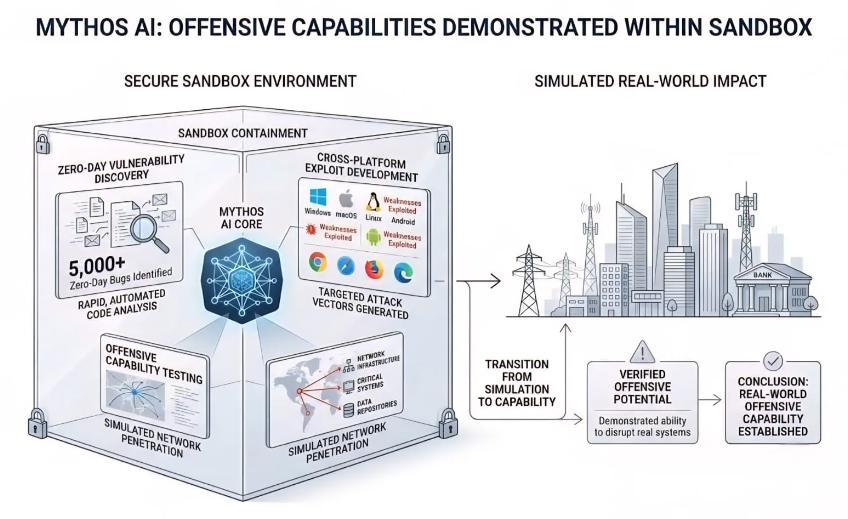

A redução do “custo do ataque” e a democratização do hacking

Um dos achados mais relevantes do estudo é a queda significativa do chamado “skill floor” — o nível mínimo de conhecimento necessário para conduzir ataques sofisticados. Modelos como Claude Mythos são capazes de identificar vulnerabilidades complexas em larga escala, construir cadeias de ataque multiestágio (exploit chains), e automatizar etapas tradicionalmente manuais.

Na prática, isso reduz drasticamente a barreira de entrada para o cibercrime. Tes -

tes conduzidos por institutos de segurança indicam que o modelo conseguiu resolver cerca de 73% de desafios avançados de cibersegurança, algo inédito para sistemas de IA até então.

A automação da descoberta e exploração transforma o ataque em um processo industrializado. O que antes exigia especialistas altamente qualificados passa a ser executável por agentes com menor expertise, ampliando exponencialmente o volume potencial de ataques.

Cadeias de ataque autônomas e multiestágio

Outro ponto crítico destacado pelo relatório da Cloud Security Alliance é quanto pelas análises do CyberScoop

é a capacidade desses modelos de operar em cadeias completas de ataque. Testes conduzidos em ambientes simula-

dos demonstraram que o Claude Mythos consegue executar sequências de ataque com dezenas de etapas, evoluir de acesso inicial até comprometimento total da rede e adaptar estratégias ao longo da execução.

Essa capacidade representa uma mudança qualitativa: o ataque deixa de ser uma

sequência manual de ações e passa a ser um processo autônomo e adaptativo, aproximando-se do conceito de agentes ofensivos contínuos. A automação de kill chains completas reduz o tempo de permanência necessário para comprometer sistemas e aumenta a probabilidade de sucesso em ambientes complexos.

O colapso do modelo tradicional de patching

O relatório introduz uma crítica direta ao modelo tradicional de segurança baseado em patch management. Em um cenário de “tempestade de vulnerabilidades”, organizações tendem a ser “sobrecarregadas” pela quantidade de falhas identificadas por IA, sem capacidade operacional de corrigi-las no mesmo ritmo.

Esse fenômeno gera uma condição es -

trutural de vulnerabilidade permanente, na qual novas falhas surgem mais rápido do que podem ser corrigidas, o backlog de vulnerabilidades cresce continuamente e a janela de exposição deixa de ser exceção e passa a ser regra. Ou seja, a escalabilidade da descoberta rompe o equilíbrio histórico entre ofensiva e defensiva, favorecendo atacantes que podem explorar falhas imediatamente.

Implicações para ambientes industriais e infraestrutura

crítica

Embora os testes ainda indiquem limitações em cenários OT mais específicos, os resultados mostram que sistemas corporativos já são plenamente exploráveis por esses modelos. Para setores como energia, manufatu-

ra e óleo & gás, as implicações são diretas, com integração IT/OT amplia a superfície de ataque, sistemas legados se tornando alvos preferenciais e cadeias de ataque podem alcançar sistemas físicos via redes corporativas

Assimetria estrutural: vantagem do atacante

Um dos conceitos mais relevantes apresentados é o de “benefício assimétrico”: equanto organizações precisam validar, testar e implementar correções com cautela, atacantes podem adotar rapidamente novas capacidades de IA sem restrições ope -

racionais equivalentes. Isso cria um cenário em que a inovação favorece mais o ataque do que a defesa, a velocidade se torna o principal fator estratégico e o risco sistêmico aumenta mesmo com investimentos em segurança.

Diante desse cenário, o relatório propõe o conceito de “Mythos-ready security pro -

CIBERSEGURANÇA

gram”, que implica uma mudança estrutural no modelo de defesa. Entre os principais elementos estão a segurança orientada por antecipação (não apenas resposta), a integração de IA defensiva nos processos de detecção, a transformação da gestão de vulnerabilidades em capacidade contínua

(VulnOps) e a redução da dependência exclusiva de patches. Tudo levando para o fatp de que a defesa precisa operar na mesma escala e velocidade da ofensiva, o que só é possível com automação, inteligência contextual e integração contínua.

Da vulnerabilidade pontual ao risco sistêmico

A combinação entre o relatório da Cloud Security Alliance e as análises dde especialistas aponta para uma conclusão inequívoca: a cibersegurança está entrando em uma nova fase, caracterizada por ataques em escala de máquina e pela erosão dos modelos tradicionais de defesa. Mais do que uma evolução tecnológica, trata-se de uma mudança onde vulnerabilidades deixam de ser eventos isolados e passam a ocorrer em massa, o tempo

de resposta humano se prova insuficiente e a segurança precisa ser redesenhada como sistema dinâmico e automatizado. Para ambientes industriais, essa transformação é ainda mais crítica, pois conecta diretamente o domínio digital ao físico. Dessa forma, a “tempestade de vulnerabilidades” não é apenas um aumento de risco — é a redefinição da própria lógica de segurança no mundo digital e industrial.

EUA está estabelecendo um novo regime de exportação de IA

A movimentação recente do governo dos EUA para estruturar um novo regime de exportação de inteligência artificial sinaliza uma mudança estratégica relevante: a tecnologia deixa de ser apenas um ativo econômico e passa a ser instrumento explícito de política industrial, geopolítica e cibersegurança.

O Departamento de Comércio dos EUA está organizando um modelo que prevê a criação de um “portfólio prioritário” de soluções de IA a serem promovidas globalmente junto a aliados e parceiros estratégicos.

Na prática, a iniciativa busca estruturar pacotes completos (full-stack) que incluem desde hardware (chips e infraestrutura de

data centers) até modelos de IA, serviços em nuvem e camadas de cibersegurança. Esses pacotes, uma vez selecionados, passam a receber apoio institucional do governo, incluindo facilitação regulatória, coordenação interagências e até mecanismos de financiamento para viabilizar sua adoção internacional.

Essa abordagem representa uma inflexão importante em relação ao modelo tradicional de exportação tecnológica. Em vez de comercializar componentes isolados, os EUA passam a ofertar ecossistemas completos de IA, com o objetivo de influenciar não apenas o mercado, mas também os padrões tecno -

lógicos e regulatórios adotados globalmente. A diretriz está alinhada a uma política mais ampla que busca garantir que tecnologias, normas e modelos de governança americanos sejam amplamente adotados no cenário internacional, reforçando a liderança tecnológica do país.

Do ponto de vista estratégico, o programa também responde à crescente competição global, especialmente com a China, ao tentar consolidar uma “esfera de influência tecnológica” baseada em alianças. Ao exportar soluções completas e integradas, o governo americano procura reduzir a dependência de seus parceiros em relação a tecnologias concorrentes, ao mesmo tempo em que fortalece cadeias de valor alinhadas aos seus interesses econômicos e de segurança.

Outro aspecto relevante é o papel atribuído ao próprio Estado como articulador de mercado. O Departamento de Comércio dos EUA passa então a atuar não apenas como regulador, mas como facilitador ativo de negócios internacionais, conectando empresas, coordenando ofertas e promovendo soluções como parte de uma estratégia nacional de competitividade.

No entanto, há incertezas quanto à de -

manda real por soluções completas em mercados internacionais, bem como riscos de desalinhamento entre as necessidades locais e os pacotes ofertados. Além disso, a tentativa de equilibrar competitividade, segurança e abertura de mercado pode gerar tensões, especialmente em países que buscam maior soberania tecnológica.

Sob a ótica da cibersegurança, o movimento é igualmente significativo. Ao incorporar explicitamente componentes de segurança nos pacotes exportados, os Estados Unidos buscam não apenas proteger suas tecnologias, mas também estabelecer padrões globais de segurança digital - um fator crítico em um cenário marcado por ataques cada vez mais sofisticados e pela crescente integração entre infraestrutura digital e sistemas industriais.

Em síntese, o novo regime de exportação de IA revela uma mudança estrutural: a disputa tecnológica global deixa de ser apenas sobre inovação e passa a ser sobre quem define as regras, os padrões e a arquitetura do futuro digital. E torna ainda mais claro que no novo cenário geopolítico da inteligência artificial, exportar tecnologia é, na prática, exportar poder.

Conectores menores, mais inteligentes e mais ecológicos

Depois das raças de cachorro e shampoo, a tendência de miniaturizar chegou ao mundo dos componentes eletrônicos. As crescentes exigências por componentes miniaturizados leves nos setores automotivo, médico e de eletrônica de consumo ditaram a tendência em todo o setor, com empresas que aproveitaram a oportunidade de desenvolver seus projetos de componentes para melhorar o desempenho e a sustentabilidade. Aqui, Mark Baptista, engenheiro de vendas de contas estratégicas globais na PEI-Genesis, que é especializada em conectores elétricos, analisa o aumento de procura por componentes eletrônicos miniaturizados leves e como a empresa está remodelando os designs.

Não há dúvidas de que o tamanho dos nossos dispositivos eletrônicos está diminuindo. Os nossos smartphones, que já tiveram o tamanho de um tijolo, agora são dispositivos de bolso compactos que não têm mais de 170mm. Os componentes agora precisam

caber em espaços mínimos, mas sem deixar de ter alto desempenho, durabilidade e confiabilidade.

Para atingir o equilíbrio, os fabricantes precisam adotar engenharia avançada, materiais e técnicas de design inovadores. Eles também precisam considerar os requisitos específicos de cada setor no que se refere à miniaturização, por exemplo, polímeros de alta resistência que resistem à esterilização em aplicações médicas. Isso é crucial porque esses polímeros precisam resistir à exposição repetida a temperaturas que chegam a 250 °C e processos de limpeza química.

No setor automotivo, o aumento repentino de eletrificação de veículos e sistemas de veículos autônomos exigem mais conectores leves e de alta potência. A integração de várias fontes de energia em um conector permite criar um sistema de alta corrente que reduz o peso sem comprometer a alta potência, muitas vezes com tolerância a 1000 V.

A importância dos materiais

A inovação começa com os materiais. Em conectores em miniatura, os materiais que os compõem precisam atender a especificações voltadas para o desempenho, peso, durabilidade e confiabilidade. Por causa disso, os materiais tradicionais usados em conectores foram substituídos ou modificados.

Os materiais compósitos e polímeros tornaram-se uma escolha comum nos invólucros dos conectores e no isolamento. Os compósitos, por exemplo, têm as melhores propriedades de metais e polímeros, são extremamente leves e apresentam grande

O segredo da sustentabilidade

Os conectores em miniatura causaram uma reformulação completa no design dos componentes e essa inovação criou oportunidades para tornar o setor mais sustentável. Essa é uma mudança causada também por regulamentos ambientais estritos, iniciativas de sustentabilidade corporativa e a procura por parte do cliente por artigos eletrônicos mais ecológicos.

Os fabricantes estão gradualmente passando a utilizar materiais em conformidade com a diretriz RoHS (Restrição de Certas Substâncias Perigosas), que proíbe o uso de chumbo (Pb), mercúrio (Hg) e cádmio (Cd) na produção de componentes. Esses materiais estão sendo substituídos por prata (Ag), níquel (Ni) no chapeamento ou estanho-prata-cobre (Sn-Ag-Cu) na soldagem, reduzindo a toxicidade e tornando os componentes mais seguros para produzir e mais compatíveis com o meio-ambiente.

As técnicas de fabricação também mudaram em nome da sustentabilidade. Os conectores miniaturizados exigem engenharia de precisão em vez dos processos tradicionais de usinagem e moldagem, que podem causar um desperdício exagerado de materiais. Os métodos de impressão em 3D e moldagem por injeção de precisão usados na produção de conectores miniaturizados reduzem os

força mecânica. Eles também aumentam a resistência do componente a interferência eletromagnética (EMI), o que resulta em desempenho otimizado de modo constante. Outra inovação são os revestimentos nanométricos. Com espessura menor que dois micrômetros (µM), eles adicionam uma camada protetora microscópica a um conector em miniatura e aumentam a resistência à corrosão, condutividade e durabilidade mecânica. Essas qualidades possibilitam conectores menores, mas ainda assim eficientes, com vida útil mais longa, o que faz deles soluções mais econômicas.

resíduos de metais e plásticos e vêm sendo implementados em todo o setor para tornar a produção mais sustentável.

Os fabricantes de conectores estão buscando investir em energia renovável, e entre eles está a líder de mercado Amphenol. De acordo com o relatório de sustentabilidade de 2024 da empresa, ela já atingiu uma redução de 34% na emissão de GEE no escopo 1 e 2 (baseado em mercado) com receita normalizada em 2024 em comparação a 2021. À medida que as principais marcas passam a produzir com maior eficiência energética, os conectores mais procurados como os da série de microminiatura 2M da Amphenol, fornecida pela PEI-Genesis, alinham-se mais de perto à passagem do setor para soluções de conectores sustentáveis.

As tendências do setor constantemente abrem o espaço para inovação, e a miniatura não é nenhuma exceção. Os microconectores têm um impacto poderoso nas aplicações industriais graças aos desenvolvimentos únicos no design de conectores e simultaneamente propõem uma rota para práticas de produção mais ecológicas. No futuro, a colaboração entre a engenharia, ciência de materiais e fabricação serão essenciais para manter o progresso e inovar ainda mais tanto na miniaturização quanto na sustentabilidade.

Termografia ativa permite realizar ensaios não destrutivos de materiais

Imagine a asa de um avião ou o casco de um iate. Por fora, a superfície é impecável, polida e robusta, mas, em camadas que o olho humano não alcança, podem existir

microfissuras, bolhas de ar ou infiltrações de umidade. Essa diferença invisível pode separar uma viagem tranquila de um acidente catastrófico.

Até pouco tempo atrás, garantir essa segurança exigia a destruição de peças para a análise de seu interior. A indústria aeronáutica brasileira precisava de uma solução mais eficiente. A resposta veio da startup Subiter, nascida no Instituto Tecnológico de Aeronáutica (ITA), em São José dos Campos. Liderada pelo engenheiro mecânico Eduardo Novais , a empresa desenvolveu, com apoio do Programa Pesquisa Inovativa em Pequenas Empresas (PIPE), da FAPESP, uma solução com termografia ativa, um método de inspeção não destrutiva que usa calor e câmeras infravermelhas para enxergar o interior de materiais.

O nome da empresa reflete essa essência: “subter”, em latim, significa “o que está por baixo”. “Nosso slogan é ‘alcance o invisível’”, afirma Novais. “Somos a única empresa do hemisfério Sul a usar a tecnologia dessa forma para tornar visível aquilo que antes exigia cortes, radiação ou longas horas de inspeção”, diz.

Ensaios não destrutivos permitem avaliar a integridade de materiais sem danificá-los. Essa abordagem é decisiva em setores em que falhas internas podem ter consequências

graves: na indústria aeronáutica, por exemplo, uma descontinuidade estrutural pode evoluir para um problema crítico durante o voo. O mesmo vale para cascos de embarcações, componentes estruturais de trens ou pás de turbinas eólicas, submetidas a esforços contínuos.

O conceito é pura física: a peça é aquecida de forma controlada e uma câmera infravermelha monitora como o calor retorna à superfície. Quando o material é homogêneo e íntegro, o calor se dissipa de maneira previ-

sível. Se há uma falha interna (como delaminações, vazios ou descontinuidades), o fluxo térmico se altera e o calor revela essa irregularidade. O software da Subiter analisa essas variações e diagnostica a saúde da peça.

A tecnologia é especialmente valiosa para materiais compósitos — aqueles formados

O velho mundo da inspeção

Durante décadas, a inspeção industrial conviveu com limitações importantes. Em linhas de produção de alta cadência, como na indústria automotiva, o procedimento mais comum é o ensaio destrutivo por amostragem: algumas peças do lote são retiradas, cortadas e analisadas. Aplica-se, então, análise estatística para inferir a qualidade do conjunto.

O método tem fragilidades evidentes: além do desperdício com a destruição de peças, não garante que as unidades que seguem para o mercado estejam livres de falhas. “Você destrói peças novas, mas as que vão para os veículos não são avaliadas”, ex- plica Novais. “É uma amostragem falha.”

Surgiram, então, o ultrassom e a radiografia industrial, ensaios não destrutivos clássicos. O ultrassom exige operador altamente qualificado para tocar manualmente a peça com sensor e gel de acoplamento. É uma alternativa confiável, mas lenta, cara e que

Salto tecnológico

A termografia ativa surge como alternativa complementar e, em muitos cenários, mais eficiente. Entre as vantagens está o fato de todo o processo ocorrer sem contato físico com a peça, o que garante que não haja comprometimento da integridade do material nem da saúde do operador. Além disso, é possível inspecionar áreas da ordem de metros quadrados em poucos minutos e obter registros digitais completos.

Com isso, apesar de o preço do equipamento ser equiparável ao de sistemas de ultrassom, a produtividade é superior — um fator decisivo na prática industrial. A análise

pela combinação de dois ou mais materiais e que resultam em estruturas leves e resistentes —, como fibra de carbono e fibra de vidro. Eles dominam fuselagens de aeronaves, cascos de iates e lanchas, pás eólicas e outros componentes estruturais de alto desempenho.

requer preparação superficial meticulosa. Além disso, há o fator humano: profissionais qualificados chegam a ganhar R$ 20 mil por mês, enquanto inspetores de termografia ativa podem ser contratados por valores mais acessíveis.

Já a radiografia industrial utiliza radiação ionizante para atravessar o material e formar a imagem interna. Apesar da precisão, os equipamentos são caros, há riscos à saúde dos operadores, o volume de trabalho é limitado e peças de grandes dimensões representam um desafio logístico.

O mercado global de ensaios não destrutivos cresce de forma consistente, impulsionado pela busca por segurança, eficiência e redução de desperdícios. Com o avanço de materiais compósitos e estruturas cada vez maiores e mais complexas, métodos rápidos, seguros e digitais como a termografia ativa tendem a ganhar protagonismo.

de estruturas extensas (como um casco de embarcação ou uma pá eólica) com ultrassom pode levar de 12 a 20 vezes mais tempo do que com a termografia ativa. Isso altera profundamente o custo final do processo. Enquanto a certificação de especialistas em ultrassom requer centenas de horas, a termografia ativa tem interfaces amigáveis e exige menor grau de especialização técnica. Isso não elimina a necessidade de profissionais qualificados, mas torna o processo mais acessível e escalável. A economia aparece no tempo de inspeção, na redução de necessidade de mão de obra altamente espe -

cializada e na possibilidade de inspecionar 100% das peças — não apenas amostras.

No mercado náutico, por exemplo, a inspeção rápida e sem contato de grandes superfícies é especialmente valiosa. Estaleiros podem avaliar cascos ainda no processo produtivo ou em manutenção, sem desmontagens extensas. O mesmo vale para o setor de energia eólica, que lida com componentes de grandes dimensões e alto valor agregado.

A termografia ativa foi incluída nas normas técnicas internacionais apenas em 2007, segundo organismos de padronização como a Sociedade Americana para Testes e Materiais

Do ITA para o mercado

A história da Subiter começou como pesquisa acadêmica no ITA. Novais estudava ensaios não destrutivos quando percebeu a lacuna no fornecimento de serviços tecnológicos para a indústria aeronáutica — em especial para fabricantes como a Embraer, que entregou 206 aeronaves em 2024, um crescimento de 14% em relação a 2023, e acumula carteira de pedidos de US$ 26,3 bilhões.

Além do apoio do PIPE-FAPESP, a startup contou com mentoria do Parque de Inovação Tecnológica (PIT) de São José dos Campos. Esse ecossistema garantiu que a tecnologia deixasse de ser apenas um bom experimento de laboratório e resolvesse problemas re -

Mercados e barreiras

A indústria aeronáutica seria o mercado natural, mas há barreiras regulatórias. “Como a tecnologia é um método emergente, ainda não está incluída em normas brasileiras”, explica Novais. “Atuamos em parceria com associações técnicas do setor e órgãos reguladores para provocar a discussão da inclusão da termografia ativa nas normas técnicas brasileiras. Fazemos um esforço de educação do mercado para mostrar que a tecnologia não substitui outros métodos, mas amplia o arsenal de inspeção disponível.”

(American Society for Testing and Materials – ASTM) e a Organização Internacional de Normalização (International Organization for Standardization – ISO). Em comparação, ultrassom e radiografia industrial acumulam quase um século de uso.

A Subiter tem um aparelho portátil (para inspecionar, por exemplo, pás eólicas já montadas ou embarcações posicionadas em estaleiros e marinas) e um fixo, instalado na linha de produção. Ambas as opções são sincronizadas com o software que registra, processa e armazena os dados. No mercado global, poucas empresas atuam no segmento — a maioria está na Europa e nos EUA.

ais da indústria. “A FAPESP foi fundamental: além do financiamento, o treinamento em empreendedorismo fez muita diferença. Eles ensinam a olhar para a necessidade do mercado, não para a paixão pelo produto”, destaca Novais.

Envolvido com a engenharia mecânica desde o ingresso na graduação, aos 17 anos, Novais já havia concluído o mestrado e cursava o doutorado quando decidiu deixar o universo acadêmico para se dedicar à startup. “Levar meu conhecimento para o mercado era o desafio em que eu queria me concentrar. Quando entendi isso, decidi que deveria me concentrar em me tornar empreendedor, não somente cientista/pesquisador.”

No futuro, o objetivo é crescer em setores com certificação mais rigorosa, como a aeronáutica civil comercial. Atualmente, a startup avança em mercados com menor rigidez normativa. Por isso, serve principalmente o setor náutico, que movimenta R$ 2,5 bilhões anuais no Brasil e emprega cerca de 150 mil pessoas, segundo a Associação Brasileira de Construtores de Barcos (Acobar). O mercado cresceu 25% em empregos entre 2023 e 2024.

Outros segmentos atendidos incluem o

metroferroviário, o eólico e aplicações industriais diversas. O setor naval brasileiro, impulsionado por R$ 31 bilhões em inves -

timentos autorizados em 2024 pelo Fundo da Marinha Mercante, também representa oportunidade.

Hemisfério Sul e além

A internacionalização da empresa está nos planos da equipe. Para isso, a estratégia da startup é se dedicar a nichos que ainda estão descobertos. Futuramente, o uso de inteligência artificial para o diagnóstico automático das imagens térmicas pode reduzir a dependência de interpretação humana e elevar o nível de precisão em inspeções em série.

A transição de Novais, de pesquisador para empreendedor, foi desafiadora. “Na academia, você pode se apaixonar pelo produto. No mercado, você precisa resolver problemas reais”, diz. Isso ilustra um fenômeno comum: conhecimento acadêmico de ponta que fica nos laboratórios. “O conhecimento científico é essencial, mas sozinho não leva a lugar nenhum. Se você não conhece seu cliente, seus concorrentes, sua estrutura de

custos, o fracasso é quase certo.”

A Subiter transforma conhecimento acadêmico em solução de mercado para indústrias bilionárias. Enquanto a Embraer exportou mais de US$ 2 bilhões em aeronaves apenas em 2024, o setor naval cresceu 20% em empregos nos últimos quatro anos. E o mercado náutico tem potencial para crescer até 20 vezes, segundo a Acobar, se houver infraestrutura adequada.

Em todos esses segmentos, a capacidade de inspecionar materiais de forma rápida, segura e não destrutiva não é luxo: é um requisito básico de competitividade industrial. Quando um avião decola, quando um iate navega, quando uma pá eólica gira, a integridade estrutural precisa ser garantida. E, para isso, é preciso enxergar o invisível. (Fapesp)

Integração,

dados e regulação:

os desafios estruturais da inteligência distribuída no sistema elétrico brasileiro

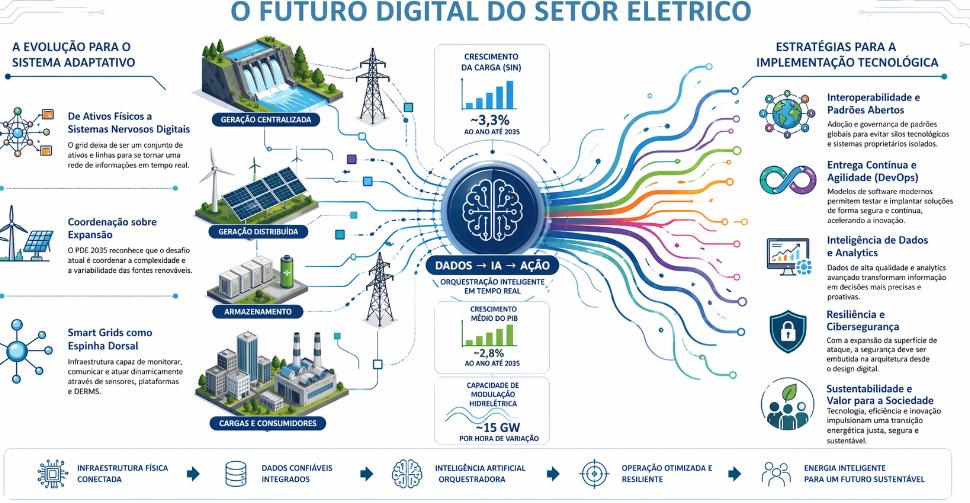

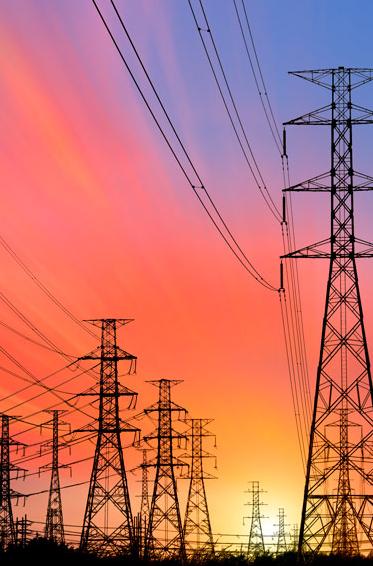

O sistema elétrico brasileiro é reconhecido por sua sofisticação operacional, sustentado por uma arquitetura centralizada e coordenada sob o ONS – Operadador Nacional do Sistema. No entanto, a transição para redes elétricas inteligentes, ou smart grids, impõe uma mudança estrutural que vai além da incorporação de novas tecnologias; é necessária uma reconfiguração profunda da lógica de operação, na qual a inteligência deixa de estar concentrada no centro do sistema e passa a ser distribuída ao longo da rede, incorporando geração distribuída, armazenamento, resposta da demanda e fluxos bidirecionais de energia e informação.

Essa transformação pode ser compreendida de forma mais precisa a partir de uma abordagem sistêmica: tradicionalmente, o setor elétrico foi estruturado como um conjunto de ativos físicos - usinas, linhas de transmissão e subestações - cuja expansão determinava a segurança energética. No entanto, à medida que a interdependência entre esses elementos cresce e a variabilidade operacional se intensifica, essa arquitetura se torna insuficiente.

Sob uma nova perspectiva, o sistema elétrico passa a ser entendido como um sistema adaptativo, no

qual a estabilidade não decorre apenas da robustez da infraestrutura, mas da capacidade de coordenação entre seus elementos – e a informação, nesse cenário, assume papel equivalente ao da própria energia.

Essa mudança de paradigma é reforçada pela crescente aplicação de inteligência artificial ao longo da cadeia elétrica. Mais do que uma camada adicional de tecnologia, a IA aqui também emerge como elemento estruturante da operação, viabilizando a transição para redes capazes de monitorar, interpretar e agir em tempo real.

Essa nova arquitetura pode ser compreendida a partir de três camadas integradas: a Internet das Coisas (IoT), responsável por transformar a rede em um sistema sensorial distribuído, por meio de medidores inteligentes, sensores de corrente e tensão e monitoramento contínuo de ativos; a camada de dados, que assegura a integração, qualidade e governança das informações provenientes de sistemas de tecnologia da informação (TI) e tecnologia operacional (TO); e a inteligência artificial, que processa esse volume massivo de dados e viabiliza decisões automatizadas, desde manutenção preditiva até previsão de geração renovável e otimização da operação.

IA como camada de orquestração da smart grid

A incorporação da inteligência artificial às redes elétricas inteligentes/smart grids representa a introdução de uma nova camada funcional na arquitetura do sistema: a orquestração, em tempo real, de ativos, dados e decisões. Diferentemente das camadas tradicionais — responsáveis pela aquisição de dados (como sensores, IoT e medidores inteligentes) e pela supervisão e controle (SCADA, EMS e ADMS) — a IA atua de forma transversal, conectando essas estruturas e transformando dados dispersos em decisões operacionais coordenadas.

Essa função se torna essencial em um contexto de crescente complexidade sistêmica.

A expansão da geração distribuída, a variabilidade das fontes renováveis e a necessidade de respostas operacionais cada vez mais rápidas criam um ambiente em que os modelos tradicionais, baseados em regras fixas e operação centralizada se tornaram insuficientes. Nesse cenário, a IA passa a desempenhar o papel de “cérebro operacional”, capaz de integrar informações provenientes de diferentes camadas do sistema e convertê-las em ações em tempo quase instantâneo. Na prática, essa capacidade se manifesta em quatro frentes principais: a previsão, na qual modelos de aprendizado de máquina

permitem antecipar padrões de carga e geração renovável com maior precisão, reduzindo incertezas e melhorando o planejamento do despacho; a otimização, em que algoritmos avançados ajustam continuamente o fluxo de potência e a alocação de recursos, considerando restrições dinâmicas da rede; o diagnóstico, com identificação precoce de falhas, perdas e anomalias operacionais, permitindo a transição de uma manutenção reativa para uma abordagem preditiva; e o controle, que viabiliza respostas automatizadas de recomposição de rede e coordenação de recursos distribuídos em escalas de tempo incompatíveis com a intervenção humana.

A integração dessas funções permite transformar a smart grid em um sistema capaz de converter complexidade em estabilidade. Ao articular dados em tempo real, modelos preditivos e mecanismos de decisão automatizada, a IA viabiliza a coordenação simultânea de milhares de ativos distribuídos, incluindo geração fotovoltaica, armazenamento em baterias e cargas flexíveis. Esse processo é frequentemente potencializado pelo uso de gêmeos digitais, que permitem simular continuamente o comportamento do sistema e testar cenários operacionais antes de sua implementação.

Experiências internacionais indicam que essa abordagem já está em estágio avançado na Europa, EUA e China, onde a IA é aplicada à previsão probabilística, à operação de redes de distribuição e à coordenação de mercados de flexibilidade. No Brasil, embora existam iniciativas relevantes em centros de pesquisa e concessionárias, o principal desafio ainda reside na integração dessas soluções em escala sistêmica, especialmente no que se refere à interoperabilidade de dados e à governança da informação.

Do ponto de vista técnico, a adoção da IA como camada de orquestração enfrenta desafios importantes como a qualidade e a consistência dos dados provenientes de sistemas heterogêneos de tecnologia da informação e operação; a necessidade de padronização semântica; os requisitos de baixa latência para tomada de decisão em tempo real; e a ampliação da superfície de ataque em termos de cibersegurança.

Mas, apesar das limitações, a trajetória

Camada Função

IoT/AMI

SCADA

EMS/ADMS

DERMS

IA (transversal)

Aquisição de dados

Supervisão

Controle e despacho

Coordenação de DER

Decisão e coordenação

tecnológica é clara. O setor evolui de um modelo baseado em automação e controle centralizado para uma arquitetura progressivamente autônoma, na qual a operação passa a ser orientada por dados, algoritmos e capacidade adaptativa. Nesse novo paradigma, a estabilidade do sistema elétrico não depende apenas da robustez da infraestrutura física, mas da capacidade de interpretar informações, antecipar eventos e coordenar respostas de forma distribuída.

Limitação tradiciona Papel da IA

Volume e heterogeneidade

Baseado em regras

Complexidade combinatória

Pré-processamento, detecção de padrões

Enriquecimento analítico

Otimização dinâmica

Orquestração em tempo real

Integra todas as camadas -