Wissen, das kleben bleibt – jetzt den NEWSLETTER kostenfrei sichern. www.digital-manufacturing-magazin.de/newsletter

Wissen, das kleben bleibt – jetzt den NEWSLETTER kostenfrei sichern. www.digital-manufacturing-magazin.de/newsletter

Liebe Leserinnen und Leser,

künstliche Intelligenz (KI) entwickelt sich zunehmend zu einer Schlüsseltechnologie – nicht nur für innovative Produkte, sondern vor allem für effizientere Produktionsprozesse. Unternehmen, die KI gezielt in der Fertigung einsetzen, schaffen damit eine wichtige Grundlage für langfristige Wettbewerbsfähigkeit und höhere Produktivität.

Industrielle KI ermöglicht es, Abläufe in Produktion und Montage datenbasiert zu analysieren, zu steuern und kontinuierlich zu verbessern. Gerade im Maschinenbau, der von hoher Variantenvielfalt, kleinen Losgrößen und anspruchsvollen Qualitätsanforderungen geprägt ist, eröffnen sich dadurch neue Chancen. Anwendungen reichen von intelligenter Produktionsplanung über Predictive Maintenance bis hin zu automatisierter Qualitätssicherung.

Auch in der Intralogistik zeigt sich das Potenzial von KI immer deutlicher. Lernfähige Systeme können Materialflüsse transparenter machen, mögliche Engpässe frühzeitig erkennen und Abläufe gezielt optimieren. Das trägt dazu bei, Liefertermine zuverlässiger einzuhalten – ein wichtiger Faktor in einem stark umkämpften Marktumfeld.

Voraussetzung für den erfolgreichen Einsatz von KI ist jedoch eine leistungsfähige digitale Infrastruktur. Denn datengetriebene Anwendungen benötigen große Mengen hochwertiger Daten, die schnell verfügbar sein müssen. Leistungsfähige Rechenzentren und Edge-Computing-Lösungen bilden deshalb die Grundlage, um KI-Anwendungen in Echtzeit betreiben zu können.

In dieser Sonderausgabe zeigen wir Ihnen, was Unternehmen über KI in der Fertigungsindustrie wissen müssen.

Lesen Sie beispielsweise in unserer Titelstory auf den Seiten 6 und 7, warum man erst Ordnung in den Daten schaffen muss, bevor man künstliche Intelligenz (KI) erfolgreich nutzen kann.

Und welche KI-Use Cases bereits heute funktionieren, wo die größten Hürden beim Einsatz von KI liegen und wie Unternehmen KI erfolgreich in ihre Prozesse integrieren können, erläutern Ihnen elf Expertinnen und Experten aus Industrie und Forschung, die wir in unserer großen KI-Expertenumfrage interviewt haben. Die Antworten finden Sie auf den Seiten 18 bis 23.

Viel Spaß beim Lesen!

Ihr

Rainer Trummer Chefredakteur

18

VOM HYPE ZUR ECHTEN WERTSCHÖPFUNG

Wo schafft künstliche Intelligenz in der Industrie heute wirklich Mehrwert – und warum scheitern viele Projekte noch an Daten, Organisation und Skalierung? Elf Expertinnen und Experten aus Industrie und Forschung zeigen, welche Use Cases funktionieren, wo die größten Hürden liegen und wie Unternehmen KI erfolgreich in ihre Prozesse integrieren.

Bild: © Gorodenkoff/stock.adobe.com

News

Neues aus der KI-Welt 5

Titelstory: Erfolgsfaktor strukturierte Daten So wird Ihre Produktion KI-ready 6

KI-Souveränität als Fundament einer resilienten Industrie

KI-Systeme selbstbestimmt einsetzen 8

KI-Readiness beginnt in der Anlagen-IT Infrastruktur entscheidet 10

Computing-Plattform für vertrauenswürdige KI

Warum industrielle

KI-Anwendungen oft enttäuschen 12

Interview mit Patrick Nebout, Yanfeng

So prägt KI die automobile Zukunft 14

Expertenumfrage: KI in der Fertigungsindustrie Vom Hype zur echten Wertschöpfung 18

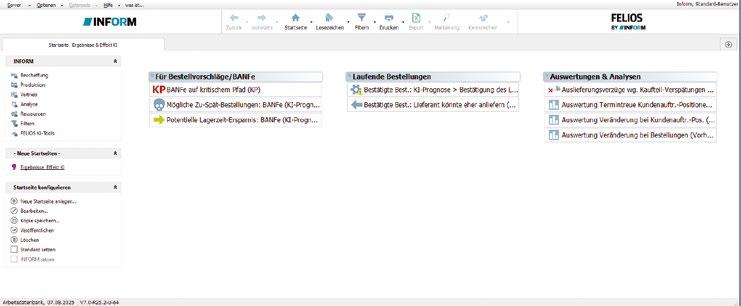

KI in der Produktionsplanung Weniger Überraschungen, weniger Umplanungen 24

ERP trifft künstliche Intelligenz Warum der KI-Erfolg im Datenkeller entschieden wird 26

KI im Mittelstand Warum strukturiertes Wissen entscheidend ist 28

Datensicherheit und digitale Souveränität m KI-Kontext

Mehr Kontrolle über Daten, weniger Risiko 30

Agentenbasierte KI in der Industrie Produktdaten sind die Basis 32

KI revolutioniert die Fertigungshallen nicht, um bewährte ERP-Systeme zu ersetzen, sondern um sie gezielt zu erweitern. Sie ermöglicht schnellere Entscheidungen, proaktive Warnmeldungen und automatisierte Routineaufgaben. Erfahren Sie, warum saubere ERP-Prozesse entscheidend sind und wo sich KI-Agenten im Shopfloor konkret einsetzen lassen.

Bild: © yoh4nn via Getty Images

KI macht Computer Vision zum strategischen Werkzeug der Fertigung

KI als Schlüsseltechnologie 34

IT-Infrastruktur für KI auf dem Shopfloor

KI in der Fertigung – IT am Limit? 36

Präzision durch Vernetzung

Sensoren: Das Nervensystem der Fabrik 38

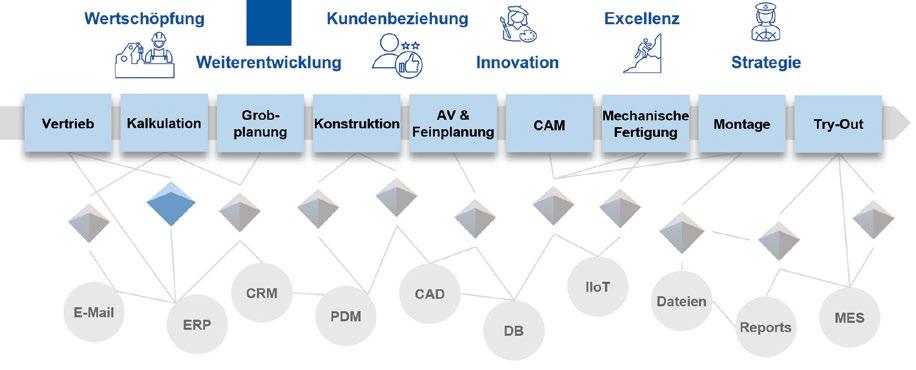

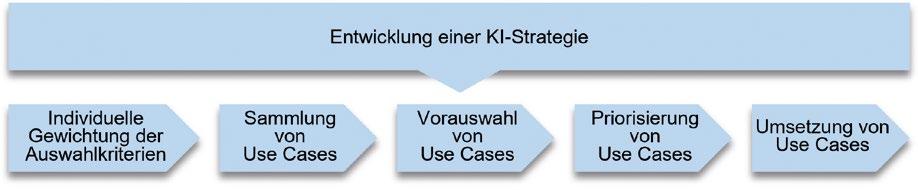

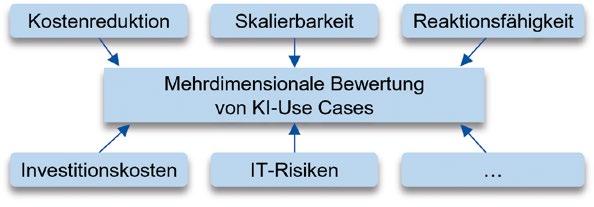

Durchlaufzeiten im Werkzeugbau verkürzen Systematische KI-Integration in der Auftragsabwicklung 40

KI und Chaos Engineering in der vernetzten Produktion Die Zukunft der Fertigung sichern 42

KI-gestützte Lösungen für QMS und IMS Effizienz und Normkonformität durch KI-Unterstützung 44

KI-Fabrik: Telekom baut Deutschland-Stack aus Souveräne KI-Plattform aus einer Hand 46 Editorial 3 Impressum 45

TITELSTORY: SO WIRD IHRE

PRODUKTION KI-READY

Künstliche Intelligenz verspricht die Revolution in der Fertigung – so die Theorie. In der Praxis herrscht Ernüchterung. Schuld daran ist meistens eine unzureichende Datenbasis. Warum Sie erst Ordnung in Ihren Daten schaffen müssen, bevor Sie künstliche Intelligenz (KI) erfolgreich nutzen können. Ein Fahrplan für die Produktion von morgen. SEITE 6

REDAKTIONELL ERWÄHNTE INSTITUTIONEN, ANBIETER UND VERANSTALTER

Appian S. 18, Aptean S. 19, 26, Cadfem S. 19, Consense S. 44, DC Smarter S. 36, Dell S. 34, Deutsche Telekom S. 46, Dynatrace S. 42, Elunic S. 19, Empolis S. 28, Fabasoft Approve S. 20, 30, IFS S. 20, Inform S. 24, it’s OWL S. 21, Kyndryl S. 10, Megla S. 22, MHP S. 22, MPDV S. 6, 23, NTT Data S. 38, Palo Alto Networks S. 5, Proalpha S. 28, PTC S. 32, ServiceNow S. 46, Siemens S. 5, 23, Signaloid S. 12, VDMA S. 8, WBA Aachener Werkzeugbau Akademie S. 40, Yangfeng S. 14

TITELANZEIGE: MPDV

SO WIRD IHRE

PRODUKTION KI-READY

MPDV, Spezialist für Fertigungs-IT, bildet mit seinem Portfolio die gesamte Wertschöpfungskette der Produktion ab. Sie reicht von Beratung, Planung, Implementierung bis hin zu Support, mit dem Ziel, die Wettbewerbsfähigkeit zu steigern und Kunden auf dem Weg zur Smart Factory zu begleiten. Durch die nahtlose Datenerfassung mit MES HYDRA X bekommen Betriebsleiter einen tiefen Einblick in den Zustand der Fertigung. Dadurch können sie auf ungeplante Ereignisse reagieren und datengestützte Entscheidungen treffen. Die Basis der hochskalierbaren Lösungen von MPDV bildet die Manufacturing Integration Platform (MIP). Damit lassen sich produktionsrelevante Anwendungen anbinden, auch von Drittanbietern und Legacy-Systemen. Die AI Suite ermöglicht den Einsatz von künstlicher Intelligenz ohne Trainings-Aufwand.

MPDV Mikrolab GmbH

Römerring 1

74821 Mosbach, Deutschland

Telefon: +49 62 61 92 09-10 1

E-Mail: info@mpdv.com www.mpdv.com

SIEMENS UND PALO ALTO NETWORKS

Siemens hat heute eine verifizierte Cybersecurity-Lösung für industrielle private 5G-Netzwerke in Zusammenarbeit mit Palo Alto Networks angekündigt. Die Lösung kombiniert Siemens‘ private 5G-Infrastruktur mit der NextGeneration Firewall (NGFW) von Palo Alto Networks, die speziell für künstliche Intelligenz (KI) optimiert wurde. Siemens hat die Lösung umfassend getestet, um hohe Verfügbarkeit, Netzwerkresilienz und unterbrechungsfreien Betrieb sicherzustellen. Sie ermöglicht es Herstellern, unterschiedliche

Aptean (Halle 15, Stand D29) integriert ERP, Produktion und KI in AppCentral

Produktionsunternehmen müssen heute gleichzeitig Variantenvielfalt, schwankende Lieferketten und steigende Transparenz meistern. Klassische ERP-Systeme bilden zwar das Rückgrat der Unternehmenssteuerung, stoßen aber schnell an ihre Grenzen, sobald Prozesse über Abteilungen, Werke und Systeme hinweg koordiniert werden müssen.

Genau hier setzt AppCentral an. Mit AppCentral bringt Aptean ERP, MES, WMS, CRM, PLM auf einer Oberfläche zusammen. Die cloudbasierte, KI-native Lösung sorgt für durchgängige Datenflüsse statt isolierter Insellösungen und bildet die Grundlage für Smart-Factory-Konzepte sowie eine effiziente Variantenfertigung. Am ApteanMessestand auf der Hannover Messe 2026 (Halle 15, Stand D29) können Besucher live erleben, wie AppCentral Datensilos auflöst und Prozesse über Abteilungsgrenzen hinweg synchronisiert.

Ein wesentliches Merkmal ist die tief integrierte KI-Schicht Aptean Intelligence. Eingebettete KI-Agenten analysieren operative Daten in Echtzeit, automatisieren wiederkehrende Aufgaben und erkennen Abweichungen frühzeitig. In der Produktion lassen sich so beispielsweise Engpässe prognostizieren und Materialflüsse optimieren.

Modularität

AppCentral verfolgt einen modularen Ansatz: Unternehmen können mit einzelnen Anwendungen starten und den Funktionsumfang schrittweise erweitern. Alle Apps sind von Beginn an miteinander vernetzt, sodass Transparenz und Datenkonsistenz jederzeit erhalten bleiben. Die Plattform passt sich flexibel an branchenspezifische Anforderungen an – sei es in der diskreten Fertigung, in der Prozessindustrie oder im Handel – und vereint detaillierte Prozesskontrolle mit unternehmensweiter Flexi-

Siemens und Palo Alto Networks bieten geprüfte Cybersecurity-Lösung für industrielles 5G.

Bild: Siemens

industrielle Sicherheitsanforderungen zu erfüllen und gleichzeitig die kritische Leistung aufrechtzuerhalten, die ihre zunehmend KI-gesteuerten Produktionen erfordern.

Die verifizierte Architektur erfüllt die IEC-62443-Anforderungen für die Sicherheit industrieller Automatisierungs- und Steuerungssysteme und erhält gleichzeitig die Leistungsmerkmale aufrecht, die für zeitkritische Produktionsanwendungen essenziell sind. Die Lösung ist als Teil des SiemensXcelerator-Portfolios verfügbar.

AppCentral vereint ERP, Produktions-, Logistik- und KI-Funktionen in einer Oberfläche und ermöglicht durchgängige Transparenz entlang der gesamten Wertschöpfungskette. Bild: Aptean

bilität. Das ERP wird vom reinen Verwaltungssystem zum zentralen, intelligenten Steuerungsinstrument.

Aptean Germany GmbH

Pforzheimer Straße 128 76275 Ettlingen, Deutschland

TEL.: +49 72 43 20 67-2 00

E-MAIL: germany@aptean.com

www.aptean.com

Um KI erfolgreich zu nutzen, müssen Produktionsunternehmen eine verlässliche Datenbasis schaffen. Wer Daten-Schrott liefert, bekommt KI-Schrott zurück. Bild: © Margarita/stock.adobe.com (generiert mit KI)

Künstliche Intelligenz verspricht die Revolution in der Fertigung – so die Theorie. In der Praxis herrscht Ernüchterung. Schuld daran ist meistens eine unzureichende Datenbasis. Warum Sie erst Ordnung in Ihren Daten schaffen müssen, bevor Sie künstliche Intelligenz (KI) erfolgreich nutzen können. Ein Fahrplan für die Produktion von morgen. VON CHRISTIANE MANOW-LE RUYET

In den Chefetagen und an den Werkbänken der Produktionsbetriebe ist das Kürzel „KI“ omnipräsent. Die Erwartungen stiegen ins Unermessliche, sodass schon mancher Produktionsleiter von künstlicher Intelligenz als Lösung für alle Herausforderungen in der Produktion träumte. Inzwischen weicht die anfängliche Euphorie nüchternem Realismus. Die Zahlen aus der Bitkom-Studie „Künstliche Intelligenz in Deutschland“ von 2025 (Datenbasis: 602 Unternehmen) zeigen: 88 Prozent der befragten Unternehmen in Deutschland nutzen KI, 21 Prozent für Produktionsabläufe.

Der Grund: Etwa 53 Prozent plagen technische Probleme, und neben mangelnden menschlichen Ressourcen fehlt für KI-Anwendungen auch die Akzeptanz unter den Mitarbeitenden. Fraunhofer skizziert 2024 in der Studie „Künstliche Intelligenz in der Produktion“ ein enttäuschendes Bild: Demnach verwenden produzierende Be -

triebe KI-Lösungen meistens nur in einzelnen Bereichen, wie etwa der Steuerung von Produktionsprozessen. Viele künstlichintelligenten Projekte scheitern an einer einfachen Erkenntnis: KI ist nur so klug wie die Daten, auf die sie zugreift. Wer DatenSchrott liefert, bekommt KI-Schrott zurück.

NEBEN MANGELNDEN MENSCHLICHEN RESSOURCEN FEHLT FÜR KI-ANWENDUNGEN OFT AUCH DIE AKZEPTANZ UNTER DEN MITARBEITENDEN.

Damit ein schlauer Algorithmus auf dem Shopfloor wirklich einen Mehrwert bietet, müssen Produktionsunternehmen eine auswertbare, valide Datenbasis schaffen. Dabei geht es um drei Säulen, die das

Fundament jeder smarten Fabrik bilden. Sie lauten:

Transparenz: Zunächst muss eruiert werden, welche Daten überhaupt existieren. Wo verstecken sich zum Beispiel die Sensordaten der Fräsmaschine? Welche Maschinenparameter liegen brach? Struktur: Rohdaten ohne Kontext sind ebenso wertlos wie keine Daten. Eine Temperaturangabe etwa ohne Zeitstempel oder Maschinenbezug ist für eine KI unlesbar. Erst durch eine einheitliche Struktur und Semantik wird aus einem Datenstrom eine Information. Auswertbarkeit: Daten müssen in Echtzeit und in einer Qualität vorliegen, die eine Analyse überhaupt erst ermöglicht. Silo-Lösungen sind deshalb meistens kontraproduktiv.

Digitales Rückgrat

Wie schafft man diese Basis technisch? Hier kommt das Manufacturing-Execution-

System (MES) ins Spiel. Es fungiert als das Nervensystem der Produktion. Das MES liefert die vertikale Integration vom Shopfloor bis zum ERP-System.

Damit ist der Grundstein für die Anknüpfungspunkte der KI gelegt. Die Experten von Fraunhofer erklären dazu: „So setzt knapp jeder dritte Betrieb, der eine technische Lösung für echtzeitnahe Produktionsleitsystem verwendet, auch KI in der Produktion ein; im Gegensatz dazu nutzen nur 13 Prozent der Betriebe ohne echtzeitnahes Produktionsleitsystem eine KI“, wie es in der Studie „Künstliche Intelligenz in der Produktion“ heißt.

Die Kombination mit einer Integrationsplattform sorgt dafür, dass unterschiedliche Protokolle und Legacy-Systeme dieselbe Sprache sprechen. Ohne diese „Dolmetscher“ bleibt die KI isoliert und kann ihre volle Wirkung nicht entfalten. Da KI in der Regel in bestehende Systeme in der Produktion implementiert wird, ist es ein großes Plus, wenn die Integrationsplattform bereits vorhanden ist.

Produktionsunternehmen, die die Möglichkeiten strukturierter Daten erkannt und auf Digitalisierung per MES gesetzt haben, sind bei der KI-Einführung eindeutig im Vorteil: Sie können Maschinendaten, Qualitätsinformationen und Prozesskennzahlen, die im MES zusammenlaufen, von KI analysieren, interpretieren und die Erkenntnisse in Maßnahmen umsetzen lassen wie beispielsweise:

Qualitätsprognosen: Die KI erkennt Datenmuster und kann Qualitätsprobleme entdecken, bevor sie entstehen.

Ausschussanalyse: Anhand der Daten identifiziert sie die Ursachen und Zusammenhänge für Ausschuss. Maschinenleistungsanalyse: KI macht verborgene Potenziale bei der Nutzung und Effizienz von Anlagen sichtbar.

Rüstzeitprognosen: Sie erstellt realistische Vorgabewerte, wodurch sich die Planbarkeit verbessert, was Stillstände reduziert.

OEE-Optimierung: KI analysiert die Gesamtanlageneffektivität datenbasiert, die sich dadurch steigern lässt. Wer im Bereich Feinplanung bereits mit einem APS arbeitet und KI einsetzt, profitiert von einer Qualitätssteigerung für die Planung durch:

adaptive Produktionsplanung: Neben anstehenden Aufträgen berücksichtigt

die KI auch Maschinenzustandsdaten, den Werkzeugeinsatz sowie die Materialflüsse in Echtzeit.

Personaleinsatzplanung: Dank intelligenter Datenauswertung lassen sich auch die Qualifikationen und Verfügbarkeiten der Mitarbeitenden berücksichtigen.

Szenarien-Vergleiche: Ohne den laufenden Betrieb zu unterbrechen, können per KI neue Planungsszenarien simuliert und verglichen werden.

„Die KI kann die Masse an Informationen in der Fertigungsplanung viel besser abbilden als der Mensch. Bei uns im Unternehmen ist das unabdingbar – die KI ist unser wesentliches Element in diesem Zusammenhang“, erklärt Kevin Mahler, COO bei Vacom.

Um den nachhaltigen Erfolg von KISystemen in der Produktion zu sichern, muss man in der Produktion einen strategischen Experten-Mix sicherstellen. Dies gelingt entweder durch den Auf -

DAMIT KI AUF DEM SHOPFLOOR EINEN MEHRWERT BIETET, MÜSSEN PRODUKTIONSUNTERNEHMEN EINE AUSWERTBARE, VALIDE DATENBASIS SCHAFFEN.

bau fester Partnerschaften mit externen Dienstleistern oder gezieltes Recruiting spezialisierter KI-Experten. Parallel dazu ist es entscheidend, ein digitales Grund -

Laut einer Fraunhofer-Studie profitieren Produktionsunternehmen, die eine technische Lösung für ein echtzeitnahes Produktionsleitsystem wie ein MES nutzen, am meisten von KI-Lösungen.

Bild: © jahidmoon026/stock.adobe.com (generiert mit KI)

Künstliche Intelligenz in der Fertigung einzuführen, ist kein reines IT-Projekt, um Ordnung zu schaffen. Vielmehr erfordert KI eine tiefgreifende Transformation in der Arbeitswelt, eine klare Strategie sowie ein Commitment von der Unternehmensführung. Damit Algorithmen messbare Produktivitätssteigerungen liefern, müssen Produktionsleiter den Aufbau von KI-Know-how ins Zentrum ihrer Strategie rücken. KI-Systeme sind nur so effektiv wie die Menschen, die sie bedienen.

verständnis bei den Mitarbeitenden im Shopfloor zu verankern. Nur wenn sie im MES-Umfeld befähigt werden, KI-Vorschläge nicht blind zu übernehmen, sondern diese kritisch auf Basis ihrer Erfahrung zu bewerten, steigt die Akzeptanz für proaktive Maßnahmen. Produktionsunternehmen sollten zudem die Ergebnisse der KI-Maßnahmen messen. Nur so lässt sich feststellen, inwieweit KI-basierte Handlungsempfehlungen tatsächlich in die tägliche Routine einfließen. Oder ob durch gezielte Qualifikationen die Akzeptanzquote für KI sowie die Kompetenz für Problemlösungen nachweislich gestiegen sind. RT

CHRISTIANE MANOW-LE RUYET ist Marketing-Managerin und Presseverantwortliche bei MPDV.

Der deutsche Maschinenbau steht unter Druck. Geopolitische Spannungen, anfällige Lieferketten, steigende regulatorische Anforderungen und ein verschärfter globaler Wettbewerb um digitale Schlüsseltechnologien verändern die Rahmenbedingungen nachhaltig. Für die Unternehmen geht es deshalb längst nicht mehr nur um Effizienzsteigerung, sondern um die Sicherung von Wettbewerbsfähigkeit, Innovationskraft und technologischer Handlungsfähigkeit. Im Zentrum dieser Entwicklung steht KI. VON JESSICA FRITZ

Künstliche Intelligenz (KI) wird zunehmend zur Schlüsseltechnologie industrieller Wertschöpfung und damit auch zu einem strategischen Machtfaktor. Wer KI beherrscht, beeinflusst in wachsendem Maße Produktionsprozesse, Innovationszyklen und industrielle Wertschöpfungsnetzwerke. Gleichzeitig entstehen neue Abhängigkeiten entlang digitaler Wertschöpfungsketten, die bisher in dieser Form nicht bestanden haben.

Aus Sicht des VDMA ist daher klar: KISouveränität ist keine technologische Detailfrage, sondern eine industriepolitische Notwendigkeit.

KI-Souveränität beschreibt die Fähigkeit von Unternehmen, KI-Systeme selbstbestimmt einzusetzen, die Kontrolle über relevante Daten, Modelle und Infrastrukturen zu wahren und technologische Abhängigkeiten bewusst zu steuern, unabhängig davon, ob die Lösungen selbst entwickelt oder extern bezogen werden.

Damit rückt eine zentrale Frage in den Mittelpunkt: Wer behält die Kontrolle über die digitalen Grundlagen industrieller Wertschöpfung?

Schon heute ist erkennbar, dass zentrale KI-Kompetenzen und Infrastrukturen stark außerhalb Europas gebündelt sind. Diese Abhängigkeiten wirken sich nicht nur auf Kostenstrukturen und Innovationsgeschwindigkeit aus. Sie betreffen ebenso die Verfügbarkeit kritischer Technologien und damit die Stabilität und Integrität industrieller Prozesse. Hinzu kommt, dass sich die Wertschöpfung zunehmend in Richtung datenbasierter Geschäftsmodelle verschiebt, wodurch sich bestehende Wettbewerbspositionen grundlegend verändern können.

Nur begrenzter Zugang zu skalierbaren digitalen Infrastrukturen

Für den mittelständisch geprägten Maschinen- und Anlagenbau stellt sich diese

KI-SOUVERÄNITÄT IST KEINE TECHNOLOGISCHE DETAILFRAGE, SONDERN EINE INDUSTRIEPOLITISCHE NOTWENDIGKEIT.

Herausforderung besonders deutlich. Viele Unternehmen verfügen über ausgeprägtes Prozesswissen und tiefes Domänenverständnis, haben aber nur begrenzten Zugang zu skalierbaren digitalen Infrastrukturen. Gleichzeitig wächst der Druck, KI rasch in bestehende Wertschöpfungsprozesse zu integrieren. Ohne geeignete Rahmenbedingungen droht hier eine strukturelle Abhängigkeit von einzelnen Technologieanbietern.

Die Folgen wären erheblich. Wer die Kontrolle über Daten und KI-Systeme verliert, verliert langfristig auch Einfluss auf zentrale Teile der eigenen Wertschöpfung. Strategische Entscheidungen werden dann nicht mehr allein im Unternehmen getroffen, sondern zunehmend durch technologische Vorgaben externer Akteure mitbestimmt.

KI-gestützte Steuerung in der Produktion: Daten und Systeme werden zu zentralen Steuerungsinstrumenten industrieller Prozesse. Bild: © Vadym/stock.adobe.com (generiert mit KI)

Vernetzte und KI-gestützte Produktionssysteme ermöglichen eine flexible und resiliente industrielle Wertschöpfung.

Bild: © kiki/stock.adobe.com (generiert mit KI)

Damit verschiebt sich auch die Machtbalance innerhalb industrieller Ökosysteme.

KI bietet große Potenziale für die Industrie

Gleichzeitig bietet KI erhebliche Potenziale für eine resilientere Industrie. KI-gestützte Optimierung kann Produktionsprozesse stabilisieren und effizienter machen. Vorausschauende Wartung hilft, ungeplante Stillstände zu reduzieren und die Anlagenverfügbarkeit zu erhöhen. Intelligente Steuerungssysteme ermöglichen es Unternehmen, flexibler auf Störungen und auf volatile Nachfragen zu reagieren. Auch in der Qualitätssicherung und im Energiemanagement eröffnet KI zusätzliche Effizienz- und Stabilitätspotenziale.

Diese Potenziale lassen sich jedoch nur dann umfassend nutzen, wenn Unternehmen die eingesetzten Technologien nicht nur anwenden, sondern auch verstehen, kontrollieren und aktiv gestalten können. Vor diesem Hintergrund braucht es klare industriepolitische Weichenstellungen. Erstens braucht Europa leistungsfähige und wettbewerbsfähige digitale Infrastrukturen, insbesondere in den Bereichen Cloud und Edge, die den Anforderungen industrieller Anwendungen gerecht werden und zugleich Verlässlichkeit und Kontrolle gewährleisten.

Zweitens müssen offene Standards und Interoperabilität konsequent gestärkt werden. Nur so können Unternehmen unterschiedliche Systeme miteinander verbinden, technologische Abhängigkeiten verringern und Innovationen flexibel in bestehende Strukturen integrieren. Drittens bleibt der Zugang zu Daten ein zentraler Erfolgsfaktor. Vertrauenswürdige Datenräume und gemeinsame Datenökosysteme ermöglichen es, Skaleneffekte zu erschließen, ohne die Kontrolle über unternehmenskritische Informationen aufzugeben. Gerade im industriellen Kontext entsteht Wertschöpfung häufig erst durch das Zusammenführen verteilter Datenquellen entlang der gesamten Wertschöpfungskette.

UND KI-SYSTEME VERLIERT, VERLIERT LANGFRISTIG AUCH EINFLUSS AUF ZENTRALE TEILE DER EIGENEN WERTSCHÖPFUNG.

Und viertens kommt der Ausgestaltung des regulatorischen Rahmens eine entscheidende Rolle zu. Der europäische AI Act setzt wichtige Leitplanken für Sicherheit und Vertrauen. Ebenso wichtig ist jedoch, dass seine Umsetzung innovationsfreundlich und praktikabel bleibt, damit industrielle Anwendungen nicht unnötig erschwert werden. Regulierung muss dabei als Enabler verstanden werden, nicht als Hemmnis.

KI ist Teil der unternehmerischen Souveränität Für die Unternehmen ergibt sich daraus ein klarer Handlungsauftrag. KI darf nicht allein als Instrument zur Effizienzsteigerung verstanden werden. Sie ist Teil unternehmerischer Souveränität. Entsprechend gilt es, Kompetenzen im Umgang mit Daten und KI aufzubauen, technologische Abhängigkeiten aktiv zu steuern und Investitionsentscheidungen konsequent an langfristige strategische Ziele auszurichten. Dazu gehört auch, eigene Datenstrategien zu entwickeln und Partnerschaften gezielt so zu gestalten, dass Kontrolle und Wertschöpfung im Unternehmen bleiben. Die industrielle Zukunft Europas entscheidet sich nicht allein im Wettlauf um die leistungsfähigsten Technologien. Sie entscheidet sich an der Frage, ob es gelingt, technologische Souveränität mit wirtschaftlicher Leistungsfähigkeit zu verbinden.

KI-Souveränität wird damit zu einem entscheidenden Faktor für eine Industrie, die auch unter unsicheren und geopolitisch geprägten Rahmenbedingungen handlungsfähig, resilient und wettbewerbsfähig bleibt. Sie ist die Voraussetzung dafür, dass industrielle Wertschöpfung auch in Zukunft in Europa gestaltet und nicht nur von außen vorgegeben wird. RT

JESSICA FRITZ ist Expertin Digitaltechnologien beim VDMA e.V. Informatik, Software und Digitalisierung.

Ein zentraler Engpass ist die fehlende Integration zwischen Produktionssystemen und UnternehmensIT. Daten aus Sensorik, PLC-, SCADA- und MESSystemen sind heterogen und oft ohne konsistente Zeitbasis oder eindeutige Anlagenzuordnung.

Bild: © panuwat/stock.adobe.com

In vielen Betrieben wird KI diskutiert, als reiche ein geeignetes Modell plus Datenanbindung. In der Praxis entscheidet jedoch nicht der Algorithmus, sondern die Belastbarkeit der technischen Basis. VON RAIK WEHSER

KI-Systeme erzeugen zusätzliche Rechenlast, erhöhen Datenvolumen und greifen in bestehende Prozessketten ein. Sie benötigen stabile Netze, skalierbare Plattformen, konsistente Datenstrukturen und klar geregelte Betriebsprozesse. Sind Infrastruktur, Datenarchitektur und Verantwortlichkeiten nicht darauf ausgelegt, wird aus einer KI-Initiative schnell ein Verfügbarkeits-, Sicherheitsoder Compliance-Risiko. KI-Readiness ist damit vor allem ein Infrastruktur-, Governance- und Betriebs-Thema.

Denn: Ein erheblicher Teil der produktionsnahen IT basiert auf Komponenten mit auslaufendem Hersteller-Support. Analysen aus dem „Kyndryl Manufacturing Readiness Report 2025“ zeigen, dass rund 29 Prozent der geschäftskritischen IT-Infrastruktur in der Fertigungsindustrie den HerstellerSupport bereits verloren haben oder kurz davorstehen. Dazu zählen Netzwerk-Infrastruktur, Speicher-Systeme sowie physische oder virtuelle Server-Systeme, auf denen produktionsnahe Anwendungen betrieben werden.

Fehlende Patches, knappe Ersatzteile und schwindendes Spezialwissen erhöhen das Ausfallrisiko. Gleichzeitig steigen Anforderungen an Audit-Fähigkeit und Schwachstellen-Management. Jede Modernisierung muss gegen bestehende Abhängigkeiten abgesichert werden. Zusätzliche KI-Workloads erhöhen die Komplexität weiter.

Fragmentierte System-Landschaften verhindern Skalierung

KI benötigt konsistente Daten, standardisierte Laufzeitumgebungen und einen über Werke hinweg einheitlichen Betrieb. In vielen Unternehmen ist die IT jedoch standortweise gewachsen. Unterschiedliche Architekturen, Schnittstellen und lokal optimierte Lösungen verhindern Skalierung. Ohne gemeinsame Datenplattform, einheitliche Identitäten und verbindliche Integrations-Standards bleibt jede Lösung ein Sonderfall. Piloten funktionieren, der Übergang in den Regelbetrieb scheitert an fehlender Zentralisierung von Monitoring, Change-Management und Security-Policies.

Gleichzeitig steigt der wirtschaftliche Druck. 63 Prozent berichten von höherem ROI-Druck auf KI-Investitionen, 54 Prozent sehen Innovation durch Probleme im Tech-Stack gebremst. Variierende Datenmodelle und Berechtigungskonzepte erhöhen Aufwand und Risiko.

KI BENÖTIGT KONSISTENTE DATEN, STANDARDISIERTE LAUFZEITUMGEBUNGEN UND EINEN ÜBER WERKE HINWEG EINHEITLICHEN BETRIEB.

Ein zentraler Engpass ist die fehlende Integration zwischen Produktionssystemen und Unternehmens-IT. Daten aus Sensorik, PLC-, SCADA- und MES-Systemen sind heterogen und oft ohne konsistente Zeitbasis oder eindeutige Anlagenzuordnung. Umbauten und Firmware-Updates verändern kontinuierlich die Datenlage. Ohne klare Datenverantwortung und kontrollierte

Change-Prozesse verlieren Modelle rasch an Verlässlichkeit.

Unkoordinierte Cloud-Strukturen verteuern den Betrieb

In vielen Unternehmen ist die Cloud-Nutzung gewachsen, statt geplant. 51 Prozent beschreiben ihre Cloud-Umgebung als zufällig entstanden, 94 Prozent würden ihre Cloud-Strategie rückblickend anpassen. Für KI ist das kritisch, weil Datenströme und Abhängigkeiten zwischen Edge-, Werknetz- und Cloud-Umgebungen abgestimmt sein müssen.

Fehlende Leitplanken führen zu redundanter Datenspeicherung, steigenden Latenzen und unscharfen Sicherheitsgrenzen. 40 Prozent investieren bereits in die Rückführung von Daten in eigene Infrastruktur-Umgebungen. Für Werke bedeutet das klare Netz-Segmentierung, definierte Datenpfade und eine Edge-Schicht, die Echtzeitanforderungen erfüllt und zugleich zentral steuerbar bleibt.

Modernisieren ohne Produktionsstillstand

Produktionssysteme lassen sich nicht wie Büroanwendungen migrieren. Anlagen laufen im Mehrschichtbetrieb, Stillstände verursachen direkte Kosten. Die Modernisierung erfordert Parallelbetrieb, schrittweise Migration und definierte Rückfalloptionen. Eine Resilienzarchitektur macht Abhängigkeiten transparent, segmentiert Systeme und kapselt Workloads, sodass Änderungen isoliert geprüft werden können. Zero-Downtime lautet die Devise. Doch das setzt Transparenz, automatisierte Tests und kontrollierte Release-Prozesse voraus. Für KI bedeutet das: Daten-Pipelines und Modelle werden wie produktionskritische Komponenten behandelt, mit Versionierung und klaren Rollback-Szenarien.

Hybrid-Architekturen als Risikomanagement

Cloud-Strategien stehen heute unter geopolitischem und regulatorischem Einfluss. 63 Prozent haben ihre Strategien ange -

passt, 75 Prozent sehen Risiken bei globaler Daten-Speicherung.

Hybrid- und Multicloud-Architekturen ermöglichen, Daten je nach Schutzbedarf gezielt zu platzieren und kritische Anwendungen kontrolliert zu betreiben. Voraussetzung ist eine durchgängige Steuerung über alle Plattformen hinweg. Einheitliche Identitäts- und Berechtigungskonzepte, technisch verankerte Compliance-Vorgaben und konsistente Telemetrie schaffen Transparenz. Ohne diese Klammer wächst mit jeder zusätzlichen Plattform die Komplexität.

Governance als Skalierungsbedingung

Mit KI verschärfen sich Fragen nach Verantwortlichkeit und Kontrolle. Werden generative Dienste genutzt, können sensible Produktionsdaten unbeabsichtigt in externe Systeme gelangen. Governance muss daher von Beginn an Teil der Architektur sein.

PRODUKTIONSSYSTEME

LASSEN SICH NICHT WIE BÜROANWENDUNGEN MIGRIEREN.

Datenklassifikation, geregelte Modellfreigaben, rollenbasierte Zugriffe und Protokollierung bilden die Grundlage. Dennoch halten 31 Prozent ihre KI-Implementierung nicht für ausreichend vorbereitet, um künftige Risiken zu beherrschen. Diese Lücke entsteht, wenn Sicherheitsarchitektur und

Betriebsprozesse erst nach Pilotprojekten nachgezogen werden.

Reifegrad als Ausgangspunkt

Unterstützung bietet zudem ein strukturierter Reifegrad-Ansatz wie der Industrial Artificial Intelligence Maturity Readiness Index (AIMRI. Das von der unabhängigen Non-Profit-Organisation International Centre for Industrial Transformation (INCIT) entwickelte Modell bewertet die KI-Fähigkeit von Industrieunternehmen entlang von 20 Dimensionen, darunter Strategie, Governance, Daten- und Infrastruktur-Fähigkeiten sowie operative Anwendungsfelder in Produktion, Lieferkette und Produktlebenszyklus-Management.

Der AIMRI ermöglicht so eine systematische Standortbestimmung, priorisiert Handlungsfelder und schafft Vergleichbarkeit. Damit wird deutlich, dass erfolgreiche KI-Transformation nicht bei Use Cases beginnt, sondern bei struktureller Reife von Organisation, Infrastruktur und Betriebsmodell.

Veraltete Komponenten, fragmentierte Datenräume und unkoordinierte CloudStrukturen machen KI teuer und riskant. Wer Modernisierung als Resilienz-Programm versteht und Governance konsequent im Regelbetrieb verankert, schafft die Grundlage für skalierbare KI in der Fertigung. RT

RAIK WEHSER ist Vice President Consult Partner Automotive & Manufacturing Industry bei Kyndryl Deutschland.

Mit KI verschärfen sich Fragen nach Verantwortlichkeit und Kontrolle. Werden generative Dienste genutzt, können sensible Produktionsdaten unbeabsichtigt in externe Systeme gelangen. Bild: © Dee karen/stock.adobe.com

Viele industrielle KI-Anwendungen enttäuschen in der Praxis. Oft liegt das nicht an den Algorithmen, sondern an der verwendeten Computing-Hardware. Denn die ist weder für die zu verarbeitenden Daten noch die benötigte Software optimiert. Neue Prozessoren, die nicht nur traditionelle Daten, sondern auch Wahrscheinlichkeitsverteilungen verarbeiten können, schaffen Abhilfe.

VON PROF. PHILLIP STANLEY-MARBELL

Steht eine große Automobilfabrik still, kann das mehr als 600 US-Dollar kosten – pro Sekunde. Das ermittelte Siemens im Jahr 2024. In anderen Industrien fällt der finanzielle Schaden zwar geringer aus. Dennoch gehören Ausfallzeiten auch hier längst zu Kostentreibern, die es unbedingt zu vermeiden gilt – egal, ob sie durch defekte Maschinen oder eigentlich überflüssige Routinewartungen verursacht werden.

Kein Wunder, dass Predictive Maintenance seit Jahren zu den industriellen Anwendungen für Künstliche Intelligenz bzw. Machine Learning gehört, denen das größte Potential zugeschrieben wird: Vorausschauende Wartung kann Ausfallzeiten um bis zu 50 Prozent verringern und die Lebenszeit von Anlagen um bis zu 40 Prozent verlängern.

Diese Zahlen bleiben für viele Unternehmen jedoch Theorie. Sie kommen nicht über die Phase von Pilotprojekten hinaus, die nicht die erhofften Resultate bringen. Eine Untersuchung von Bearing Point ergab, dass nur vier Prozent der Unternehmen das erwartete Potential von Predictive Maintenance ausschöpften. Auch andere KI-Projekte in der Industrie bleiben oft hinter den Erwartungen zurück. Woran liegt das?

Heutige Computing-Hardware ist für KI-Anwendungen nur bedingt geeignet Laut einer aktuellen Untersuchung von McKinsey, für die weltweit Industrie-COOs befragt wurden, scheitert der Einsatz von KI neben organisatorischen und kulturellen Faktoren häufig an unzureichender IT/OTInfrastruktur, ungeeigneter Hardware und

mangelhafter Datenqualität. Dabei spielt auch die Rechenarchitektur eine Rolle.

Denn zwischen heutiger Computerarchitektur und den Anforderungen moderner KI für Anwendungen wie Predictive Maintenance, der Optimierung von Produktionsabläufen oder Simulationen klafft eine Lücke. Praktisch alle gängigen Prozessoren – ob in SPS-Systemen, PCs oder Rechenzentren – sind deterministisch konzipiert: ein Wert hinein, ein Wert heraus. Sie verarbeiten einzelne, eindeutige Zahlenwerte und liefern als Ergebnis stets einen einzelnen Zahlenwert.

Die Hardware-Formfaktoren sind so konzipiert, dass sie sich leicht in bestehende Systeme nachrüsten lassen.

Für klassische Anwendungen ist das ideal. Eine Steuerung erhält ein Signal und löst exakt definierte Aktionen aus. Moderne KIund Analyseverfahren operieren jedoch in einer anderen Realität: Ihre Eingangsdaten sind selten exakt. Sie arbeiten mit Wahrscheinlichkeiten und Unsicherheiten. Ihr mathematisches Fundament ist nicht deterministisch, sondern probabilistisch. Das heißt: Deterministisch konzipierte Hardware, die einzelne Zahlenwerte ausgibt, obwohl die zugrundeliegenden Eingaben mit Unsicherheiten behaftet waren, wird zum Problem.

In der industriellen Produktion ist gerade die Unsicherheit von Daten allgegenwärtig. Kein Sensor misst perfekt. Vibrationsdaten enthalten Rauschen. Temperaturfühler haben begrenzte Auflösung. Messwerte driften. Hinzu kommen Modellannahmen und schwankende Betriebsbedingungen. Jeder Eingangswert ist daher nur eine Annäherung an die Realität. Wird diese Unsicherheit bei der Berechnung ignoriert, entstehen zwangsläufig Fehlentscheidungen. Predictive Maintenance zeigt das besonders deutlich. Erkennt ein Modell ein mögliches Problem, reicht es nicht zu wissen, dass „ein Ausfall droht“. Entscheidend ist: Wie wahrscheinlich ist dieser Ausfall? Liegt die Wahrscheinlichkeit bei vier Prozent, wird man anders handeln als bei neunzig Prozent. Ohne diese Einordnung bleibt jede Warnung entweder zu vorsichtig oder zu riskant.

Zentralisierung statt Edge-KI als technische Notlösung und mit neuen

Klassische Hardware kann die benötigten probabilistischen Modelle nur mit hohem Rechenaufwand abbilden, da sie mit Einzelwerten rechnet. Soll eine Wahrscheinlichkeitsaussage erzeugt werden, muss die Berechnung vielfach wiederholt werden – mit leicht veränderten Annahmen. Dieses Vor-

Für Edge-KI-Anwendungen lässt sich der C0-Prozessor direkt an der Maschine in Form eines microSD-Moduls in bestehende Steuerungssysteme integrieren.

gehen, etwa über Monte-Carlo-Verfahren, erzeugt aus vielen Einzelergebnissen eine Wahrscheinlichkeitsverteilung. Technisch funktioniert das. Praktisch vervielfacht es jedoch den Rechenaufwand.

PROBLEM, REICHT ES NICHT ZU WISSEN,

DASS „EIN AUSFALL

DROHT“. ENTSCHEIDEND IST: WIE WAHRSCHEINLICH IST DIESER AUSFALL?

Daher sind Edge-Systeme in der Industrie für diese Berechnungen oft ungeeignet. Also werden Daten zentralisiert und in Rechenzentren oder der Cloud ausgewertet. Dort entstehen neue Herausforderungen: enorme Datenmengen, Integrationsaufwand, Latenz und zusätzliche Infrastrukturkosten. Gleichzeitig entfernt sich die Entscheidung vom Ort des Geschehens – der Maschine selbst.

Damit wird klar, woran KI-Projekte in der Industrie oft scheitern: Die Software

Der C0-Prozessor kann nicht nur Einzelwerte, sondern ganze Wahrscheinlichkeitsverteilungen in Echtzeit verarbeiten. Bilder: Signaloid

ist probabilistisch, die Hardware darunter deterministisch. Predictive Maintenance ist dabei nur ein besonders greifbares Beispiel. Dasselbe Spannungsfeld findet sich bei digitalen Zwillingen, bei der Prozessoptimierung, in der robotischen Zustandsbestimmung oder bei autonomen Systemen in der Intralogistik.

Neue Prozessorarchitekturen für probabilistisches Rechnen

Wenn der Engpass in der Rechenarchitektur liegt, muss die Lösung ebenfalls dort ansetzen. Anstatt Unsicherheit durch vielfache Wiederholungen zu approximieren, sind Prozessoren erforderlich, die Wahrscheinlichkeitsverteilungen nativ verarbeiten können. Genau hier setzen neue Prozessorarchitekturen an.

Ein Beispiel dafür ist der von Signaloid entwickelte C0-Prozessor. Für Edge-KI-Anwendungen direkt an der Maschine lässt er sich in Form eines microSD-Moduls in bestehende Steuerungssysteme integrieren, zum Beispiel von Bosch Rexroth. Er steht auch als Cloud-Lösung zur Verfügung, die unter anderem von Boeing genutzt wird. Der C0-Prozessor kann nicht nur Einzelwerte, sondern ganze Wahrscheinlichkeitsverteilungen in Echtzeit verarbeiten. Dadurch lassen sich teils enorme Leistungsgewinne gegenüber traditionellen Prozessoren erzielen: In Benchmarks zeigte sich etwa eine rund 2000-fache Beschleunigung bei der Unsicherheitsanalyse von Infrarotkameradaten und eine etwa 95-fache Beschleunigung bei der Modellierung von Strahlungsabsorption.

Durch den Einsatz von Prozessoren, die Wahrscheinlichkeitsverteilungen nativ verarbeiten können, wird transparent, mit welcher Sicherheit eine KI-Vorhersage oder -Entscheidung tatsächlich getroffen wird – die Grundlage für eine „Trustworthy AI“ in industriellen Anwendungen.

Ob Predictive Maintenance, digitale Zwillinge, Prozessoptimierung, autonome Robotik oder simulationsgestützte Qualitätsprognosen – überall dort, wo industrielle KI mit realen, variablen und statistisch geprägten Eingangsdaten arbeitet, schafft Hardware, die nativ mit Wahrscheinlichkeitsverteilungen arbeitet, die Grundlage für belastbarere Entscheidungen, effizientere Systeme und den Übergang von Pilotprojekten in den produktiven Einsatz. KF

PROF. PHILLIP STANLEY-MARBELL ist CEO/CTO und Gründer von Signaloid.

Patrick Nebout, CTO von Yanfeng, einem Zulieferer für automobile Innenräume, gibt im Interview einen Einblick in den aktuellen Stand der KI-Transformation in der Automobilproduktion. Dabei erläutert er, wie und warum sich die Ansätze in China, Europa und den USA unterscheiden und in welchen Bereichen Yangfeng bereits heute erfolgreich KI einsetzt.

Digital Manufacturing (DM): Künstliche Intelligenz wird oft als Game-Changer für die Automobilindustrie bezeichnet. Aus Ihrer globalen Perspektive: Wo stehen wir wirklich, wenn es um die Einführung von KI in der Fertigung geht, und wie unterscheiden sich die Ansätze zwischen China, Europa und den USA?

PATRICK NEBOUT: KI transformiert die Automobilproduktion bereits heute, insbesondere durch Bildverarbeitungssysteme, Qualitätskontrolle und vorausschauende Instandhaltung. Unser Unternehmen setzt KI-gestützte Computer Vision seit Jahren erfolgreich in mehreren Werken ein. China schreitet mit bemerkenswerter Geschwindigkeit voran. Unternehmen gehen dort schnell vom Pilotprojekt in die breite Umsetzung über. Europa verfolgt einen vorsichtigeren, analytischeren Ansatz und legt den Fokus auf Validierung, Regulierung und langfristige Nachhaltigkeit. In den USA treiben vor allem das Silicon

Valley und Innovationsökosysteme aus dem Verteidigungsbereich Forschung und Skalierung parallel voran. Heute nähern sich die globalen Ansätze zunehmend an. Die chinesische Führung respektiert lokale Besonderheiten und Compliance-Anforde-

Viele Teams

experimentieren mit

KI, weil die Technologie im Trend liegt – nicht weil sie ein konkretes operatives Problem löst.“

rungen, während westliche Unternehmen grundsätzlich vorsichtiger agieren. Bei Yanfeng erleben wir echte Fortschritte durch regionsübergreifende Zusammenarbeit – wir vernetzen unsere Ökosysteme über China, Europa und Nordamerika hinweg, statt in regionalen Silos zu arbeiten.

DM: Sie haben den chinesischen Markt erwähnt, der oft als Vorreiter bei der KI-Implementierung gilt. Was macht China anders, und was kann Europa davon lernen, während es seine eigenen regulatorischen Standards beibehält?

PATRICK NEBOUT: Chinas Stärke liegt in Pragmatismus und klarer Ausrichtung. Tests werden zügig durchgeführt, und sobald ein Konzept funktioniert, folgt rasch die Skalierung. Nationale Strategien verbinden Universitäten, Technologieunternehmen und Hersteller unter klaren Fünf- bis Zehn-Jahres-Plänen – alle ziehen in dieselbe Richtung.

In Nordamerika wird Innovation durch privates Kapital, Start-up-Ökosysteme und öffentliche Förderung vorangetrieben. Das Ziel ist dort, weltweit führend bei zukunftsweisenden KI-Technologien zu bleiben.

Europa hingegen neigt dazu, sich in Debatten und rechtlichen Rahmenbedingungen zu verlieren, bevor gehandelt wird. Der regulatorische Ansatz der EU ist wichtig für Vertrauen und Ethik, kann aber die industrielle Umsetzung verlangsamen. Europa kann von Chinas Tempo und Umsetzungsdisziplin lernen und dabei sein Engagement für Sicherheit, Datenschutz und verantwortungsvolle KI beibehalten.

DM: Laut der MIT-Studie „State of AI in Business 2025“ scheitern viele KI-Initiativen oder entwickeln nicht die beabsichtigte Wirkung. Welche typischen Fallstricke beobachten Sie in der Praxis, und was unterscheidet erfolgreiche KI-Projekte von solchen, die scheitern?

PATRICK NEBOUT: Laut MIT scheitern über 90 Prozent der KI-Pilotprojekte an der

WEITER AUF SEITE 16

Patrik Nebout ist CTO beim Automobilzulieferer

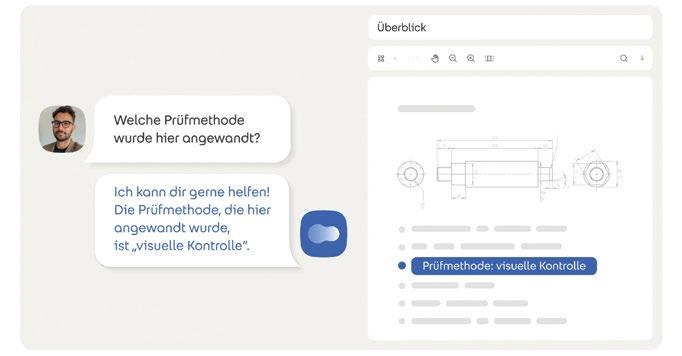

Die Industrie steht unter starkem Innovations- und Effizienzdruck. Globale Lieferketten, steigende Qualitätsanforderungen und zunehmende Regulierung treiben die Digitalisierung. KI wird zum entscheidenden Wettbewerbsfaktor im operativen Alltag. Intelligentes Dokumenten- und Qualitätsmanagement integriert KI in bestehende Geschäftsprozesse und schafft messbaren Mehrwert. VON ANDREAS DANGL

KI-Chat in Fabasoft Approve. Bild: Fabasoft Approve

In Industrieunternehmen verteilen sich Informationen häufig auf mehrere Systeme – ERP-Lösungen, CRM-Tools, CADoder BIM-Anwendungen. Das Ergebnis: hoher Koordinationsaufwand, Zeitverlust und Fehleranfälligkeit. Moderne Dokumentenmanagementsysteme verbinden ganzheitliches Datenmanagement mit KI-Funktionalitäten und schaffen ein intelligentes Assistenzsystem, das Dokumente, Metadaten und Unternehmenswissen intelligent verknüpft. Wie diese Symbiose in der Praxis funktioniert, zeigen die folgenden vier Use Cases von Fabasoft Approve.

Use Case #1: Interactive Exploded View Fachkräfte aus Konstruktion, Projektmanagement oder Verkauf müssen relevante Informationen schnell in umfangreichen Datenbeständen finden. Interactive Exploded View von Fabasoft Approve erweitert Dokumente kontextbezogen und ermöglicht intuitives Navigieren innerhalb der Datenbanken. Nutzer:innen klicken beispielsweise eine Materialnummer in einer technischen Zeichnung an und öffnen direkt die dazugehörige 360-Grad-Sicht mit Bestellinformationen und weiteren Bauteil-Details. Zusätzliche Suchanfragen in anderen Systemen entfallen.

Qualitätsmanager:innen erhalten so eine konsistente „Single Source of Truth“ für fundierte Entscheidungen über Abteilungsund Systemgrenzen hinweg.

Use Case #3: KI-Chat mit Dokumenten Anlagendokumentationen in der Energiebranche umfassen oft mehrere Tausend Dokumente. Mitarbeitende investieren erhebliche Zeit in die manuelle Durchsicht. Der KI-Chat schafft direkten Zugang zu den Inhalten: Anwender:innen befragen einzelne Dokumente oder ganze Sammlungen per Chatfenster in natürlicher Sprache und erhalten sofort präzise Antworten. Die KI ist mandantenrein konzipiert – sie lernt ausschließlich aus den Unternehmensdaten, hat keine Internetverbindung und gibt kein Wissen an andere Organisationen weiter.

Use Case #4: KI-Formulare und Fragenkataloge

Informationen stecken oft in unstrukturierten Formaten wie Bestellunterlagen oder Ausschreibungsdokumenten. Intelligente KI-Formulare automatisieren die Datenübertragung: Die KI extrahiert Metadaten aus verschiedenen Quellen und überführt sie direkt in strukturierte, digitale Formulare. Bei komplexen Ausschreibungen mit Hunderten technischen Merkmalen beantwortet die KI Anforderungskataloge automatisch, hinterlegt die jeweilige Quelle und macht Abhängigkeiten bei Revisionen sichtbar. So transformieren Unternehmen unstrukturierte Dokumente in nutzbares Wissen und beschleunigen die Projektabwicklung nachhaltig.

Von der Strategie zur messbaren Effizienz

KI entfaltet ihren Mehrwert durch konsequente Integration in bestehende Prozesse – nicht durch isolierte Pilotprojekte. Für Industrieunternehmen bedeutet das: weniger Datenchaos, mehr Durchgängigkeit – und eine nachhaltige Stärkung der Wettbewerbsfähigkeit.

Honauerstraße 4, 4020 Linz, Österreich

TEL.: +43 732 606162-0

E-MAIL: approve@fabasoft.com www.fabasoft.com/approve Fabasoft Approve GmbH

Use Case #2: 360-Grad-Sicht Informationssilos fragmentieren im Anlagenbau oft den Blick auf Projekte: Technische Zeichnungen liegen im Dokumentenmanagement, kaufmännische Daten in ERP-Systemen. Die 360-Grad-Sicht führt diese zusammen. Die KI analysiert Dokumente semantisch, erkennt automatisch Kraftwerk-Kennzeichensysteme (KKS) und verknüpft sie mit relevanten Metadaten wie Bestellpositionen oder Materialnummern.

Andreas Dangl ist Entrepreneur und Geschäftsführer der Fabasoft Approve GmbH. In seiner Funktion unterstützt er Unternehmen aus der Industrie bei der Einführung von KIgestütztem Dokumentenund Qualitätsmanagement. Bild: Fabasoft Approve

Umsetzung. Nach unserer Erfahrung liegt der Hauptgrund im Fehlen eines klaren Business Cases und Skalierungsplans. Viele Teams experimentieren mit KI, weil die Technologie aktuell im Trend liegt – nicht weil sie ein konkretes operatives Problem löst.

Erfolgreiche Projekte starten klein, fokussieren sich auf einen messbaren ROI und zielen auf schnell umsetzbare Anwendungsfälle ab, die sofortigen Mehrwert bringen. Auch externe Partnerschaften machen einen Unterschied, denn die Kombination aus industriellem Knowhow und spezialisierter KI-Expertise ist sehr wertvoll. Wichtig ist zudem: Nicht jeder Anwendungsfall benötigt ein großes Sprachmodell. Manchmal liefert ein gut optimiertes Bildverarbeitungssystem deutlich höhere Erträge.

DM: Ein schneller ROI wird oft als kritischer Erfolgsfaktor genannt. Wie geht Yanfeng an KI-Projekte heran, um sicherzustellen, dass sie tatsächlichen Wert schaffen, anstatt zu langwierigen Experimenten zu werden?

PATRICK NEBOUT: Wir verfolgen einen disziplinierten Innovationsprozess: Zunächst ein Proof of Concept, dann bei vielversprechenden Ergebnissen ein Minimum Viable Product. Zeigt ein PoC nicht schnell genug Potenzial, stoppen wir ihn konsequent. Diese agile Vorgehensweise ermöglicht es uns, Ressourcen auf Initiativen mit nachweislichem Wert zu konzentrieren.

Unsere KI-Projekte sind funktions- und regionsübergreifend angelegt und werden

durch klare Governance-Strukturen für die Skalierung unterstützt. Das Aufbrechen von Silos zwischen Business Units und Produktlinien ist dabei essenziell, denn Erfolg entsteht durch Zusammenarbeit. Zudem pflegen wir eine Kultur, die Scheitern als Teil des Lernprozesses akzeptiert. Risiken komplett zu vermeiden ist weitaus riskanter, als intelligent zu experimentieren.

den Ausschuss um mehr als 30 Prozent reduzieren. Das zweite Beispiel betrifft den Laminierungsprozess: Hier hilft KI den Mitarbeitern, Qualitätsprobleme vorherzusagen, bevor die Teile verarbeitet werden. Unser Management fördert diese Projekte aktiv auf Executive-Ebene und stellt sicher, dass Best Practices funktions- und geschäftsbereichsübergreifend ausgetauscht werden.

In fünf Jahren wird KI nahtlos in unsere Geschäftsprozesse, Entscheidungsfindung und Produktinnovation integriert sein.“

DM: Können Sie 2-3 Beispiele nennen, wo Yanfeng bereits erfolgreich KI in der Produktion eingesetzt hat? Welche messbaren Verbesserungen haben diese Anwendungen geliefert?

PATRICK NEBOUT: Für uns ist KI ein strategischer Wettbewerbsvorteil und daher teilen wir detaillierte Ergebnisse primär intern mit unseren Partnern. So viel kann ich sagen: KI-Anwendungen in der Fertigung und im Engineering haben bereits messbare Verbesserungen in Qualität, Effizienz und vorausschauender Wartung gebracht. Zwei Beispiele aus der Fertigung: Bei Endof-Line-Tests für Sichtteile setzen wir KI auf Basis von Computer Vision und Large Language Models ein. Damit konnten wir

DM: KI-Technologie ist eine Sache, aber die Menschen dahinter eine andere. Wie nehmen Sie Ihre Belegschaft auf dieser Transformationsreise mit, und wie sieht Ihr interner KI-Ansatz in der Praxis aus?

PATRICK NEBOUT: Unsere Transformation basiert auf einem KI-Ökosystem, das interne Talente, externe Partner und strukturierte Lernprozesse verbindet. Dafür bauen wir ein Center of Excellence für KI auf, das Schulungen, den Austausch von BestPractices und die gemeinsame Entwicklung von Anwendungsfällen fördert.

KI beschränkt sich nicht auf Fertigung oder Engineering – jeder Bereich kann profitieren, von Logistik und Finanzen bis zu HR und Nachhaltigkeit. Wenn Mitarbeiter KI als praktisches Werkzeug erleben, das ihre tägliche Arbeit verbessert, steigt die Akzeptanz ganz natürlich.

DM: Wo sehen Sie Yanfeng und die Automobilzulieferindustrie in Bezug auf KI in fünf Jahren? Welche Entwicklungen werden die Branche am stärksten prägen.

PATRICK NEBOUT: In fünf Jahren wird KI nahtlos in unsere Geschäftsprozesse, Entscheidungsfindung und Produktinnovation integriert sein. Die Unternehmen, die KI am effizientesten integrieren, werden sich einen entscheidenden Wettbewerbsvorteil verschaffen.

Wir erwarten, dass KI über die reine Fertigungsoptimierung hinauswächst und auch Produktinhalte prägt – intelligente Systeme werden direkt in Fahrzeugkabinen eingebettet, nicht nur in Fahrerassistenzsysteme oder beim autonomen Fahren. Das wird das Nutzererlebnis grundlegend verändern und neue Wertschöpfung für unsere Kunden ermöglichen.

Bei Yanfeng gestalten wir diese Zukunft bereits aktiv, über China, Europa und Nordamerika hinweg, im Einklang mit unserer globalen Innovationsstrategie.

DM: Herr Nebout, wir danken Ihnen für das Gespräch. KF

Zwischen Pilotprojekt und Produktivbetrieb entscheidet sich, ob KI-Lösungen ihre Versprechen einlösen können. Dabei bestimmen

auch in der Produktion nicht allein Algorithmen und Daten den Erfolg, sondern vor allem die Frage, wie belastbar und nachvollziehbar ihre Ergebnisse im Alltag wirklich sind.

Für die Manufacturing-Branche entwickelt sich künstliche Intelligenz langsam, aber sicher zum neuen Standard. Während viele Pilotprojekte in den operativen Betrieb übergehen, entscheidet sich ganz konkret in den Produktionshallen und Ingenieurbüros, ob sich die neuen Lösungen langfristig im Alltag durchsetzen. Denn was bei aller Technologie-Euphorie schnell übersehen wird: In der Praxis entscheidet nicht nur Rechenleistung über Akzeptanz und Wirksamkeit der KI, sondern in erster Linie auch das Vertrauen der Menschen, die mit ihren Ergebnissen arbeiten.

Kommt es hier zu einer Schieflage, verpuffen Investitionen in neue KI-Lösungen schnell, ohne dass Unternehmen einen Mehrwert aus ihnen ziehen können. Ein Praxisbeispiel kann verdeutlichen, wo das gesamte System bei fehlendem Vertrauen ins Stocken gerät: Meldet die KI etwa ein erhöhtes Ausfallrisiko für eine Turbine, kann die gelieferte Datenlage durchaus eindeutig erscheinen und das System empfiehlt eine vorgezogene Wartung. Das Team ist allerdings skeptisch, weil eine ähnliche Warnung sich vor Monaten als Fehlalarm erwiesen hatte, unnötiger Stillstand und entsprechend hohe Kosten waren die Folgen. Für die Mitarbeitenden stellt sich bei der neuen Analyse also nicht nur die Frage, ob die Prognose stimmt, sondern vor allem, warum und wie die KI zu diesem Ergebnis kommt.

Präzise KI-Entscheidungen sind ausschlaggebend

Die Skepsis ist angebracht und wichtig, denn besonders in Industrie- und Produktionsumgebungen sind präzise Entscheidungen ausschlaggebend. Fachkräfte müssen nachvollziehen können, welche Sensorwerte, historische Muster oder Kontextfaktoren eine Empfehlung beeinflussen.

Für einen wirklichen Mehrwert und Wettbewerbsvorteil müssen KI-Modelle erklärbar und transparent sein.

KI muss aus diesen Gründen immer auch erklärbar sein und auch abstrakte Ergebnisse begründen können. Sie macht sichtbar, welche Variablen Gewicht haben und wo Unsicherheiten liegen. Damit entstehen sowohl transparente Prozesse als auch die Möglichkeit, Verantwortung bewusst zu übernehmen. Auf diese Weise kann Vertrauen wachsen, weil Entscheidungen von der Belegschaft nicht blind akzeptiert, sondern verstanden werden.

Wie KI zum Innovationstreiber wird Erklärbarkeit allein genügt allerdings nicht. Nachhaltige Akzeptanz entsteht erst, wenn KI-Entscheidungen nachvollziehbar und in eine klare Governance-Strategie eingebettet sind. Um Risiken zu kontrollieren und Compliance-Anforderungen zu erfüllen, müssen Unternehmen Modelle, Datenbasis und Einsatzkontext transparent dokumentieren und Entscheidungen über Audit Trails rekonstruierbar machen.

Genau hier setzt IFS.ai an. Die IndustrialAI-Plattform von IFS verbindet erklärbare Modelle mit integrierter Dokumentation und konkreten Anwendungsfällen. Entscheidungslogiken entwickeln sich damit vom rein technischen Hintergrundprozess hin zu einem integrierten Bestandteil der operativen Abläufe. Empfehlungen bleiben begründbar und überprüfbar, Mitarbeitende werden nicht mit einem isolierten Output konfrontiert, sondern erhalten Kontext und Transparenz. Unternehmen können KI damit produktiv einsetzen, ohne Verantwortung aus der Hand zu geben. Mit branchenspezifischen Lösungen verbindet IFS Innovation mit klarer Governance und macht vertrauenswürdige KI zum belastbaren Wettbewerbsvorteil. Entscheidend sind diese Aspekte auch, weil mit dem EU AI Act die Transparenz, Dokumentation und das Risikomanagement zur Voraussetzung für den rechtskonformen Einsatz von KI werden.

Wo schafft künstliche Intelligenz in der Industrie heute wirklich Mehrwert – und warum scheitern viele Projekte noch an Daten, Organisation und Skalierung? Elf Expertinnen und Experten aus Industrie und Forschung zeigen, welche Use Cases funktionieren, wo die größten Hürden liegen und wie Unternehmen KI erfolgreich in ihre Prozesse integrieren. VON RAINER TRUMMER

Künstliche Intelligenz (KI) gilt als Schlüsseltechnologie für die industrielle Transformation. Von Predictive Maintenance über Qualitätskontrolle bis zur Produktionsplanung verspricht sie effizientere Prozesse und bessere Entscheidungen. Doch zwischen Pilotprojekten und breitem Roll-out liegen oft Datensilos, organisatorische Hürden und fehlende Strategien. Wie Unternehmen diese Herausforderungen meistern können und wo KI bereits messbaren Mehrwert schafft, erläutern auf den nächsten Seiten elf Experten aus Industrie und Forschung.

1 KI-Anwendungen rücken auch in der Industrie immer mehr in den Mittelpunkt. In welchen konkreten Anwendungsbereichen der Produktion schafft KI aktuell den größten Mehrwert?

2 Wie bewerten Sie die aktuelle Datenverfügbarkeit und Systemlandschaft (Maschinenanbindung, MES, ERP, Cloud/Edge) als Grundlage für KI-Anwendungen – und wo sehen Sie hier den größten Handlungsbedarf?

3 Welche Voraussetzungen müssen erfüllt sein, damit KI-Lösungen vom Pilotprojekt in einen stabilen Roll-out überführt werden können?

Senior Advisory Solution Consultant bei Appian Bild: Appian

1. Künstliche Intelligenz schafft vor allem Mehrwerte in den Bereichen Qualitätskontrolle, Predictive Maintenance und Lieferkettenoptimierung. Bei der Qualitätskontrolle erkennt KI präzise Abweichungen von Standards, indem sie Daten extrahiert und anhand von Geschäftsregeln prüft. In der vorausschauenden Wartung analysiert KI Sensordaten in Echtzeit, um Ausfälle frühzeitig zu erkennen und Wartungen optimal zu planen. Hochrelevant ist auch der Bereich ‚Know Your Business Partner‘ (KYBP): KI prüft automatisch Lieferantenzertifikate und gleicht diese mit Referenzdaten ab. So lassen sich auch Anforderungen des Lieferkettengesetzes effizient erfüllen.

2.

Der größte Handlungsbedarf liegt in einer einheitlichen Datenbasis.“

Die heterogene Systemlandschaft aus MES, ERP, Maschinen und Cloud-Lösungen erzeugt Datensilos, die KI-Pro -

jekte ausbremsen. Der größte Handlungsbedarf liegt in einer einheitlichen Datenbasis. Mithilfe einer Data Fabric lässt sich eine virtuelle Datenschicht schaffen, die Daten aus allen Quellen in Echtzeit zugänglich macht – ohne aufwändige Migration. KI-Systeme erhalten so aktuelle, qualitativ hochwertige Daten für präzise Entscheidungen. Zusätzlich identifiziert KI automatisch Datenqualitätsprobleme und hilft frühzeitig bei der Korrektur.

3.

Für einen stabilen Roll-out muss KI als integraler Bestandteil von Geschäftsprozessen verstanden werden – nicht als isoliertes Tool. In Prozesse eingebettete KI erhält klare Ziele, Governance und Verantwortlichkeit. Prozesse ermöglichen die Messbarkeit jeder KI-Aktion, gewährleisten Skalierbarkeit und sichern durch menschliche Kontrollschritte die notwendige Sicherheit. Nachvollziehbarkeit aller KI-Entscheidungen sowie klare Datenkontrolle schaffen das Vertrauen, das für einen unternehmensweiten Einsatz unabdingbar ist.

Director Product Management bei Aptean Germany Bild: Aptean Germany

Den stärksten Hebel sehen wir derzeit in drei Bereichen: vorausschauende Instandhaltung, Qualitätssicherung und Produktionssteuerung. Mit Aptean AppCentral fließen Daten aus Oxaion ERP, Syncos MES, Sensorik und Instandhaltung in eine gemeinsame KI-Schicht zusammen. Ausfallrisiken werden so frühzeitig erkannt, Wartung wird vorausschauend statt reaktiv geplant und Qualitätsmuster werden identifiziert, bevor Ausschuss entsteht. Darüber hinaus ermöglichen KI-Agenten in AppCentral erste Schritte zur autonomen Prozesssteuerung – etwa bei der Feinplanung oder wenn Regeln in der Fertigung verletzt werden. Das alles kommt aus einer Hand und einer integrierten Plattform, ohne dass Unternehmen einen zusätzlichen KI-Spezialanbieter einbinden müssen.

2.

Das ERP ist kein Auslaufmodell, sondern wird zum Backbone für eine KI-Skalierung.“

kontinuierlich einfließt. Drittens weniger Komplexität: Wer KI, ERP und MES aus einer Hand bezieht, vermeidet Schnittstellenprobleme und das Koordinieren mehrerer Anbieter. Aptean liefert genau dieses integrierte Portfolio – und macht den Roll-out damit planbar, anstatt zum Projektrisiko.

Lead Artificial Intelligence bei Cadfem Germany

Bild: Cadfem Germany

KI schafft heute schon greifbare Mehrwerte in der gesamten Produktentwicklung – vom Requirements Engineering bis hin zur Überführung in den Betrieb. Den größten Nutzen stiftet sie allerdings in den frühen Phasen der Produktentwicklung, dort, wo Varianten schnell erzeugt, bewertet und optimiert werden müssen. AI Augmented Ideation & Design beschleunigt Simulationen von Stunden auf Sekunden und macht damit große Designräume erstmals real nutzbar. KI unterstützt bei der Variantenfindung, liefert valide physiknahe Vorhersagen, reduziert Iterationszeiten und schafft so eine neue Qualität datengetriebener Entscheidungen.

2.

Für KI sind saubere Datenerfassung, Standards, klare Pipelines und einheitliche Formate entscheidend.“

Das eigentliche Problem ist nicht die fehlende Datenverfügbarkeit – es sind Datensilos. ERP, MES und Maschinenanbindung liefern reichlich Informationen, aber eben isoliert voneinander. Entscheidungen basieren deshalb oft auf verzögerten oder unvollständigen Auswertungen. Der größte Handlungsbedarf liegt in der semantischen Integration: Systeme müssen nicht nur verbunden, sondern in einen gemeinsamen Kontext gebracht werden. Genau das übernimmt AppCentral als zentrale Intelligenzschicht, die Oxaion ERP, Syncos MES und weitere Quellen konsolidiert und für KI-Modelle nutzbar macht – flexibel on-premise, in der Cloud oder hybrid betrieben.

3.

Drei Faktoren sind aus unserer Sicht entscheidend. Erstens eine saubere, konsistente Datenbasis: keine Silos, sondern durchgängige Integration über alle Systemebenen. Zweitens Transparenz: KI darf keine Blackbox sein. AppCentral liefert nachvollziehbare Empfehlungen, in die Nutzerfeedback

Daten gibt es in der Industrie bereits heute reichlich: Simulationen, Sensorik und bestehende Systeme liefern einen großen Datenschatz. Der Engpass liegt nicht in der Menge, sondern in der Struktur, Qualität und Nutzbarkeit. Häufig sind Daten verteilt, inkonsistent oder nicht maschinenlesbar. Für KI sind jedoch saubere Datenerfassung, Standards, klare Pipelines und einheitliche Formate entscheidend. Der größte Hebel besteht darin, Daten systematisch vorzubereiten und über Abteilungsgrenzen hinweg zugänglich zu machen.

3. Der Übergang scheitert selten an der Modellgüte, sondern an Betrieb und Organisation. Für einen stabilen Roll-out braucht es robuste Datenpipelines, Versionierung, Monitoring und klare Verantwortlichkeiten, um Modelle automatisiert zu aktualisieren und Qualitätsdrifts früh zu erkennen. Ebenso wichtig ist die Nutzerakzeptanz: Mitarbeitende müssen die KI verstehen, vertrauen und in ihre Workflows integrieren können. Erst das Zusammenspiel aus Technik, Prozessen und Change-Management ermöglicht skalierbare KI.

1.

Vorstand Elunic AG

Bild: Elunic

Die wahre Revolution durch KI findet aktuell in der Verwaltung statt – in den Fabrikhallen haben wir in Deutschland

1 KI-Anwendungen rücken auch in der Industrie immer mehr in den Mittelpunkt. In welchen konkreten Anwendungsbereichen der Produktion schafft KI aktuell den größten Mehrwert?

2 Wie bewerten Sie die aktuelle Datenverfügbarkeit und Systemlandschaft (Maschinenanbindung, MES, ERP, Cloud/Edge) als Grundlage für KI-Anwendungen – und wo sehen Sie hier den größten Handlungsbedarf?

3 Welche Voraussetzungen müssen erfüllt sein, damit KI-Lösungen vom Pilotprojekt in einen stabilen Roll-out überführt werden können?

die letzten 30 Jahre zur Produktion 4.0 hochautomatisiert, an den Schreibtischen stecken viele Unternehmen aber noch im Büro 1.0 fest. Aktuell sehe ich den größten Mehrwert nicht bei den physischen Maschinen, sondern im Customer Service und After Sales sowie bei der Aufbereitung von Stammdaten. Wir bewegen uns in der Kundenbetreuung von Self-Service-Portalen hin zum echten ‚Self-Solvement‘. Ein weiterer großer Hebel ist das Aufbrechen von Datensilos. Produktionsdaten und Fehlercodes lassen sich heute einfach in natürlicher Sprache abfragen, ohne dass jemand komplexe Dashboards aufwändig konfigurieren muss. Der eigentliche Mehrwert liegt im Skalieren von Erfahrungswissen und im Abgeben von Routineaufgaben an Agenten.

2.

Das große Sprachmodell (LLM) – ob nun von OpenAI, Anthropic oder anderen Anbietern – ist mehr oder weniger austauschbar und nicht mehr so relevant. Der große Hebel liegt im Prozess und der Datenzugänglichkeit, denn nur durch die Mitgabe von maschinenbauspezifischem Kontext kann die KI in unserer Systemlandschaft verlässliche Entscheidungen treffen. In vielen Unternehmen ist das Wissen heute noch in hierarchischen Strukturen abgegrenzt, die durch einen geschützten Zugang zu Informationen geprägt sind. Der größte Handlungsbedarf liegt in der fachlichen Strukturierung und Aufnahme dieser Datenmengen.

3.

Um aus der Pilotphase herauszukommen, müssen wir in Stufen denken.“

Die Technologie ist da, das eigentliche Nadelöhr ist das Mindset und die Disziplin. Ein erfolgreiches Projekt scheitert oft daran, dass direkt das ‚dickste Brett‘ gebohrt werden will – etwa einen Service-Bot zu bauen, der ab Tag eins jedes hochkomplexe Fachproblem löst. Um aus der Pilotphase herauszukommen, müssen wir in Stufen denken. Bei Elunic bewerten wir Geschäftsvorgänge dafür mit der RICE-Methode – einem Priorisierungs-Framework aus dem Produktmanagement, das wir auf KI-Use Cases übertragen haben. RICE steht für Reach, Impact, Confidence und Effort. Das Prinzip: Wer zu viele Ideen hat und nicht weiß, wo er anfangen soll, braucht kein Bauchgefühl, sondern eine objektivierte Entscheidungsgrundlage. Genau das liefert RICE – und stellt sicher, dass die ersten umgesetzten Cases schnelle Durchschlagskraft haben und intern Vertrauen in die Technologie aufbauen. Viel wichtiger ist aber die menschliche Komponente: Wir müssen das Delegieren lernen. Wer mit KI arbeitet, hört auf, Ergebnisse mühsam selbst zu schreiben, und lernt stattdessen zu beschreiben, welches Ergebnis er erzielen will. Diese Transformation erfordert den Fokus auf das Wesentliche.

Geschäftsführer

von Fabasoft Approve

Bild: Fabasoft Approve

Den größten Mehrwert schafft KI dort, wo große Mengen qualitätsrelevanter Daten verarbeitet und in Maßnahmen überführt werden. Ein wesentlicher Hebel liegt in der präventiven Qualitätssicherung. KI erkennt frühzeitig Muster in Produktionsund Qualitätsdaten, bevor überhaupt Fehler entstehen. Gleichzeitig beschleunigt sie Abläufe wie FMEA oder den 8D-Prozess durch datenbasierte Vorschläge für Ursachenanalysen und Maßnahmen. Gerade in der Fertigung und im Anlagenbau, wo viel Wissen bislang unstrukturiert vorliegt, schafft KI erstmals eine durchgängige, wirklich nutzbare Datenbasis.

2.

Viele Industrieunternehmen verfügen bereits über Systemlandschaften mit ERP und weiteren Tools. Die Herausforderung liegt darin, diese Systeme sinnvoll zu vernetzen und konsistente Daten zu schaffen. In der Praxis begegnen uns häufig Datensilos, Medienbrüche und fehlende Datenmodelle. Das erschwert den Einsatz von KI deutlich, da ihre Leistungsfähigkeit von der Datenqualität abhängt. Handlungsbedarf sehen wir im Aufbau einer unternehmensübergreifenden ‚Single Source of Truth‘ sowie in der Integration bestehender Systeme in eine gemeinsame Datenumgebung. Cloud-native Architekturen helfen dabei, da sie die nötige Skalierbarkeit und Flexibilität für den effizienten KI-Betrieb bieten.

KI-Initiativen brauchen klar definierte Anwendungsfälle mit messbarem Mehrwert.“

3. Der Übergang ist vor allem eine Frage der richtigen Rahmenbedingungen. KI-Initiativen brauchen klar definierte Anwendungsfälle mit messbarem Mehrwert und eine saubere Datenbasis für verlässliche Ergebnisse. Entscheidend ist außerdem, dass sich die KI nahtlos in bestehende Systeme und Arbeitsabläufe integriert. Erst wenn sie im operativen Alltag genutzt wird und sich auf Basis realer Daten stetig verbessert, entfaltet sie ihr volles Potenzial.

1.

Sören Michl

Vice President AI Adoption bei IFS

Bild: IFS

Aktuell schafft KI den größten Mehrwert in der Produktion, indem sie beispielsweise mit Predictive Maintenance Stillstände vermeidet, Produktionspläne optimiert, Lieferketten effizienter steuert und transparenter macht sowie Abweichungen im Shopfloor frühzeitig erkennt. Dadurch entstehen nicht nur stabilere Abläufe, sondern auch eine deutliche Kostentransparenz und konkrete Einsparpotenziale. Dies setzt allerdings voraus, dass KI direkt in die operativen Prozesse integriert ist.

Viele Unternehmen haben bereits eine breite Systemlandschaft aus Maschinenanbindung, MES und ERP, die große Datenmengen produziert. Die Herausforderung liegt jedoch weniger in der Verfügbarkeit, sondern in der Fragmentierung, dem fehlenden Kontext und der oft unzureichenden Qualität der Daten. Sie liegen oftmals in Silos, sind nicht durchgängig verknüpft und häufig nicht in Echtzeit verfügbar. Gleichzeitig wird genau hier bereits KI eingesetzt. Sie nutzt die Daten nicht nur passiv, sondern trägt aktiv dazu bei, deren Qualität zu verbessern. Beispielsweise erkennt sie Inkonsistenzen, ergänzt den Kontext und bereinigt automatisiert Daten. So entsteht schrittweise eine belastbare Datengrundlage, auf der weiterführende KI-Anwendungen sinnvoll aufbauen können.

3.

Die beste KI ist die, die man nicht sieht –weil sie nahtlos in Prozesse integriert ist.“

Der erfolgreiche Roll-out von KI gelingt dann, wenn sie im Alltag spürbaren Nutzen schafft, ohne zusätzliche Komplexität zu erzeugen. Die beste KI ist die, die man nicht sieht – weil sie nahtlos in Prozesse integriert ist und im Hintergrund bessere Entscheidungen, Automatisierung und klare Handlungsempfehlungen liefert. Entscheidend ist also, dass KI direkt in der Anwendung wirkt und nicht als isoliertes Tool genutzt werden muss.

1.

Bereichsleiter Fraunhofer IEM, Geschäftsleitung it’s OWL

Bild: it’s OWL

Es gibt nicht ‚den‘ Anwendungsfall in der Produktion; der Mehrwert von KI entsteht in der Breite. In unserem Flagship-Projekt Datenfabrik.NRW haben wir beispielsweise rund 50 konkrete Use Cases umgesetzt – von der Fabrikplanung über die Produktionssteuerung bis hin zur Qualitätskontrolle und Logistik. Die zentrale Erkenntnis: KI ist kein punktuelles Tool, sondern ein Querschnittswerkzeug für bessere Entscheidungen entlang der gesamten Wertschöpfungskette. Unternehmen, die das verstehen, gehen weg von einzelnen Leuchtturm-Use Cases hin zu einer systematischen Integration von KI in ihre Kernprozesse.

2.

KI ist kein punktuelles Tool, sondern ein Querschnittswerkzeug für bessere Entscheidungen entlang der gesamten Wertschöpfungskette.“

In KI-Projekten werden ‚Digitalisierungssünden‘ schnell sichtbar: historisch gewachsene, wenig integrierte Systemlandschaften und oft unzureichende Datenqualität. Der größte Aufwand liegt daher meist in der Datenaufbereitung, nicht in den Algorithmen. Der zentrale Handlungsbedarf liegt in sauberen Datenstrukturen, Schnittstellen und konsistenter Datenbasis. Gleichzeitig kann KI helfen, Daten zu verbessern, zum Beispiel durch Anomalie-Erkennung oder das Ergänzen fehlender Informationen. Kurz gesagt: Ohne solide Datenbasis bleibt KI Stückwerk. Wer jedoch in Datenqualität und Systemintegration investiert, schafft die Voraussetzung, KI-Anwendungen skalierbar und nachhaltig in die Produktion zu bringen.

1 KI-Anwendungen rücken auch in der Industrie immer mehr in den Mittelpunkt. In welchen konkreten Anwendungsbereichen der Produktion schafft KI aktuell den größten Mehrwert?

2 Wie bewerten Sie die aktuelle Datenverfügbarkeit und Systemlandschaft (Maschinenanbindung, MES, ERP, Cloud/Edge) als Grundlage für KI-Anwendungen – und wo sehen Sie hier den größten Handlungsbedarf?

3 Welche Voraussetzungen müssen erfüllt sein, damit KI-Lösungen vom Pilotprojekt in einen stabilen Roll-out überführt werden können?

3. Business Case und die Übertragbarkeit auf weitere Anlagen oder Werke müssen von Anfang an mitgedacht werden. Das erfordert klare Governance mit definierten Verantwortlichkeiten sowie interdisziplinären Teams aus Produktion, IT und KI-Expertise. Auch mit solchen organisatorischen Fragen haben wir uns in der Datenfabrik.NRW intensiv auseinandergesetzt.

1.

Leiter Competence Center Data Science bei Megla Bild: Megla

KI kommt in der Produktion heute unterschiedlich stark zum Einsatz. Bilderkennung zur Qualitätssicherung hat sich bereits etabliert, wobei Predictive Maintenance, Predictive Quality und Energieoptimierung immer stärker gefragt sind. KI-gestützte Sichtprüfung erkennt Defekte oft mit über 99 Prozent Genauigkeit – deutlich zuverlässiger als manuelle Kontrolle. Was sich durch den KI-Hype klar verändert, ist der Wunsch, wie

mit Daten und Systemen gearbeitet wird – Stichwort Agentic AI: KI-Systeme, die selbstständig Aufgaben übernehmen, zum Beispiel das Erstellen von Dashboards und Reports.

2.

Die Datenbasis ist das Fundament, aber der Einstieg muss nicht perfekt sein. Oft lassen sich erste Projekte mit vorhandenen Daten schnell umsetzen. Was nicht fehlen darf: eine klare Datenstrategie mit definierten Zielen sowie eine Data Governance, die von Anfang an sicherstellt, dass die wachsende Datenlandschaft auch für die Anwendungsfälle von morgen geeignet ist.

3.

Der häufigste Grund, warum Pilotprojekte nicht in die Produktion überführt werden ist kein technischer. Oft wird der Faktor Mensch nicht ausreichend berücksichtigt. Konkret bedeutet das: Mitarbeitende früh einbinden Pilotteams als interne Botschafter nutzen und Erfolge sichtbar machen. Wer Change-Management von Anfang an mitdenkt und nicht ignoriert, erhöht die Erfolgschancen deutlich.

Oft wird der Faktor Mensch nicht ausreichend berücksichtigt.“

1.

Dr. Walter Heibey

Partner und Lead Architect Manufacturing bei MHP

Bild: MHP

Aktuell entfaltet KI ihren größten Mehrwert in der bildbasierten Qualitätssicherung (QS), da hier etablierte Technologien zum Einsatz kommen. Die Vorhersage von Messwerten auf Basis von Zeitreihen wird sowohl in der QS als auch in der Instandhaltung genutzt. Trotz ihres großen Potenzials

werden Large Language Models (LLMs) aktuell noch eher sporadisch eingesetzt.

2.

Hochwertige Produktionsdaten stehen heute nahezu überall zur Verfügung. Der Unterschied entsteht in der Nutzung: Während andere Märkte, insbesondere Unternehmen in China und in den USA KI-basierte, weitgehend automatisierte Echtzeit-Entscheidungen etablieren, bleibt der DACH-Bereich laut unserem aktuellen ‚Industrie 4.0 Barometer‘ häufig in der Analysephase stehen. Nicht die Datenerhebung, sondern die datengetriebene Steuerung entscheidet über Produktivität und Wettbewerbsfähigkeit. KI-Anwendungen können diesen Mehrwert erst entfalten, wenn man einen Schritt davor macht: Und zwar Steuerungslogiken konsequent in Software zu überführen und von der Hardware zu entkoppeln. Unternehmen, die ein klar definiertes architektonisches Fundament etablieren, schaffen die Voraussetzung für flexible, skalierbare und zukunftssichere Produktionssysteme sowie die Basis für KI-Anwendungen.

3.

Unternehmen haben hohe Erwartungen an KI, übersetzen diese jedoch nur begrenzt in praktische Implementierungen.“

Datendrehscheibe zwischen Shopfloor und Unternehmens-IT fungieren. Das größte Optimierungspotenzial liegt daher weniger in der KI selbst, sondern in einer durchgängigen Datenbasis, einer besseren Integration von MES- und ERP-Systemen sowie in offenen Plattform- und Cloud-/Edge-Architekturen.

3.

Grundlegende Voraussetzungen wie eine zuverlässige Maschinenanbindung, integrierte Systeme von Shopfloor bis ERP und vor allem eine durchgängige Datenbasis müssen erfüllt sein. Genauso wichtig ist, KI-Anwendungen in bestehende Prozesse und IT-Architekturen, etwa über ein MES, einzubetten und nicht als isolierte Insellösungen zu betreiben. Erst wenn die Datenqualität, Systemintegration und organisatorische Strukturen stimmen, lassen sich KI-Anwendungen langfristig stabil und erfolgreich einsetzen.

Ebenfalls in unserer aktuellen weltweiten Unternehmensbefragung haben wir gesehen, dass die DACH-Region in einem ‚KI-Hype-Gap‘ feststeckt. Unternehmen haben hohe Erwartungen an KI, übersetzen diese jedoch nur begrenzt in praktische Implementierungen. Dies unterstreicht die Notwendigkeit, Kompetenzen, Investitionen und organisatorische Voraussetzungen gezielt auszubauen, um die erwarteten Potenziale von KI in der industriellen Produktion künftig tatsächlich realisieren zu können.

1.

Für den erfolgreichen Einsatz von KI ist die konsistente Datenzusammenführung entscheidend.“

Geschäftsführer Products & Services bei MPDV Bild: MPDV

Wo man sehr viele Produktionsdaten auswerten muss und klassische Algorithmen an ihre Grenzen stoßen, bringt KI den größten Nutzen, beispielsweise in der Produktionsplanung. Da moderne Fertigungen sehr viele Arbeitsgänge, Artikelvarianten und Ressourcen benötigen, entstehen große Datenmengen und eine hohe Komplexität. KI wertet diese nicht nur aus, sondern sucht die ideale Reihenfolge für die Arbeitsgänge der jeweiligen Planungsszenarien. So reduzieren sich Bearbeitungs- sowie Rüstzeiten, und der Ressourcen-Einsatz wird optimal geplant.

2.

In den vergangenen Jahren hat sich die Datenverfügbarkeit deutlich verbessert, doch die Systemlandschaft ist noch sehr fragmentiert. Für den erfolgreichen Einsatz von KI ist die konsistente Datenzusammenführung aus Maschinen, Prozessen und Planungssystemen entscheidend. ManufacturingExecution-Systeme spielen dabei eine zentrale Rolle, da sie als

1.

Dr. Matthias Loskyll

Senior Director AI & Robotics bei Siemens Digital Industries Bild: Siemens

Industrielle KI verbessert den gesamten Lebenszyklus von Produkten und Anlagen. Großen Mehrwert sehen wir bei der Echtzeit-Datenanalyse, zum Beispiel mit Senseye Predictive Maintenance: KI prognostiziert den Wartungsbedarf von Maschinen, noch bevor ein Defekt auftritt. Aber auch bei der Qualitätskontrolle, beispielsweise mit unseren KI-gesteuerten Systemen für Sichtprüfungen Inspekto. Im Bereich generative KI beschleunigen unsere industriellen Copiloten die Generierung, Optimierung, Fehlerbehebung und Dokumentation von SPS-Code mittels natürlicher Sprache.

2.

Eine industrielle KI muss die Sprache des Engineerings sprechen: präzise, komplex und zutiefst technisch.“