Schaffen wir bei Industrial-AI das, was wir weder bei LLMs noch bei der Cloud, noch im E-Commerce, Zahlungswesen und, und, und … geschafft haben? Nämlich europäische Lösungen zu etablieren, die weltweit führend sind. Das ist die große Frage. Stellt man diese der Telekom, dann ist die Antwort: Na klar! Hat der Magenta-Riese doch unlängst die erste KI-Fabrik nach nur sechs Monaten Planungs- und Bauzeit eröffnet. Ob dieses Vorzeigeprojekt ein Erfolg wird, entscheiden aber auch die Unternehmen, die ihre KI-Projekte über diese Plattform realisieren – oder eben nicht (S. 8).

Und viele tun sich genau damit noch schwer. Denn derartige Projekte erfordern Investitionsbereitschaft, Veränderungswillen und gut aufbereitete Daten. Und noch eine weitere Zutat ist essenziell, wie auf dem Adesso Data Day zu hören war (S. 48).

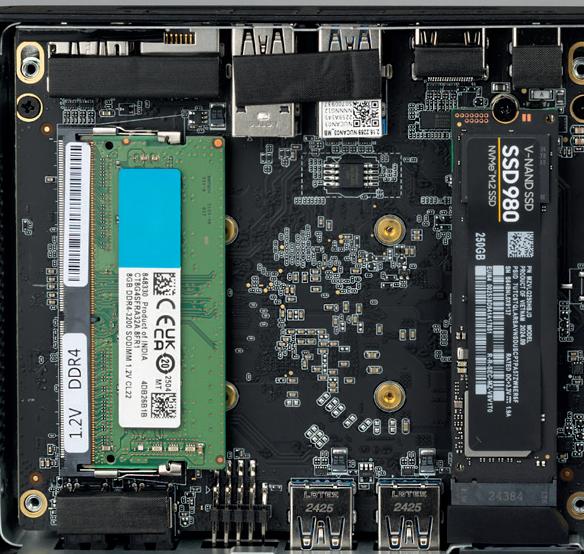

Die Schattenseite des KI-Booms zeigt sich auf einem ganz anderen Spielfeld: bei den Speicherpreisen. Denn DRAM, Grafikspeicher und auch SSDs werden nicht nur teurer, auch die Zeitspannen für Preisgarantien schrumpfen dramatisch. Welche Auswirkungen das auf den IT-Channel hat, deckt unsere Titelgeschichte auf (S. 10).

Die Channel-Chefs stehen ab sofort in unserer neuen Rubrik „Channel Chat“ im Mittelpunkt. Hier lesen Sie, was die Leader beschäftigt, was sie rückblickend vielleicht heute anders machen würden und mit wem sie gerne mal einen Tag verbringen würden (S. 6).

SYLVIA LÖSEL

sylvia.loesel@vogel.de

Der UCC-Markt wird angetrieben durch hybrides Arbeiten und neuerdings KI.

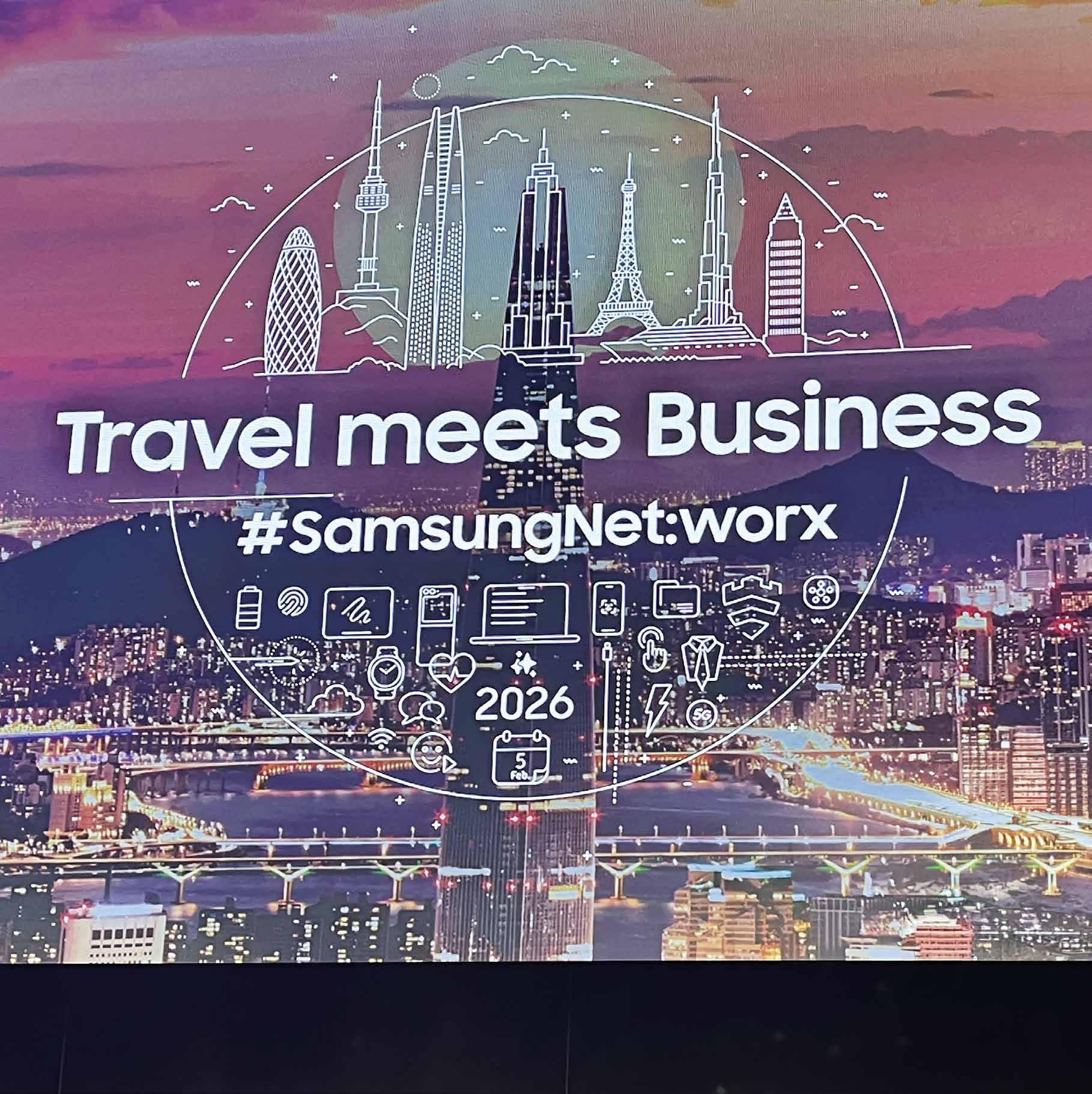

Die Cybersicherheit des eigenen Unternehmens hat inzwischen wohl fast jeder auf dem Schirm. Aber wie sieht es mit der Lieferkette aus?

44 Flexera knöpft sich Cloud-Kosten vor

ProsperOps und Chaos Genius – mit diesen beiden Übernahmen beschreitet Flexera neue Wege.

Die erste KI-Fabrik Deutschlands entstand in Rekordzeit. Die Telekom eröffnete sie jetzt in München.

MARKT & ANALYSEN

Channel-Chat mit Klaus Kaiser von der Teccle Group

Klaus Kaiser: Mit wem würden Sie gerne einen Tag tauschen? > 6

Telekom eröffnet KI-Fabrik Made in Germany

Warum dieser europäische Ansatz vor allem für den industriellen Mittelstand entscheidend ist.

> 8

TITEL Speicherdürre im IT-Channel

Der KI-Boom trocknet den Markt für DRAM, Grafikspeicher und auch SSDs aus, was die Preise massiv nach oben treibt.

> 10

Der KI-Boom trocknet den Markt für DRAM, Grafikspeicher und auch SSDs immer weiter aus, was die Preise massiv nach oben treibt.

Managed Services im Fokus

Im vierten Quartal 2025 hat Samsung einen Rekordumsatz und -gewinn erzielt. Umsatztreiber war der KI-Boom. > 18

Frischer Wind bei G Data

Nikolas Schran ist bei G Data Cyberdefense zurück und bringt grundlegende Veränderungen mit. > 20 Cybersicherheit in der Lieferkette

Warum und wie Unternehmen ihre Lieferkettensicherheit priorisieren sollten. > 22

Chefwechsel

Bei Plusserver, Veeam und Hirschtec gibt es personelle Änderungen. > 24

Neues aus dem Management

Managerwechsel bei Memorysolution, Ecotel und Forescout. > 26

Channel-News

Emvion stellt sich vor, Palo Alto mit neuem Partnerprogramm und Check Point startet Vier-Säulen-Strategie. > 27

CHANNEL FOKUS UCC

Kommunizieren, aber safe!

Seit der Corona-Pandemie geht’s aufwärts im UCC-Markt, angetrieben durch hybrides Arbeiten und neuerdings KI. > 28

PRODUKTE

Quad-CPU-Server und All-in-One-PC

Fsas stellt Quad-CPU-Server vor und Wortmann einen neuen All-in-One-PC. > 36

ISE: LED auf dem Vormarsch

Auf der ISE 2026 hatten

LED-Videowalls einen noch größeren Stellenwert als zuvor. > 38

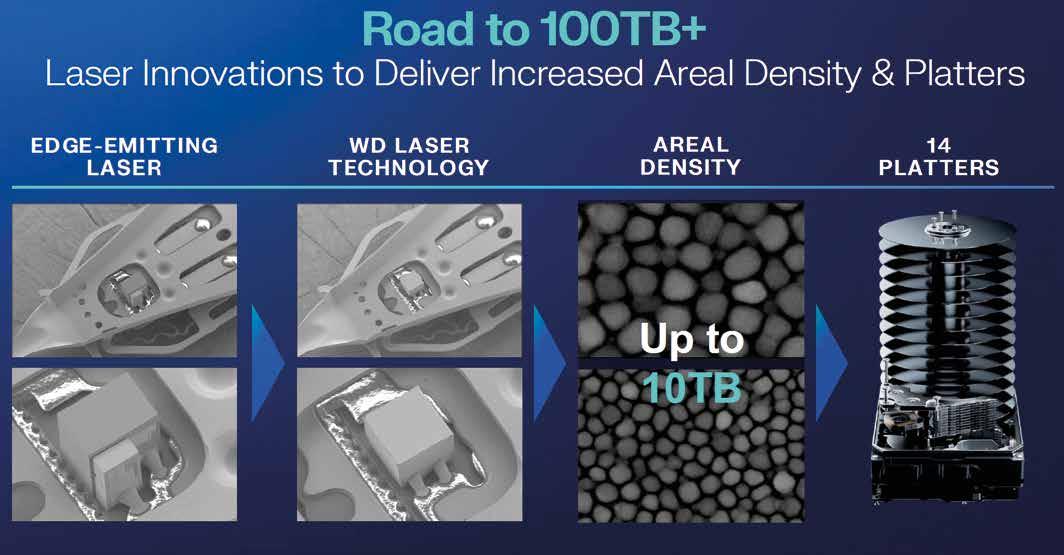

Schneller. Größer. Sparsamer

Auf dem Innovation Day 2026 hat Western Digital neue Technologien vorgestellt. > 42 Flexera knöpft sich Cloud-Kosten vor ProsperOps und Chaos Genius –mit diesen beiden Übernahmen beschreitet Flexera neue Wege. > 44

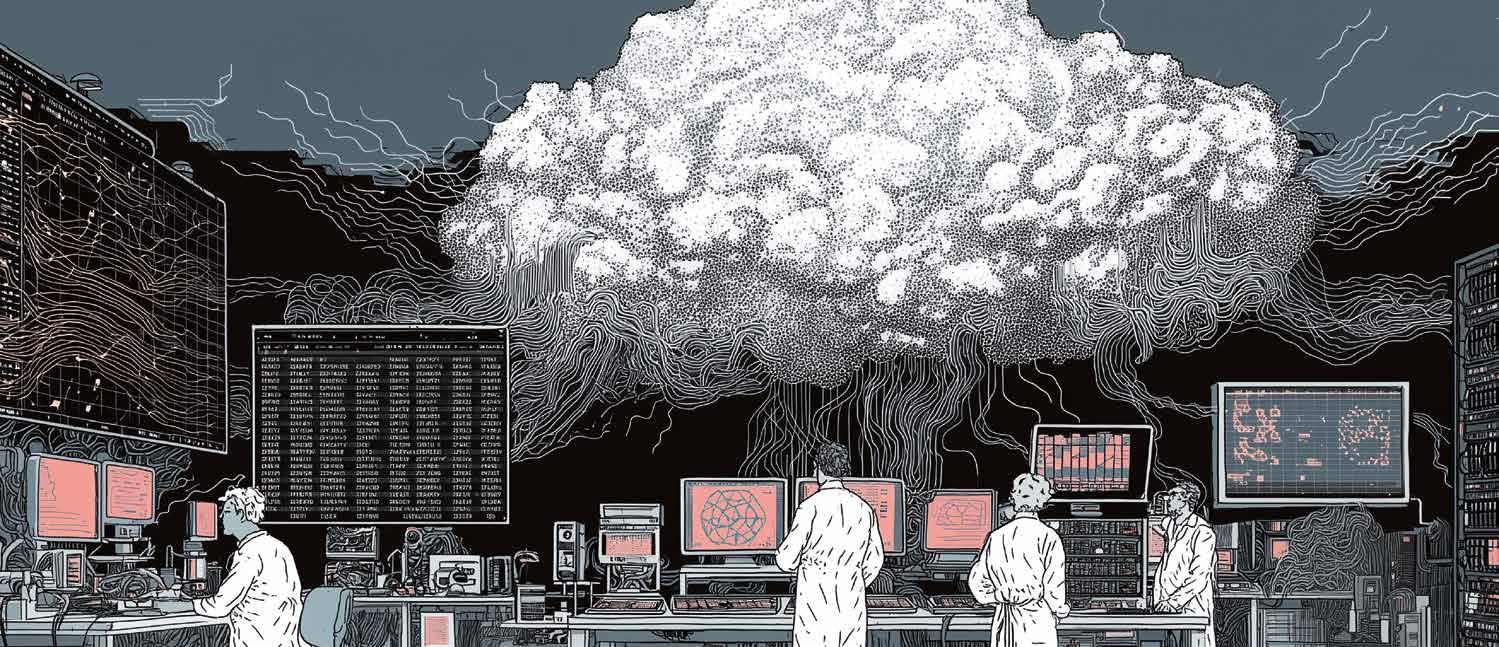

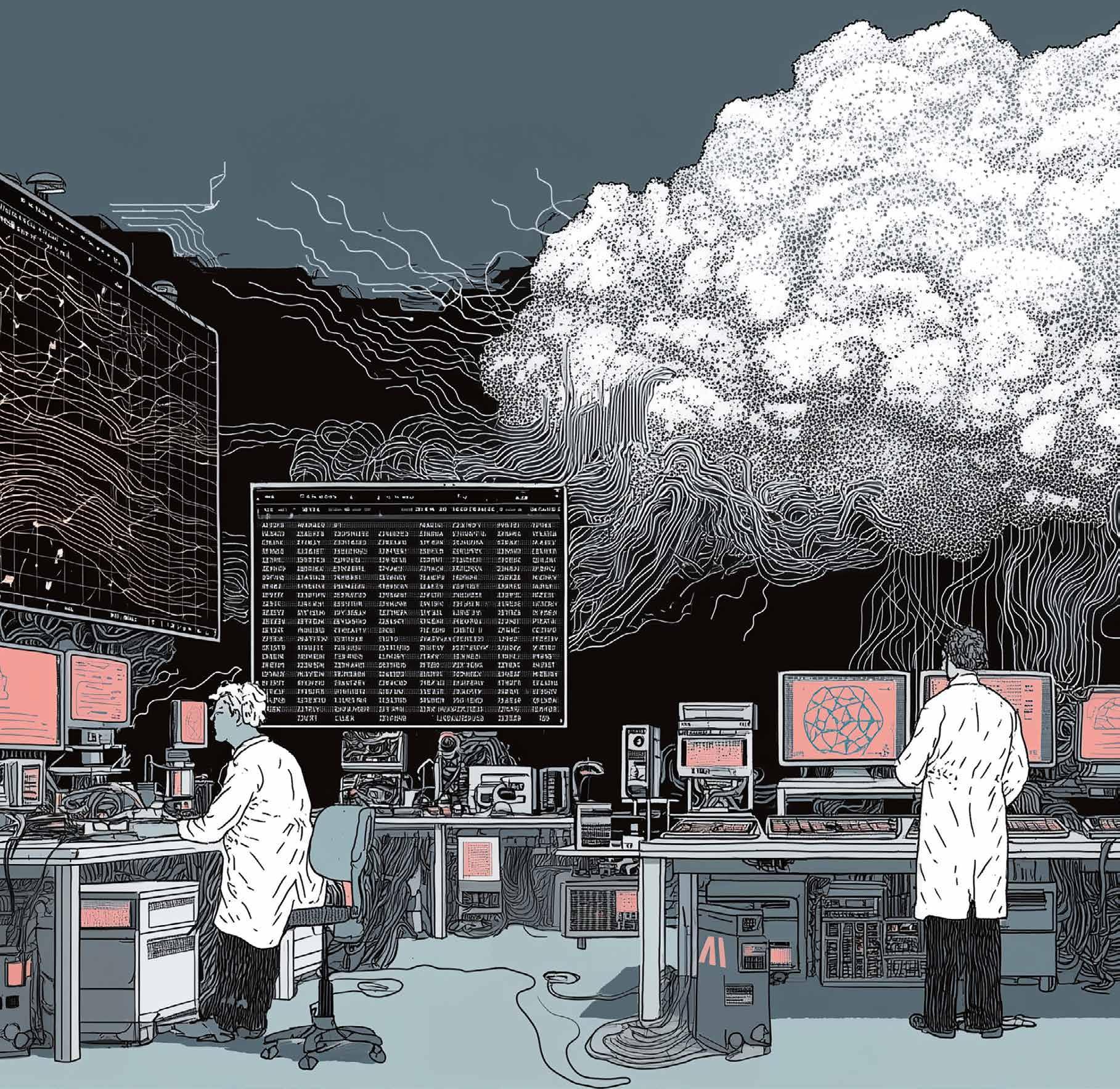

KI schlüpft nicht von selbst

KI hat in vielen Unternehmen die Experimentierphase hinter sich gelassen. Gleichzeitig zeigt sich, dass der Übergang in den breiten Einsatz oft stockt. > 48

VERANSTALTUNGEN

ISE in Barcelona

Die AV- und Systemintegrationsbranche traf sich Anfang Februar in Barcelona. > 62

ITZ Display Solutions Come together

Im Rahmen der ISE hatte ITZ zum Come together geladen. > 64

Samsung Net:worx

Die Samsung-Partnerkonferenz Mobile Experience B2B fand in Düsseldorf statt. > 66 Impressum

48 KI schlüpft nicht von selbst

Künstliche Intelligenz hat in vielen Unternehmen die Experimentierphase hinter sich gelassen. Gleichzeitig zeigt sich, dass der Übergang in den breiten Einsatz oft stockt.

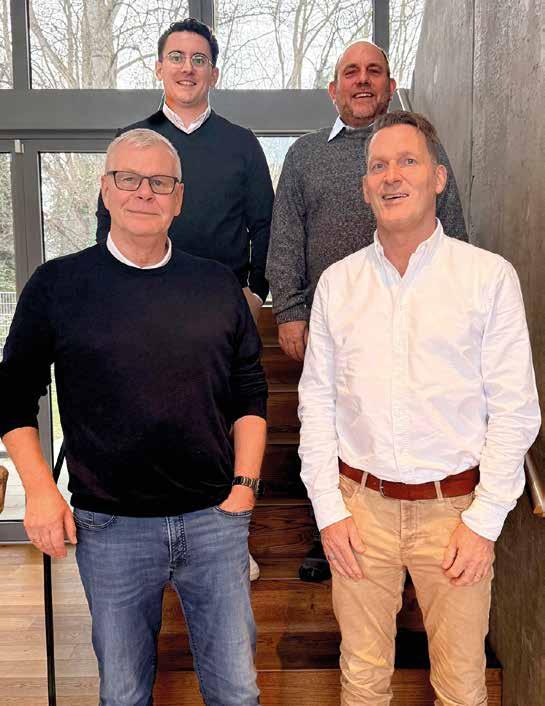

Klaus Kaiser ist Mitgründer, Managing Partner und Group CEO der Teccle Group, einem IT-Dienstleister für den deutschen Mittelstand. Er hat das Unternehmen im September 2020 mitgegründet. Unter dem Dach der Teccle bieten spezialisierte IT-Unternehmen Dienstleistungen in den Bereichen Cloud, Infrastruktur, Modern Workplace und Sicherheit an.

Mit wem würden Sie gerne einen Tag tauschen?

Mit einem unserer Kunden. Ich möchte erleben, wie es sich anfühlt, unsere Leistungen zu nutzen – im Alltag, mit echten Herausforderungen. Ich bin überzeugt: Wer sich als Anbieter weiterentwickeln will, muss den eigenen Service aus Kundensicht verstehen. Eben nicht auf einer PowerPoint-Folie, sondern live erleben.

Was hat Sie zuletzt Zeit, Geld und Nerven gekostet?

Der Balanceakt zwischen Wachstum und Integration. Fünf Jahre intensiver Aufbau und dann die Erkenntnis: Wir müssen nicht nur größer, sondern auch klarer werden. Der Weg dahin war mit vielen Herausforderungen verbunden. Aber auch mit dem Gefühl, dass wir als Team über uns hinauswachsen.

Welche Technologien bringen Ihnen konkret Geschäft – und welche eher nicht?

Managed Services sind das, was unsere Kunden brauchen – verlässlich, sicher, zukunftsfähig. Technologien, die nicht auf konkrete Probleme einzahlen, bleiben oft Wunschdenken. Wir schauen nicht auf das, was gerade einen Hype erfährt. Wir schauen auf das, was beim Kunden wirklich wirkt.

Wo brauchen Kunden heute mehr Erklärung als früher?

CHANNEL CHAT

Im Channel-Chat erfahren Sie, was die Chefs aus dem ITChannel so umtreibt...

In dieser Ausgabe mit Klaus Kaiser, Group CEO der Teccle Group

Ganz klar bei IT-Security. Viele Kunden wollen zwar digitaler werden, unterschätzen aber die Risiken. Für uns heißt das: erklären, einordnen, Vertrauen aufbauen – oft schon im ersten Gespräch. Leider ist IT-Sicherheit für viele noch wie eine Versicherung: wichtig, aber unliebsam.

Was würden Sie einem IT-Dienstleister raten, der heute neu startet?

Klar bleiben. Nicht alles gleichzeitig machen. Lieber wenige Dinge sehr gut machen und mit einem klaren Nutzenversprechen. Und: ein Team aufbauen, das nicht nur Skills mitbringt, sondern Werte teilt. Das macht den Unterschied im Alltag. n

Für Managed Service Provider (MSPs) sind Governance und Compliance längst zu zentralen Erfolgsfaktoren geworden. Während die Nachfrage nach Managed Security Services weltweit stark wächst, stehen Dienstleister vor der Herausforderung, Microsoft-365-Umgebungen über mehrere Mandanten hinweg effizient, sicher und regelkonform zu verwalten.

Das neue eBook von AvePoint, „The MSP’s Guide to Profitable Multi-Tenant Governance and Compliance“, zeigt praxisnah, wie MSPs ihre Services standardisieren, Compliance-Anforderungen erfüllen und gleichzeitig neue Umsatzpotenziale erschließen können.

Mit zunehmender Kundenzahl steigt die Komplexität exponentiell: Unterschiedliche Richtlinien, manuelle Prozesse und häufige Portalwechsel erschweren die Verwaltung Studien zufolge¹ verlieren Techniker bis zu 18 Prozent ihrer Arbeitszeit durch ineffiziente Zugriffsverwaltung, während 28 Prozent der MSPs Sicherheitsrichtlinien erst nach einem Vorfall überprüfen.

Diese Ineffizienzen führen zu Risiken, die nicht nur den operativen Aufwand erhöhen, sondern auch die Kundenzufriedenheit und Profitabilität gefährden. Gleichzeitig verschärfen neue Vorschriften wie DSGVO, HIPAA oder NIS2 den Druck auf MSPs, Compliance dauerhaft sicherzustellen.

AUTOMATION ALS SCHLÜSSEL ZU EFFIZIENZ UND SICHERHEIT

An diesem Punkt setzt AvePoint Elements Baseline Management an. Die Lösung bietet einen zentralen Ansatz, um Microsoft-365-Umgebungen automatisiert, standardisiert und skalierbar zu verwalten. Anstatt jede Mandantenkonfiguration manuell zu prüfen, können MSPs mit vordefinierten Baselines Sicherheits- und ComplianceEinstellungen über alle Kunden hinweg einheitlich umsetzen. Automatisierte Prüfungen erkennen Abweichungen frühzeitig und korrigieren sie, bevor sie zu Sicherheitsvorfällen oder Audit-Problemen führen.

Das Ergebnis:

• 60% schnelleres Onboarding neuer Kunden

• weniger manuelle Fehler durch automatisierte Richtliniendurchsetzung

• kontinuierliche Compliance über alle Mandanten hinweg

• und eine messbar höhere Servicequalität

COMPLIANCE ALS DIFFERENZIERENDER SERVICE

Für viele MSPs wird Compliance zunehmend zu einem Differenzierungsmerkmal. Kunden aus regulierten Branchen – etwa Finanzdienstleister, Gesundheitsorganisationen oder Behörden – erwarten von ihrem Dienstleister, dass Sicherheits- und Compliance-Vorgaben proaktiv eingehalten werden.

Mit AvePoint können MSPs diese Anforderungen nicht nur erfüllen, sondern in ein wiederkehrendes Geschäftsmodell überführen. Durch Services wie Compliance-Berichte, Baseline Enforcement oder Governance Monitoring entstehen neue, margenstarke Angebote – von Compliance-as-a-Service bis hin zu individuellen Beratungsprojekten.

Wie Carlo Dannies, Managing Director der HAFN IT GmbH, betont: „Der Einsatz von AvePoint Elements ist weit mehr als die Einführung eines Tools – es ist die Basis für ein konsistentes, skalierbares und zukunftssicheres Serviceangebot.“

Die Anforderungen an Governance und Compliance werden weiter steigen. Wer heute in Automatisierung und Standardisierung investiert, schafft die Grundlage für profitables Wachstum und langfristige Kundenbindung.

Das neue eBook von AvePoint bietet eine praxisorientierte Anleitung für MSPs, die ihre Governance- und Compliance-Prozesse optimieren möchten.

Jetzt kostenlos herunterladen:

The MSP’s Guide to Profitable MultiTenant Governance and Compliance AvePoint United Kingdom

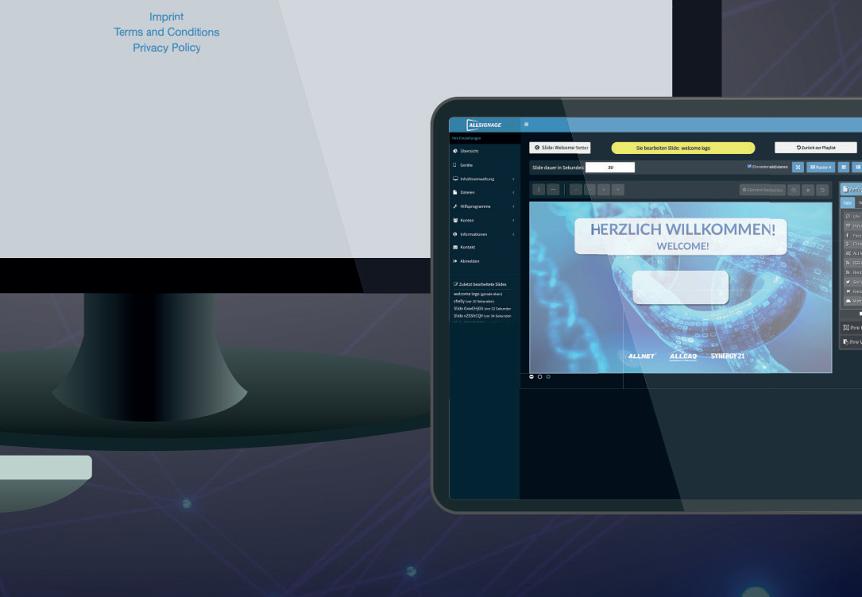

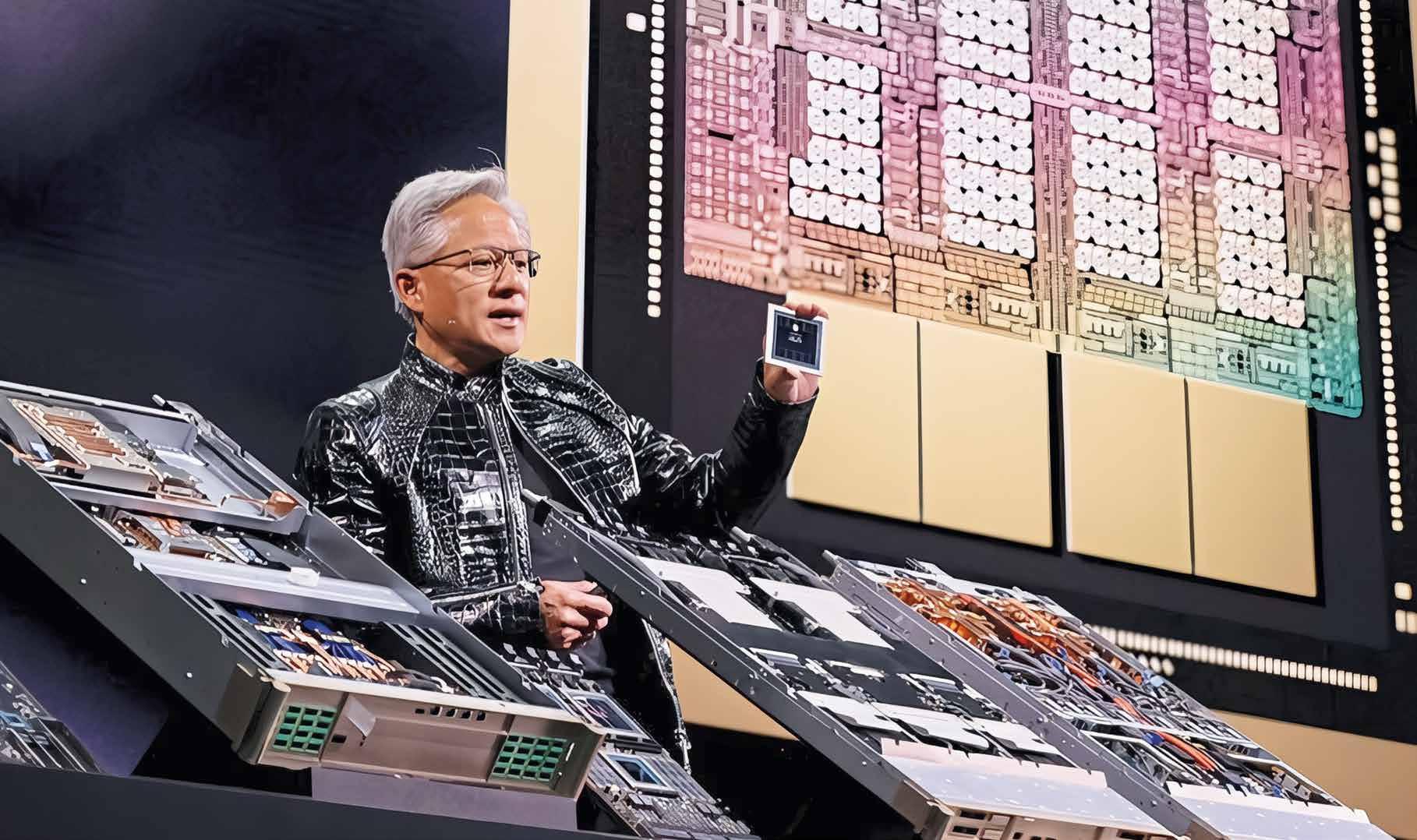

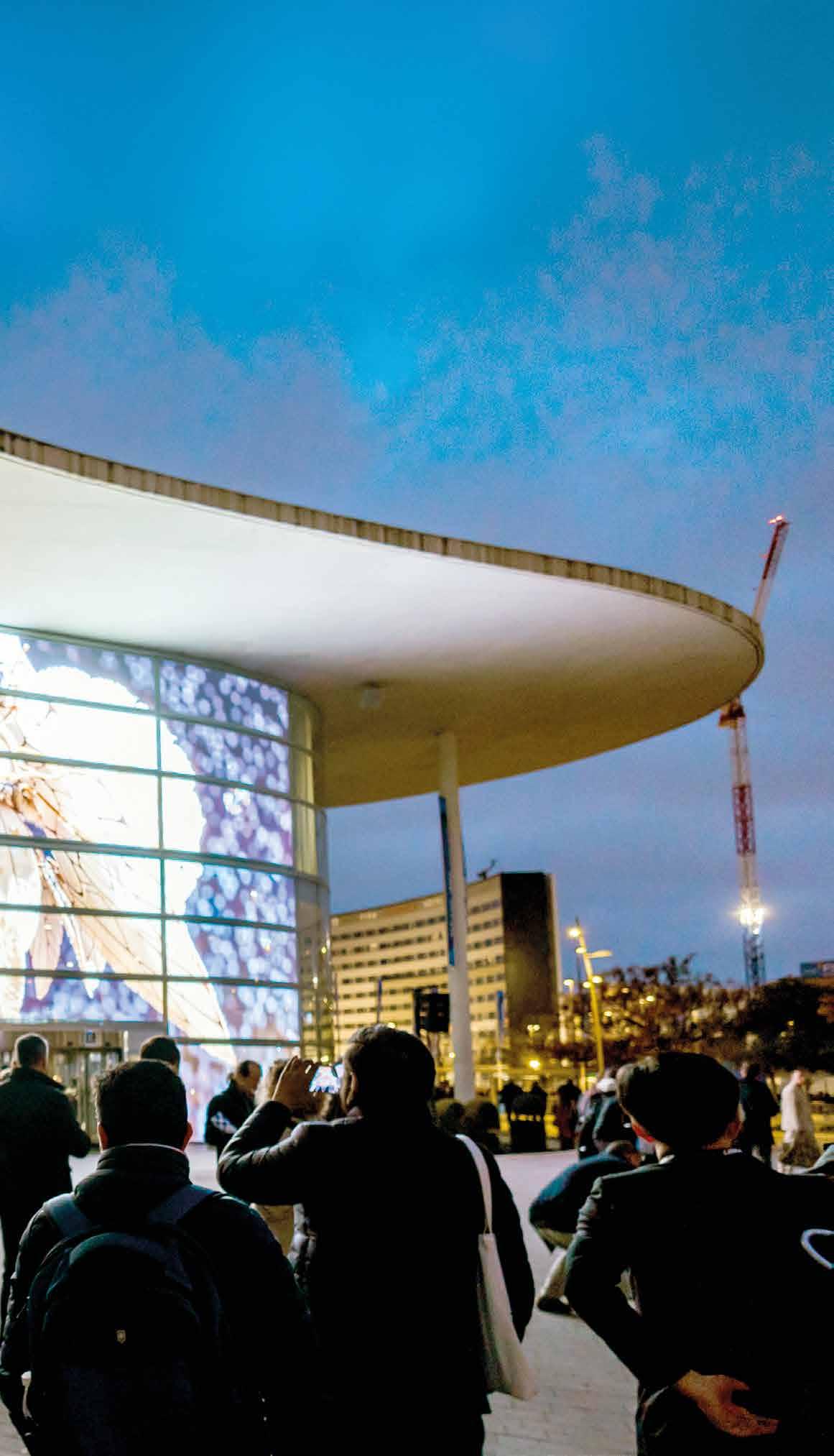

Die erste KI-Fabrik Deutschlands entstand in Rekordzeit. Die Telekom eröffnete sie jetzt in München. Warum dieser europäische Ansatz vor allem für den industriellen Mittelstand entscheidend ist und welche Anwendungen bereits laufen. | Sylvia Lösel

Es gibt jetzt keine Ausreden mehr.“

Tim Höttges, CEO der Deutschen Telekom, nimmt mit diesem Statement bei der Eröffnung der ersten KI-Fabrik in Deutschland auch den Mittelstand in die Pflicht. Denn es gehe darum, aus dem Industrie-Knowhow und den vorhandenen Daten nun der Vorreiter bei Industrial KI zu werden. Der erste Schritt sei gemacht. In nur sechs Monaten entstand die erste KI-Fabrik für die Industrie. „Man sieht, was geht, wenn alle wollen“, so der CEO. „Unsere KI-Fabrik

in München ist die Basis für innovative Geschäftsmodelle, für die Industrie, Startups und den Staat – und für Souveränität. Wir beweisen hier, dass Europa KI kann.“ Nicht nur die Politik habe schnell vieles möglich gemacht. Auch die Zusammenarbeit mit den einzelnen Unternehmen habe funktioniert. „Vielleicht hat die europäische Industrie bislang zu wenig kooperativ agiert“, sagt Höttges.

Die KI-Fabrik ist nicht nur in Rekordzeit entstanden, sie ist auch ein (fast) reines

Historischer Moment in München: Umrahmt von T-Systems-CEO Ferri Abolhassan (3. v. l.) und Telekom-Chef Tim Höttges (3. v. r.) nehmen Dieter Reiter (OB München), Markus Söder (Ministerpräsident von Bayern) und Lars Klingbeil (Bundesfinanzminister) Deutschlands erste KI-Fabrik ans Netz.

europäisches Projekt. Von den 35 beteiligten Unternehmen sind 34 aus Europa. Einzige Ausnahme: Nvidia. Ansonsten liest sich die Liste der beteiligten Unternehmen wie das Who’s who der europäischen Industrie: SAP, Siemens, Schneider Electric, Quantum Systems, Wandelbots – um nur einige zu nennen. Auf diese Art und Weise konnte ein souveräner KI-Stack aufgebaut werden – von der Connectivity über das Data Center und Security bis hin zum Application Layer und der Integration für Kunden.

Mit dem Start der KI-Factory erhöht sich die KI-Rechenleistung, die für Deutschland zur Verfügung steht, um 50 Prozent. Das macht die Dimensionen deutlich. 30 Prozent der Kapazität sei bereits „gebucht“, so Dr. Ferri Abolhassan, Vorstandsmitglied der Deutschen Telekom und CEO von T-Systems, in seiner Keynote. Nun geht es darum, auch die anderen 70 Prozent auszulasten. Und hier ist das Commitment ganz klar in Richtung deutschem Mittelstand. Die deutsche Volkswirtschaft habe genau dort ihre Stärken, wo KI künftig ihre größte Wirkung erzielt: im Maschinenbau, in der Fertigung, in der Logistik, in der Robotik. „Diese Industriedaten – das sind Vorteile, die wir endlich in digitale Führungsstärke übersetzen müssen.“ Das bedeutet: Wir müssen die Infrastruktur besitzen und die Software-Plattformen, auf denen industrielle KI entsteht, trainiert und betrieben wird. Sonst bleiben wir Anwender – und andere entscheiden über unser technologisches Schicksal.

Man wolle das Pricing so gestalten, dass dieses Offering auch für den Mittelstand attraktiv sei und sich so von den Hyperscalern abheben, die oft nur für Großkunden interessante Packages anböten. Dass dafür der Preis für die Energiekosten ein Knackpunkt ist, das gibt Höttges unumwunden zu. Und appelliert deshalb auch gleich an die bei der Eröffnung vertretenen Politiker: „Wir brauchen einen Industriestrompreis für Rechenzentren“, bekräftigt auch Bayerns Ministerpräsident Söder und gibt die Aufgabe zur Etablierung eines europäischen Energiepreises an die europäische Politikebene weiter. KI ist der Rettungsanker für die Industrie, ist Höttges überzeugt. Nachdem man den Zug bereits bei der Cloud und beim Thema „unstrukturierte Daten“ verpasst habe, muss man nun bei der Industrie-KI punkten. Die hierfür notwendigen „strukturierten Daten" wären in den Unternehmen vorhanden. Diesen Schatz gelte es nun zu heben. „Dafür haben wir nun die Voraussetzungen geschaffen.“

„Wir reden nicht, die Telekom macht”, betont Tim Höttges, CEO der Deutsche Telekom. Bisher nutzen viele Unternehmen KI zurückhaltend, weil sie den Abfluss ihrer Daten außerhalb des europäischen Wirtschaftsraums fürchten. Dadurch

entgehen ihnen Kostenvorteile mit entsprechend (negativen) Auswirkungen auf ihre Wettbewerbsfähigkeit. „Damit die Investitionsoffensive gelingt, brauchen wir beides – öffentliche und private Investitionen. Für die öffentlichen Investitionen haben wir die Voraussetzungen geschaffen und arbeiten jetzt daran, dass mit Tempo investiert wird“, sagt Bundesfinanzminister Lars Klingbeil. „Ich konnte mich heute in beeindruckender Weise davon überzeugen, dass auch die privaten Investitionen anlaufen. Für mich ist besonders wichtig: Technologieführerschaft muss der Kern des künftigen Geschäftsmodells Deutschlands sein. Hier wurde ein wichtiger Pflock für das deutsche und europäische KIÖkosystem gesetzt. Davon profitieren nicht nur innovative Unternehmen, das stärkt auch die digitale Souveränität.“

Für die KI-Fabrik wurde im Rahmen der laufenden Revitalisierung des Tucherparks, eines der größten europäischen Stadtentwicklungsprojekte, ein ehemaliges Rechenzentrum mit einer Fläche von etwa 10.700 qm entkernt und grundlegend modernisiert. Ausgestattet mit Glasfaseranbindung und modernster Technik. Das Rechenzentrum wird vollständig aus erneuerbaren Energien betrieben. Es ist auf höchste Energieeffizienz ausgelegt. Die Abwärme wird in Zukunft das gesamte Quartier Tucherpark mit Wärme versorgen. Ein modernes Kühlkonzept setzt auf Kühlung des Rechenzentrums durch Wasser des nahegelegenen Eisbachs. Die Industrial AI Cloud fügt sich damit in die Nachhaltigkeitsstrategie der Telekom ein. Rund um die Industrial AI Cloud wächst ein breites Ökosystem aus Unternehmen, Forschungseinrichtungen und Startups.

Die Eckdaten der KI-Fabrik:

■ Die Infrastruktur basiert auf rund 10.000 Nvidia-Blackwell-GPUs, darunter NvidiaDGX-B200-Systeme und Nvidia-RTX-PROServer-GPUs

■ 6 Monate von der Idee bis zum Launch

■ 5.000 Quadratmeter

■ 1 Milliarde Euro Investitionssumme

■ 50 % Erhöhung der KI-Rechenleistung in Deutschland

■ SAP liefert die „SAP Business Technology Platform“ und Anwendungen

■ 0,5 Exaflops Compute-Power

■ 4 x 400-GB-Glasfaseranbindungen

■ 20 Petabyte Speicher

Industriepartner können beispielsweise digitale Zwillinge von Fabriken und Anlagen aufbauen, Fertigungsprozesse simulieren oder Robotik- und Qualitätsprüfungsanwendungen entwickeln. Startups nutzen die Nvidia-KI-Plattform, um die Bereitstellung neuer KI-Dienstleistungen auf den Markt zu beschleunigen. Forschungseinrichtungen erhalten Zugang zu souveräner Hochleistungsrechenpower für ihre Projekte. Die Industrial AI Cloud steht ab sofort Kunden aus Industrie, Startups, Forschung und öffentlichem Sektor zur Verfügung. Unternehmen können Rechenleistung und Plattformdienste flexibel nach Bedarf buchen – von Pilotprojekten bis hin zu unternehmenskritischen Produktionssystemen.

Mit der schnellen Umsetzung der KI-Fabrik zeigt Deutschland aber auch, dass es die Kompetenzen hat, eine der geplanten KI-Gigafactories aufzubauen. Wo diese letztendlich entstehen, ist noch offen. Kompetenz ist das eine, Energiekosten und Netzstabilität sind die anderen Faktoren. n

Der KI-Boom trocknet den Markt für DRAM, Grafikspeicher und auch SSDs immer weiter aus, was die Preise massiv nach oben treibt. Wir haben nachgefragt, ob sich das in absehbarer Zeit wieder ändern wird und welche Auswirkungen das auf den IT-Channel hat. | Klaus Länger

Wir haben Ende 2025 frühzeitig Speichermodule und SSDs bevorratet. Seit 2026 ist die Lage neu: Der notwendige Nachkauf ließ die Verkaufspreise unserer Geräte deutlich steigen.

Die Aussicht auf kurzfristig wieder sinkende Speicherpreise ist nur eine Fata Morgana.

Die großen KI-Rechenzentren der Hyperscaler und der LLM-Entwickler wie Meta oder Elon Musks xAI saugen Arbeits-, Massen- und Grafikspeicher auf wie der trockene Wüstenboden einen Regenguss, was den Herstellern von DRAM und NAND Rekordumsätze beschert. Für die Systemhersteller und den IT-Channel bringt die Dürre im Speichermarkt allerdings rasant gestiegene Preise. Die Marktforscher von Trendforce haben für das vierte Quartal 2025 bei DDR5- und DDR5-SDRAM einen Preisaufschlag von etwa 45 bis 50 Prozent ermittelt und für NAND-Flash eine Steigerung von bis zu 38 Prozent. Für das erste Quartal 2026 gehen sie sogar von einer Verdoppelung bei DRAM und etwa 60 Prozent Aufschlag für SSDs aus.

Der auf Speicher spezialisierte Distributor Memorysolution teilt diese Ansicht und erwartet auf absehbare Zeit keine Besserung. Maximilian Jaud, Director Strategy & Commercial Development bei dem Spezialdistributor, erklärt dazu: „Die stark gestiegenen Preise für DRAM und NAND sind aus unserer Sicht kein kurzfristiger Ausreißer, sondern Ausdruck eines angespannten Marktes, der sich 2026 kaum entspannen dürfte. Hersteller priorisieren derzeit planbare Großkunden,

margenstarke Produkte und langfristige Steuerbarkeit – nicht maximale Stückzahlen oder kurzfristige Marktchancen.“ Auch der Spotmarkt ist kein preisberuhigendes Element mehr, sondern nur noch ein Indikator für Allokationsengpässe.

Für die Gerätehersteller und die Systemhäuser stellen die gestiegenen und weiter steigenden Speicherpreise ein großes Problem dar. Denn angesichts knapper Margen müssen sie die gestiegenen Preise der Rechner an ihre Kunden weitergeben. Zwar haben viele der großen und auch einige kleinere Hersteller wie etwa Aquado rechtzeitig einen Vorrat an DRAM und SSDs angelegt, aber auch der reicht nur eine begrenzte Zeit. So sagt Volker Rühlicke, Vorstand bei Aquado: „Wir haben frühzeitig Speichermodule und SSDs bevorratet und konnten trotz hohem Auftragsvolumen durch das Supportende von Windows 10 in Q4/25 unseren Fachhändlern faire Preise anbieten. Seit 2026 ist die Lage neu: Der notwendige Nachkauf ließ die Verkaufspreise unserer Geräte deutlich steigen.“ Dell verweist in einem knappen Firmenstatement lediglich auf die Notwendigkeit von Preisanpassungen, „wie bei anderen in der Industrie“, sowie auf

Die stark gestiegenen Prei se für DRAM und NAND sind aus unserer Sicht kein kurzfristiger Ausrei ßer, sondern Ausdruck ei nes angespannten Marktes, der sich 2026 kaum ent spannen dürfte.

Maximilian Jaud, Director Strategy & Commercial

eine resiliente und global diversifizierte Lieferkette. Laut der Nachrichtenagentur Nikkei Asia sollen Dell, HP und Acer bereits Arbeitsspeicher des chinesischen Herstellers CXMT zertifizieren. Der sei zwar auch teurer geworden, aber die Systemhersteller hätten damit eine zusätzliche Quelle, um Lieferengpässe zu vermeiden.

Olaf von Heyer, Vorstand bei Concat, registriert je nach Hersteller Preisaufschläge von 20 bis 30 Prozent, rechnet aber damit, dass die Preise noch weiter steigen. „Einige Hersteller kommunizieren sehr proaktiv, hier besteht die Chance, Ware für Kunden zu einem aktuell günstigen Preis zu beziehen“, fügt der Concat-Chef hinzu. Laut Matthias Assmann, Vorstand von ElectronicPartner und Comteam-Geschäftsführer, reduzieren zudem einige PC- und Notebook-Hersteller den Arbeitsspeicher ihrer Geräte „beispielsweise von 16 GB auf 8 GB. So können Liefermengen sichergestellt und die Preiserhöhungen für Endkunden möglichst moderat gehalten werden.“ Allerdings dürften vor allem bei PremiumNotebooks die Preise steigen, da hier große und schnelle LPDDR5X-Speicher zum Einsatz kommen.

Für die Kunden und damit auch den Channel sind weniger die steigenden

„Nvidia Rubin“: CEO Jensen Huang stellt auf seiner Keynote zur CES 2026 die KI-GPU der nächsten Generation vor. Sie wird in den Nvidia-eigen KI-Servern eingesetzt und auch in Systemen von OEM-Partnern.

Das Training von LLMs oder Inferenz im großen Stil benötigt enorme Mengen an Grafik- und Arbeitsspeicher. So sitzen auf einer der kommenden Rubin-GPUs von Nvidia 288 GB HBM4, dazu kommen beim Vera-Rubin-Superchip noch 1,5 TB LPDDR5X für die Vera-ARMCPU. In einem NVL72-Rack stecken insgesamt 36 CPUs und 72 GPUs. Und in den großen KI-Rechenzentren werden davon Hunderte stehen.

Generell gilt: Kunden können mit Preiserhöhungen umgehen, aber nicht mit Unverbindlichkeit.

Preise an sich ein Problem, sondern eher die fehlende Planungssicherheit: „Angebotspreise können oftmals nur wenige Tage garantiert werden, und verlässliche Aussagen zu Lieferzeiten sind nahezu unmöglich“, erläutert Frank Söder, Geschäftsführer beim Systemhaus Kutzschbach. Von Heyer unterstreicht das mit der Aussage: „Kunden können mit Preiserhöhungen umgehen, aber nicht mit Unverbindlichkeit.“ Sie würden erwarten, dass

bei Angeboten die zugesagten Laufzeiten eingehalten werden. Allerdings werde die Zeitspanne, in der die Hersteller ihre eigenen Preise im Voraus kommunizieren können, immer kürzer. Laut Rühlicke ist diese Unsicherheit für den Fachhandel ein Problem, da die Partner bei Angeboten keine verbindlichen Preise mehr nennen können. Speziell bei Ausschreibungen öffentlicher Auftraggeber bestehe „kaum eine Chance, risikofrei anzubieten und den Zuschlag zu erhalten.“ Auch bei Kutzschbach ist man damit konfrontiert, dass Kunden Projekte verschieben oder bestehende Systeme

lieber durch verlängerte Garantien absichern und länger betreiben. Projektstornierungen gab es bislang nicht, berichtet Söder, „da wir die angebotenen Lösungen innerhalb der jeweiligen Preisbindungen der Hersteller rechtzeitig bestellen konnten“. Allerdings werde das immer schwerer.

Einige Concat-Kunden haben sich ebenfalls dazu entschlossen, bestehende Umgebungen weiter zu betreiben und Aktualisierungen zu verschieben, so von Heyer. Andere Kunden „müssen handeln und in den sauren Apfel beißen“, also trotz höherer Preise investieren. Dabei gebe es ein Umdenken in der Beschaffung. Lange Angebotsphasen gibt es nicht mehr, „wenn der Preis passt, wird sofort bestellt“.

President Central Region

Jabra

Hybride Meetings stehen oft in der Kritik. Viele meinen, Besprechungen funktionierten besser, wenn entweder alle im Raum sitzen oder alle remote teilnehmen. Technisch ist es natürlich einfacher, wenn alle Teilnehmenden die gleichen Voraussetzungen haben. Hybride Meetings sind durchaus eine Herausforderung. Was aber tun? In der Realität haben sich flexible Arbeitsmodelle bereits etabliert: Viele Mitarbeitende arbeiten regelmäßig von zuhause, andere nahezu vollständig remote –etwa aufgrund von Betreuungsaufgaben, körperlichen Einschränkungen oder neurodivergenten Bedürfnissen.

Zusammenarbeit, die jeden überall abholt Aus Gründen der Inklusion, Gleichberechtigung und Talentbindung führt an hybrider Arbeit kein Weg vorbei. Hinzu kommt die standortübergreifende Zusammenarbeit, bei der ganze Teams in Konferenzräumen sitzen und per Video verbunden sind. Alle in einen Raum zu bekommen, ist oft unmöglich; alle am eigenen Laptop teilnehmen zu lassen, wenn mehrere Personen am gleichen Ort sind, hingegen absurd – denn diejenigen, die ins Büro kommen, suchen bewusst den persönlichen Austausch und machen den Weg zur Arbeit nicht, um dann alleine vorm PC zu sitzen. Die individuellen Bedürfnisse und Präferenzen sind verschieden und sollten berücksichtigt werden, um erfolgreiche Zusammenarbeit zu gewährleisten. Dazu gehört auch, dass Besprechungen –

egal welcher Art – gut organisiert und moderiert werden, sodass auch leisere Stimmen gehört werden.

Jabra hat es sich zur Aufgabe gemacht, remote und vor Ort Teilnehmende gleichberechtigt einzubinden und ein reibungsloses, möglichst natürliches Meetingerlebnis zu schaffen. Mit Jabra PanaCastLösungen lässt sich die gesamte Raumlandschaft eines Unternehmens abdecken – vom Huddle Room über mittelgroße Meetingräume bis hin zu größeren Konferenzräumen. Alle Teilnehmenden im Raum sind dank 180°-Sichtfeld optimal im Bild, intelligente Funktionen wie der Virtual Director rücken Sprechende automatisch in den Fokus. Remote-Kolleginnen und -Kollegen sehen so immer, wer spricht, und können dem Geschehen besser folgen. So entsteht ein deutlich natürlicheres und dynamischeres Meeting-Erlebnis. Sind virtuell Anwesende zusätzlich mit einem Jabra Headset und der PanaCast 20 ausgestattet, werden auch sie im Raum optimal wahrgenommen.

Das Jabra PanaCast Room Kit Multi setzt auf ein Plug and Play-Design, das die Einrichtung stark vereinfacht und den Serviceaufwand minimiert.

ermöglichen standardisierte, skalierbare Raumkonzepte. Selbst erweiterte Setups wie das Jabra PanaCast Room Kit Multi – mit PanaCast 55 VBS, Erweiterungskameras und SpeakerMic – bleiben im Handling überschaubar. Kunden profitieren von konsistenter Meetingqualität in allen Räumen und zentraler Geräteverwaltung. Der Channel erschließt sich ein attraktives Geschäftsfeld und kann sich als strategischer Partner für moderne Zusammenarbeit positionieren.

Für Reseller und Systemhäuser wirkt das Thema Video oft komplex und beratungsintensiv. Jabras PanaCast-Lösungen sind darauf ausgelegt, diese Hürde zu senken: Sie sind einfach zu implementieren, integrieren sich nahtlos in bestehende UC-Plattformen und

Die

Projektkalkulationen müssen aufgrund der gestiegenen

Komplette Stornierungen durch Kunden gebe es nicht, sondern durch Hersteller, die ihre Angebotspreise nicht halten können.

Für Assmann stellt sich die Lage weniger dramatisch dar: „Projektverschiebungen oder gar Stornierungen sind aktuell eher unwahrscheinlich. Allerdings müssen Projektkalkulationen aufgrund der gestiegenen Speicherpreise häufiger überprüft und angepasst werden.“ Zudem würden die Systemhäuser sich öfter nach alternativen Produkten und Konfigurationen umsehen, um den Kunden wirtschaftlich tragbare Lösungen bieten zu können.

Die Unterstützung durch Hersteller wird im Channel unterschiedlich wahrgenommen. Laut Assmann bemühen sich etwa Acer und Lenovo um Produktalternativen,

rechtzeitige Lieferungen und auch Hilfe bei der Planung, und auch von Heyer berichtet, dass einige Hersteller sehr proaktiv kommu nizieren, wenn sie noch verhält nismäßig günstige Geräte liefern können. Generell seien „Verbind lichkeit und Transparenz“ die beste Hilfe, die Hersteller geben können. Das unterstreicht der AquadoChef aus Herstellersicht und hebt die Kommunikation mit den Fachhändlern und das gegenseitige Vertrauen hervor. Söder gibt zu bedenken, dass auch den Systemherstellern angesichts der Marktsituation die Hände gebunden seien und sie nur eingeschränkt auf die Situation im Markt reagieren können.

Übereinstimmung herrscht bei den Systemhäusern darüber, dass es sich für

Kunden nicht lohnt, auf fallende Preise zu warten. Denn das werde in absehbarer Zeit nicht passieren. Das sagt auch Jaud vom Speicher-Distributor Memorysolution: „Aus unserer Sicht ist Abwarten derzeit keine tragfähige Strategie. Wir rechnen nicht mit einer kurzfristigen Normalisierung, sondern sehen eine nachhaltige strukturelle Veränderung im Speichermarkt. Zwar kann es punktuell zu temporären Preisbewegungen nach unten kommen, diese sind jedoch weder planbar

Notebooks mit Intels Panther-Lake-X-Prozessoren wie das Acer Swift Edge 16 AI benötigen sehr schnellen und damit kostspieligen LPDDR5X-9600-Speicher, damit die integrierte Arc-B390-GPU ihre volle Leistung liefert.

noch verlässlich genug, um darauf Entscheidungen aufzubauen. Eine spürbare, breite Preiskorrektur sehen wir aktuell nicht.“ Speziell bei kritischen und zeitgebundenen Projekten können das erhebliche Auswirkungen auf Kosten, Zeitplan und sogar die Umsetzbarkeit haben.

Während Firmenkunden durch die Preissteigerungen zwar irritiert sind, notwendige Projekte aber letztlich doch durchziehen, sieht es im Privatkundenmarkt anders aus. Hier wird es sicher etliche Anwender geben, die ihre Windows-10-Rechner auch nach dem endgültigen Ablauf des Supports durch Microsoft noch länger laufen lassen, statt einen

Angebotspreise können oftmals nur wenige Tage garantiert werden, und verlässliche Aussagen zu Lieferzeiten sind nahezu unmöglich.

Frank Söder, Geschäftsführer von Kutzschbach

BILD: MARTIN DARK

kostspieliger gewordenen Windows11-Rechner zu kaufen. So gehen die Marktforscher von Trendforce davon aus, dass durch die steigenden Preise für DRAM und SSDs im ersten Quartal 2026 die weltweiten Verkaufszahlen von Notebooks um fast 15 Prozent nach unten gehen werden. Noch dramatischer könnte sich die Situation im bisher so lukrativen Gaming-Sektor entwickeln. So gibt es Gerüchte, dass Nvidia wegen der hohen GDDR7-Preise die für dieses Jahr geplanten RTX-5000-Super-Karten mit größerem Speicher auf unbestimmte Zeit verschiebt und die für Ende 2027 geplante Herstellung der RTX-6000-Rubin-Karten ebenfalls erst später startet. Bei den derzeit aktuel-

len Karten lässt der Speicher bereits die Preise klettern, und auch schnelle DDR5Module für Gaming-PCs haben drastisch im Preis angezogen. Daher schlagen unter den Gamern die Emotionen hoch, wie man in den einschlägigen Foren lesen kann. Die KI ist dort als Preistreiber geradezu zum Hassobjekt geworden, und nicht wenige User geben an, sich entweder komplett von ihrem noch teurer gewordenen Hobby verabschieden zu wollen oder auf CloudGaming umzusteigen. Wenn sich die Stimmung nicht beruhigt und diese Drohungen wahr gemacht werden, dann könnte das vor allem jene E-Tailer schwer treffen, über die bisher der Löwenanteil dieses Komponentengeschäfts läuft. n

UCC-Plattformen haben sich von reinen Kommunikationskanälen zu wissensverarbeitenden Infrastrukturen entwickelt. Meeting-Transkripte, Chats und Dokumente werden semantisch ausgewertet. Retrieval-Augmented Generation (RAG) ermöglicht, interne Inhalte kontextuell abzurufen und generative Antworten, Zusammenfassungen oder Empfehlungen zu erzeugen.

Technisch kombiniert RAG ein Large Language Model mit einem vorgelagerten Retrieval-Mechanismus. Dokumente werden in Vektorrepräsentationen überführt und in einem Index gespeichert. Bei einer Anfrage werden relevante Fragmente mithilfe einer Ähnlichkeitssuche ermittelt und als Kontext in den Prompt integriert. Das Modell erzeugt daraus eine synthetisierte Antwort. In UCC-Umgebungen betrifft dies insbesondere Meeting-Zusammenfassungen, Chat-Assistenten, Compliance-Abfragen sowie Support-Bots mit Zugriff auf interne Wissensdatenbanken. Mit dieser Integration verändern sich jedoch grundlegende Sicherheitsannahmen. Klassische UCC-Sicherheitsmodelle fokussieren sich auf die Transportverschlüsselung, die Authentifizierung, das Identitätsmanagement und die Zugriffskontrolle. RAG transformiert diese Systeme hingegen in probabilistische Entscheidungsinstanzen. Kommunikationsinhalte werden nicht nur gespeichert, sondern auch aktiv in generative Prozesse eingebunden. Dadurch entsteht eine neue Vertrauensbeziehung zwischen Datenintegrität, semantischem Retrieval und modellbasierter Antworterzeugung. Ein zentrales Risiko besteht in der Auflösung klassischer Trust Boundaries. Inhalte unterschiedlicher Herkunft werden in einem gemeinsamen semantischen Raum aggregiert und kontextuell, nicht deterministisch verarbeitet.

Dadurch fließen Daten interpretativ in die Systemlogik ein und eröffnen neue Manipulationsmöglichkeiten.

Da UCC-Systeme große Mengen an benutzergenerierten Inhalten verarbeiten,

können manipulierte Chat-Nachrichten oder Wissenseinträge in den semantischen Index gelangen und später als Kontext in den Modellprompt einfließen. Weil Sprachmodelle Systeminstruktionen und Kontext nicht zuverlässig trennen, können solche Inhalte indirekte Steuerungswirkungen entfalten und Assistenten beeinflussen. Damit verbunden ist das Risiko eines Datenabflusses. Werden Kommunikationsarchive global indexiert, ohne den Retrieval-Prozess an Benutzerrechte zu koppeln, können sensible Informationen kontextuell offengelegt werden. Insbesondere in Cloudbasierten UCC-Umgebungen entstehen zusätzliche Herausforderungen. Die semantische Suche operiert abstrakt über Inhalte; ohne saubere Kontextisolation wird der Vektorindex faktisch zu einem globalen Datenspeicher.

Risiken durch agentische Erweiterungen: Wenn UCC-Assistenten nicht nur antwor-

ten, sondern auch Aktionen auslösen –etwa Tickets erstellen oder E-Mails versenden – kann dies zu einer Manipulation des Kontexts in privilegierten Operationen führen. Die Kombination aus generativer Antworterzeugung und externer ToolIntegration erweitert die Angriffskette erheblich.

RAG ist im UCC-Umfeld kein Komfortfeature, sondern eine sicherheitsrelevante Infrastrukturkomponente. Die Vermischung von Kommunikationsdaten und generativer Verarbeitung verschiebt das Sicherheitsparadigma. Schutzmaßnahmen müssen daher vor dem Retrieval greifen.

RAG erweitert UCC-Systeme um neue Angriffsebenen. Betreiber und Entwickler müssen diese veränderten Vertrauensgrenzen berücksichtigen, um semantische Assistenz sicher einsetzen zu können.

https://www.neosec-it.com/

Sandikci begrüßt die Teilnehmenden der Samsung Net:worx 2026 in Düsseldorf.

Im vierten Quartal 2025 hat Samsung einen Rekordumsatz und -gewinn erzielt. Umsatztreiber war der KIBoom. Mit einem Fokus auf Künstliche Intelligenz und mehr Managed Services soll auch der Mobile-Bereich im laufenden Jahr stärker von KI profitieren. | Margrit Lingner

Mit einem Fokus auf das Lösungsgeschäft und Managed Services soll im laufenden Jahr auch der Bereich Mobile Experience (B2B) stärker vom KI-Boom profitieren. Wie das aussehen kann, haben die über 200 Partner auf der Partnerkonferenz in Düsseldorf erfahren. Samsung hat im letzten Quartal 2025 mit 93,8 Billionen Won (ca. 54 Milliarden Euro) den höchsten jemals in einem Quartal erzielten konsolidierten Umsatz eingefahren. Das liegt vor allem am Halbleitergeschäft. Durch den starken Wettbewerb auf dem Smartphone-Markt musste der Device-Experience-Bereich einen Umsatzrückgang von 8 Prozent im Vergleich zum Vorquartal hinnehmen. Dennoch ist das Jahr 2025 gut gelaufen, verkündet Tuncay Sandikci, Director MX B2B bei Samsung.

Die größten Wachstumschancen liegen im Lösungsgeschäft mit SamsungKnox-Lösungen und Services, auf das wir gemeinsam mit Systemhäusern und Resellern setzen.

In einem schwierigen Umfeld ist der Smartphone-Umsatz bei Samsung Deutschland leicht gewachsen. Der Tablet-Markt ist stabil geblieben, aber die Aussichten für 2026 bleiben verhalten. Dafür hätten die mit Partnern realisierten Projekte zugenommen, bekräftigt Sandikci. Dabei helfe gerade bei Unternehmenskunden das kürzlich vom BSI verliehene IT-Sicherheitskennzeichen. Es schaffe Transparenz und ermögliche es auch Endkunden, sich über die erfüllten Sicherheitsanforderungen zu informieren. Wichtig sei ferner die in Zusammenarbeit mit Nexus und dem BSI entwickelte Sicherheitslösung Samsung Knox Native. Die hardwarebasierte Lösung ermöglicht Behörden und Unternehmen eine geschützte mobile Kommunikation.

„Die größten Wachstumschancen liegen im Lösungsgeschäft mit Samsung-KnoxLösungen und Services, auf das wir gemeinsam mit Systemhäusern und Resellern setzen. Jetzt heißt es durchstarten. Unsere Technologieplattform ist offen für branchenspezifische Anwendungen und lässt sich an die jeweiligen Kundenanforderungen anpassen – ob Großunternehmen, Betrieb oder Behörde,“ erklärt der Mobile-Chef. Innovationen und neue Produkte sind ein weiterer wichtiger Schritt zu mehr Produktivität und einer einfacheren und intuitiveren Interaktion mit mobilen Geräten. Wohin die Reise geht, wird auch die neue Generation der Galaxy-S26-Reihe zeigen. Sicher ist: KI wird dabei eine größere Rolle spielen. Mit der Weiterentwicklung steige auch das Interesse von Geschäftskunden an KI-gestützten Smartphones. Schließlich

beschleunigen sie Arbeitsabläufe und schützen sensible Unternehmensdaten. Zur Stärkung der Marktpräsenz hat Samsung ein neues Vertriebsteam für den Mittelstand aufgestellt. Es soll für die Kundenakquise und Betreuung verantwortlich sein. Verteilt nach Regionen sind sie näher an den Kunden und sollen gemeinsam mit Partnern das Business mit den Managed Services ausbauen. „Die Nachfrage nach Managed Services im B2B-Umfeld ist hoch – denn vielen kleinen und mittleren Unternehmen fehlen die nötigen IT-Ressourcen und das entsprechende Knowhow, um ihre mobilen Geräte zu verwalten und zu überwachen“, weiß Sandikci. „Mit unserem etablierten Samsung-Knox-Programm für MSP bieten wir bereits heute eine leistungsfähige Plattform“. Ziel sei es aber, das MSP-Netzwerk weiter auszubauen.

Der Weg dahin sei jedoch kein Sprint, sondern eher ein Marathon, glaubt Michael Vorberger, Director MX B2B Open Market Sales bei Samsung. Geschäftspotenzial sieht Vorberger dabei aber durchaus. Gut aufgestellt sei Samsung dabei gerade, weil passende Endgeräte mit Lösungen kombiniert werden können. Für den steigenden Bedarf mobiler Datenerfassung, etwa bei Frontline-Workern in Gesundheitswesen, Einzelhandel oder Logistik hat Samsung taffe Smartphones und Tablets im Portfolio. Dazugehörige Lösungen können mit Partnern entwickelt und ausgerollt werden. Auch Device as a Service (DaaS) wird für Business-Kunden attraktiver. Sie können der Schlüssel für eine langfristige Kundenbindung sein – und die Digitalisierung in mittelständischen Unternehmen vorantreiben. n

Nikolas Schran ist bei G Data Cyberdefense zurück und bringt grundlegende Veränderungen mit: Das Direktgeschäft wird eingestampft, Channel First wird aktiv vorangetrieben. Im Gespräch mit IT-BUSINESS erklärt er, welche Schritte jetzt notwendig sind. | Natalie Forell

Wir müssen dem Partner die Hilfestellung geben, die er braucht.

Seit Oktober 2025 ist Nikolas Schran bei G Data Cyberdefense als Vice President Sales & Marketing zurück. Drei Jahre Abwesenheit haben ihm eine frische Sicht auf das Bochumer Unternehmen verschafft und seine Diagnose ist eindeutig: „Wir haben viel mehr zu bieten. Wir müssen das Thema Channel noch mehr in die Pflicht nehmen.“ Die Konsequenz: In den kommenden Monaten gibt es ein neues Partnerprogramm. Gefolgt von einem neuen XDRProdukt im Juni.

Das aktuelle Partnerprogramm stammt aus dem Jahr 2017 und das kann eine kleine Ewigkeit in der ITWelt sein. Damals war von Security Operations Center noch keine Rede, Managed Security Services steckten in den Kinderschuhen. Heute übernehmen Partner andere Aufgaben, sind tief in die ITStrategie ihrer Kunden eingebunden

und agieren als strategische Berater. „Unser bisheriges Partnerprogramm wird diesen Anforderungen nicht gerecht“, schlussfolgert Schran.

Das neue Programm setzt auf Channel First. Als Grundidee verfolgt Schran den Ansatz, dass keiner den Kunden besser kennt als die Partner selbst. Während die Partner den perfekten Zeitpunkt für eine Implementierung kennen, kennt G Data die Produkte in- und auswendig und kann diese gemeinsam mit dem Dienstleister präsentieren. Hier hakt es aktuell aber noch, wie Schran durchblicken lässt. Die Kommunikation läuft nicht reibungslos, Partner fragen skeptisch: Warum soll jetzt die Zusammenarbeit plötzlich besser werden? Schran gibt zu: „Diese Frage beantworten wir bisher nicht gut genug.“

Schran will das Partnerprogramm bewusst flexibel gestalten. Statt eines One-Size-FitsAll-Modells soll das neue Programm angepasste Partnerstufen enthalten. Partner haben sich gewandelt. Früher lieferten sie Monitore, Maus und Software, während sie heute strategischer Unterstützer sind. Hier müsse man als G Data noch „nachschärfen“, betont Schran. „Deshalb müssen wir auch entsprechend der verschiedenen Produkte ganz klar kategorisieren. Wir müssen dem Partner die Hilfestellung geben, die er braucht.“

kommenden Monaten eine bessere Beziehung und bessere Kommunikation aufgebaut werden. Dabei wird auch über mögliche Marketplace-Partner nachgedacht, wie er verrät. Beim Thema Distribution hält sich der Hersteller allerdings weiterhin zurück, da dies aktuell kein „gangbarer Weg“ in Deutschland sei.

Das neue Programm soll deshalb schwarz auf weiß festhalten, dass G Data mit Partnern zusammenarbeitet, nie an ihnen vorbei. „Das war auch früher schon der Fall“, so Schran. „Wir hatten traditionell aber schon immer sehr viele Direktkunden. Wir haben auch Kunden, die als Consumer im Online-Shop angefangen und sich dann hochgearbeitet haben. Trotzdem sagen wir jetzt ganz klar, dass unser Commitment zum Channel viel stärker geworden ist.“

Um die neue Strategie umzusetzen, stockt G Data gezielt das Personal auf. Das bereits bestehende Partnerteam wird dediziert erweitert. Beispielsweise wird es MarketingMitarbeiter geben, die explizit Partner unterstützen. „Wenn ein Partner von sich aus sagt, ich bin bereit, eine Kundenveranstaltung zu machen, dann braucht er auch

unseren Support, wenn wir das Thema mittragen sollen. Sei es beim Einladungsmanagement oder bei anderen Aufgaben“, sagt Schran. Das seien dann meist „simplifizierte Themen“, sodass sich der Partner weiterhin auf das Kerngeschäft fokussieren kann.

Dabei verfolgt Schran ein ehrgeiziges Ziel: bei allen 5.000 Partnern soll in den

Trotz der ambitionierten Ziele, zeigt Schran sich zuversichtlich: „Ich glaube, dass es nie eine bessere Zeit gab, bei G Data zu sein.“ Der Grund dafür liegt unter anderem an der veränderten Weltlage. Geopolitische Spannungen verschärfen sich und mehr Unternehmen rufen nach Digitaler Souveränität. G Data profitiert von einem Kernversprechen: „Für den Kunden ist wichtig, dass die Menschen, die Zugriff auf seine Daten haben, in Deutschland sitzen und nirgendwo anders. Es ist also wichtig, dass die Daten, die wir haben, einzig in Deutschland verarbeitet werden“, fasst Schran zusammen. Laut ihm sollte Europa unabhängiger mit sensiblen Daten umgehen. Dafür wäre es grundlegend, sich von amerikanischen Produkten loszulösen. „Das wird aber nicht von heute auf morgen gelingen“, weiß Schran. „Wir müssen aber zumindest loslaufen: Jeden Tag, an dem wir es nicht tun, das ist ein verlorener Tag.“

Die Veränderungen verfolgen ein klares Ziel: „Wir haben viele tolle Partner. Wir machen nur nicht mit allen den richtigen Umsatz.“ Bei guten 5.000 Partnern reicht die Palette von kleinen Dienstleistern, die eine Anwaltskanzlei betreuen, bis hin zu großen Dienstleistern wie Bechtle. Das Problem liege woanders, wie Schran offen zugibt: „Wir haben die Partnerlandschaft manchmal nicht gut genug behandelt und sie häufig allein gelassen.“ Anstatt die Landschaft also zu erweitern, soll der Umsatz pro Partner spürbar steigen und das nicht durch höhere Preise, sondern durch gemeinsam gewonnene Neukunden. G Data und die Partner sollen künftig als Einheit auftreten und gemeinsam die steigende Nachfrage nach Digitaler Souveränität bedienen.

Die Marktbedingungen sind ideal. Das Bochumer Unternehmen muss nur zeigen, dass es diese Gelegenheit auch ergreift. n

Die Cybersicherheit des eigenen Unternehmens hat inzwischen wohl fast jeder auf dem Schirm. Aber wie sieht es mit der Lieferkette aus? Während die physische Sicherheit oft im Fokus steht, erweisen sich digitale Vernetzung und Software als kritische Einfallstore. | Ira Zahorsky

Checkliste für Unternehmen zur Lieferkettensicherheit

Verantwortlichkeiten festlegen

Scope und Lieferanteninventar

Risikoanalyse und Due Diligence

Sicherheitsanforderungen in Verträgen

Onboarding und Offboarding

Technische Mindestkontrollen für Anbindungen

Kontinuierliche Überwachung

Notfallmanagement und Meldewege

Dokumentation und Nachweisführung

Umsetzungsfahrplan und Schulung

Die Cybersicherheit in der Lieferkette ist eines der drängendsten Themen für Unternehmen. Laut einer Umfrage der NonprofitOrganisation ISC2 sind 70 Prozent der Organisationen „sehr oder extrem besorgt“ über Sicherheitsrisiken durch Drittanbieter. 28 Prozent der Befragten haben in den letzten zwei Jahren einen Cybersicherheitsvorfall erlebt, der von einem Drittanbieter ausging. Im Bereich der Software-Lieferkette betraf es dem IT-Security-Anbieter Armis zufolge deutlich mehr Unternehmen: 84 Prozent in den vergangenen 12 Monaten.

Die Folgen von Angriffen über die Lieferkette sind dieselben, die auch ein direkter Angriff auf das Unternehmen hat, und damit genauso wenig vernachlässigbar. Neben finanziellen Verlusten zählen Betriebs- und Produktionsausfälle bis zur Wiederherstellung, kompromittierte Daten, der Verlust geistigen Eigentums sowie von Kunden, Partnern und deren Vertrauen zu den größten Schäden.

Für Unternehmen ist also nicht nur die Sicherheit der physischen Lieferkette enorm wichtig, sondern auch die der digitalen. Eine abgesicherte Lieferkette bietet mehr Resilienz und erhöht den Schutz sensibler Daten und Systeme und damit auch das Vertrauen in Produkte und Anbieter. Das hat auch die deutsche Regierung erkannt und entsprechende

Die Lieferkette hat oft schwache Glieder und ist deshalb ein beliebtes Ziel für Cyberangriffe.

Einer Umfrage von Sophos zufolge hängt die Gefahr durch Cyberbedrohungen nicht allein von der unternehmenseigenen Sicherheitsstrategie ab, sondern zu einem erheblichen Teil auch von der der Geschäftspartner.

Punkte in Richtlinien und Gesetze mit aufgenommen. Das Ende letzten Jahres in Kraft getretene NIS2-Umsetzungsgesetz (NIS2UmsuCG) enthält ebenso wie der Cyber Resilience Act (CRA) und das KRITIS -Dachgesetz erweiterte Vorgaben zur Lieferkettensicherheit.

Die rechtlichen Vorschriften geben einen Rahmen, doch decken sie nicht die zahlreichen Herausforderungen bei der Sicherheit gegen Cyberbedrohungen in der Lieferkette ab. Dazu zählen:

z Mangel an Informationen über das Risiko, das ein oder mehrere Zulieferer darstellen.

z Mangel an Transparenz oder Kontrolle der Lieferanten

z Komplexität der Lieferketten: Betroffene kennen weder die Lieferanten ihrer Lieferanten noch alle möglichen Einstiegspunkte.

z Insider-Bedrohungen durch externe Dienstleister

z Open-Source-Software

Es gibt zahlreiche Ansätze zur Umsetzung der Lieferkettensicherheit. Wichtig ist es, nicht an einzelnen Punkten „herumzudoktorn“, sondern ein ganzheitliches, für das Unternehmen passende Konzept zu entwickeln. Zunächst gilt es, die verantwortlichen Personen für die Cybersicherheit der Lieferkette festzulegen. In der Regel ist das der CISO. Anschließend sollte ein vollständiges Register aller Drittparteien (Lieferanten, IT-Dienstleister, Cloud,

Open Source, Freelancer) erstellt und deren Kritikalität, Zugriffsrechte, Datenarten, Standorte/Subunternehmer und Abhängigkeiten erfasst werden. Mit einem standardisierten Fragekatalog wie der BSI-Grundschutz-Checkliste kann man den Risiko-Score für jeden Lieferanten ermitteln. In diesem Schritt sollten auch Nachweise von den Lieferanten, beispielsweise ISO 27001, eingefordert werden. In Verträge müssen Sicherheitsanforderungen aufgenommen werden. Dazu zählen Sicherheits-SLAs (Service Level Agreements), Incident-Meldung, Prüf- und Auditrechte, Subunternehmer-Freigabe und Datentilgung bei Vertragsende. Für Software und Produkte müssen die SBOM-Bereitstellung, sichere Update-Prozesse und Vulnerability Disclosure geregelt werden. Neben einem kontrollierten und dokumentierten On- und Offboarding eines Lieferanten gehören auch technische Mindestkontrollen für Anbindungen wie Netzwerksegmentierung, API- und Schnittstellenschutz sowie Absicherungen für die Cloud zum Pflichtprogramm. Schließlich sollten sich die Lieferanten regelmäßigen Reviews unterziehen, sie auf Schwachstellen überprüfen, ein gemeinsames Notfallmanagement inklusive Playbooks erstellen und Ernstfallübungen durchführen. Um den Umsetzungsfahrplan komplett zu machen, stehen noch die Punkte Dokumentation und Nachweisführung sowie Schulungen aller Unternehmensmitarbeiter auf der Agenda. n

Plusserver richtet sich mit einer neuen Management-Aufstellung auf die nächste Entwicklungsphase aus. Am 1. März 2026 wird Dr. Marc Wilczek neuer Geschäftsführer. Er verfügt über mehr als 20 Jahre Erfahrung in der IT- und Technologiebranche und hat Unternehmen in unterschiedlichen Führungsrollen durch Wachstum und Transformationen geführt. Aktuell ist er als Chief Commercial Officer noch beim IT-Dienstleister Controlware tätig. „Plusserver verbindet ein starkes technologisches Fundament mit klarer Positionierung: souveräne Cloud- und Hosting-Lösungen aus Deutschland, betrieben mit operativer Exzellenz“, betont Wilczek die Positionierung von Plusserver. „Gemeinsam mit dem Team wollen wir diese Stärken weiter ausbauen und gezielt in nachhaltiges Wachstum übersetzen.“

Die Stärkung des Führungsteams folgt auf

eine Phase der Stabilisierung und Neuausrichtung des Unternehmens. „Plusserver hat in den vergangenen Jahren wichtige Grundlagen geschaffen: Strukturen wurden gestärkt, Verantwortlichkeiten klar definiert und die Organisation insgesamt zukunftsfähig aufgestellt“, blickt Thomas Vollrath, Vorsitzender des Aufsichtsrats, zurück. Diese Phase habe der bisherige CEO Andreas Kadler maßgeblich mitgestaltet, für dessen Einsatz sich Aufsichtsratsmitglied Thomas Noglik bedankt. Gleichzeitig ist Noglik überzeugt, „mit Dr. Marc Wilczek einen CEO gewonnen zu haben, der Wachstum, Marktverständnis und Führungserfahrung vereint.“

Parallel zur CEO-Neubesetzung verstärkt Plusserver das Management-Team mit Friedrich Haarmann als Chief Product Officer (CPO). Er kehrt zu Plusserver zurück und übernimmt die Verantwortung für Portfolio- und Produktstrategie. Haar-

Veeam hat die Ernennung von Armin Müller zum Regional Vice President für Mitteleuropa bekannt gegeben. In seiner neuen Position soll Müller die Geschäfte von Veeam in Zentraleuropa leiten und Unternehmen dabei helfen, robusten Datenschutz, Sicherheit und Business Continuity zu erreichen. Müller verfügt über mehr als 30 Jahre Erfahrung in den Bereichen Unternehmenssoftware, Cloud und Channel Leadership.

Vor seiner Zeit bei Broadcom bekleidete er die Rolle des Vice President, Central EMEA (CEMEA) bei VMware, und war dort für das regionale Wachstum und die

Transformation verantwortlich. Davor war er als VP & Country Manager für Deutschland bei VMware verantwortlich und soll dort einen maßgeblichen Anteil an der Cloud-Einführung und dem dortigen Kundenerfolg gehabt haben Müller war außerdem sechs Jahre bei Oracle als Regional Vice President, Cloud Systems North und VP Hardware Sales Northern Europe tätig. Zuvor war er in leitenden Positionen bei T-Systems International und bei IBM, wo er über zwei Jahrzehnte lang die Vertriebsstrategie und das Kundenengagement in Europa gestaltete. | ap

mann war bereits zuvor – von 2013 bis 2016 – beim Cloud Provider tätig. Gemeinsam mit Raphael Bächle (CFO), Peter Höhn (CCO) und Tobias Meier (COO) bilden die beiden Neuzugänge das neue Führungsteam. | md

Lutz Hirsch zieht sich zurück

Dr. René Sternberg, zuvor Director Service Delivery, steigt bei Hirschtec auf und bildet seit 14. Januar 2026 zusammen mit Jochen Sperber und Khaled Thaler die operative Geschäftsführung von Hirschtec. Lutz Hirsch, Gründer und Inhaber, zieht sich derweil aus dem operativen Geschäft zurück. Er konzentriert sich auf seine Rolle als Eigentümer und fokussiert sich – zusammen mit der Geschäftsführung – auf die strategische Ausrichtung und die Unternehmensplanung beim Service Provider für den Digital Workplace. Sternberg verantwortet damit die Geschäftsbereiche Service Delivery und People & Culture, Sperber die Finance und Corporate IT und Thaler den Sales, das Marketing und die Kommunikation. | ap

Die ifm Unternehmensgruppe setzt für hybride Meetings auf ClickShare Videokonferenzsysteme von Barco. Im Fokus stehen einfache Bedienung, zuverlässige Technik und optimale Präsentationsqualität. Lieferung, Installation und Service übernimmt Integrator DataVision.

Mit über 165.000 Kunden, Vertrieb in 145 Ländern und Standorten in 50 Staaten spielt effiziente Kommunikation für ifm eine zentrale Rolle. Ob Projektbesprechungen, internationale Meetings oder Home Office Teilnahmen –hybride Formate verbinden persönliche Interaktion mit digitaler Flexibilität und ermöglichen einen starken Wissensaustausch.

Moderne Audio und Videotechnik bildet dabei die Basis. „Je besser die Technik, desto größer ist der Erfolg. Seit 2017 vertrauen wir auf die extrem einfach bedienbare Lösung ClickShare von Barco, die man wirklich als Marktbereiter bezeichnen kann“, stellt Hendrik Lutens fest, der bei ifm den Bereich IT Backend Services und Unified Communication verantwortet. „Mit ClickShare fühlen sich Remote-Teilnehmer fast so, als seien sie vor Ort und es gehen keine Informationen verloren,“ ergänzt Joachim Hopp, der sich an den ifm-Standorten in der Bodenseeregion um die Audio- und Videokonferenztechnik kümmert.

Der Meeting-Start erfolgt innerhalb von Sekunden: Notebook anschließen, ClickShare Button drücken – fertig. Der robuste USB Dongle verbindet automatisch Kameras, Mikrofone, Lautsprecher

und Displays, unabhängig von der genutzten Plattform. „Noch einfacher geht es für den Nutzer wirklich nicht“, ist Lutens tief überzeugt.

Seit 2020 ist DataVision fester Partner für Planung, Lieferung und Installation. Durch die Zugehörigkeit zum Ricoh Konzern bietet das Unternehmen weltweiten Service. „Wir arbeiten sehr gerne und eng mit DataVision zusammen – es gibt feste wöchentliche Termine und unsere dortigen Ansprechpartner sind quasi ein Teil unseres Teams,“ berichtet Hopp. Allein am Standort Essen wurden bereits 50 Meetingräume umgesetzt; langfristig soll ClickShare an sämtlichen 72 ifm-Standorten weltweit Standard werden.

Neben dem CX 50 nutzt ifm auch die drahtlosen ClickShare Videobars mit integrierter Kamera, Lautsprechern und Mikrofon. Derzeit sind 45 Videobars, über 200 CX 50 sowie weitere CX 30 im Einsatz. Die Verwaltung erfolgt zentral über die XMS Cloud Plattform, die Konfiguration,

Fehlerdiagnose und Nutzungsanalysen ermöglicht. Sicherheit besitzt höchste Priorität: Die interne Securityabteilung prüft alle Geräte umfassend. ClickShare steht auf der offiziellen White List zugelassener Netzwerkgeräte.

Auch der neue ClickShare Hub Pro wird diesen Prozess durchlaufen. „Wir gehen sämtliche Entwicklungen von ClickShare mit. Jeder innovative Zugang zu hybriden Meetings mit einem perfekten Präsentations-Erlebnis ist ein Gewinn für unser Unternehmen,“ erklärt Lutens.

Ein Gewinn, der sich in der Zufriedenheit der Teilnehmer und im minimierten Reiseaufwand ausdrücken lässt. „Wir erheben zwar keine Zahlen, aber unserem Budget für das Einrichten und Verbessern der weltweiten Konferenz- und MeetingRäume stehen hohe Einsparungen bei den Hotel- und Fahrkosten gegenüber“, ist sich Lutens sicher.

Memorysolution hat die Unternehmensführung neu strukturiert. Künftig übernimmt das Dreierteam Gerald Diercks, Ulf Kilper und Maximilian Jaud die Leitung des Unternehmens und damit die Verantwortung für die strategische und operative Ausrichtung. Der langjährige Gesellschafter Ralf Thoma wurde im Rahmen der Änderungen zum Prokuristen bestellt. Er hat die Entwicklung von Memorysolution seit über 25 Jahren mitgestaltet.

Gerald Diercks gründete Memorysolution 1997 und entwickelte das Unternehmen zu einem national etablierten Spezialisten für Enterprise- und DatacenterSpeicherlösungen. In der neuen Führungsstruktur bleibt er als Managing Director mit Fokus auf Strategie und Finanzen verantwortlich und begleitet die langfristige Entwicklung weiterhin aktiv. Ulf Kilper obliegt als Director

Operations & Procurement die operative Gesamtverantwortung. Er bringt langjährige Erfahrung im internationalen Einkauf sowie im Produkt- und Lieferantenmanagement mit. Maximilian Jaud übernimmt als Director Strategy & Commercial Development die kommerzielle und strukturelle Weiterentwicklung und soll das Marketing, den Vertrieb und die Organisationsentwicklung von Memorysolution stärken.

Mit dem erweiterten Führungsteam zielt Memorysolution darauf ab, die Marktpräsenz in der DACH-Region weiter auszubauen und möchte seine Rolle als Technologiepartner in der Distribution von Enterprise- und DatacenterSpeichern, in der Versorgung industrieller Anwendungen mit ICs sowie in der Entwicklung individuell konfigurierter Serverlösungen stärken. | md

Der Vorstandsvorsitzende Markus Hendrich tritt nach mehr als fünf Jahren im Vorstand von Ecotel zurück, um sich persönlich zu verändern. Hendrich scheidet damit noch vor Ende seines im August 2026 auslaufenden Vertrags vorzeitig aus dem Unternehmen aus. Während seiner Amtszeit als CEO hat Hendrich den TK-Anbieter durch die Transformation zur nächsten Wachstumsphase geführt und einen Generationswechsel im Unternehmen vollzogen. Er bleibe dem Unternehmen verbunden und werde in der Übergangsphase noch beratend zur Seite stehen.

Bis ein geeigneter Nachfolger für die Unternehmensführung gefunden wird, hat der Aufsichtsrat beschlossen, Peter Zils, stellvertretender Vorsitzender des Aufsichtsrats, zum CEO zu ernennen. Zils ist Gründer der Gesellschaft und war vor seinem Wechsel in den Aufsichtsrat im April 2023 lange Jahre Vorstandsvorsitzender bzw. Co-Vorstandsvorsitzender der Gesellschaft. Die Ecotel-Führung ist überzeugt, dass mit Zils als Interims-CEO auch langfristige Zukunftsentscheidungen nicht verlangsamt würden und Ecotel auf Erfolgskurs bleiben wird. | ml

Das Führungsteam von Memorysolution: (vorne v. l.) Gerald Diercks, Ulf Kilper sowie (hinten v. l.) Maximilian Jaud und Ralf Thoma

Dirk Decker soll bei Forescout als Regional Director für Zentraleuropa Unternehmen dabei unterstützen, die wachsenden Herausforderungen in den Bereichen Asset-Transparenz, Risikomanagement und Zero Trust in komplexen hybriden und operativen Umgebungen zu bewältigen. „Der Ansatz von Forescout zur Absicherung von IT-, OT-, IoT- und IoMT-Umgebungen bietet eine starke Grundlage für moderne Zero-Trust-Strategien, während europäische Organisationen mit einer beispiellosen Komplexität konfrontiert sind“, so Decker. Der neue Regional Director bringt 15 Jahre Erfahrung mit, zuletzt war er Regional Sales Director DACH bei Ping Identity. Auch McAfee und Intel zählen zu seinen bisherigen Arbeitgebern. | iz

Seit Anfang des Jahres tritt die IT-Gruppe, bestehend aus Sälker IT Solutions, MDSI IT Solutions, RF Computer, Venabo und Pramux unter dem gemeinsamen Namen Emvion auf. Mit über 160 Mitarbeitern an drei Standorten vereint die Gruppe Kompetenzen in Managed Services und Softwareentwicklung. Mit dem gemeinsamen Auftritt und dem Brand möchte die Gruppe die Grundlage für weiteres Wachstum schaffen. Der gemeinsame Name ist Ergebnis eines langfristigen Integrationsprozesses. „Jetzt ist die Zeit reif, diese Einheit auch nach außen zu tragen“, sagt Emvion-Geschäftsführer Daniel Knüwer. Kunden und Partner würden von einem Namen, Ansprechpartner und Zugang zu Ressourcen der gesamten Gruppe profitieren.

Emvion reagiert damit auf die komplexer werdenden IT-Anforderungen im Mittel-

stand. Denn wenn individuelle Softwareanpassungen oder tiefe Prozessintegrationen nötig sind, stoßen klassische Systemhäuser oft an Grenzen. Emvion löst diese Silos auf. Das Portfolio vereint zwei Bereiche. Zum einen IT-Infrastruktur & Security: Hier verspricht das Knowhow der SystemhausSpezialisten (ehemals Sälker IT Solutions und RF Computer) stabile Basis-IT, CloudLösungen, Managed Services und IT-Security. Der zweite Bereich ist Software und Prozesse. Durch die Integration der Software-Unternehmen (Venabo, Pramux,

Mit NextWave startet Palo Alto ein neues Partnerprogramm. Es ist auf KI-gestützte Sicherheit ausgerichtet und soll es Partnern erlauben, profitable Sicherheitslösungen anbieten zu können. Im Fokus steht ein weiterentwickelter Ansatz, der auf „Platformization“ setzt und technische Expertise sowie Serviceleistungen belohnt.

Zudem werde Komplexität reduziert, da Partner die Sicherheitsarchitektur ihrer Kunden über Netzwerk, Cloud und SOC hinweg integrieren können. So entstehen laut Palo Alto neue, margenstarke Chancen im Servicesegment.

NextWave steht Partnern ab sofort zur Verfügung. Es konzentriert sich auf die drei transformative Vorteile: Verbesserung der Partnermargen, Beschleunigung der Geschäftsabschlüsse und Reinvestition für Wachstum. So belohne etwa „Platformization“ technische Expertise und maximiere somit die Profitabilität. Zudem sollen optimierte Service-Tools Reibungsverluste reduzieren und die Abschlusszeiten verkürzen. Und der Development Fund (PDF) investiert erworbene Rückvergütungen beispielsweise in Schulungen oder Lösungsentwicklung. | ml

Mit dem gemeinsamen Namen bündelt Emvion verschiedene Kompetenzen unter einem Dach.

MDSI IT Solutions) bietet Emvion Lösungen für ERP, KI, Zeiterfassung, Smart Mobility sowie individuelle Softwareentwicklung. Die Gruppe stellt somit nicht nur IT-Systeme bereit, sondern beschäftigt sich auch mit den dahinterliegenden Prozessen. Die Neuaufstellung sei eine strategische Weichenstellung für die Zukunft. Knüwer erklärt: „Wir haben uns so aufgestellt, dass wir weiterwachsen können – sowohl organisch als auch anorganisch.“ | md

Check Point: vier Säulen und drei Übernahmen

Check Point hat eine Vier-Säulen-Strategie entwickelt, um Unternehmen sicher durch die KI-Transformation zu führen. Die Strategie wird durch drei Akquisitionen unterstützt und zielt darauf ab, eine einheitliche, präventionsorientierte Sicherheitsplattform zu schaffen. Die Säulen umfassen: Hybrid Mesh Network Security, Workspace Security, Exposure Management und KI-Sicherheit. Zu diesem Zweck hat der Cybersecurity-Anbieter die Unternehmen Cyata, Cyclops Security und Rotate übernommen. Cyata fokussiert sich auf das Identitätsmanagement von KI-Agenten, Cyclops Security auf die Priorisierung von Cyber-Assets und Rotate auf den zentralen Schutz in SaaSUmgebungen für MSP. | md

Seit der Corona-Pandemie geht’s aufwärts im UCC-Markt, angetrieben durch hybrides Arbeiten und neuerdings KI. Tendenz 2026: Weiteres Wachstum sehr wahrscheinlich. Immer stärker nachgefragt werden dabei UC-Lösungen aus und für Europa. | Mihriban Dincel und Margrit Lingner

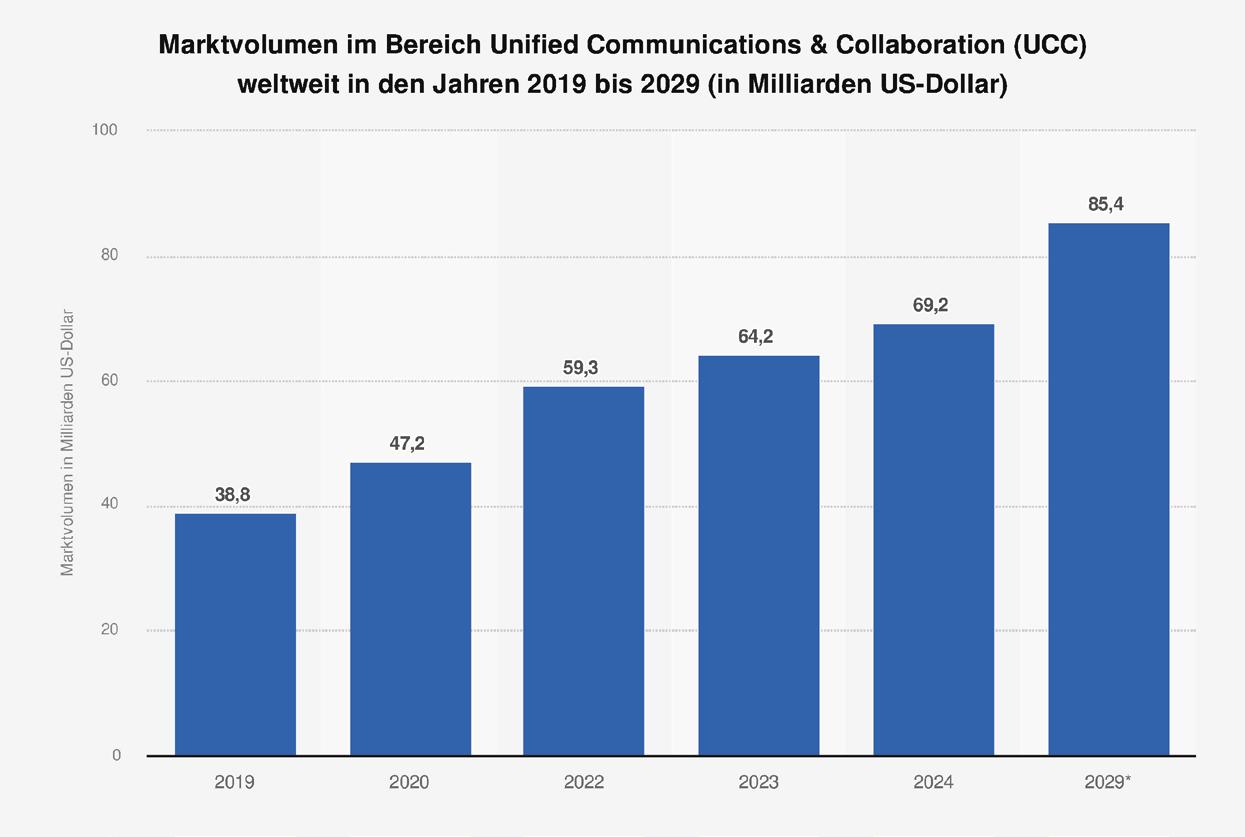

KI ist in der Unternehmenskommunikation angekommen. In Arztpraxen und vielen Call und Contactcentern haben Chatbots den Telefondienst übernommen und erledigen Terminabsprachen. KIgestützte Tools und Lösungen haben das Zeug, die Geschäftskommunikation durch Automatisierung, Effizienzsteigerung, bessere Erreichbarkeit und optimierte Benutzererfahrung umzukrempeln. Wegen der steigenden Nachfrage nach KITools gehen die Analysten von IDC davon aus, dass das Marktvolumen im UCCMarkt weltweit bis 2029 auf 85,4 Milliarden US Dollar steigen wird. Allerdings gewinnt in Deutschland und Europa „die Diskussion um Digitale Souveränität 2026 weiter an Bedeutung“, ist Dr. Ralf Ebbinghaus, Geschäftsführer von Enreach,

überzeugt. Zunehmende Regulierungen und geopolitische Unsicherheiten führen dazu, dass immer mehr Unternehmen „europäische Alternativen zu globalen Technologieanbietern“ suchen. Schließlich gelten Abhängigkeiten von US oder asiatischen Herstellern auch laut Harald Josef Ollinger, Vice President Marketing & Communications bei Komsa, als Risiko. Unternehmen und öffentliche Auftraggeber wollen heute „zunehmend kontrollierbare, vertrauenswürdige, europäische oder souveräne ITLösungen“. Beherrscht wird der Markt derzeit allerdings von TechRiesen wie Microsoft, Cisco und Zoom. Doch zeigen UCAnbieter hierzulande, wie KIAgenten wie Wilma, Nia oder Shomi Arbeitsabläufe in der Unternehmenskommunikation verbessern können.

Jürgen Walch, Teamlead Category Management Unified Communication bei Herweck, ist der Ansicht: „Gerade bei UCCPlattformen, die Sprach, Video, Chat und mittlerweile auch KI gestützte Funktionen bündeln, ist das Thema hochsensibel. Entsprechend steigt die Nachfrage nach DSGVO konformen, transparenten und kontrollierbaren UCCArchitekturen.“ Der Grund: Im UCCUmfeld werden viele sensible Daten übertragen und gespeichert. Damit geht ein erhöhtes Risiko für potenzielle Datenausspähung einher, weiß Ollinger. Ähnlicher Ansicht ist auch Christoph Scheuermann, Geschäftsführer bei Starface. „Europäischsouveräne UCC

Unternehmen

wollen Tech-

nologien, die Effizienz, Erreichbarkeit und Kundenbindung verbessern, ohne die Kontrolle über Daten und Prozesse aus der Hand zu geben.

Dr. Ralf Ebbinghaus, Geschäftsführer von Enreach

Dienste müssen konsequent in der EU gehostet werden, datenschutzkonforme KI-Modelle implementieren und ein Höchstmaß an Transparenz über die Infrastruktur liefern.“ Er betont: „Sensible Inhalte wie Transkriptionen dürfen ausschließlich im europäischen Rechtsraum verarbeitet und nicht dauerhaft gespeichert werden“.

„Viele KI-Funktionen basieren auf Modellen, die außerhalb Europas trainiert wurden. Das wird zunehmend kritisch hinterfragt“, nennt Walch einen Punkt. Auswegslos ist die Lage nicht. „Die EU arbeitet an verschiedenen Rahmen wie etwa ‚Made in Europe‘. Diese beeinflussen massiv, wie UCC- und KI-Dienste betrieben werden sollen“, macht er Mut. Dabei ist laut Ollinger entscheidend, dass souveräne Lösungen drei Hoheiten erfüllen: Datenhoheit (Kontrolle über Speicherort, Zugriff und rechtliche Grundlagen), Technologiehoheit (Nutzung

europäischer Technologien zur Reduktion von Abhängigkeiten) und Betriebshoheit (Betrieb durch europäische Partner unter EU-Regularien).

Walch spricht von einem ganzheitlichen Souveränitätskonzept, das neben Rechenzentren in der EU eine Unabhängigkeit von außereuropäischen Hyperscalern oder zumindest eine klare technische und vertragliche Abschottung, kundenseitig kontrollierte Schlüssel, Transparenz und Auditierbarkeit sowie offene Standards und APIs beinhaltet. „Hersteller wie AlcatelLucent (ALE) positionieren sich als europäischer Anbieter für Kommunikations- und Netzwerktechnik, der Datenschutz, Compliance und Unabhängigkeit in den Mittelpunkt stellt“, gibt Olliger ein Positivbeispiel wieder.

Zoom betreibt als amerikanischer UC-Anbieter dedizierte Datencluster in Frankfurt und Amsterdam, um auf die speziellen Anforderungen der Kunden eingehen zu können. Dabei arbeitet Zoom mit der Telekom zusammen. Mit Zoom Node gibt es zudem die Möglichkeit, Zoom-Services auf kundeneigenen Servern zu installieren und zu betreiben. So lassen sich beispielsweise Meetings im eigenen Netz abhalten und aufzeichnen. Zudem versichern die Amerikaner, dass Kundendaten, egal ob aus Meetings oder anderer Quelle, nicht zum Training für KI-Modelle genutzt würden.

Auch wenn Zoom-Lösungen oder Microsoft Teams in deutschen Unternehmen weit verbreitet sind, gibt es dennoch ernstzunehmende souveräne Alternativen. Ollinger nennt beispielsweise Rainbow von ALE. „Dies ist eine europäische, souveräne UCaaS/CPaaS-Plattform – konzipiert für Datenschutz, Verschlüsselung und sichere Kommunikation.“ Auch Anbieter wie Enreach, Nfon, die Gamma-Gruppe und Wildix entwickeln, betreiben und hosten ihre UC-Lösungen in Deutschland oder

Europa und verschreiben sich der DSGVO. So betont etwa Starface-Chef Scheuermann, dass „die KI-Modelle ausschließlich in der EU betrieben und DSGVO-konform eingesetzt werden“. Zudem bieten „die Lösungen sowohl in rechtlicher als auch in technischer Hinsicht ein hohes Maß an Sicherheit und Compliance.“

So bekräftigt auch der Enreach-CEO, dass sein Unternehmen „in Europa verwurzelt ist und Lösungen anbietet, die in Europa entwickelt und betrieben werden“. Die langjährige Kenntnis europäischer Märkte, die EU-basierte Infrastruktur und der lokale Support biete Partnern und Unternehmenskunden „maximale Transparenz, Datenhoheit und reduzierte Abhängigkeit von außereuropäischen Plattformen“. Jedenfalls ist Walch überzeugt, dass souveräne Lösungen „vom Geheimtipp zum Geschäftsmodell werden“. Denn sie zeichnen sich neben der Konkurrenzfähigkeit durch Rechtssicherheit, bessere

Viele KI-Funktionen basieren auf Modellen, die außerhalb Europas trainiert wurden. Das wird zunehmend kritisch hinterfragt.

Jürgen

Kontrollmöglichkeiten, branchen- und regionalspezifische Anpassbarkeit, engeren Support und kürzere Entscheidungswege sowie eine geringere Abhängigkeit aus. „Für viele Kunden ist die Entscheidung weniger ideologisch als vielmehr risikobasiert und strategisch“, weiß Walch.

Dabei versprechen auch europäische KI-Lösungen heute viel. Chat- und Voice-

Bots, Zusammenfassungen, EchtzeitÜbersetzungen oder proaktive Analysen der Gespräche, gehören fast schon zum Standard. „KI-Agenten sind ein spannender Ansatz und werden schon bald integraler Bestandteil moderner UCCArchitekturen sein“, glaubt der StarfaceChef.

Auch bei Zoom sind KI-Agenten längst im Einsatz. So verschickt beispielsweise der Zoom AI Companion Zusammenfassungen

Sensible Inhalte wie Transkriptionen dürfen ausschließlich im europäischen Rechtsraum verarbeitet und nicht dauerhaft gespeichert werden.

Christoph Scheuermann, Geschäftsführer von Starface

von Meetings oder Kundengesprächen automatisch per Mail an die Gesprächsteilnehmenden. Die nächsten Schritte und mögliche Aufgabenverteilung plant der AI Companion gleich mit. Doch sollen KI und KIAgenten die menschliche Kommunikation nicht ersetzen, sondern sinnvoll erweitern, indem sie repetitive Aufgaben übernehmen und Abläufe automatisieren. So schön sich die

neue automatisierte KIWelt auch anhört, ein paar Hürden gibt es beim Implementieren der Lösungen schon. Schließlich sind sie trotz Automatisierung doch sehr individuell und müssen auf den jeweiligen Kunden zugeschnitten werden. Das hat eine gewisse Komplexität zur Folge. Der begegnen die Hersteller mit vorkonfigurierten, flexibel anpassbaren Lösungen. Das wiederum bietet Partnern die Möglichkeit, aufbauend auf den KITechnologien der Hersteller, „ihren Kunden bedarfsgerechte KILösungen anzubieten“. Ebbinghaus führt aus, „das Angebot

reicht von vorkonfigurierten Conversational-AI-Anwendungen bis hin zu Entwicklungsoptionen für individuelle Bots“. Dass das Anpassen von KI-Lösungen auf Kundenbedürfnisse kein unüberwindliches Hindernis sein muss, haben zum Beispiel Nfon und Wildix gezeigt. So hat Nfon Partner im Rahmen eines Hackathons zum Entwickeln eigener KI-Agenten aufgerufen. Wildix-Partner hingegen konnten im „Wilma AI Contest“ praxistaugliche KI Anwendungen entwickeln. Die besten Projekte der DACH-Region wurden ausgezeichnet.

„Je autonomer aber eine KI agieren soll, desto tiefer muss man sich mit den Geschäftsprozessen beschäftigen. Einfach nur einen bestehenden manuellen Prozess zu digitalisieren, erzeugt keine direkte Verbesserung, sondern kann im Gegenteil die Kundenzufriedenheit noch verschlechtern“, warnt Olllinger. Daher seien Prozessanalysen, Workshops mit Kunden und eine

Beratung, die über Möglichkeiten und Risiken aufklärt, entscheidend.

„Ziel ist es, das System ‚trainier- und bedienbar‘ zu halten – grafische Konfigurationen, und Agentenbaukästen statt sichtbarer Code“, sagt Walch. Weiter seien klare Use Cases, modulare KI-Bausteine, zentral einheitliche Modelle für Datenschutz, Training und Nutzung sowie eine transparente Kommunikation mit Kunden essenziell, um der Komplexität zu begegnen. „Wichtig ist es, die KI als Werkzeug zur Entlastung zu positionieren, nicht als Geheimnis in einer Blackbox“, betont Walch. Hersteller, Distributoren und Systemhäuser müssten KI in „verständlichen Mehrwert übersetzen“. Denn er ist überzeugt: „Vertrauen verkauft besser als maximale Feature-Listen.“

Schließlich geht es darum, „Unternehmen mit sinnvollen Technologien zu unterstützen, nah an den Menschen, nah an Geschäftsprozessen und nah an europäischen Werten“, fasst Ebbinghaus zusammen. n

Margrit Lingner Leitende Redakteurin IT-BUSINESS

Frankreich tut es, und einige Unternehmen in Deutschland tun es auch: Sie vertrauen ihre Kommunikation europäischen Anbietern an. Statt Microsoft Teams oder Zoom werden sämtliche französischen Beamten und Staatsangestellten mit Visio kommunizieren. Das Open-Source-Tool beruht auf französischer Technologie und soll bis 2027 ausgerollt werden. Das Ziel: Abhängigkeit von außereuropäischen Lösungen beenden und die Sicherheit der öffentlichen elektronischen Kommunikation gewährleisten. Positiver Nebeneffekt: Der Staat spart pro 100.000 Nutzer, die keine lizenzierten Lösungen mehr einsetzen, eine Million Euro pro Jahr. Und nein, es muss nicht Visio sein. Aber es gibt europäische Alternativen zu den zugegebenermaßen leistungsfähigen US-Tools. Sie fördern die Digitale Souveränität, schaffen Arbeitsplätze in Europa und ermöglichen Partnern langfristige Kundenbeziehungen. Und ein Wink mit dem Zaunpfahl in Richtung Digitalministerium ist der französische Weg allemal.

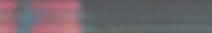

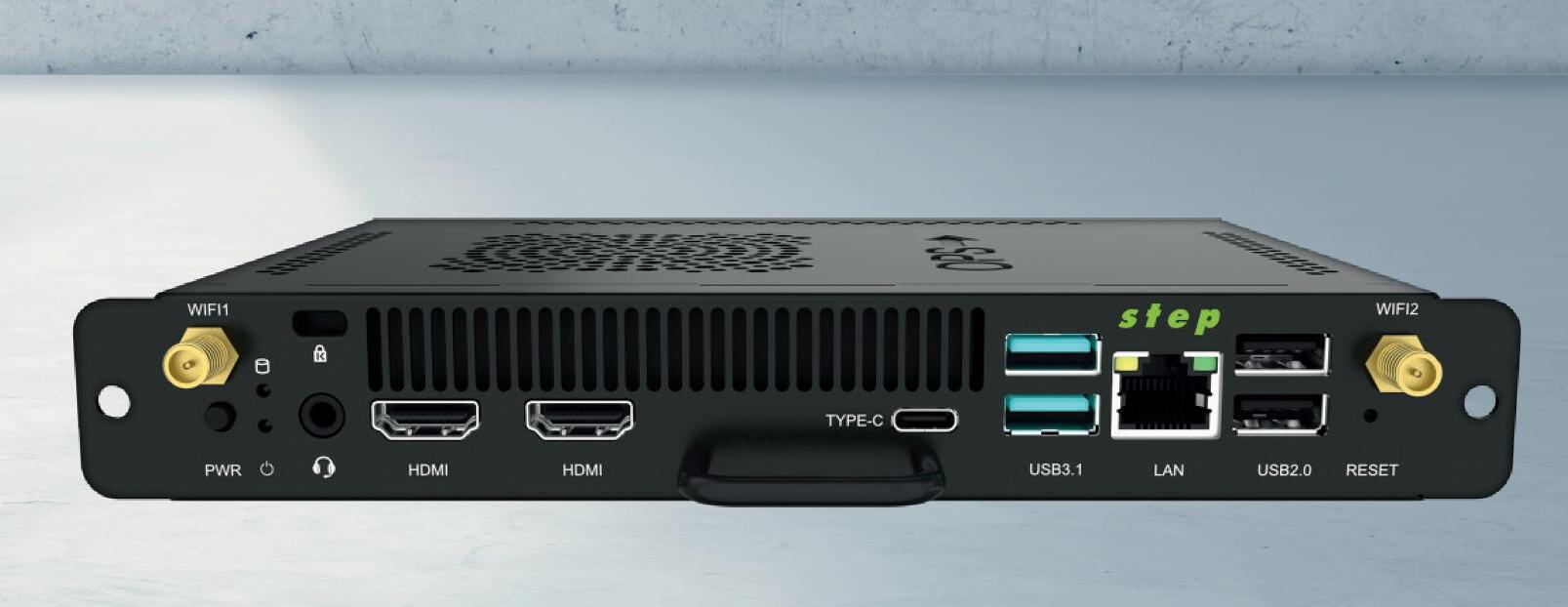

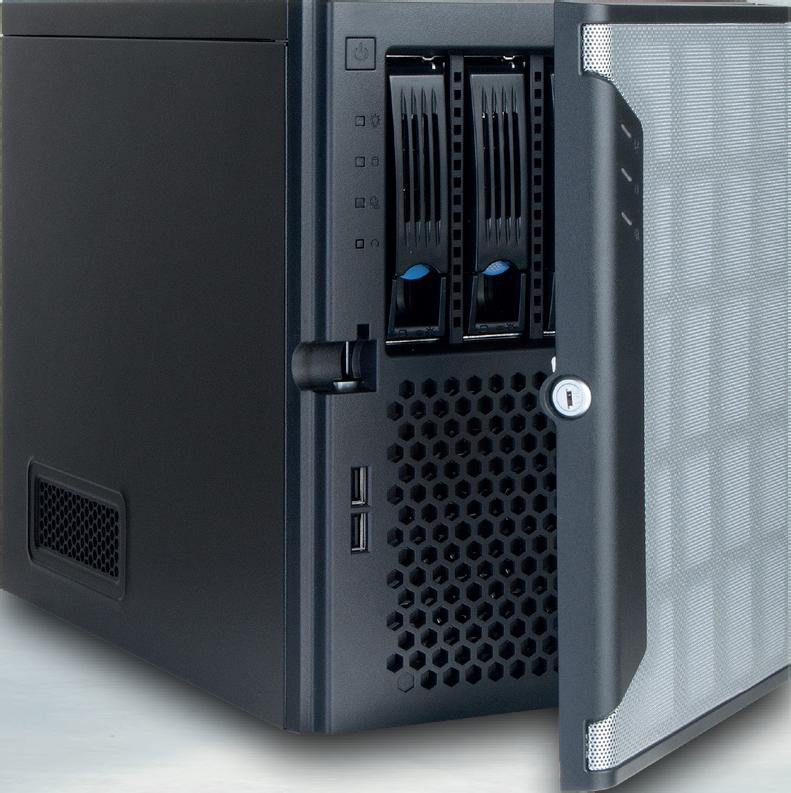

Bis zu vier Xeon-6-Prozessoren aus Intels Granite-Rapids-Familie mit insgesamt maximal 344 Cores finden im Primergy RX4770 M8 von Fsas Platz. Damit und mit bis zu 16 TB DDR5 soll der 3U-Server eine leistungsfähige Basis für geschäftskritische ERP-, CRM- und Branchenlösungen, In-Memory-Deployments wie SAP S/4HANA oder Virtualisierung im großen Stil bilden. Unternehmen bekommen die Möglichkeit, mehrere ältere Systeme zu konsolidieren und so Platz im Datacenter zu gewinnen und auch noch Performance sowie Antwortzeiten zu optimieren. Zudem können in dem Server bis zu 24 NVMe-, SAS- oder SATA-SSDs im 2,5-ZollFormat eingesetzt werden. Das Mainboard

bietet zehn PCIe-Gen5-Slots für Erweiterungskarten, vier davon mit voller Höhe, sowie zwei OCP-3.0-Slots für LAN-Karten. Drei 80+-Titanium-Netzteile sorgen für Ausfallsicherheit und Effizienz. | kl

Der 2U-Server Fsas Primergy RX4770 M8 kann auf bis zu vier Intel-Xeon-6700P-CPUs und 16 TB RAM skaliert werden.

BILD: WORTMANN

Ganz im Weiß präsentiert sich der All-in-One-PC Wortmann Terra 2710HA wh Greenline, ist aber dennoch ein „grünes“ Produkt. Denn der schlanke Rechner mit integrier

Hinter dem 27-Zoll-Full-HD-Display des All-in-One-PC 2710HA sitzt ein Mainboard mit einem Intel Ultra 5 225.

Flüssiges Arbeiten ermöglicht ein Intel Core Ultra 5 225 mit sechs P- und vier E-Cores. Der Arrow-Lake-Prozessor kann auf 16 GB DDR5-SDRAM zugreifen, die M.2-SSD ist 1 TB groß. Der Speicher ist auf bis zu 96 GB erweiterbar, und auch eine zusätzliche 2,5-ZollSSD findet noch in dem Rechner Platz. Das 27-Zoll-IPS-Panel ohne Touch-Erkennung liefert eine Auflösung von 1.920 x 1.080 Pixel bei 60 Hz. Für Videocalls ist eine im Gehäuse versenkbare 5-MP-Webcam eingebaut und auch zwei Stereolautsprecher sind an Bord. Für die Netzwerkanbindung steht neben einem Gigabit-LANAnschluss auch ein Wi-Fi-6-Adapter zur Verfügung. Als Betriebssystem ist Windows 11 Pro installiert. Maus und Tastatur gehören nicht zum Lieferumfang. Der Wortmann Terra 2710HA wh Greenline kostet 1.139 Euro (UVP). | kl

Auf der ISE 2026 hatten LEDVideowalls einen noch größeren Stellenwert als zuvor. Weitere Neuheiten waren ein 85-Zoll-3DDisplay von Samsung, ein 3DDisplay mit Gestensteuerung von Sony, sparsame E-Paper-Displays und eine All-in-One-Videobar von Shure. | Klaus Länger

Ein Blickfang bei der ISE war die eindrucksvolle Drohnenshow. Auf Video in der E-Paper-Ausgabe.

QUELLE: B9__BILDHINWEIS © XXXX XXXXXX

Das imposante Messegelände in Barcelona: Mit 92.170 Besuchern stellte die ISE 2026 einen neuen Rekord auf.

Eines der Messehighlights bei Samsung war das 85 Zoll große 3D-Display. Es kann auch ohne Brille einen 3D-Effekt erzeugen und so beispielsweise ein virtuelles

Fotomodell in einem Bekleidungsgeschäft darstellen.

Bei dem 130 Zoll großen QPHX-Display nutzt Samsung die Micro-RGBTechnologie mit einem aus winzigen RGB-LEDs aufgebauten Backlight für das VA-Panel.

Mit einem einzelnen

Controller bietet das modulare Micro-LED-Display Magnit LMPB von LG eine 8K-Auflösung. Durch den Einsatz von Lichtleitern statt Kupferkabeln kann ein Controller bis zu 10 km entfernt vom Display installiert werden.

Für die Integrated Systems Europe ist der Umzug von Amsterdam nach Barcelona ein Erfolgsmodell: Mit 92.170 Unique Visitors brach die ISE den Rekord des Vorjahres. Wie Mike Blackman, Managing Director der ISE, anmerkte, waren allein am Mittwoch mehr als 64.000 Besucher auf dem Messegelände, mehr als die Gesamtbesuchszahl der ISE 2019 in Amsterdam. Gleichzeitig hat sich auch der Charakter der Pro AVund DigitalSignageMesse gewandelt: von einer europäischen hin zu einer globalen Veranstaltung.