Ed Waitzer on ESG today PAGE 13

Shauneen Bruder is comfortable with AI in the boardroom PAGE 20

How to capitalize on AI now PAGE 29

Ed Waitzer on ESG today PAGE 13

Shauneen Bruder is comfortable with AI in the boardroom PAGE 20

How to capitalize on AI now PAGE 29

It’s time to rethink how we work and how boards govern

15 DIRECTORS’ DILEMMA

How should directors tackle AI?

Chapter talk on IP, AI and IT; welcome, Dexter John; National Director Conference and Gala in June; and board appointments

10 DISPATCHES

Tips for introverts, hiring from within, finding the right board for you, top skills for the 2025 director, and green productivity

13 POINT OF VIEW

Stripped of politics, ESG is really about practicing sound business judgment

48 RECOMMENDED READING

In We, The Data: Human Rights in the Digital Age, political scientist

Wendy H. Wong warns of the potential harm from information collection by companies

50 ADJOURNED

On International Women’s Day 2025, females remain greatly outnumbered in the boardroom

EDITOR

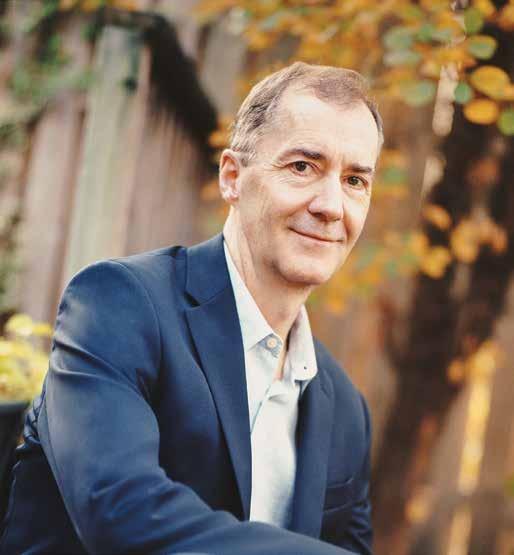

Simon Avery

ART DIRECTION + DESIGN

Steven Balaban, Philina Chan

INSTITUTE OF CORPORATE DIRECTORS

Rahul Bhardwaj, President and CEO

Richard Piticco, Chief Administrative Officer

Jan Daly Mollenhauer, Vice-President, Sales Marketing, Membership

Gigi Dawe, Vice-President, Policy & Research

Shannon Hunt, Vice-President, Education

Kathryn Wakefield, Vice-President, Chapter Relations

SJC

Tony Gagliano, Chair and CEO

Cameron Williamson, Vice-President Client Solutions, Media & Content

Sasha Emmons, Vice-President, Branded & Custom Content

Paul Ferriss, Director, Editorial & Creative

Joycelyn Tran, Production Manager

ADVERTISING INQUIRIES

For advertising inquiries, please contact Christine Miles, Director, Sponsorship, cmiles@icd.ca

Building trust and confidence in Canadian organizations is imperative. At the Institute of Corporate Directors (ICD), we believe that this starts with the right leadership and good governance. Directors must lead by being informed, prepared, ethical, connected, courageous and engaged with the world. In the pages that follow, you will find thoughtful and provocative articles that explore these essential leadership qualities.

Bâtir la confiance envers les organisations canadiennes est primordial. À l’Institut des administrateurs de sociétés (IAS), nous croyons que cela commence par un bon leadership et une bonne gouvernance. Les administrateurs doivent gouverner en étant informés, préparés, intègres, connectés, courageux et ouverts sur le monde. Dans les pages qui suivent, vous trouverez des articles réfléchis et provocateurs qui explorent ces qualités de leadership essentielles.

1601 – 250 Yonge Street, Toronto, Ontario M5B 2L7

T: 416-593-7741 F: 416-593-0636 E: info@icd.ca

ISSN 2371-5634 (Print)

www.icd.ca ISSN 2371-5650 (Online)

The ICD welcomes a diversity of opinion for inclusion in Director Journal. The contents of this publication do not necessarily reflect the opinions of the ICD, its partners, its sponsors, or its advertisers. Readers are encouraged to consider seeking professional advice and other views.

To request reprints of articles, please contact info@icd.ca

Simon Avery Editor savery@icd.ca

There’s no hiding from this technological transformation

Members of the Institute of Corporate Directors have diverse interests, but one widely shared desire is to gain more knowledge about artificial intelligence – does my organization need it, how should we begin to invest in it, and what are the board’s oversight responsibilities? This issue aims to provide some guidelines for directors, whether your organization is contemplating an initial investment or already integrating AI into overall strategy.

People we spoke to used words like “transformational” in their descriptions, but no one suggested the technology is overhyped. In fact, they warned that board members who fail to understand the strategic impact AI is going to have on their business models will underperform. Furthermore, organizations that put more weight on the risks of AI rather than the opportunities will fall behind.

The arrival of AI requires boards to enhance their knowledge and update processes, says Shauneen Bruder, who serves on the board of Canada’s largest AI institute, the Vector Institute in Toronto, and chairs the board of CN Railway. “It’s going to need broad literacy and adjusted governance and control mechanisms so that you can control for the unknowns,” she says (page 20).

Our cover story, on page 29, makes the case for Canadian companies to accelerate their adoption of AI, but to do so with caution. “There’s an AI emergency in Canada,” says Nicholas Darveau-Garneau, a corporate director and entrepreneur. “We have to get going.” But he also advises boards to direct investments to specific business problems that need fixing.

A second feature, “Boards grapple, laws lag” (page 40) looks at the state of regulations and industry standards. AI’s rapid evolution translates into a legal framework still under construction, particularly in Canada and the United States. This is the moment boards need to be learning everything they can about AI and ensuring their organization has the right people and training in place to eventually move ahead with further deployment. They should also have a eye on industry standards as well as compliance and regulations in other jurisdictions.

On ne peut échapper à cette transformation technologique

Les membres de l’Institut des administrateurs de sociétés ont des intérêts diversifiés, mais l’un de leurs désirs communs est d’obtenir davantage de connaissances sur l’intelligence artificielle. Mon organisation en a-t-elle besoin? Comment devrais-je commencer à y investir? Et quelles sont les responsabilités du conseil en matière de surveillance? Ce numéro entend fournir certaines réponses et lignes directrices à l’intention des administrateurs, que votre organisation envisage un investissement initial ou soit déjà en train d’intégrer l’IA dans sa stratégie d’ensemble.

Nous avons parlé à beaucoup de gens à propos de l’IA et de la direction qu’elle a prise. Ces gens utilisent des mots comme « transformationnel » dans leurs descriptions, mais personne n’a suggéré que cette technologie est surestimée. En fait, ces personnes préviennent les administrateurs que s’ils échouent à comprendre l’impact stratégique de l’IA sur leur modèle d’affaires, ils se condamnent à voir leurs entreprises sousperformer. En outre, les organisations qui mettent plus d’emphase sur les risques que sur les opportunités traîneront de la patte.

L’arrivée de l’IA, puissante et envahissante, exige des conseils qu’ils améliorent leurs connaissances et actualisent leurs processus, affirme Shauneen Bruder, qui siège au conseil du plus grand institut d’IA au Canada, le Vector Institute de Toronto, et préside le conseil de CN Rail. « On aura besoin d’un fort degré de littératie, d’une gouvernance adaptée et de mécanismes de contrôle afin de pouvoir contrôler les inconnues », explique-t-elle en entrevue en page 20.

Notre article principal, en page 29, expose le fait que les entreprises canadiennes devront accélérer leur adoption de l’IA, mais de façon prudente. « Il existe une urgence d’adopter l’IA, soutient Nicholas Darveau-Garneau, un administrateur de sociétés et entrepreneur. Nous devons nous mettre au travail. »

Un deuxième article en page 40, « Pendant que les conseils tentent de comprendre l’IA, les lois peinent à suivre le rythme », traite de l’état de la réglementation et des normes de l’industrie. L’évolution rapide de l’IA se traduit par un cadre juridique encore en chantier, particulièrement au Canada et aux États-Unis. C’est le moment où les conseils doivent apprendre tout ce qu’ils peuvent sur l’IA et faire en sorte que leur organisation mettent en place les bonnes personnes et de la formation adéquate pour éventuellement progresser vers un déploiement ultérieur. Ils devraient aussi garder l’œil ouvert sur les normes de l’industrie ainsi que la conformité et la réglementation dans d’autres juridictions.

must forge ahead into the unknown

Directors confront a world of accelerated uncertainty today. While our instincts may tell us to pause, the reality demands clear focus and action; directors cannot afford to sit still and wait for the dust to settle.

Take the environment surrounding AI as an example. A year ago, the conversation focused on responsible use and regulation of the emerging technology. Today that theme has been overtaken by political and technological events. As I write this, the U.S. has just banned federal employees from downloading the Chinese AI model DeepSeek onto work devices. And Meta and Google have relinquished their claims that their AI will not be used for military purposes.

Board oversight of AI is becoming essential. About one-third of the TSX 60 companies have incorporated it into their board mandates and more than half mention AI in their 2024 proxy circulars. The proxy advisory services company Glass Lewis, in its latest policy guidelines, has included board oversight of AI for the first time, calling on companies to disclose their practices as well as the steps they are taking to develop their own AI expertise.

On top of the AI tsunami sweeping the corporate world, the prospect of a trade war is forcing many Canadian companies to reassess their corporate strategies. During the past few years, Canadian and U.S. companies signed commercial agreements within the framework of the revised free trade agreement the two countries signed in 2018. A new, protectionist environment could change many of the rules and contracts they have come to rely on.

Even in trying times, I draw optimism from the fact that we have a strong foundation and culture for good governance in Canada. But it’s important to acknowledge that directors are facing extraordinary stress and challenges. The choices they have to confront will test that foundation, making board resilience essential. My mantra for these times is Keep Calm and Lead On. Coincidentally, our National Director Conference in Edmonton this June will focus on the resilient board, with both global trade and AI forming part of the agenda. I encourage members to attend, enjoy the wonderful Edmonton hospitality, spend time with peers, share insights and learn.

Rahul Bhardwaj, LL.B, ICD.D President and CEO, The Institute of Corporate Directors

Les conseils doivent avancer dans l’inconnu

Les administrateurs évoluent aujourd’hui dans un monde d’incertitude accélérée. Même si nos instincts peuvent nous dicter de prendre une pause, la réalité exige une clarté d’objectifs et d’action. Les administrateurs ne peuvent tout simplement pas se permettre d’être inactifs en attendant que la poussière retombe.

Prenons pour exemple l’environnement qui entoure l’intelligence artificielle. Il y a un an, la conversation s’articulait autour d’un usage responsable et d’une réglementation de la technologie en émergence. Aujourd’hui, ce thème a cédé le pas à des événements politiques et technologiques. Au moment où j’écris ces lignes, le gouvernement américain vient tout juste d’interdire à tous les employés fédéraux de télécharger le modèle d’IA DeepSeek. Et Meta et Google ont renoncé à leur volonté que leurs travaux en IA ne servent pas à des fins militaires.

La surveillance de l’IA par le conseil devient essentielle. Environ le tiers des sociétés du TSX 60 l’ont intégrée aux mandats de leurs conseils et plus de la moitié d’entre elles mentionnent l’IA dans leurs circulaires de sollicitation de procurations. L’entreprise de services-conseils en procuration Glass Lewis, dans ses plus récentes lignes directrices sur les politiques de référence, a inclus pour la première fois la surveillance de l’IA par les conseils, appelant les entreprises à divulguer leurs pratiques ainsi que les mesures qu’elles prennent pour développer leur propre expertise en matière d’IA.

En plus du tsunami d’IA qui balaye le monde corporatif, la perspective d’une guerre commerciale force beaucoup d’entreprises canadiennes à réévaluer leurs stratégies d’ensemble. Au cours des dernières années, des entreprises canadiennes et américaines ont signé des ententes commerciales dans le cadre de l’accord de commerce révisé entre les deux pays signé en 2018. Un nouvel environnement protectionniste pourrait changer bien des règles. Mon mantra, dans ces circonstances, est de rester calme et de continuer.

Incidemment, notre Congrès national des administrateurs, qui se tiendra à Edmonton en juin, portera sur la résilience au cœur du conseil. J’invite les membres à y participer, à profiter de la magnifique hospitalité des gens d’Edmonton, de passer du temps avec leurs pairs, de partager des idées et d’apprendre.

+ RECENT CHAPTER EVENTS

+ ICD BOARD APPOINTMENT

+ DIRECTORS ON THE MOVE

Intellectual property (IP) is one of the most valuable assets a company holds and its proper management requires board directors to stay informed. This Ottawa Chapter event was spearheaded by Kim Butler. During the event, Natalie Giroux, president of Stratford Intellectual Property, provided expert insights into protecting patents, trade secrets and trademarks. The session highlighted strategies for reducing IP-related risks and ensuring that investments are aligned with corporate goals. Directors gained practical advice on assessing IP strength and developing comprehensive strategies to protect innovation and minimize risk.

Artificial Intelligence is transforming industries, offering businesses opportunities to innovate and optimize processes. At a recent Manitoba Chapter event, David Gerhard, Professor and head of the Department of Computer Science at the University of Manitoba, shared expert insights on AI’s evolution, its impact on businesses, and the responsibilities of boards in guiding AI strategies. The session covered ethical considerations, regulatory developments, and how boards can align AI initiatives with organizational goals while addressing potential risks.

Have you ever attended a board meeting where technology topics are deferred to the one director with IT expertise? At a recent GTA Chapter event, led by committee members Andrew Wilson and Leanna Falkiner, experts discussed how directors without a technical background can effectively govern IT issues like cybersecurity, digital assets and generative AI. This session highlighted the importance of fostering inclusive, productive IT discussions across the boardroom. Richard Wilson, a partner at PwC Canada, moderated the webinar featuring Sharon Castelino, Director at Move Health Corp. and the City of Toronto Investment Board, and Ranjika Manamperi, CIO at Ontario Power Generation. The panel provided governance frameworks, practical strategies for engaging with technology leaders, and tools for translating complex IT topics into familiar boardroom terms like strategy, risk and finance.

ICD BOARD APPOINTMENT

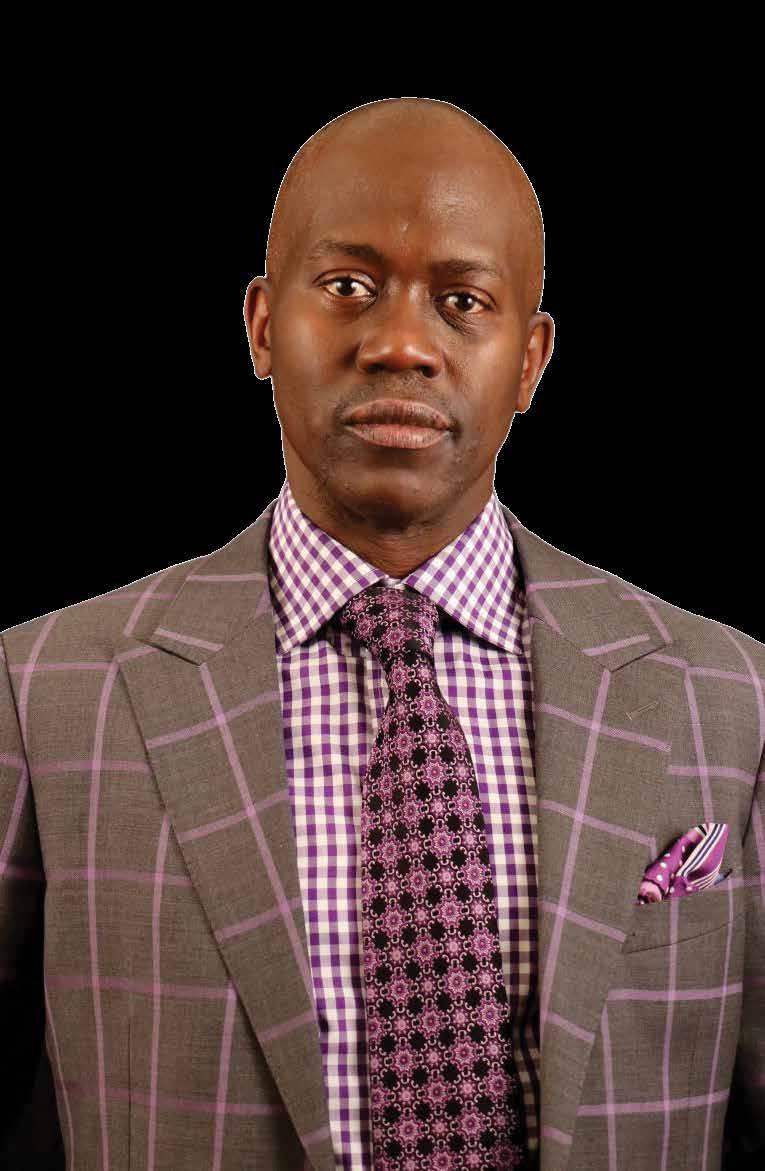

Dexter John, ICD.D

Dexter John brings over 25 years of leadership, governance and risk management experience from his prior positions at Stikeman Elliott, Donahue LLP, Investment Dealers Association, Ontario Securities Commission, the Toronto Stock Exchange, Kingsdale Shareholder Services Inc., and Sodali & Co (Canada). He currently serves as the CEO of the Financial Services Regulatory Authority (FSRA) of Ontario.

John’s influence extends beyond his current roles. He is a board member for Organigram Inc., CanPR and FSRA, and has previously served on the boards of Prosper Gold Corp., Augustine Ventures Inc. and Partners Real Estate Investment Trust. He also contributed to the “Charting the Future of Corporate Governance” report as a member of the Committee on the Future of Corporate Governance in Canada, a joint initiative of TMX Group Ltd. and the Institute of Corporate Directors.

Conference keynote address

Nik Nanos will paint a picture of the mood of Canadians in 2025 and on the heels of 2024, the “Super Year” for elections when 3.7 billion people voted in 72 countries. Drawing from his extensive research, Nanos will offer insights and analysis of economic, technological and societal factors and explore how boards of Canadian businesses can navigate these shifts and stay ahead of emerging trends and evolving stakeholder expectations.

Register now for the 2025 ICD National Director Conference and Fellowship Awards Gala in Edmonton.

The ICD would like to congratulate the following members on their recent board appointments:

METALS & MINING

André Le Bel, ICD.D DIRECTOR Vior Inc.

GOVERNMENT

Bob Dhillon, ICD.D DIRECTOR Alberta Investment Management Corp. (AIMCo)

Patricia Bood, ICD.D DIRECTOR

Passenger Transportation Board

BANKING, FINANCE & INVESTMENTS

Greg Clark, ICD.D DIRECTOR Calvert Home Mortgage Investment Corp.

EDUCATION

Susanna Zagar, ICD.D GOVERNOR Ontario Tech University

ENERGY & POWER

Ravinder Minhas DIRECTOR FortisAlberta Inc.

Nicolle Butcher, ICD.D DIRECTOR Ontario Power Generation Inc.

INSURANCE

Sharon Giffen, ICD.D DIRECTOR WorkSafeBC

SPORTS & ENTERTAINMENT

Andrew MacCorquodale, ICD.D DIRECTOR Saskatchewan Roughrider Football Club Inc.

OIL & GAS

Kelly Koss-Brix, ICD.D DIRECTOR ATCO Ltd.

TRANSPORTATION

Darlene Hyde, ICD.D DIRECTOR TransLink

Harpinder Sandhu ICD.D DIRECTOR TransLink

NOT-FOR-PROFIT

Pamela Huff, ICD.D DIRECTOR Trillium Health Partners Foundation

Ken Dufault, ICD.D DIRECTOR Chronic Disease Innovation Centre

Elaine Pantel, ICD.D DIRECTOR Prosserman JCC Schwartz/Reisman Centre

Patricia Bood, ICD.D DIRECTOR

Project Change Foundation

Patricia Bood, ICD.D DIRECTOR

Clean Prosperity

John Barrett, ICD.D CHAIR World Institute for Nuclear Security

Meg Bregazzi, ICD.D DIRECTOR

Alberta Children’s Hospital Research Institute

Kurt Pregler, ICD.D DIRECTOR

Metro Vancouver Crime Stoppers

Miranda Ji CHAIR Intercultural Association of Greater Victoria

Annie Houle DIRECTOR Girl Guides of Canada

Dina Kamal DIRECTOR Girl Guides of Canada

Heather McFadyen DIRECTOR Girl Guides of Canada

Send your board appointment publication requests to: Sheldon Mahabir, Director of Member Engagement, smahabir@icd.ca

NEWSWORTHY TRENDS AND TOPICS FOR DILIGENT DIRECTORS

IT’S SHOWTIME

NETWORKING CAN BE TOUGH for introverts, with four out of 10 identifying as such. But schmoozing can build connections, grow your career, and help you learn about different industries. So how do you mingle without zapping your energy or pretending to be something you’re not?

One way, according to Forbes, is to prepare to socialize before you mingle. Do a little research on the people you want

to meet and what topics you want to learn about. Having a few go-to questions or conversation starters can make small talk less stressful. If you’re more comfortable listening, make that work for you; most people love to talk about themselves and their projects when asked. Another tactic is to seek out networking opportunities that are more your speed, like virtual or more intimate events or workshops.

WHEN A CEO IS APPOINTED FROM THE BOARD, conventional wisdom has been that the move is both a failure in succession planning and a stop-gap measure. The practice is growing, however, and can be the best strategic option, according to Harvard Business Review.

It’s easy to understand why; board members have valuable institutional knowledge that can help steady the markets, as well as possessing both an internal and external POV.

However, there can be downsides too; directors may think they know each other well but they’ve often only worked together in one context, which can lead to overestimating a candidate’s knowledge. Picking a board member over an internal candidate can demoralize teams and even affect market value.

Between 2018 and 2023, HBR says that the number of board members becoming permanent CEOs jumped by 88 per cent.

Considering making a director the CEO? Those who’ve made the transition say to focus on these three factors:

JOINING A BOARD is a compelling next step for late-stage senior execs to keep one foot in the industry and still earn income, but without the daily grind. But is it really as flexible as it seems? The short answer is yes. The longer answer is, it takes some planning, according to board search specialist Kylie Hammond, via LinkedIn.

The key to landing a board seat is knowing where your experience fits best, being deliberate in your lifestyle choices and understanding how earnings align with responsibilities. Directorship can be demanding, so it’s crucial to be clear about what kind of roles you want and how much effort you’re willing to commit. Take your time finding the right fit; it’s normal for matching process to take up to two years, so plan accordingly.

THERE’S NO ONE-SIZE-FITS-ALL “perfect” board size, but both too big or too small can be problematic. With bloated boards, it’s hard to keep everyone engaged, and one or two voices may dominate. Too small, and there’s not enough hands to get the job done. So, what’s the sweet spot for many companies? Ideally, says the Corporate Governance Institute, it’s about 10 members.

Here are three factors that may guide size: the stage of development of the company, the number of board committees required, and the right balance of skills and experience.

1 For small businesses, it’s less about getting to a board of 10 than about building the good habit of meeting regularly, and then, as needed, adding expertise that matches the company’s ambition and adding separation between the board and management.

2 As a company grows, adding committees like audit and compensation naturally means more board members to manage the workload.

3 The final consideration when it comes to optimal board size: ensuring the right blend of skills and expertise to support the company’s strategy as it evolves over time.

CHANGE IS THE ONLY CONSTANT, and boards need to keep up. According to the Corporate Governance Institute, there are five key soft and hard skills that directors need now.

First up, directors need a solid grasp of AI, what it can do (even in the boardroom itself), where the risks lie, and how to use it effectively.

Also, sustainability expertise is still tablestakes; despite rumblings from the U.S., ESG isn’t going anywhere, as it’s a multi-trillion-dollar space globally that’s only growing.

NOT MONEY, BUT PLANTS.

That trailing pothos or giant monstera next to your desk can help boost your productivity, writes Ben Kesslen at Quartz. That’s just one tip to make your work-from-home space more appealing when you’re there for eight hours a day. Other tips from the experts at Serpple, a search engine optimization company, include investing in good lighting, decluttering your space, buying the best tech you can afford and choosing a good chair. Your back and hips will thank you.

Crisis management and resilience planning are next on the list. With the past few years’ unprecedented events, knowing how to pivot through upheaval is a must.

Strategic thinking and innovation is also critical. Directors can drive growth by spotting industry shifts early and jumping on new opportunities.

Finally, strong stakeholder communication skills are essential. Mastering storytelling that engages key groups such as investors, employees and customers can make or break a company’s success.

DESPITE PUBLIC FEARS to the contrary, ESG in corporate Canada is here to stay, and with it the overriding principle that companies perform best when their leaders respect various stakeholder interests rather than simply short-term profit maximization. But it’s important to understand that different companies will prioritize different ESG (environmental, social and governance) issues and may not even use the term “ESG” anymore.

Some companies champion conservative ideals, others emphasize liberal ones. When we strip away the various forms, the outcome is the same: boards exercising their business judgment to address material risks that might harm the business and stakeholders they serve. In fact, Canadian law requires that directors address ESG factors relevant to achieving sustainable returns.

Likewise, while leaders at both ends of the political spectrum often argue that corporations should not use their resources for political ends, neither are averse to corporate campaign contributions. Both have their own specific ESG issues (some overlap) in respect of which they would argue that good corporate governance should be about more than just making money. In the United States today, companies that have pro-gun, pro-Christian or anti-climate views are lauded for their “values” while those with contrary positions are said to be illegitimately promoting a “woke” agenda. The shared assumption is that our market system works best when corporate conduct has regard for the interests of various stakeholders.

Torys LLP recently reported that most Canadian public companies consider ESG factors to be part of prudent risk management. Torys’ survey of companies in the TSX composite index indicated that 95 per cent publish some form of ESG report, nearly 80 per cent include ESG factors in their board skills matrix, and 59 per cent link executive pay to climate related metrics.

Suggesting that corporate managers should ignore ESG issues and only focus on profits implies that they shouldn’t be expected to exercise business judgment and self-restraint. This encourages corporate conduct at the margins of the law ignoring moral boundaries and leads to the need for more regulation to protect the public from bad corporate conduct.

A narrow focus on profit maximization encourages excessive risktaking sometimes with catastrophic effects on the economy. Government interventions after such market failures (for instance, the 2008 financial sector and auto industry bailouts) are far more “socialistic” than is a focus on sustainable corporate conduct.

Managers who embrace the narrow profit maximization norm are more likely to see themselves as individual profit maximizers, putting their own interests ahead of others. Encouraging such selfish behaviour erodes confidence in private enterprise.

Edward Waitzer is a lawyer, former chair of the Ontario Securities Commission and a Senior Fellow at the C. D. Howe Institute.

Profit maximization cannot diverge from reasonable public expectations and overall social welfare indefinitely. Concepts of fairness (which are undermined by excessive profit-taking and corporate misbehaviour) affect the way political systems interact with corporations. The stakes are high in a world in which geopolitical instability has become a danger to democracy and market capitalism. Authoritarianism (of the extreme left or right) is not a political environment in which most corporations or voters want to live.

In 2008, the Supreme Court of Canada made clear through its BCE decision that directors have a duty to act in the best interests of a corporation and, in doing so, may consider the impact of corporate decisions on shareholders and other stakeholders.

The Canada Business Corporations Act has since been amended to confirm that directors may consider the interests of shareholders, employees, retirees and pensioners, creditors, consumers and governments, the environment and the long-term interests of the corporation.

In hindsight, this amendment may have been undesirable. The Supreme Court’s decision was clear and deliberately broad. In specifying certain interests (and not others) the statutory amendment may have narrowed the scope of the Supreme Court’s decision and could encourage the polarizing ESG backlash.

Time will tell whether the court’s guidance will suffice or more robust enforcement mechanisms will be required. The immediate point is that once each side’s specific ESG issues are set aside, conservatives and liberals should encourage boards to continue to exercise their business judgment, devoid of partisanship, to address material risks that might harm the corporations and stakeholders they serve. The Supreme Court of Canada got that right some time ago.

Working Effectively with Your Board: A Program for Senior Executives is a two-day in-person experience that optimizes board interactions for organizational success. Attendees will gain a deeper understanding of management’s role, practical tools for engagement, and strategies to maximize boardroom effectiveness.

PROGRAM: June 16 - 17, 2025

APPLY BY: May 15, 2025

LOCATION: Rotman School of Management, Toronto

Adjunct Professor, Rotman School of Management, University of Toronto

Board Advisor and Educator at Fullbrook Board Effectiveness

How should AI be addressed at the board level?

Sue Paish

Sue Paish is the CEO of DIGITAL, leading an innovation portfolio that has leveraged $255-million to deliver $630-million in total investments in Canadian-led innovation. DIGITAL is driving transformation through AI-infused technologies, supporting the growth and success of Canadian companies. Paish serves on the boards of Telus International, Canadian Tire and Own the Podium.

AIis ubiquitous across industry and society. Think of AI as you would think of electricity it’s everywhere impacting society and industry, with risks and opportunities varying by sector and/or by initiatives in which an organization may be engaged. Boards need to understand both the impact, or potential impact, of AI on their organizations’ strategies and provide appropriate governance and oversight in this fast-moving area.

While the degree to which AI is having an immediate effect might vary from industry to industry, it is important for boards to discuss how AI is impacting their organization. Is AI a strategic threat, a strategic opportunity or both? For many industries, AI may also be an operational cornerstone. Understanding and providing governance oversight relative to AI goes to the core function of any board, especially in respect of overall strategy, acquisitions, new product lines, leadership development, workforce skills and future readiness.

More than 50 per cent of directors recently surveyed by Deloitte said that AI did not appear regularly on their board’s agenda. It’s important, however, for boards to receive briefs and be engaged

Comment les conseils devraient-ils aborder l’intelligence artificielle?

L’IA est présente à toutes les échelles de l’industrie et de la société. Envisagez-la de la même façon que l’électricité – qui est partout – influence l’industrie et la société, avec des risques et des opportunités qui varient selon les secteurs et/ou les initiatives dans lesquelles une organisation est susceptible d’être engagée. Les conseils doivent comprendre à la fois les impacts – ou les impacts potentiels – de l’IA sur la stratégie de l’organisation et fournir une gouvernance et une surveillance appropriées dans ce domaine en évolution rapide.

Même si l’immédiateté des effets de l’IA peut varier d’une industrie à l’autre, il est important pour un conseil de discuter de la façon dont elle affecte votre organisation. Représente-t-elle une menace stratégique, une opportunité stratégique ou les deux? Pour beaucoup d’industries, l’IA peut aussi s’avérer une

in discussions relative to the impact of AI on their strategy or key initiatives so that they develop an overall understanding of how AI impacts the business. So, how can directors best to achieve this?

Sue Paish est PDG de DIGITAL. À ce titre, elle dirige un portefeuille d’innovation qui a recueilli 255 millions $ pour générer des investissements totaux de 630 millions $ en innovations d’origine canadienne. DIGITAL suscite une transformation au moyen de technologies issues de l’IA, soutenant ainsi la croissance et le succès d’entreprises canadiennes. Mme Paish siège aux conseils de Telus International, Canadian Tire et Own the Podium.

AI does not need to be on every board meeting agenda. How you level up your own understanding of AI and that of your board depends in part on the sector and stage of AI adoption across the organization. If it’s critical to your core strategy, or to regulatory compliance or an ongoing project, then perhaps it should be on every agenda for a time. What’s important is that the board is aware of, and engaged with, AI at the right level. If you serve on the board of a health organization or company in the financial sector, for example, you will likely be engaged with AI in a more intense and regular way than boards of organizations in some other sectors. However, as every sector is affected by AI, every board needs to be informed and understand what the technology is and how it will impact the strategy and plans for the organization.

One particularly stunning finding in Deloitte’s report was that 79 per cent of the directors who responded said that they thought their board had limited, minimal or no knowledge or experience with AI. With AI evolving rapidly and impacting every company and industry, most boards would benefit from education, updates or training sessions.

There are a growing number of options on this front. AI education may include guest speakers, industry experts or targeted executive training programs. The organization I lead, Vancouver-based DIGITAL, Canada’s global innovation cluster for digital technologies, collaborates with other organizations to advance innovation and strengthen digital skills. One of our key partnerships is with the SFU Beedie School of Business on an initiative called DIAL. This program builds AI fluency for strategic decisionmaking while supporting real-world AI implementation tailored to specific industries.

Board education on AI is not a standalone topic, or a one-off session. Rather, it is best accomplished as a fundamental element of ongoing board knowledge-building relative to key elements or initiatives in the organization. And so, ‘who’ is best positioned at the board to provide oversight and guidance on AI? AI needs to be addressed in a strategic, cross-functional way, with the board working in coordination with management. The board committee

pierre angulaire opérationnelle. Le fait de comprendre et de fournir une surveillance de la gouvernance en matière d’IA est au cœur de la fonction du conseil, en particulier par rapport à la stratégie d’ensemble, aux acquisitions, aux nouvelles lignes de produits, au développement du leadership ainsi qu’aux compétences de la main-d’œuvre et à la préparation face à l’avenir.

Plus de cinquante pour cent des administrateurs récemment sondés par Deloitte ont avoué que l’IA ne figurait pas régulièrement à l’ordre du jour des réunions de leur conseil. Or il est important que les conseils reçoivent des documents qui en traitent et soient engagés dans des discussions relatives aux impacts de l’IA sur leur stratégie ou leurs principales initiatives de manière à développer une compréhension d’ensemble du phénomène. Comment réaliser cela?

L’IA ne doit pas nécessairement figurer à l’ordre du jour de chaque réunion du conseil. La façon dont vous élevez votre compréhension de la question et celle de votre conseil dépend en partie de votre secteur d’activité et du degré d’adoption de cette technologie à l’échelle de l’organisation. Si l’IA est essentielle à votre stratégie de base, à votre conformité réglementaire ou à un projet en cours, alors peut-être devrait-elle s’inscrire à l’ordre du jour de chaque réunion pendant un certain temps. Ce qui importe, c’est que le conseil connaisse l’IA et y soit engagé à un degré adéquat. Par exemple, si vous siégez au conseil d’une organisation de santé ou d’une entreprise du secteur financier, il est probable que vous y serez engagé de manière plus intense et régulière que les conseils d’organisations évoluant dans certains autres secteurs. Toutefois, comme chaque secteur est affecté par l’IA, chaque conseil doit être informé de la technologie et comprendre sa nature et la façon dont elle affectera la stratégie et les projets de l’organisation.

L’un des résultats particulièrement frappants de l’enquête de Deloitte est que 79 pour cent des répondants ont dit penser que leur conseil avait une connaissance et une expérience limitée, minimale ou nulle de l’IA. Dans le contexte d’une technologie qui évolue rapidement et affecte toute les entreprises et industries, la plupart des conseils profiteraient de cours, de mises à jour ou de séances de formation sur la question. Un nombre croissants d’options existent sur ce front. En matière de formation à l’IA, il y a des conférenciers, des experts de l’industrie ou des programmes de formation à l’intention de membres ciblés des équipes de direction. L’organisation que je dirige à Vancouver DIGITAL, la grappe canadienne d’innovation mondiale du Canada pour les technologies numériques collabore avec d’autres organisations pour promouvoir l’innovation et renforcer les compétences numériques. Un de nos partenariats principaux est mené avec la SFU Beedie School of Business autour d’une initiative appelée DIAL ou Developing Leaders for the IA-driven Digital Economy (Développer des leaders de l’économie numérique axée sur l’IA). Ce programme entend créer une aisance en matière d’intelligence artificielle en vue de la prise de décisions stratégiques tout en soutenant concrètement la mise en œuvre sur mesure de l’IA applicable à des industries spécifiques.

L’éducation du conseil en matière d’IA ne se résume pas à une question distincte ni à une séance unique. Il s’agit plutôt d’un élément fondamental dont la réussite repose sur l’acquisition continue par le conseil de connaissances relatives aux éléments ou initiatives clés au sein de l’organisation.

responsible for AI will depend on the organization. AI is an important element of risk mitigation, but it’s also a risk and opportunity in and of itself. AI touches privacy, data, security and ethics. Depending on the organization and any specific initiatives in play, AI may be in the domain of a governance committee or a risk management or audit committee. AI governance is not a one-sizefits-all topic. It does, however, provide the opportunity and imperative for a board to work in concert with management to both leverage and mitigate the impacts of this fast-evolving technology.

Donc, qui est le mieux positionné au conseil pour offrir de la surveillance et de l’orientation sur l’IA? Cette technologie doit être abordée de manière stratégique et pluridisciplinaire, le conseil et la direction travaillant en coordination. Le comité du conseil qui sera chargé de l’IA dépendra de l’organisation. La question est un élément important de l’atténuation du risque, mais il s’agit aussi en soi de risque et d’opportunité. L’IA relève à la fois de la vie privée, des données, de la sécurité et de l’éthique. En fonction de l’organisation et de toute initiative spécifique en jeu, l’IA peut relever du comité de gouvernance, de gestion du risque ou d’audit. La gouvernance de l’intelligence artificielle ne requiert pas une approche uniforme. Elle offre cependant l’opportunité et l’obligation pour un conseil de travailler de concert avec la direction pour à la fois exploiter et atténuer les impacts de cette technologie en évolution rapide.

Ron Cuthbertson

Ron Cuthbertson, ICD.D, serves on the board of Canada Post and has experience on both private and public boards. He is a veteran CEO and executive coach with more than 30 years’ experience in large and medium-sized domestic and international companies, with specific expertise in technology, retail and supply chain. He is the CEO and co-founder of a startup focused on sustainability and waste reduction and the beneficial applications of AI.

The explosive growth of artificial intelligence and its innovatively disruptive influence presents myriad considerations for directors, amongst which are both opportunities and risks. When a board of directors is addressing AI, there are several key areas they should focus on to ensure they are overseeing AI effectively and responsibly. Also, after understanding how AI fits into the company’s overall business model and long-term goals, there are some practical steps they should consider taking.

AI, especially technologies like machine learning, can pose ethical challenges. The board should ensure that AI initiatives align with the company’s ethical standards. Questions about bias, fairness, privacy and transparency should be top of mind. The board can help establish or review AI ethics guidelines, ensuring that AI applications are designed to avoid harm from things such as bias in algorithms or discrimination in automated decision-making.

Regularly reviewing and assessing AI-related risks can help mitigate unforeseen consequences. With AI, large amounts of data are often used, which raises concerns about data privacy, security and potential breaches. The board should be apprised of potential risks such as operational disruptions, misuse of AI, or job displacement due to automation, and ensure strong safeguards are in place.

I recommend boards consider creating a dedicated AI or technology oversight committee. This committee would monitor AI projects, review policies and ensure alignment with business objectives and legal standards. Given the pace of change and adoption, boards should ensure AI

La croissance explosive de l’intelligence artificielle et son influence perturbatrice présentent une myriade de considérations pour les administrateurs, lesquelles comportent à la fois des risques et des opportunités. Quand un conseil d’administration aborde la question de l’IA, il doit porter son attention sur plusieurs zones clés afin de s’assurer qu’il l’aborde de façon efficace et responsable. En outre, après avoir compris comment l’IA s’intègre au modèle d’affaires et aux objectifs à long terme de l’entreprise, les administrateurs devraient envisager de franchir un certain nombre d’étapes.

L’intelligence artificielle, en particulier les technologies telles que l’apprentissage machine, peut poser des problèmes éthiques. Le conseil devrait s’assurer que les initiatives découlant de son utilisation soient conformes aux normes éthiques de l’entreprise. Les questions relatives au biais, à l’équité, à la vie privée et à la transparence devraient figurer au sommet des priorités. Le conseil peut contribuer à l’établissement ou à la révision des lignes directrices en cette matière, afin de faire en sorte que les applications soient conçues de manière à éviter de causer des torts comme le biais dans les algorithmes ou la discrimination dans les processus de décision automatisés.

L’analyse et l’évaluation régulières des risques relatifs à l’IA peuvent contribuer à atténuer certaines conséquences imprévues. Avec l’IA, de vastes sommes de données sont souvent utilisées, ce qui

initiatives are integrated across key areas of the organization for cohesive execution and alignment. There may be legal implications of AI applications, especially concerning intellectual property liability and fairness. The board should stay informed on emerging laws and best practices, ensuring that AI initiatives comply with relevant regulations, such as data protection, privacy laws and industry-specific guidelines.

To implement AI effectively, companies often need significant investment in infrastructure, whether it’s data storage, computing power or software tools. The board should ensure that the company is allocating resources appropriately and establish key performance indicators (KPIs) for AI-related projects to ensure initiatives are delivering value and aligning with the company’s strategic goals.

Ron Cuthbertson, IAS.A, siège au conseil de Postes Canada et possède de l’expérience au sein de conseils d’organisations privées et publiques. Gestionnaire chevronné, il a occupé des postes de PDG et de coach exécutif pendant plus de 30 ans au sein de moyennes et grandes entreprises nationales et internationales, avec une expertise particulière en technologie, commerce de détail et chaîne logistique. Il est chef de la direction et cofondateur d’une entreprise en démarrage axée sur le développement durable, la réduction des déchets et les applications bénéfiques de l’intelligence artificielle.

soulève des inquiétudes à l’égard de possibles violations de la vie privée et de la sécurité. Le conseil devrait être informé des risques éventuels tels que les perturbations opérationnelles, le mauvais usage de l’IA ou les suppressions d’emplois dues à l’automatisation et faire en sorte que de solides balises soient mises en place.

AI can also help companies gain a competitive edge. To capitalize on potential opportunities the board could encourage innovation in AI, fostering an environment that explores new applications for AI in the business, from product development to customer service to process optimization. It’s also strategically advantageous for a board to recognize the importance of acquiring and retaining top AI talent including both technical experts and cross-disciplinary leaders.

Lastly, communication and stakeholder engagement around AI are critical to a board. AI can be polarizing, and how the company addresses AI publicly may influence its reputation. The board should ensure the company is proactively explaining how it is responsibly deploying AI with clear communication on how the company is using AI, particularly if AI is affecting customer experience, employment or safety.

For boards of directors, addressing these elements of AI is essential for both harnessing its potential benefits and mitigating its risks. By focusing on ethical considerations, data privacy, intellectual property, regulatory compliance, business model integration, talent management and governance, boards can help guide companies to leverage AI responsibly and strategically. Ultimately, well-managed AI initiatives can drive innovation, improve efficiency and provide a competitive advantage while minimizing risks.

Je recommande aux conseils d’envisager la création d’un comité chargé de la surveillance de l’IA ou de la technologie. Ce comité assurerait la supervision des projets d’IA, des politiques et ferait en sorte qu’ils soient conformes aux objectifs d’affaires et aux normes juridiques. Compte tenu du rythme d’adoption du changement, les conseils devraient s’assurer que les initiatives relatives à l’IA soient intégrées aux secteurs clés de l’organisation en vue d’une exécution et d’une harmonisation cohérentes. Les applications de l’intelligence artificielle peuvent aussi comporter des implications juridiques, en particulier concernant la responsabilité et l’équité à l’égard de la propriété intellectuelle. Le conseil devraient demeurer informé des lois et meilleures pratiques émergentes, pour faire en sorte que les initiatives d’IA soient conformes aux réglementations en vigueur, notamment sur la protection des données, les lois sur la protection de la vie privée et les lignes directrices spécifiques à l’industrie. Pour mettre en œuvre efficacement l’IA, les entreprises doivent souvent consentir des investissements importants en infrastructure, qu’il s’agisse de stockage des données, de capacité informatique ou d’outils logiciels. Le conseil devrait faire en sorte que l’entreprise y alloue les ressources de façon appropriée et établisse des indicateurs clés de performance pour tous les projets reliés à l’IA afin de s’assurer que les initiatives offrent de la valeur et soient conformes aux objectifs stratégiques de l’organisation.

L’intelligence artificielle peut aussi aider les entreprises à se doter d’un avantage concurrentiel. Pour capitaliser sur les opportunités potentielles à cet égard, le conseil pourrait encourage l’innovation en IA en stimulant un environnement qui explore de nouvelles applications dans l’entreprise, du développement de produit au service à la clientèle en passant par l’optimisation des processus. Il serait aussi stratégiquement avantageux pour le conseil de reconnaître l’importance d’acquérir et de retenir les meilleurs talents en IA, dont des experts techniques et des leaders multidisciplinaires.

Récemment, la communication et l’engagement auprès des parties prenantes ont pris une importance cruciale pour le conseil. L’IA peut s’avérer polarisante et la manière dont l’entreprise aborde la question en public peut influencer sa réputation. Le conseil devrait faire en sorte que l’organisation explique de façon proactive et claire comment elle déploie l’IA de manière responsable, en particulier si l’IA affecte l’expérience client, l’emploi ou la sécurité.

Pour les conseils d’administration, il est essentiel d’aborder ces éléments pour à la fois exploiter ses avantages potentiels et atténuer les risques qui peuvent y être associés. En portant attention aux considérations éthiques, à la confidentialité des données, à la propriété intellectuelle, à la conformité réglementaire, l’intégration du modèle d’affaires, la gestion du talent et la gouvernance, le conseil peut contribuer à guider l’organisation pour qu’elle exploite l’IA de façon responsable et stratégique. Ultimement, les initiatives d’IA bien gérées peuvent stimuler l’innovation, améliorer l’efficacité et offrir un avantage concurrentiel tout en minimisant les risques.

We've rapidly grown to become one of Canada's largest and most influential executive compensation consulting firms by delivering a differentiated consulting experience.

Director

Human Resources Committee toolkit

Regularly

With over 150 professionals in more than 15 o ces around the world, we help you make performance-enhancing and defensible compensation decisions in the best interests of your organization.

Written by SIMON AVERY

How does a banker land at the leading edge of artificial intelligence? Shauneen Bruder spent 35 years at Royal Bank of Canada, serving as executive vice-president of operations before retiring in 2019. Today, in addition to serving as chair of Canadian National Railway Co., she is a board member of the Vector Institute, Canada’s largest AI institute cofounded by Nobel Laureate Geoffrey Hinton, who remains Vector’s chief scientific advisor. The Toronto-based organization is recognized internationally for its AI research and helping businesses apply the technology. It is funded by the federal and provincial governments together with a consortium of private businesses. In a recent conversation with Director Journal, Bruder described the inevitability of an AI world and shared ideas for how big and small companies can embrace it.

As a seasoned bank executive, how did you make the transition to the realm of AI?

AI wasn’t unfamiliar to me at all. [At RBC] we were an early adopter of core process and transaction automation, which is kind of a precursor to what we’re seeing in AI. But beyond that, I’ve always understood that this technology has the potential to transform the way we work. It really is a transformational opportunity and for Canada in particular when you look at our productivity challenges across sectors to improve how we work, how we live, [and how we] solve complex problems.

One of the fundamental roles of directors is to understand, and be active and engaged in, strategy and enterprise risk oversight. It’s in that capacity that you start to tiptoe into this AI discussion and need to build your own competency as a director. Great directors have a lot of curiosity, and they are lifetime learners, and they ask great questions of leaders. And you don’t have to be an expert to ask great questions.

How do you find that outlook pairs with the director community? Is that what you’re seeing, or is there some hesitation with AI?

I think there is some trepidation. It’s a whole new taxonomy. It’s a whole new language. We don’t come to this world as technology experts, but we need to appreciate that boards have successfully navigated many technology transformations over the years. The fundamentals of good governance principles apply, and we know how to do this as directors. I think what’s different is AI is a transformational opportunity, and that can be a bit daunting. But the fundamentals of the director role in understanding the risks and the strategic opportunities are no different. No company or director, in my view, can fail to consider the implications of AI.

What advice can you give other directors, who may not have a lot of tech expertise, on how to approach AI?

I actually think it’s comforting to approach it in terms of our fundamental oversight goal. Regularly we review what our competitors are doing. [We ask] what are our critical and emerging enterprise risks? What’s our risk appetite? What’s our tone at the top and our culture around some of these things? We push management on the resourcing, the talent, the skills, the capacity of the corporation, these are all questions that we know how to ask. It is really part of our strategic and

Quelle est votre feuille de route en matière d'IA ?

Il est peut-être temps de poser les grandes questions à la direction.

Comment une banquière peut-elle se retrouver à l’avant-garde de l'intelligence artificielle ? Shauneen Bruder a passé 35 ans à la Banque Royale du Canada, où elle a occupé le poste de vice-présidente exécutive des opérations avant de prendre sa retraite en 2019. Aujourd'hui, en plus d'être présidente du conseil d'administration de la Compagnie des chemins de fer nationaux du Canada (CN Railway), elle est membre du conseil d'administration de l'Institut Vecteur, le plus grand institut d'intelligence artificielle du Canada, cofondé par le lauréat du prix Nobel Geoffrey Hinton, qui demeure le conseiller scientifique principal de Vecteur. L'organisation, située à Toronto, est reconnue internationalement pour ses recherches sur l'IA et pour l'aide qu'elle apporte aux entreprises dans l'application de cette technologie. Elle est financée par les gouvernements fédéral et provincial, ainsi que par un consortium d'entreprises privées. Lors d'un récent entretien avec Director Journal, Mme Bruder a décrit l’inévitabilité du monde de l'IA, en plus de nous faire part de ses idées sur la manière dont les grandes et petites entreprises peuvent l'adopter.

En tant que dirigeante de banque expérimentée, comment avez-vous fait la transition vers le domaine de l'IA ?

L'IA ne m'était pas du tout inconnue. [À RBC], nous avons été les premiers à adopter l'automatisation des processus et des opérations de base, qui est en quelque sorte le précurseur de ce que nous voyons dans l'IA. Mais au-delà de cela, j'ai toujours compris que cette technologie avait le potentiel de transformer notre façon de travailler. Il s'agit vraiment d'une opportunité de transformation et pour le Canada en particulier, si l'on considère nos défis en matière de productivité dans tous les secteurs pour améliorer notre façon de travailler, notre façon de vivre, [et notre façon de] résoudre des problèmes complexes. L'un des rôles fondamentaux des administrateurs est de comprendre la stratégie et la surveillance des risques de l'entreprise, et d'y participer activement. C'est à ce titre que l'on commence à s'immiscer dans le débat sur l'IA et que l'on doit développer ses propres compétences en tant qu'administrateur. Les grands administrateurs sont très curieux ; ils apprennent tout au long de leur vie et posent d'excellentes questions aux dirigeants. Et il n'est pas nécessaire d'être un expert pour poser de bonnes questions.

Comment trouvez-vous que cette perspective va de pair avec la communauté des administrateurs ? Est-ce que c'est ce que vous constatez, ou y a-t-il une certaine hésitation à l'égard de l'IA ? Je pense qu'il y a une certaine appréhension. Il s'agit d'une toute nouvelle taxonomie. C'est un tout nouveau langage. Nous n'arrivons pas dans ce monde en tant qu'experts en technologie, mais nous devons comprendre que les conseils d'administration ont réussi de nombreuses transformations technologiques au fil des ans. Les principes fondamentaux d’une bonne gouvernance s'appliquent, et nous savons comment procéder en tant qu'administrateurs. Je pense que ce qui est différent, c'est que l'IA est une opportunité de transformation, ce qui peut être un peu intimidant. Mais les principes fondamentaux du rôle de l'administrateur, qui consiste à comprendre les risques et les opportunités stratégiques, ne sont pas différents. Aucune

enterprise risk oversight. I think [it’s helpful] to approach AI that way. You can also ask for third-party support.

There are some other things that I’ve seen boards start to do like reviewing your competency matrix and asking whether you have the right technical expertise around the board table. Increasingly, technology literacy is becoming as important as financial literacy in terms of board competencies.

Does adding technical expertise to a board mean giving up some experience and bringing in young directors in their 30s, or is that going too far?

I don’t think the board should aspire to be an expert in the technical complexities of AI. I don’t think that’s necessary. I think the focus of the board should be on understanding the strategic implications and risks of AI. And for that, you don’t need deep domain expertise. You need more governance, strategic and risk oversight. It’s really important that boards understand that their role is oversight. It’s not management. They have to hold management accountable. They have to ask the right questions, but they’re not going to be technical experts, and they shouldn’t be.

Where do you draw the line between AI knowledge the board needs and information that’s best left to the computer scientists?

I think boards need to focus on three things: First, understanding the strategic impact [of AI] on business models and stakeholder value. And there’s an equal or greater risk of missing the strategic opportunity on this, because we tend to be overly indexed on the risks. Second, overseeing risk management and the governance frameworks, and holding management accountable for those. And third ensuring responsible implementation [of AI] that aligns with organizational values.

Does all of this lie at a particular committee level? Or does it need to be across the board?

It depends on the organization. My own bias is that AI is going to be so pervasive to most companies that you need to build a level of overall board literacy and accountability to understand the strategy and the risks.

What do you think the next phase of AI will be?

My view is that AI is going to become deeply integrated in everything we do. It’s going to become a pervasive capability, much like the

entreprise ni aucun administrateur ne peut, à mon avis, ne pas prendre en compte les implications de l'IA.

Quels conseils pourriez-vous donner à d'autres administrateurs, qui n'ont peut-être pas beaucoup d'expertise technologique, sur la façon d'aborder l'IA ?

En fait, je crois qu'il est plus rassurant de l'aborder sous l'angle de notre objectif fondamental en matière de surveillance. Nous examinons régulièrement ce que font nos concurrents. [Nous nous demandons] quels sont les risques critiques et émergents de notre entreprise ? Quelle est notre appétence pour le risque ? Quel est notre ton au sommet et quelle est notre culture par rapport à certains de ces éléments ? Nous poussons la direction à se pencher sur les ressources, les talents, les compétences, la capacité de l'entreprise, autant de questions que nous savons déjà poser. Cela fait vraiment partie de notre stratégie et de la surveillance des risques d'entreprise. Je pense [qu'il est utile] d'aborder l'IA de cette manière. Vous pouvez également demander l’aide d'un tiers.

Shauneen Bruder ICD.D

Chair of CN Railway

Director at the Vector Institute

Honorary Consul for Luxembourg in Toronto

Previous roles:

Chair of the Board of Governors, University of Guelph

Chair of the Canadian Chamber of Commerce

Chair of the Canadian American Business Council

Présidente de la Compagnie des chemins de fer nationaux du Canada (CN Railway)

Directrice de l'Institut Vecteur

Consul honoraire du Luxembourg à Toronto

Rôles précédents :

Présidente du conseil d'administration de l'Université de Guelph

Présidente de la Chambre de commerce du Canada

Présidente du Canadian American Business Council

Il y a d'autres choses que j'ai vu les conseils d'administration commencer à faire, comme revoir leur matrice de compétences et se demander s'ils disposent de la bonne expertise technique autour de la table du conseil d'administration. De plus en plus, les connaissances technologiques deviennent aussi importantes que les connaissances financières en termes de compétences du conseil d'administration.

L'ajout d'une expertise technique au sein d'un conseil d'administration implique-t-il de renoncer à une certaine expérience et de faire appel à de jeunes administrateurs d'une trentaine d'années, ou est-ce aller trop loin ?

Je ne pense pas que le conseil d'administration doive aspirer à devenir un expert des complexités techniques de l'IA. Je ne crois pas que cela soit nécessaire. Je pense que le conseil d'administration devrait se concentrer sur la compréhension des implications stratégiques et des risques de l'IA. Et pour cela, vous n'avez pas besoin d'une expertise approfondie du domaine. Il faut davantage de gouvernance, de surveillance stratégique et de contrôle de risques. Il est vraiment important que les conseils d'administration comprennent que leur rôle est de superviser. Ce n'est pas de la gestion. Ils doivent demander des comptes à la direction. Ils doivent poser les bonnes questions, mais ils ne seront pas des experts techniques et ils ne devraient pas l'être.

Où se situe la limite entre les connaissances en IA dont le conseil d'administration a besoin et les informations qu'il vaut mieux laisser aux informaticiens ?

Je pense que les conseils d'administration doivent se concentrer sur trois points. D’abord, comprendre l'impact stratégique [de l'IA] sur les modèles d'entreprise et la valeur

internet. It’s moving so fast no sector can ignore it. Each company has to ask management what immediate opportunities exist [for AI] to improve efficiency and effectiveness. It has to be business-led it can’t be technology for innovation’s sake. It has to be focused on solving business problems and then asking how could the competitive environment change?

Well, let’s take autonomous agents as an example. How close are those to becoming widespread in business?

No company or director, in my view, can fail to consider the implications of AI.

« À mon avis, aucune entreprise ni aucun administrateur ne peut ne pas prendre en compte les implications de l'IA. »

I can’t make predictions about autonomous agents, but I do think that we are seeing solutions that are allowing people to move beyond routine tasks, so it’s more of a collaborative application, as opposed to autonomous, discrete applications. Forward looking companies are using AI responsibly, and they’re investing in people so that AI is enhancing rather than replacing human potential. So, I think initial deployments are collaborative assists. They’re not autonomous. And I’m also seeing companies investing a lot in AI literacy to look at how you can accelerate business applications that leverage data to increase productivity.

We don’t have laws yet in Canada specifically directed at AI although the EU is further ahead. For boards that have to allocate capital, how delicate a walk is it investing in technology that may get pulled back by regulations? Similar to any new capability, it’s important for boards to ask management for their roadmap for AI adoption. Successful AI integration requires a comprehensive, strategic approach. It is ultimately going to be an organizational transformation, and like any big organizational change initiative, it’s going to need clear principles. It’s going to need broad literacy and adjusted governance and control mechanisms so that you can control for the unknowns.

Boards have to query management to understand the capabilities that are going to be required. You can’t approach this without the kind of a data environment and technology stack that is capable of supporting AI. So that’s the first bar, you need architecture maturity that ensures that your data can be consumed. You need to think about your talent how are you re-skilling your workforce? Do you have data scientists? Do you have PhDs in machine learning? Do you need them? Can you buy them? Can you use third parties? What’s your organizational culture for innovation and change, and the ability to move at the speed of AI, and what’s your governance and control environment? So those are legitimate

des parties prenantes. Il existe un risque égal ou supérieur de manquer l'opportunité stratégique dans ce domaine, car nous avons tendance à trop nous focaliser sur les risques. Ensuite, superviser la gestion des risques et les cadres de gouvernance, et tenir la direction responsable de ces éléments. Et finalement, veiller à une mise en œuvre responsable [de l'IA] qui s'aligne sur les valeurs de l'organisation.

Tout cela relève-t-il d'un comité particulier ? Ou cela doit-il s'appliquer à l'ensemble de l'organisation ?

Cela dépend de l'organisation. Je crois que l'IA sera tellement omniprésente dans la plupart des entreprises qu'il faudra que le conseil d'administration ait un niveau de connaissances et de responsabilités suffisant pour comprendre la stratégie et les risques.

Selon vous, quelle sera la prochaine phase de l'IA ?

Je crois que l'IA va être profondément intégrée dans tout ce que nous faisons. Elle va devenir une capacité omniprésente, à l'instar d'internet. Elle évolue si rapidement qu'aucun secteur ne peut l'ignorer.

Chaque entreprise doit demander à sa direction quelles sont les opportunités immédiates [pour l'IA] d'améliorer l'efficacité et l'efficience. Elle doit être pilotée par l'entreprise il ne peut s'agir de technologie pour le plaisir d'innover. Elle doit se concentrer sur la résolution de problèmes de l'entreprise et se demander par la suite ; comment l'environnement concurrentiel pourrait-il changer ?

Prenons l'exemple des agents autonomes. Dans quelle mesure ces agents sont-ils sur le point de se répandre dans les entreprises ?

Je ne peux pas faire de prédictions sur les agents autonomes, mais je crois que nous voyons des solutions qui permettent aux gens d'aller au-delà des tâches routinières, de sorte qu'il s'agit davantage d'une application collaborative que d'applications autonomes et discrètes. Les entreprises tournées vers l'avenir utilisent l'IA de manière responsable et investissent dans le personnel afin que l'IA renforce le potentiel humain au lieu de le remplacer. Je pense donc que les premiers déploiements sont des aides à la collaboration. Ils ne sont pas autonomes. Je constate également que les entreprises investissent beaucoup dans la maîtrise de l'IA afin de déterminer comment accélérer les applications commerciales qui exploitent les données pour accroître la productivité.

Au Canada, nous n'avons pas encore de lois spécifiquement axées sur l'IA — bien que l'UE soit plus avancée. Pour les conseils d'administration qui doivent allouer des capitaux, est-il délicat d'investir dans une technologie qui pourrait être freinée par des réglementations ?

Comme pour toute nouvelle capacité, il est important que les conseils d'administration demandent à la direction sa feuille de route pour l'adoption de l'IA. Une intégration réussie de l'IA nécessite une approche stratégique globale. Il s'agira en fin de compte d'une transformation organisationnelle et, comme pour toute grande initiative de changement organisationnel, il faudra des principes clairs. Elle nécessitera une large sensibilisation et des mécanismes de gouvernance et de contrôle adaptés afin de pouvoir maîtriser les inconnues. Les conseils d'administration doivent interroger la direction pour comprendre les capacités qui seront nécessaires. Il est impossible d'aborder cette

questions for the board to make sure that the company is ready to address the risks.

What do you consider to be some of the best practices used in AI deployment right now?

In terms of best practices, especially for small companies, you can do some testing and learning in small deployments. You know the quality of the data is critical. You’ve got to keep a human in the loop. I would not use AI for any critical decisions at this point. I think companies with complex safety and financial risks really need to proceed carefully because the stakes are higher.

Do you have any specific guidance for small and medium-sized businesses?

Increasingly, technology literacy is becoming as important as financial literacy in terms of board competencies.

« De plus en plus, la culture technologique devient aussi importante que la culture financière en termes de compétences du conseil d'administration. »

The Vector Institute and its sister organizations [the Montreal Institute for Learning Algorithms (MILA) and the Alberta Machine Intelligence Institute (Amii)] can help. Vector, for example, has a program called Fast Lane that’s helped more than 250 companies implement AI solutions such as customer support engines, search engines and reservation engines.

Does the Vector Institute work with large enterprises too?

Yes, Vector offers partnership opportunities that include access to talent, professional development programming if you want to develop AI literacy within your organization and [the chance] to tap into leading-edge research and development coming out of universities.

You mentioned that you wouldn’t want to use AI for any critical decision making at this point. What advancements would you need to see to increase your comfort level there? You’ve got to be certain of the quality of your data, the quality of your business models, the ability of your technology to eliminate bias, and the quality of your control environment. I wouldn’t deploy [AI] for diagnostics in health care, for example, without a human in the loop. You need a second set of eyes on this in order to really use AI for life-critical decisions. You would want an extraordinary level of 99.9999 per cent confidence in your models. And you know, as a director, I certainly wouldn’t suggest that I’ve seen that kind of confidence yet.

The terms “artificial general intelligence” and “superintelligence” are getting thrown around a lot?

question sans disposer d'un environnement de données et d'un ensemble de technologies capables de prendre en charge l'IA. C'est donc la première barre ; vous avez besoin d'une maturité d'architecture qui garantit que vos données peuvent être consommées. Vous devez aussi penser à vos talents comment vous requalifiez votre main-d'œuvre ? Avez-vous des scientifiques de données ? Avez-vous des docteurs en apprentissage automatique ? En avez-vous besoin ? Pouvez-vous les acheter ? Pouvez-vous faire appel à des tiers ? Quelle est votre culture organisationnelle pour l'innovation et le changement, et la capacité d'évoluer à la vitesse de l'IA, et quel est votre environnement de gouvernance et de contrôle ? Ce sont donc des questions légitimes pour le conseil d'administration afin de s'assurer que l'entreprise est prête à faire face aux risques.

Quelles sont, d’après vous, les meilleures pratiques utilisées dans le déploiement de l'IA à l'heure actuelle ?

En termes de meilleures pratiques, en particulier pour les petites entreprises, vous pouvez faire des tests et apprendre dans le cadre de petits déploiements. Vous savez que la qualité des données est essentielle. Il faut garder un être humain dans la boucle. Pour l'instant, je n'utiliserais pas l'IA pour prendre des décisions critiques. Je crois que les entreprises confrontées à des risques financiers et de sécurité complexes doivent procéder avec prudence, car les enjeux sont plus importants.

Avez-vous des conseils spécifiques à donner aux petites et moyennes entreprises ?

L'Institut Vecteur et ses organisations sœurs [l'Institut québécois d’intelligence artificielle ou MILA, et l'Alberta Machine Intelligence Institute (Amii)] peuvent les aider. Vector, par exemple, a un programme nommé Fast Lane qui a aidé plus de 250 entreprises à mettre en œuvre des solutions d'IA telles que des moteurs de soutien à la clientèle, des moteurs de recherche et des moteurs de réservation.

L'Institut Vector travaille-t-il également avec les grandes entreprises ?

Oui, Vector offre des possibilités de partenariat qui comprennent l'accès aux talents, des programmes de développement professionnel si vous souhaitez développer des compétences en matière d'IA au sein de votre organisation et [la possibilité] de tirer parti de la recherche et du développement de pointe réalisés par les universités.

Vous avez mentionné que vous ne souhaiteriez pas utiliser l'IA pour la prise de décisions critiques à ce stade. Quelles sont les avancées dont vous auriez besoin pour vous sentir plus à l'aise dans ce domaine ?

Vous devez être certain de la qualité de vos données, de la qualité de vos modèles commerciaux, de la capacité de votre technologie à éliminer les biais et de la qualité de votre environnement de contrôle. Je ne déploierais pas [l'IA] pour des diagnostics dans le domaine de la santé, par exemple, sans qu'il y ait un humain d’impliqué dans le processus. Il est nécessaire de disposer d'une

Should they be part of the discussion right now, or are they more conceptual?

I think boards create more value right now by ensuring that their organizations have the right principles, the right literacy, the right governance instruction and structures in place to handle AI developments as they emerge, and then you hold management accountable for those regular strategic horizon scans [to stay] competitive.

Canadian companies are facing criticism for their slowness to adopt AI. What’s your assessment of the situation in Canada?

We know Canada is behind. I think it’s never been more important when you look at our productivity and competitive challenges. So Canadian companies have to get AI right. They have to capture the opportunity, and they have to make sure that they safely and responsibly use AI. The greatest risk is that we miss out on the opportunity and its economic and social benefits. We know how to manage the risks. I think we need to capture the opportunity.

When you say “miss out,” do you mean the train is leaving the station, or can businesses legitimately hold back, see what others do, and then leap ahead?

Canadian universities produce more AI talent [than most countries], and we need to hold on to that talent. We need to deploy it nationally. We need to make sure that the infrastructure is there. Canada doesn’t have enough [computing power] relative to what other countries are investing in to support the large language models, both their development and their use. So yes, there is [a legitimate concern] that we will miss out and get left behind, or won’t be in control of our own destiny if we don’t invest in retaining the extraordinary talent that we produce, in supporting businesses so we don’t lose them to other environments when they reach a level of maturity, and in making sure that we’ve got the infrastructure in place to support AI.

Where does the drive to adopt AI need to come from?

The government gets blamed a lot, but ultimately, it’s boards that are in charge of capital deployment. It’s back to the fundamental role that boards have to oversee strategy and risk. When you talk about missing out on opportunities, that’s a strategic question that boards need to be asking management. How are you thinking about leveraging the opportunities of AI? Where can you deploy it, for efficiency, for effectiveness? What are our competitors doing? What are the trends? Those are governance oversight questions that Canadian boards need to be asking. Organizations have a lot of competition for where to deploy capital, but it needs to be dictated by some of these medium and longer-term strategic questions.

deuxième paire d'yeux pour pouvoir réellement utiliser l'IA dans le cadre de décisions vitales. Il faudrait un extraordinaire niveau de confiance de 99,9999 % dans vos modèles. Et vous savez, en tant que directrice, je ne dirais pas que j'ai déjà vu ce genre de confiance jusqu’ici.

Les termes « intelligence générale artificielle » et « superintelligence » sont souvent utilisés. Devraient-ils faire partie de la discussion dès maintenant, ou sont-ils plus conceptuels ?

Je pense que les conseils d'administration créent plus de valeur en ce moment en s'assurant que leurs organisations ont les bons principes, la bonne culture, les bonnes instructions et structures de gouvernance en place pour gérer les développements de l'IA au fur et à mesure qu'ils émergent, puis en demandant à la direction de rendre compte de ces analyses stratégiques régulières [pour rester] compétitives.

Les entreprises canadiennes sont critiquées pour leur lenteur à adopter l'IA. Quelle est votre évaluation de la situation au Canada ?

Nous savons que le Canada est en retard. Je pense que cela n'a jamais été aussi important si l'on considère nos défis en matière de productivité et de compétitivité. Les entreprises canadiennes doivent donc bien maîtriser l'IA. Elles doivent saisir l'opportunité et s'assurer qu'elles utilisent l'IA de manière sûre et responsable. Le plus grand risque est de passer à côté de cette opportunité et de ses avantages économiques et sociaux. Nous savons comment gérer les risques. Je pense que nous devons saisir l'occasion.

Lorsque vous dites « passer à côté », voulez-vous dire que le train quitte la gare ou que les entreprises peuvent légitimement attendre pour voir ce que les autres font avant de faire un bond en avant ?