EDITORIAL

Mientras escribimos estas líneas, la centésima edición de NAB Show Las Vegas llega a su fin. Una amplia representación de esta revista ha recorrido todos los pasillos del Convention Center para recoger con detalle lo más novedoso de esta feria, una de las citas más importantes de nuestro mercado.

Aunque el número de asistentes está todavía lejos de las cifras pre pandemia, la organización espera que en esta edición haya subido considerablemente. En 2022 52,000 personas visitaron la feria, incluyendo fabricantes de tecnología, empresas de radiodifusión, cineastas, productores, periodistas y muchos otros profesionales de la industria. Lejos queda la cifra de los casi 100,000 asistentes de 2019, pero sin duda en 2023 veremos un aumento de los visitantes respecto al año pasado, en breve la organización hará públicos sus datos y saldremos de dudas.

Las ferias tecnológicas son una parte integral del desarrollo y la innovación en cualquier campo. Representan una oportunidad

única para que las empresas presenten sus últimos productos y servicios a un público global y para que los asistentes descubran nuevas tendencias y tecnologías emergentes en su campo de trabajo. Los fabricantes de tecnología pueden presentar sus últimas invenciones y recibir comentarios directos de los usuarios finales, lo que puede ayudar a mejorar y perfeccionar sus productos. Además, son una fuente crucial de información y educación para los profesionales de la industria. Los visitantes pueden asistir a sesiones de conferencias y talleres sobre temas relevantes del sector y aprender de expertos y líderes en su campo. Sin duda el teletrabajo ha llegado para quedarse en muchos puestos de trabajo, pero nada como el cara a cara para cerrar negocios y expandir nuestras relaciones comerciales. Contentos de haber hecho las maletas un año más, nos veremos de nuevo en unos pocos meses en IBC, la gran cita europea para el Broadcast.

Editorial EDITORIAL TM Broadcast 3

EDITOR

Javier de Martín editor@daromediagroup.com

DIRECCIÓN DE CONTENIDOS

Mercedes González mercedes.gonzalez@tmbroadcast.es

DIRECCIÓN ADMINISTRACIÓN

Laura de Diego laura.dediego@daromediagroup.com

DIRECCIÓN COMERCIAL

Javier M. Gutiérrez jmg@tmbroadcast.es

PUBLICIDAD

Sergio Castaño sergio.castano@tmbroadcast.es

Patricia Pérez ppt@tmbroadcast.com

REDACCIÓN redaccion@tmbroadcast.es

MAQUETACIÓN

Sorex Media

COLABORADORES

Yeray Alfageme

Carlos Medina

Luis Pavía

Carlos Alberto Martín

Javier Guerra

Luis Sanz

Alfonso Redondo

José Luis Cordero

Carlos González

Fernando Suárez

SUSCRIPCIONES

suscripciones@tmbroadcast.es

Imprime: IMEDISA ARTES GRÁFICAS S.L.

Dep. legal: M-11254-2008

ISSN: 1888-6965

Impreso en España en abril de 2023

TM Broadcast no se hace responsable de las opiniones vertidas en los reportajes e informaciones firmadas. Todos los derechos reservados. Esta publicación no puede ser reproducida ni en todo ni en parte en ningún medio impreso ni electrónico, ni registrada en, ni transmitida por cualquier sistema sin permiso previo por escrito de la editorial.

TM Broadcast es una publicación de Daró Media Group S.L.

Centro Empresarial Tartessos

Calle Pollensa 2, Oficina 14 28290 Las Rozas, Madrid.

Tf: 91 640 46 43

6

Actualidad

15

The Viewfinder, por Yeray Alfageme

16

Producción técnica de RTVE para la emisión en España de la Copa Mundial de la FIFA

Qatar 2022 y prueba de concepto de producción en nube pública

RTVE ha desplazado a Qatar a más de 80 profesionales para la producción técnica para España de la Copa Mundial de la FIFA 2022, emitida a través de sus plataformas de televisión, radio y servicios interactivos. Entre los partidos y los programas deportivos previos y post, las dos cadenas La 1 y Teledeporte han efectuado más de 65 horas de emisión TDT.

Producción virtual con Grup Mediapro

Entrevista con Emili Planas, CTO y Operations Manager en el grupo audiovisual, para conocer en profundidad cómo la compañía está desarrollando esta tecnología.

4 SUMARIO SUMARIO

36

Experiencias de multimedia audiovisual sobre redes 5G 44

50

5G MAG

La red 5G está preparada para la contribución de actualidad, solo hace falta que los operadores móviles y la industria broadcast se comuniquen

eSerie A TIM

Alessandro Lonati, Director de Infront Productions, y el equipo de gestión de proyectos de Thomas Borghi, Alessandro Zampini y Andrea Mariani, explican cómo se produce esta competición y cuáles son los desafíos más importantes que han tenido que superar.

62

El efecto de la IA sobre la producción remota en la industria de la difusión

Artículo de: Saket Dandotia- Director de operaciones y cofundador de Magnifi

64

¿Puede la tecnología basada en la nube ayudar a los broadcasters a adaptar los contenidos informativos para satisfacer la exigencia de inmediatez de los usuarios?

Artículo de: Olivier Bovis, director de soluciones multimedia de Sony Europe

SUMARIO TM Broadcast 5

56

TM Broadcast en NAB Show 2023

Primer día

TM Broadcast se ha acercado hasta NAB Show 2023 para descubrir de primera mano las novedades del sector broadcast y daros a conocer las últimas soluciones del mercado. La feria inició el sábado 15 de abril, en su edición número 100, en Las Vegas Convention Center y concluirá el miércoles que viene.

El evento se inició con el desayuno que celebra cada año la asociación IABM para repasar el estado de los diferentes aspectos y la evolución técnica del sector. Peter White, CEO de IABM, presentó los resultados del último estudio realizado sobre el estado de la industria broadcast. El estudio analizó temas como los desafíos macroeconómicos actuales, una disminución en el número de

suscriptores y el aumento en la oferta de hardware y servicios. Se señaló, entre otros aspectos, la escasez de talento en la industria y exploró la transición de la radio al vídeo, así como la importancia de la participación de los espectadores.

A continuación, pudimos conocer algunas de las novedades que los expositores han traído a Las Vegas. En esta primera jornada nos centramos en el pabellón oeste, el más extenso y novedoso de la feria.

AWS presentó varias novedades relacionadas con el mundo del entretenimiento y los medios de comunicación, como sus nuevas soluciones basadas en inteligencia artificial y aprendizaje automático para mejorar la calidad de los contenidos y la experiencia del usuario.

Por otra parte, pudimos ver nuevas soluciones de almacenamiento y procesamiento de datos en la nube. Además, la compañía anunció nuevas herramientas de análisis y monitoreo de la audiencia, así como soluciones para mejorar la seguridad en la distribución y transmisión de contenidos.

Con Vizrt pudimos conocer novedades relacionadas con la tecnología de producción de contenido. Entre las principales novedades destacó la adquisición de Fluix para la plataforma HTML5 y presentaron tres nuevos productos: Vizrt Engine, Real Engine Parallel Control y Vizrt Arena Outdoor AR, que ofrecen soluciones de control en tiempo real y tecnología de realidad aumentada para eventos deportivos en exterio-

Actualidad 6 NOTICIAS TM Broadcast NAB SHOW 2023

res. Además, la compañía comunicó que toda su cartera de productos estará disponible tanto en nube como en plataformas locales para sus clientes, con una fuerte presencia en los principales proveedores de nube, especialmente en AWS. La compañía también exhibió sus soluciones SaaS Pure y Tricaster Flex Control Panel.

Entre las novedades de GatesAir destacaron un transmisor de alta potencia para AM, FM y DTV, que va desde bajas a altas potencias. También expuso una aplicación móvil que permite monitorear y controlar los transmisores de forma remota. Por último, pudimos conocer un sistema de amplificación con «hot swappable» que permite el intercambio de módulos de potencia sin interrumpir la transmisión.

Vislink dio a conocer sus últimas novedades en soluciones de enlace de vídeo basadas en 5G, drones y AI. La compañía enfatizó en la calidad y estabilidad de sus soluciones de enlace de vídeo, que incluyen la detección de puntos destacados en las transmisiones en vivo. Además, presentó su «Camera, encoder and lighting in a box», que se utiliza en shows en vivo para transmitir fácilmente.

Por su parte, Signiant presentó sus novedades como proveedor digital nativo, en el cual destacaron las economías de escala para el procesamiento de contenido. La compañía mostró soluciones de software como servicio (SaaS) para la gestión de intercambio de contenidos, agregación y distribución en 3 plataformas de nube pública: AWS, Azure y

Google. También enseñó soluciones de flujo de trabajo en la nube, que permiten la transferencia de archivos de un proveedor a otro.

Por último nos acercamos al stand de AJA, al cual han traído sus últimas novedades en equipamiento de enlace de vídeo. La compañía presentó su nueva capacidad de códec para Bridge Live, una combinación de hardware y software que incluye opciones de JPEG XS y múltiples códecs de streaming. Además, anunció su Bridge NDI de hasta 16 canales.

Segundo día

Tras un primer día apasionante en el West Hall, donde los expositores nos mostraron no ya el futuro sino el nuevo presente, en este segundo día nos hemos dirigido al hall central que, junto con el próximo hall norte, engloba soluciones y equipamiento más reconocible y consolidado.

Antes de dirigirnos al centro de convenciones de Las Vegas hicimos una parada en el hotel Westgate, donde EVS y Arista celebraron un desayuno mostrando interesantes

casos de uso y proyectos conjuntos. Durante el evento, Gerard Philips de Arista destacó la importancia de la comunicación constante para escuchar las necesidades de los clientes y satisfacerlas. Por su parte, Néstor Amaya de EVS habló sobre la importancia de la facilidad de uso y la flexibilidad para utilizar redes IP en entornos de producción de medios, y destacó la automatización de los despliegues como clave para una gran puesta en marcha. También se destacó la importancia del soporte para ofrecer soluciones excelentes.

Kevin Callahan de Fox Sports explicó que buscaban una solución fácil de implementar, escalable y flexible, y que el estándar SDI no cumplía con estas necesidades. Por lo tanto, emitieron una solicitud de propuestas a todos los proveedores, y Arista y EVS resultaron ser la mejor opción. Se desplegaron dos flypacks totalmente redundantes para el Super Bowl, la Copa Mundial de la FIFA y otros eventos importantes, todo con señales basadas en IP 2110. El resultado es un espacio cómodo donde la tecnología IP ya no es un problema. Se pasó de días de imple-

Actualidad NOTICIAS TM Broadcast NAB SHOW 2023 8

mentación a horas con una operación más sencilla.

También se destacó que la implementación de sistemas basados en IP es mucho más rápida que la de sistemas basados en SDI. En el viaje hacia IP 2110, las pruebas son clave para descubrir problemas de interoperabilidad. IP es la mejor solución debido a su escalabilidad, flexibilidad y garantía de futuro. Al mirar a largo plazo, SDI no es una opción.

Se mencionó que el Super Bowl se emitió en 1080p HDR y que se puede pasar a 4K en el futuro. Para este nuevo escenario, EVS desarrolló nuevas herramientas y habilidades, haciéndolas reutilizables. Se destacó que las especificaciones técnicas excelentes son clave para el éxito.

Ya en el pabellón central del centro de convenciones, BirdDog presentó varias novedades en su catálogo de productos. Una de ellas es la cámara PTZ X120, que ofrece una calidad de imagen excepcional y cuenta con tecnología NDIHX2 y 3 a un precio más accesible. Además, la cámara tiene conectividad WiFi, salida HDMI y SDI lineal, y funciona

como una webcam USB. También presentaron un control remoto para PTZ con actualizaciones de software y control. Además, lanzaron un software de producción remota que se integra con Adobe Cloud y una capa para Adobe Premiere que permite la edición colaborativa. La compañía también presentó AppleTV BirdDog Cloud, una versión para ver cualquier fuente NDI en la pantalla grande de manera remota a través de internet, que incluye control PTZ. Estas soluciones también están disponibles para dispositivos Android y iOS, con una app para control PTZ de todas las cámaras, fuentes NDI y PTZ de BirdDog.

Sennheiser ha mostrado sus novedades para cineastas, equipos de ENG y creadores de contenido con el lanzamiento del receptor portátil inalámbrico digital G3 y G4. Con un rango de 134 metros sin ningún tipo de control en el transmisor y un retraso de solo 1,9 milisegundos, estos dispositivos ofrecen una gran calidad de sonido. Además, se pueden controlar a través de una aplicación móvil por Bluetooth, y la sincronización entre transmisor y receptor

también se realiza por Bluetooth. Con un soporte magnético para un fácil montaje, estos receptores ofrecen una gran flexibilidad y facilidad de uso. También se ha presentado un nuevo transmisor para micrófonos de mano que incluye alimentación phantom y grabación local en tarjeta micro-SD.

Riedel exhibió varias novedades, entre las cuales destaca el nuevo panel Artist, el cual combina tres paneles en uno y cuenta con aplicaciones instalables para intercomunicación, monitoreo y control. Además, este panel tiene la capacidad de controlar cualquier dispositivo en la red y cuenta con integraciones con Dataminer y Pebble. También se ha agregado la capacidad Dante para el intercomunicador Artist. Por otro lado, se presentó la versión 2.4 GHz de Bolero, el sistema inalámbrico de intercomunicación de Riedel, que ofrece una mayor cobertura y rendimiento.

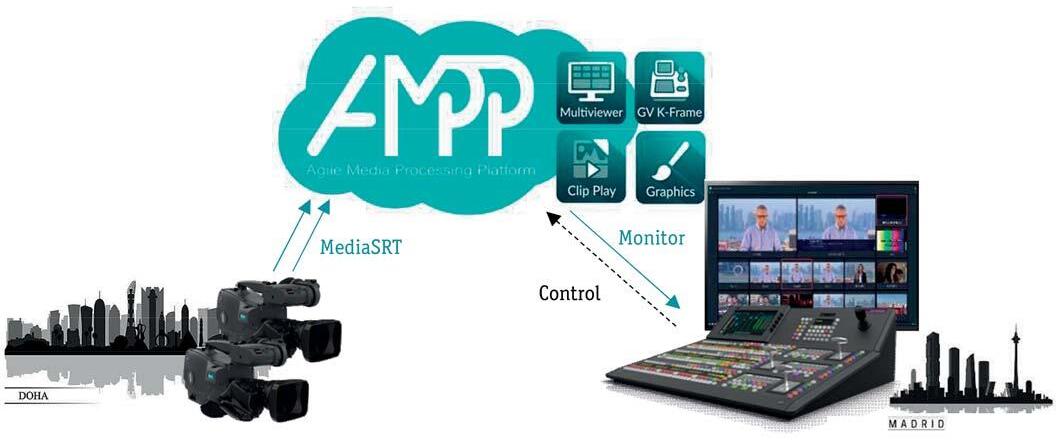

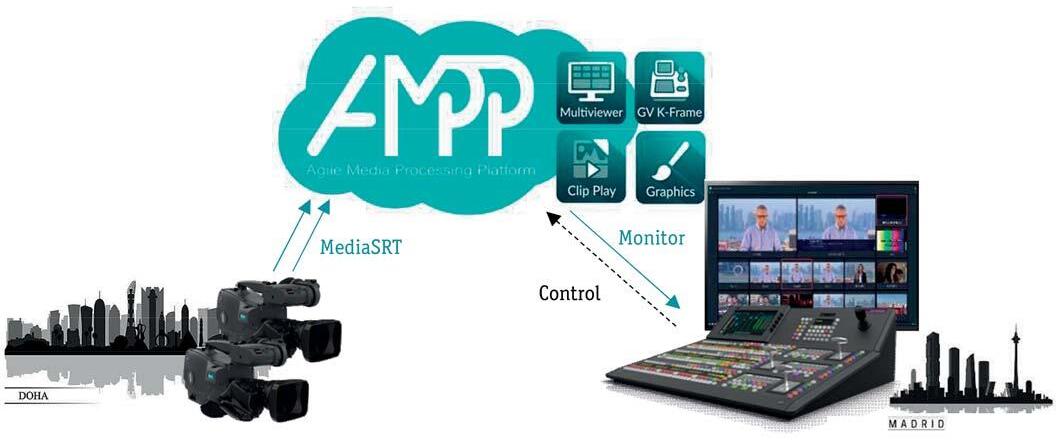

Grass Valley presentó su línea de productos consolidada con un enfoque en soluciones únicas por dispositivo. AMPP es la plataforma de producción y playout que puede hacer todo el hardware en un software centralizado, con integraciones tanto nativas como de terceros. Se presentó un programa de colaboración con hasta 15 socios en la feria. AMPP se puede ejecutar en hardware local como GV AMPP server o hardware IT estándar, así como en la nube con los tres principales proveedores. También se ofrece una opción de computación híbrida. La única opción de modelo es SaaS para AMPP y las aplicaciones. AMPP

Actualidad

NOTICIAS TM Broadcast 10 NAB SHOW 2023

incluye un sistema MAM y soluciones de playout, y es una plataforma abierta basada en microservicios que cubre todo el proceso de producción desde la adquisición hasta el playout. AMPP comenzó su desarrollo en 2016 y se lanzó en 2020, y es una solución única en la industria con clientes como RTVE, Canal+ y Eurosport.

RTS enseñó varias novedades en su stand, entre ellas la demostración de ST2110 para producción móvil, un sistema de intercomunicación con redundancia completa en dos redes diferentes. También presentaron Odin, que tiene la capacidad de ingesta, intercambio y distribución de diferentes formatos de audio

como 2110, 2022 y Dante, y DSPK, un altavoz digital con actualizaciones de firmware y hardware para su uso con la matriz de intercomunicación y la línea de fiesta digital de RTS. El modelo DSPK-4 cuenta con conectividad adicional a través de USB y Bluetooth. Además, presentaron la caja de color Dante para proveedores de terceros y la caja de compatibilidad NMOS para todos los dispositivos NMOS.

Por su parte, Phabrix ha presentado dos nuevos productos: el QxP portable rasterizer y el QxL con más potencia e interfaces. Ambos dispositivos pueden ser alimentados por batería o AC, y cuentan con fuentes de alimentación redundantes.

Además, tienen una pantalla multitáctil y una interfaz de usuario completamente nueva. Ambos dispositivos tienen salida de vídeo a través de HDMI e IP 2110, y el QxL tiene opciones adicionales para SDI. Estos dispositivos son completamente capaces de Dolby, pero solo en audio. El QxP y el QxL fueron lanzados hace un mes.

Hitachi mostró su cámara Skuhd7000-s2 con un chipset nativo de 4K y obturador de alta velocidad. La versión 1080p tiene licencia para actualizarse a 4K en el futuro, así como una licencia de cámara lenta. Esta actualización solo requiere una licencia única y no hay cambios de hardware, solo una actualización de

Actualidad NAB SHOW 2023

firmware. La cámara está enfocada en la flexibilidad, con múltiples formatos de salida en cada uno, UHD y múltiples velocidades de cuadro simultáneamente, incluyendo HDR. Si es necesario, la cámara puede disparar fuera de los estándares. Además, cuenta con una entrada SDI en la cámara, alimentación por promotor, un solo cable de fibra, puerto USB para alimentación externa y un conector minijack. También se esperan nuevos visores de LCD a color y OLED.

ClearCom ha exhibido una serie de novedades en su sistema de intercomunicación, entre ellas, los flujos de trabajo de inicio de sesión Roleplace. Además, han introducido la personalización de perfiles de panel de intercomunicación basada en llaves USB, que se crean en el software y se eliminan automáticamente una vez que se retira la llave. También han desarrollado una herramienta de producción dinámica para el intercomunicador, que permite configurar todas las fuentes en una línea de fiesta o en fuentes de audio IP, y se pueden crear perfiles de líneas de intercomunicación e IFB. Estas mejoras proporcionan una mayor flexibilidad y personalización en el uso del sistema de intercomunicación ClearCom.

Telemetrics presentó un nuevo robot inalámbrico para el control y movimiento automatizado de cámaras. Este robot es completamente inalámbrico y puede utilizarse con diferentes tipos de cámaras. Además, cuenta con cámaras ópticas en la parte trasera que siguen los puntos de vista con una precisión de

1mm, así como con 3 escáneres láser para detener el movimiento ante la aproximación de obstáculos, con una iluminación clara para su reconocimiento visual. También cuenta con planificación de rutas para automatizar el movimiento hasta 10 horas, intercomunicación entre robots para evitar interrupciones de imagen y seguimiento de rostros y objetos, incluyendo una función de reframing durante el seguimiento.

Hollyland ha traído a la feria varias novedades, entre ellas una cámara compacta para transmitir y grabar mediante WiFi, Bluetooth y con salidas HDMI y USB. La cámara cuenta con lentes fijas y un panel de control Android incorporado. Permite realizar streaming directo en redes sociales, grabar en posición vertical y horizontal, y es compatible con baterías estándar y alimentación DC. Este producto tiene previsto su lanzamiento para junio o IBC. Además, Hollyland ha presentado un nuevo monitor inalámbrico de 7 pulgadas con dos puertos para baterías, receptor y monitor integrados en un solo dispositivo con pantalla LCD.

Marshall ha mostrado varias novedades en sus cámaras POV, incluyendo un nuevo sensor Sony y extensiones de cámaras con NDI, PoE y HDMI. Además, han introducido una cámara PTZ de alta definición genlock de 12G-SDI. Marshall también está haciendo un esfuerzo por ir hacia la tecnología IP con NDI y Dante, y ofrecen opciones de streaming con Zixi y SRT compatible, así como también USB. Aunque estas cámaras ofrecen una definición 4K, no incluyen HDR ni WCG.

Por último, Audinate ha presentado novedades relacionadas con su tecnología Dante para vídeo. Entre ellas se encuentra el Dante controller, que permite controlar y configurar dispositivos de audio y vídeo en una red Dante. Además, han lanzado el AJA Dante box, que proporciona interoperabilidad entre las soluciones Dante y AJA, y es compatible con la resolución UHD. Asimismo, han desarrollado el Dante Ultra, una solución que ofrece una alta calidad de audio y vídeo con una sincronización total entre ambos. Estas novedades de Audinate permiten una integración completa de los sistemas de audio y vídeo a través de la tecnología Dante.

Tercer día

Tercer y último día en NAB Show para TM Broadcast y ha terminado por todo lo alto. Esta última jornada la hemos dedicado al hall norte, el cual es continuidad del central con más expositores broadcasts reconocidos y con gran historia en el sector. Veamos qué novedades nos han dejado.

Matrox ha presentado una solución híbrida llamada Matrox Origin que permite migrar de forma incremental a la nube, de una manera que tenga sentido para el negocio. Cuenta con una plataforma de desarrollo tanto en la nube como en las instalaciones físicas, ofreciendo una solución sin compromisos con cambios de imagen limpios y responsivos y distribución de baja latencia por debajo de un segundo. Además, es multiformato para producir múltiples versiones de la misma fuente y virtualizar para ser escalable, confiable, ágil, reducir costos utilizando

Actualidad

NAB SHOW 2023 NOTICIAS 12 TM Broadcast

el modelo de pago por uso, ser flexible y sostenible. La clave es el procesamiento síncrono, procesar más rápido que en tiempo real para sincronizar todo al final, y está basada en microservicios API con interfaz HTTP Rest, incluyendo análisis y métricas.

Quantum ha mostrado Storenext 7.1 en abril, el cual incluye nuevas características. Además, presentó Myriad, un almacenamiento totalmente flash centrado en la animación, VFX y XR. Este sistema puede manejar una gran cantidad de archivos y es capaz de alcanzar velocidades de transferencia de datos de hasta 10 GB/s y 100,000 IOPS. Quantum también ha destacado su tecnología de almacenamiento definido por software, así como su uso

de tecnologías nativas de la nube, como Kubernetes y microservicios.

EVS, una empresa líder en soluciones de producción en vivo, ha traído a la feria varias novedades en su enfoque de soluciones. En lugar de centrarse en productos específicos, se están enfocando en productos para satisfacer las necesidades de sus clientes. Xtramotion es una tecnología basada en inteligencia artificial que permite la generación de cámara lenta en cámaras estándar, tanto en local como en la nube. LSM Via incluye capacidades multiview para una mayor eficiencia en la producción. Xnet vIA utiliza redes IP en lugar de las tradicionales Xnet, reduciendo la latencia a solo unos pocos fotogramas y utilizando una red de 10G. La integración del servidor de

repetición con sistemas de MediInfra y Cerebrum permite la gestión de redes y sistemas. Cerebrum con Neuron son representaciones gráficas de flujos de señal y control de sistemas. Neuron View es un multiviewer de baja latencia en tiempo real con 32 entradas y 8 salidas en hardware. MediCeption es una gestión de contenido integrada en PAM que permite la creación y edición compleja o sencilla con IPD-VIA. Con una interfaz web basada, es posible trabajar de forma remota mientras se está en las instalaciones, e incluyen entradas SRT y NDI en todos los servidores de vídeo.

WTVision exhibió importantes novedades en el marco de la feria NAB, donde destacó los grandes cambios a nivel de gestión que ha

NAB SHOW 2023

experimentado la compañía, así como las adaptaciones realizadas para enfrentar el mercado postCOVID. También se presentaron nuevas versiones de todas las soluciones, con especial atención en gráficos para deportes, noticias automatizadas y playout automatizado, con una nueva arquitectura para modelos híbridos que pueden ser basados en-prem, en la nube o distribuidos gracias a las interfaces web. El acceso remoto también permite operaciones distribuidas. Además, se incluye un motor HTML5 que evita los costos de GPU en la nube en comparación con la versión 3D, y que permite entregar cualquier formato de streaming. Se mantiene la versión Navient, pero las nuevas soluciones ofrecen mayor flexibilidad sin perder calidad. Finalmente, mostraron un motor VR que permite controlar Unreal5 y cualquier otro motor de renderizado.

Zero Density presentó novedades en producción virtual, XR y gráficos en tiempo real durante NAB. Estas soluciones están basadas en Unreal Engine y se basan en la tecnología Avalanche de EPIC Games, lo que permite una alta calidad gráfica en tiempo real. Además, se ha mejorado la integración entre los motores de Zero Density y Avalanche. También se ha presentado un nuevo sistema de seguimiento de cámaras para instalaciones de estudio fijo basado en cámaras IR y sensores en la cámara. Estas soluciones permiten el seguimiento de múltiples talentos, tanto en HD como en 4K con resolución completa UHD, incluyendo WCG y HDR, lo que resulta en gráficos en vivo de alta calidad.

Por su parte, Blackmagic Design expuso Davinci Resolve 18.5, una versión con 150 nuevas características, centrándose en la inteligencia

artificial y el motor Unreal. Entre las nuevas funcionalidades destacan la transcripción de voz a texto con selección de subclips para generar subtítulos, y la herramienta FX Relight, que analiza el clip y crea un mapa 3D para generar la iluminación. También presentaron la aplicación Resolve Monitoring para compartir la salida a través de Internet, los nuevos switchers Atem con versión 4K para la solución montada en escritorio Atem TV Studio, y la cámara Ursa 12K con una nueva versión de filtro óptico para eliminar efectos de imagen no deseados en resoluciones más altas, cumpliendo con las especificaciones de Netflix. Por último, se presentó el sistema de conversión IP 2110 con vista previa en panel y LCD con conectividad 3G, óptica y ethernet, aunque solo es capaz de manejar resoluciones HD.

Kiloview mostró una serie de novedades en su gama de productos, incluyendo soluciones para grabación, gestión centralizada, enrutamiento y conmutación, multiview y monitoreo NDI, producción NDI, soluciones SRT y codificadores Ethernet duales con capacidades extendidas como multiview, SDI, HDMI e incluso grabación en USB flash. Además, la compañía presentó su media gateway para conversión de transmisión con nueve entradas y transcodificación en paralelo, así como una solución modular y portátil para enlazar pantallas P3, con capacidad para 4K y NDI y una batería de seis horas. Estos productos también cuentan con grabación completa en tarjeta SD y un módulo 5G o doble 4G LTE con un total de 10 conexiones simultáneas, lo que permite la transmisión directa de

NDIHX desde el codificador.

CueScript ha presentado interesantes novedades en relación con sus prompters para cámaras PTZ, entre las que destaca su diseño con un centro de gravedad equilibrado que permite una mayor estabilidad y comodidad en su uso. Además, estos prompters pueden trabajar con cámaras tanto con lentes simples como intercambiables, ofreciendo una mayor flexibilidad en la elección de equipos. Por otro lado, CueScript también ha lanzado CueTalk Cloud, un servicio basado en la nube y con conectividad IP que permite una gestión más sencilla y accesible de los prompters, mediante una suscripción de pago. Por último, la compañía ha introducido un nuevo método de control de sus prompters: SayiT, que permite activarlos por voz, facilitando aún más su manejo.

Y por último, For.A enseñó varias novedades, entre las que se destacan su nuevo switcher con interfaz NDI para producciones híbridas, compatible también con SDI y control de cámaras PTZ. También presentaron una interfaz web de usuario para un centro de producción todo en uno, que incluye enrutador de vídeo, switcher, mezclador de audio, codificador de streaming, grabador y reproductor, que fue galardonado con el premio Best of the Show. Además, firmaron un acuerdo de distribución con Alfalite. For.A también presentó un multivisor 2110, junto con SDI y 2022 para redes de 10G, y un nuevo procesador de vídeo con 32 canales y capacidades IP. Finalmente, presentaron el Soar-A para visualización y monitoreo compatible con RIST, junto con SRT para menor latencia y menos paquetes perdidos.

NOTICIAS 14 TM Broadcast Actualidad NAB SHOW 2023

Durante las últimas décadas, hemos sido testigos de una revolución tecnológica que ha transformado drásticamente la forma en que consumimos contenido. La democratización de la tecnología ha permitido que cualquier persona pueda crear y difundir su propio contenido, lo que ha generado una enorme cantidad de oportunidades para nuevos creadores y productores en el sector. Sin embargo, también ha tenido un impacto negativo en la calidad de este y la forma en que se produce y distribuye.

Como profesional, he observado con preocupación cómo la democratización de la tecnología ha llevado a una disminución en la calidad. Ahora cualquier persona puede grabar un vídeo con su teléfono móvil, editarlo y subirlo a internet sin necesidad de una formación técnica ni artística previa. Esto ha generado una sobrecarga de información que ha dificultado la diferenciación entre el contenido de calidad y el que no lo es.

Además, la democratización de la tecnología ha llevado a una falta de control en el proceso de producción y distribución de este contenido. Cualquier persona puede publicar en línea sin necesidad de pasar por una revisión previa por parte de un profesional, lo que ha llevado a una proliferación de noticias falsas, contenido engañoso y discursos de odio.

Como profesionales del sector, tenemos la responsabilidad de preservar la calidad de lo que producimos y asegurarnos de que el público reciba información confiable y entretenimiento de calidad. Debemos ser conscientes de que la tecnología es una herramienta, y como tal,

debemos utilizarla de manera responsable y ética.

Es nuestro cometido educar y formar a nuevos creadores y productores para que entiendan la importancia de la calidad y la ética en el contenido que producen. Debemos fomentar la colaboración y el trabajo en equipo, y asegurarnos de que haya un control de calidad en todas las etapas del proceso de producción y distribución.

Asimismo, debemos seguir invirtiendo en la tecnología y en la formación de profesionales para que estén al día en las últimas tendencias y herramientas disponibles. Esto nos permitirá seguir innovando y creando contenido de calidad que atraiga al público y lo mantenga informado y entretenido.

En conclusión, la democratización de la tecnología ha tenido un impacto negativo en el sector broadcast, pero como profesionales, tenemos la responsabilidad de preservar la calidad del contenido y asegurarnos de que el público reciba información confiable y entretenimiento de calidad. Debemos utilizar la tecnología de manera responsable y ética y seguir invirtiendo en la formación y la innovación para mantenernos al día en un entorno cada vez más cambiante.

No todo vale.

@yerayalfa www.linkedin.com/yerayalfa

THE VIEWFINDER The Viewfinder TM Broadcast 15 Democratización,

Por Yeray Alfageme, Business Development Manager en Optiva Media an EPAM company

que no más y peor

TM Broadcast RTVE EN QATAR PRODUCCIÓN TÉCNICA 16

Producción técnica de RTVE para laemisión en España de la Copa Mundial de la FIFA Qatar 2022 y prueba de

concepto de producción en nube pública

Artículo realizado por Dirección de Medios y Operaciones TVE: Manuel González Molinero Jesús García Romero

17 TM Broadcast RTVE EN QATAR PRODUCCIÓN TÉCNICA

A la izquierda: pruebas de realización en cloud.

RTVE ha desplazado a Qatar a más de 80 profesionales para la producción técnica para España de la Copa Mundial de la FIFA 2022, emitida a través de sus plataformas de televisión, radio y servicios interactivos. Entre los partidos y los programas deportivos previos y post, las dos cadenas La 1 y Teledeporte han efectuado más de 65 horas de emisión TDT. El partido inaugural de la selección española ha conseguido un 47.9% de cuota de pantalla con 5.863.000 de espectadores. Y durante los penaltis de la final se han alcanzado los 12.207.000, el 69,7% de cuota. Otro hito importante de

esta operación es que RTVE ha emitido 20 de los partidos del Mundial por el canal de ultra alta definición UHD de la emisión TDT (siendo el primer evento de este nivel en TDT UHD). Se transmitió en UHD con formato HDR y el sonido fue multicanal Dolby Atmos.

En paralelo a la emisión TDT, se ha retransmitido 19 partidos a través de la aplicación RTVE Play para móviles y dispositivos conectados y la web de CRTVE con datos récord de audiencia. La plataforma mayoritaria de consumo han sido los dispositivos Android a través de la aplica-

ción RTVE Play, seguido de los usuarios Android a través del navegador web. El tercer lugar lo han ocupado tanto los PC con Windows a través del navegador web como los dispositivos iOS. Como ejemplos de consumo de esta producción digital señalar que en el partido de octavos de final entre España y Marruecos se han registrado hasta 675.000 dispositivos simultáneos con 2,06 Terabit/s de tráfico de directo entregado a usuarios. Han llegado a haber 2.169.497 usuarios únicos (combinaciones de IP + User-Agent) conectados al directo desde España durante el partido. Y la final

PRODUCCIÓN TÉCNICA 18 RTVE EN QATAR TM Broadcast

El equipo técnico de Qatar.

Argentina-Francia ha tenido más de 1.000.000 de dispositivos simultáneos conectados al stream, con un máximo de 2,69 Terabit/s de tráfico de directo entregado a usuarios y hasta 2.717.201 usuarios únicos conectados desde España.

Radio Nacional de España ha cubierto 50 de los 64 partidos del torneo, incluyendo todas las eliminatorias. Se han contabilizado más de 148 horas de programación mediante una fórmula mixta entre la emisión convencional en antena y la difusión de contenidos a través de plataformas como Play Radio y la aplicación para dispositivos móviles de RNE. La versatilidad de los medios técnicos enviados a Doha (especialmente los Quantums) permitió hacer conexiones, entrevistas e incluso programas especiales desde diferentes puntos de la ciudad más allá de la programación principal realizada desde los estudios del IBC y desde las líneas IP de los estadios. También se ha ofrecido un podcast de difusión diaria a través de Play Radio y de la plataforma Spotify resumiendo la actualidad de cada jornada para los oyentes que consumen contenidos sonoros en soportes como altavoces inteligentes. Y para seguidores de RNE en redes sociales, los enviados especiales a Qatar han llegado a producir más de 200 vídeos exclusivos.

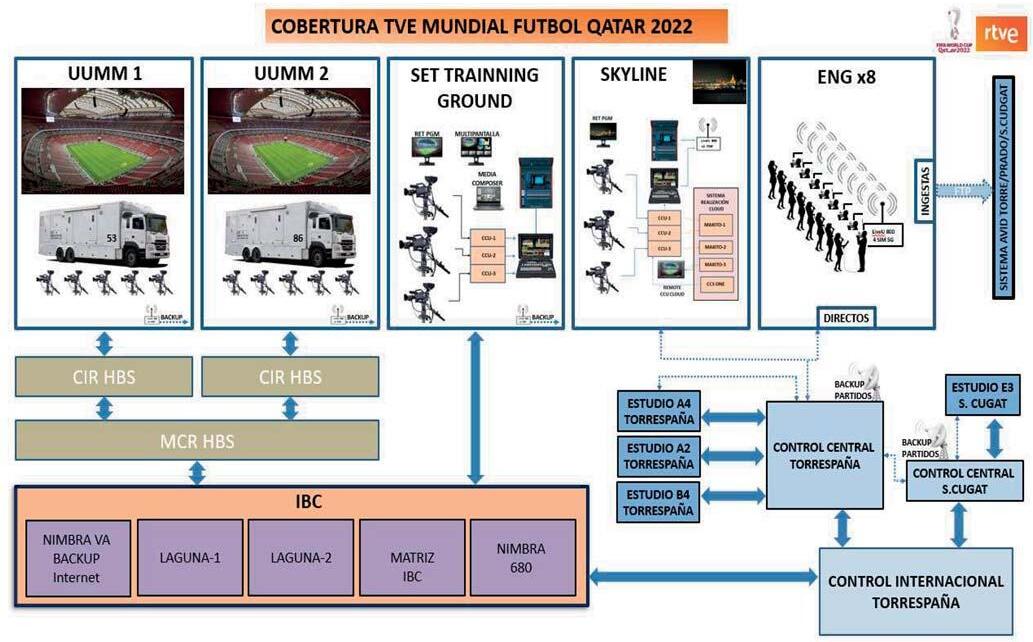

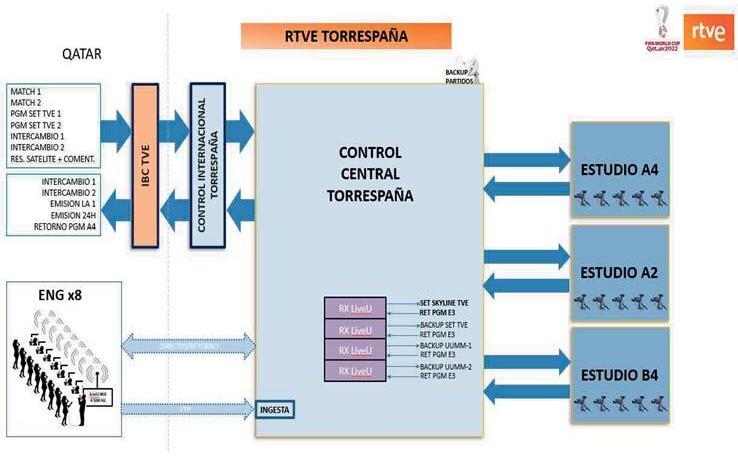

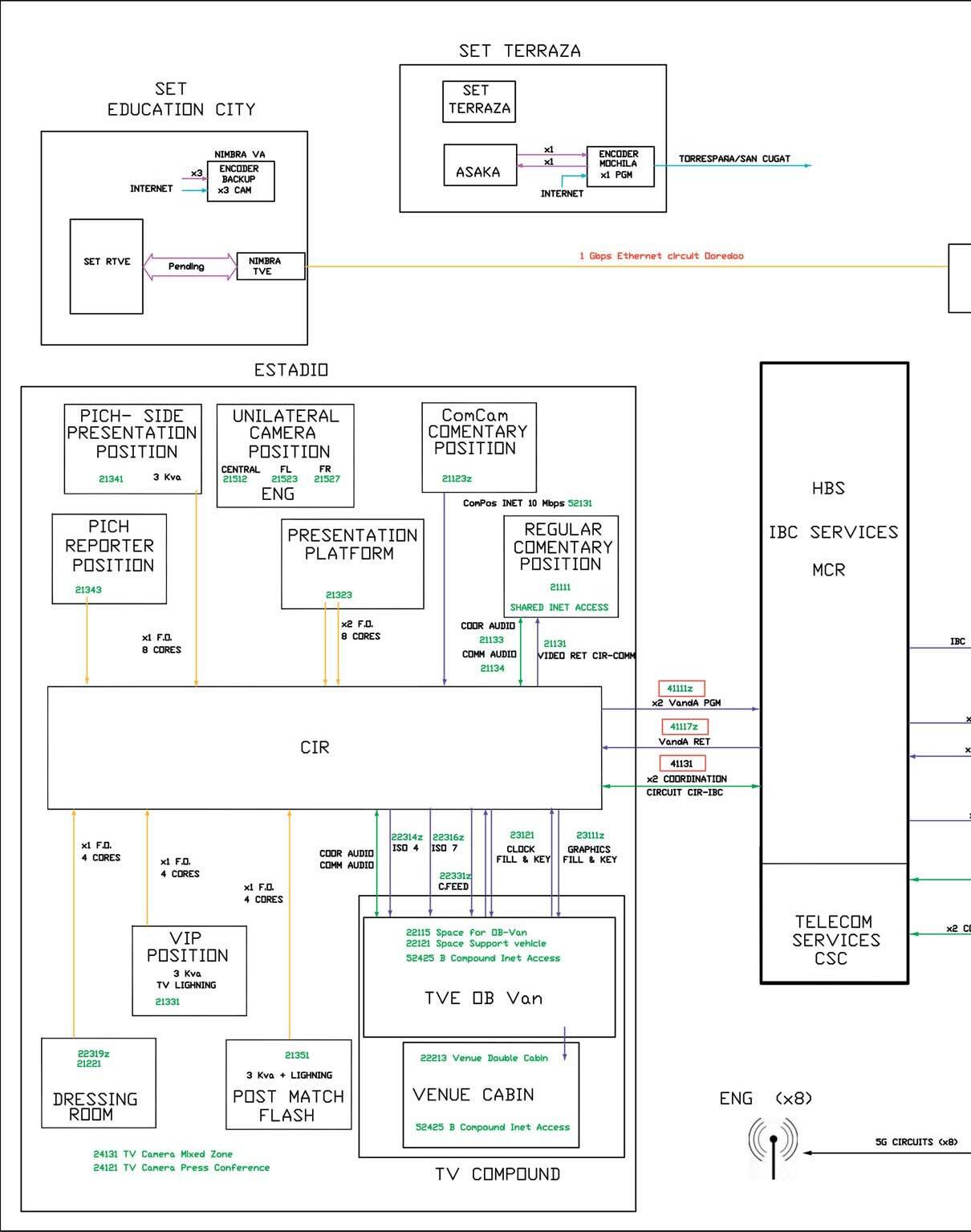

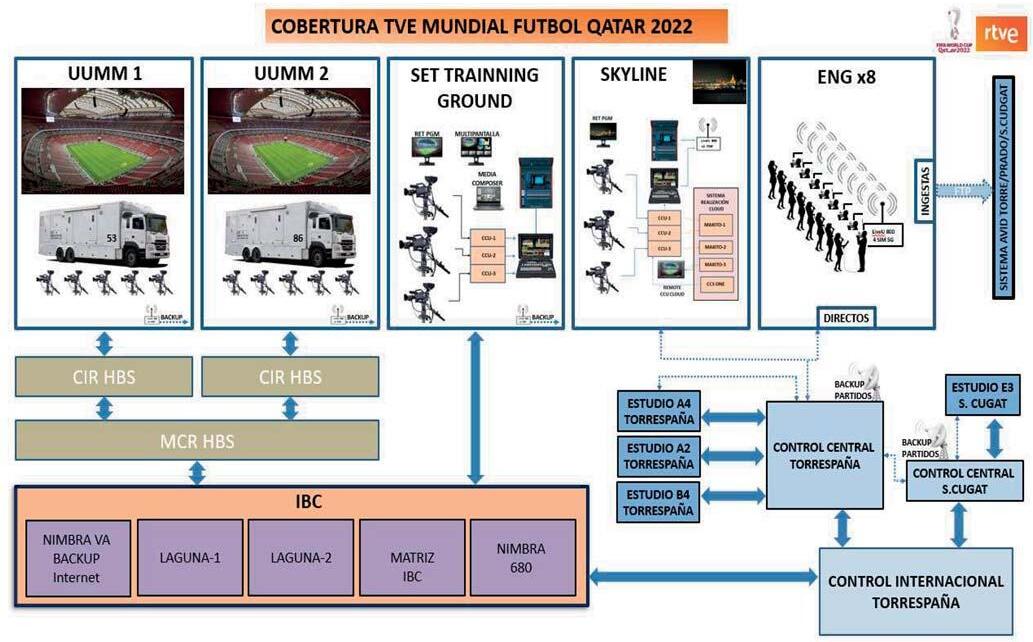

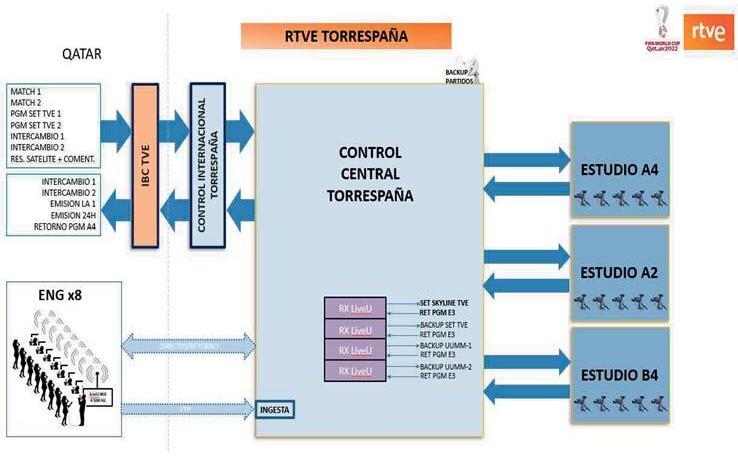

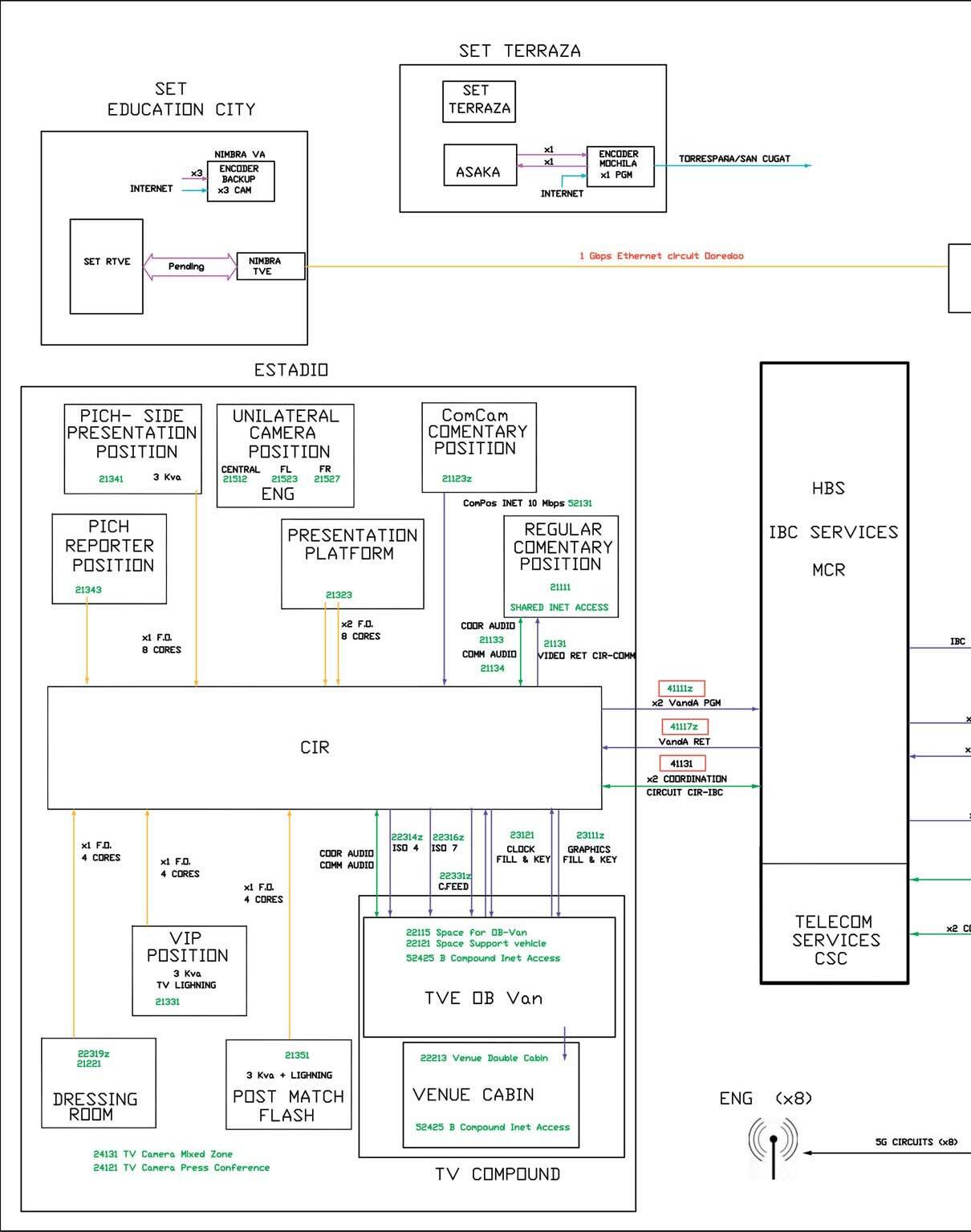

Para la cobertura de televisión se han instalado dos SET, uno en el campo de entrenamiento de la selección española y otro "el Skyline" en la terraza de uno de los rascacielos de Doha, la capital de Qatar. Desde ellos se han hecho infinidad de conexiones diarias con los informativos Telediario 1 y 2 y L´Informatiu, con Las mañanas de La 1 y con los canales Teledeporte y Canal 24 Horas. Ocho equipos de ENG por toda la ciudad han asistido a los entrenamientos de las selecciones, ruedas de prensa, entrevistas a jugadores, seguimiento de fans y las diversas ceremonias y actividades culturales de la ciudad de Doha.

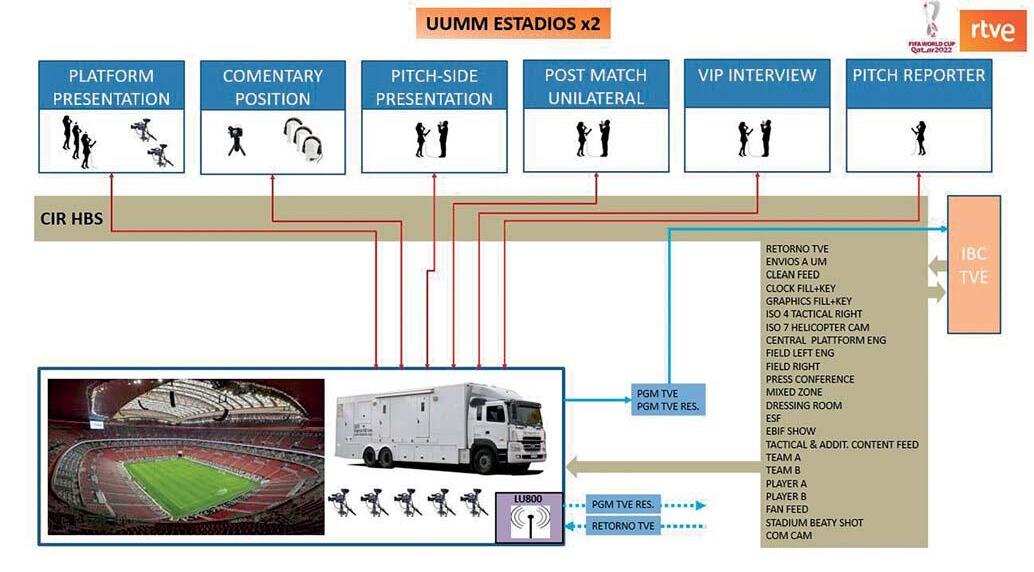

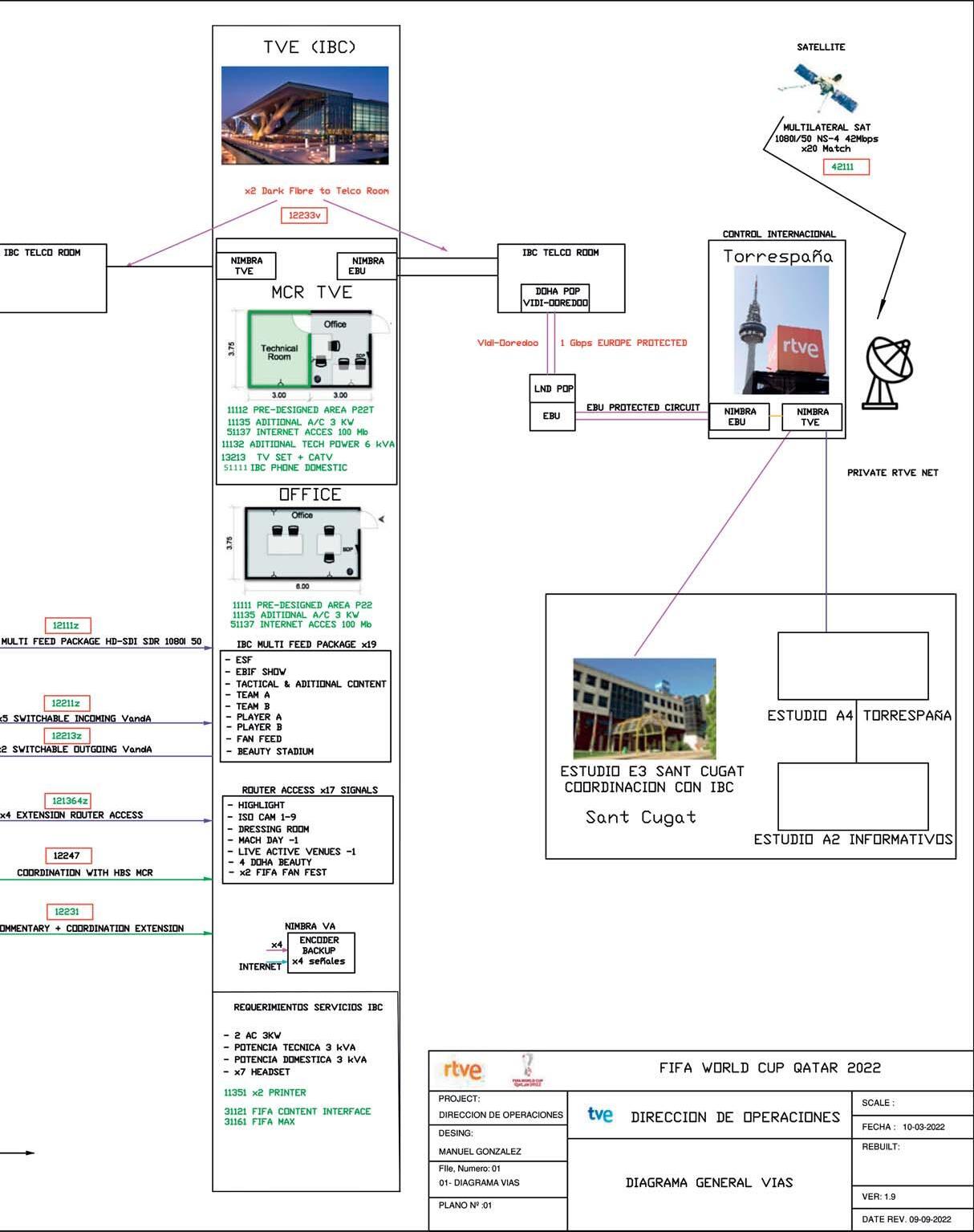

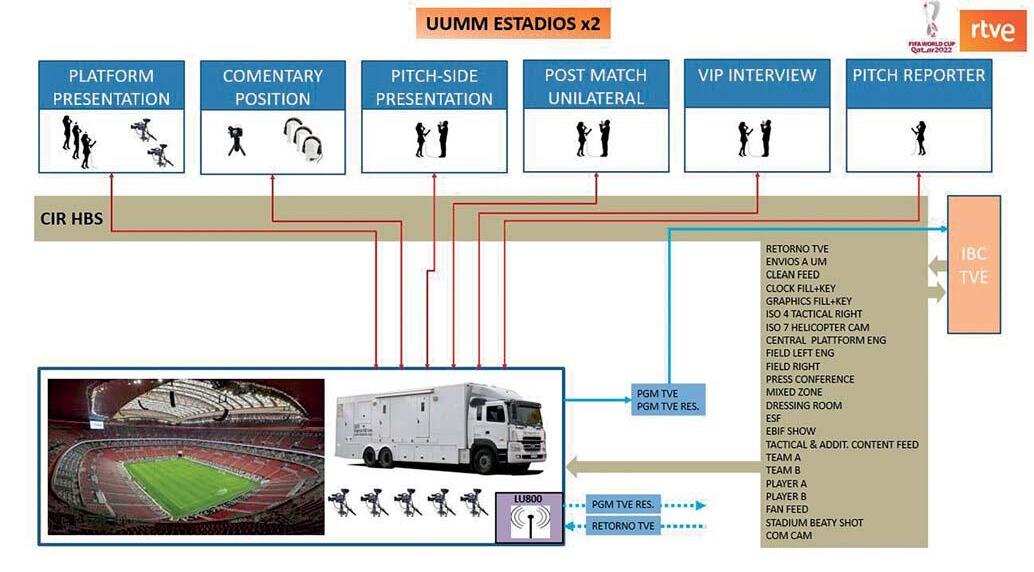

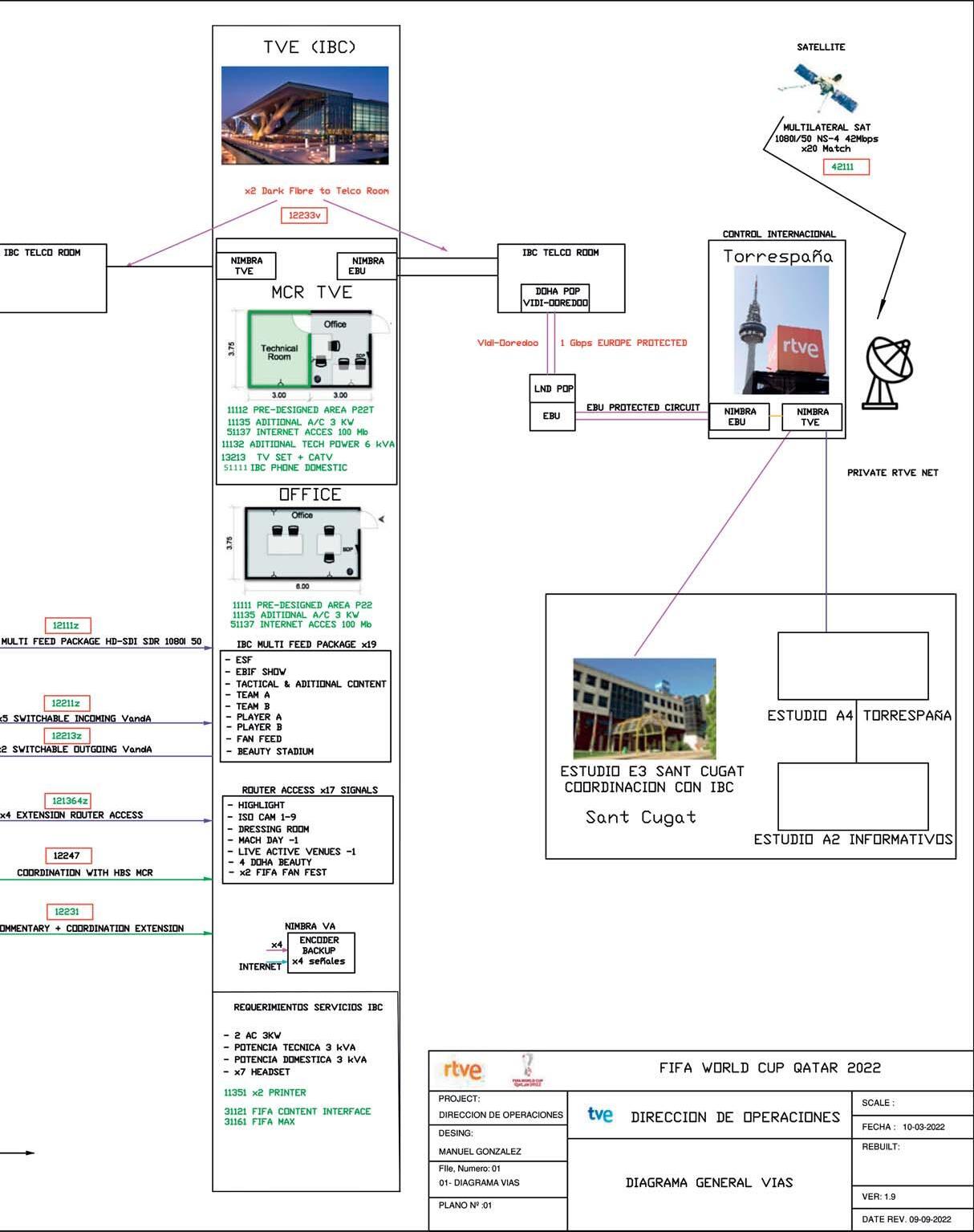

El día a día de la actualidad del mundial se ha seguido a través de los programas diarios realizados en los estudios A4 de Torrespaña y E3 de Sant Cugat. Para la personalización de los partidos retransmitidos se han empleado dos unidades móviles en los estadios, y junto al campo de juego un SET para la previa del partido y posiciones de comentarista con los mejores especialistas deportivos. Todas las señales generadas en las diferentes ubicaciones se han canalizado a través del IBC situado en Doha, hasta Madrid y Sant Cugat a través de circuitos internacionales y de la propia red de contribución de RTVE.

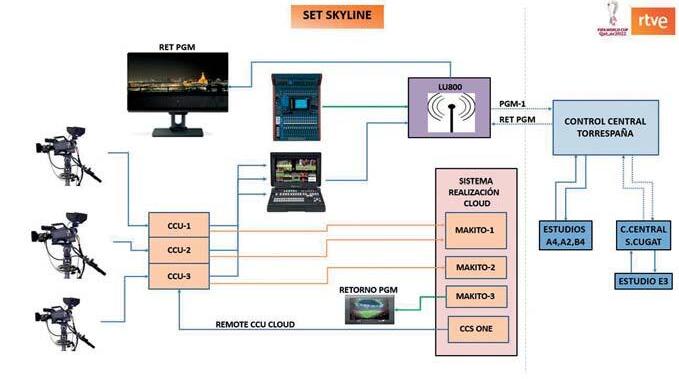

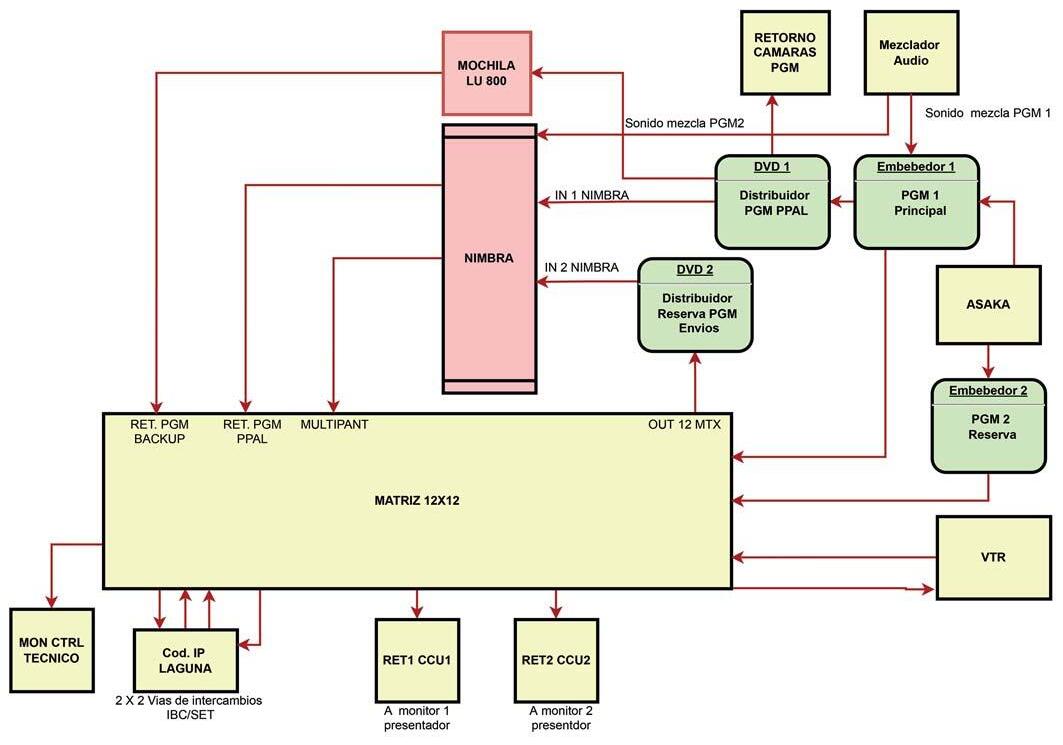

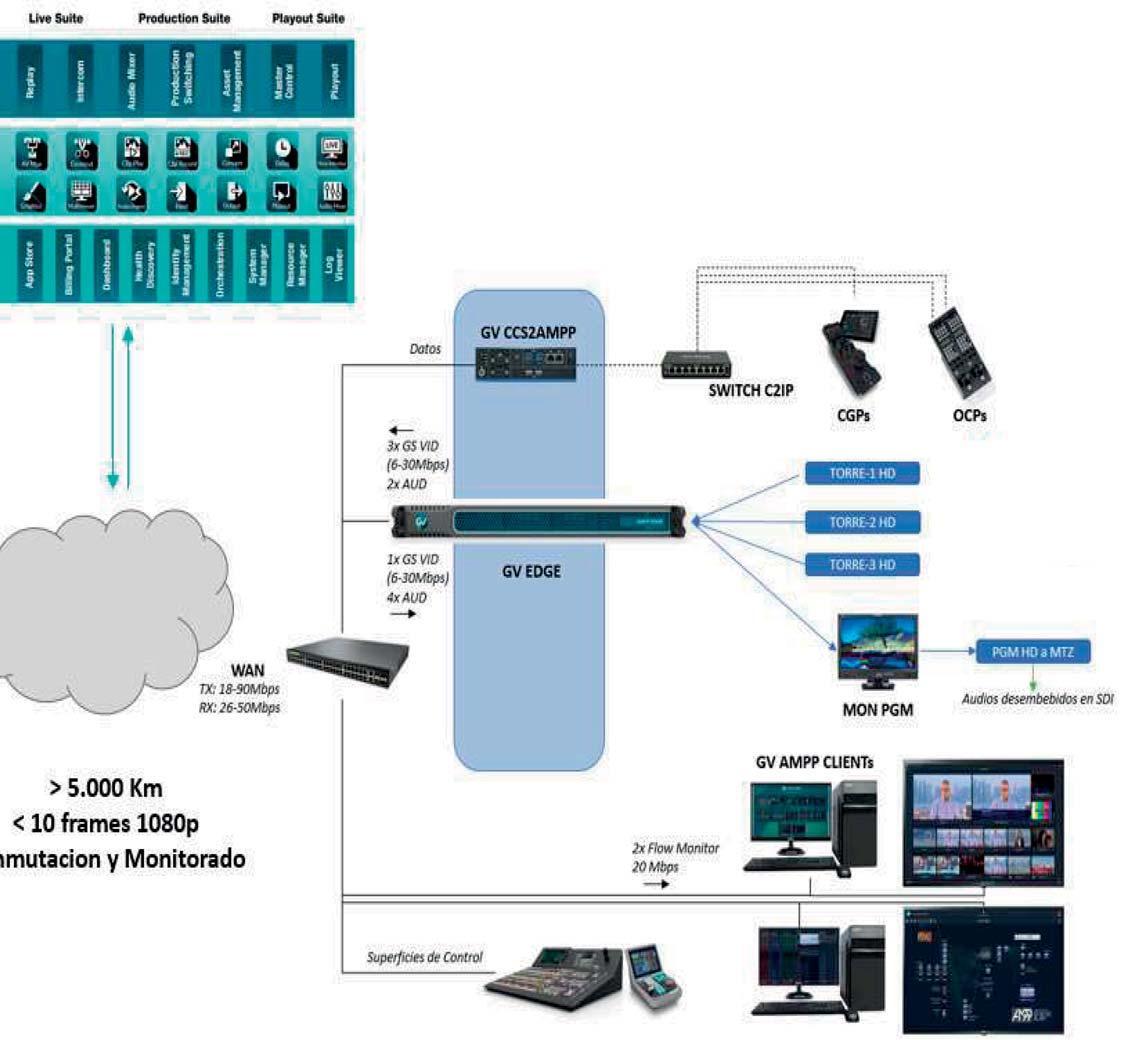

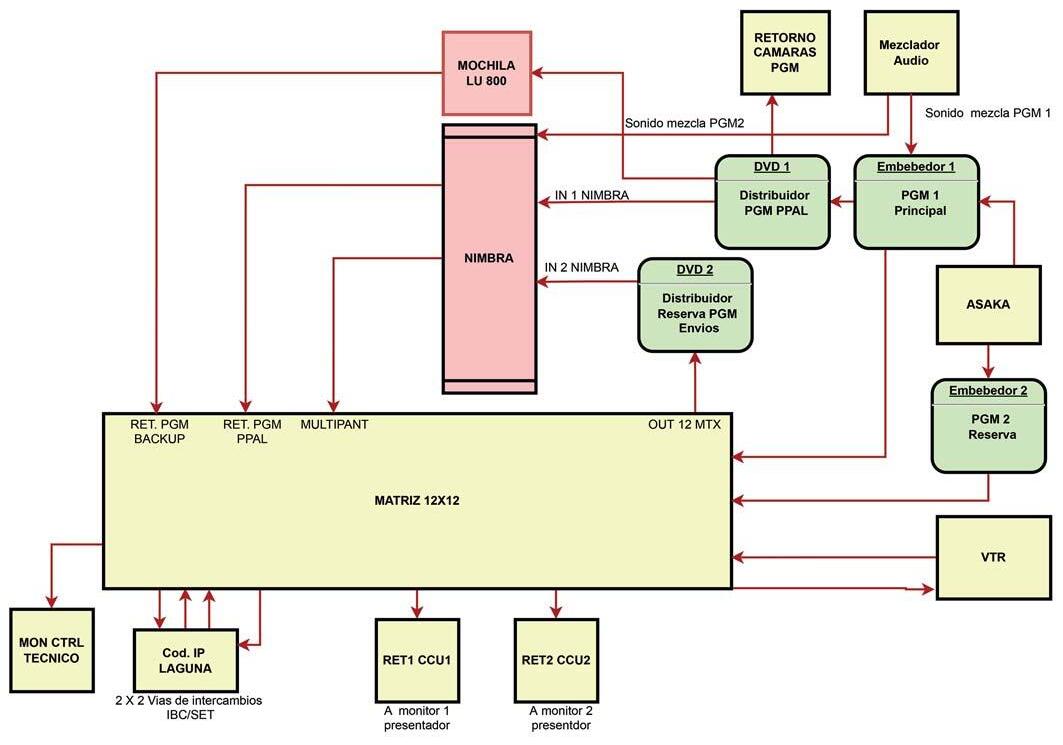

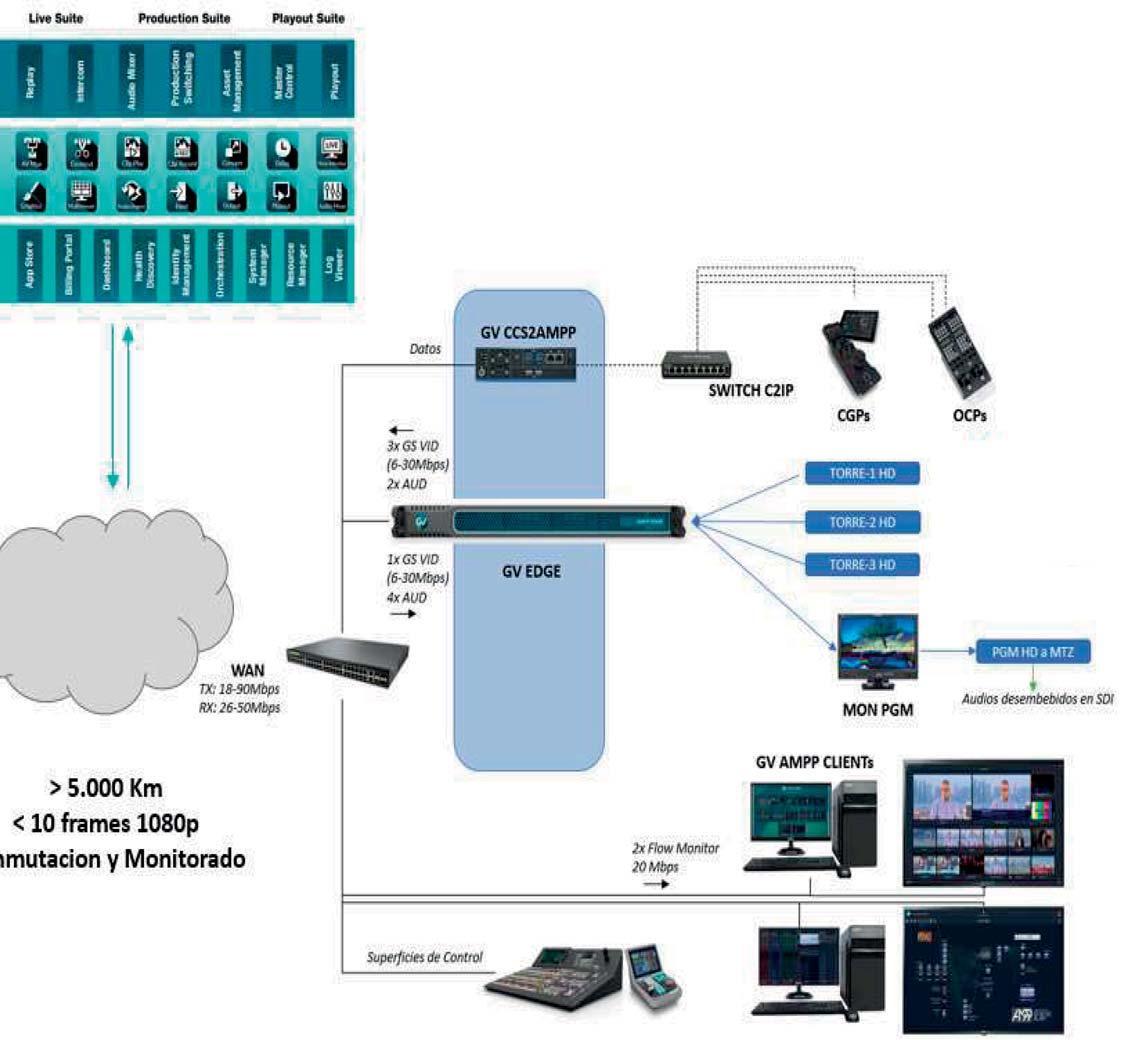

En paralelo a la producción tradicional de este tipo de eventos, en colaboración con el fabricante Grass Valley y con el equipo de ingeniería del integrador Crosspoint se ha realizado una prueba de concepto para establecer una cadena completa de producción basada en la nube pública y redes WAN entre nuestro Skyline en Doha y un control técnico montado en el centro madrileño de Torrespaña. En servidores Amazon

TM Broadcast

19

se ha implementado la plataforma AMPP de Grass Valley con todos los servicios necesarios para la producción. El Skyline de Doha ha sido el set remoto para esta producción en la nube.

DESPLEGUE TÉCNICO PARA LA PRODUCCIÓN DEPORTIVA

Para la cobertura de esta competición deportiva mundial, en la capital de Qatar donde se ha celebrado el acontecimiento, se han instalado dos sets sobre los que ha pivotado fundamentalmente el seguimiento de toda la información del evento. Y los estudios de Madrid o Radio Nacional de España, la web y la plataforma RTVE Play han completado la oferta multi-dispositivo por la que

la corporación pública ha hecho llegar la producción del mundial de futbol a los ciudadanos.

En un espacio dedicado del IBC (International Broadcasting Centre) en Doha, se ha instalado un control de RTVE desde el que se han gestionado las señales servidas por HBS y los servicios técnicos de intercambio que intervienen en la operación de televisión, radio e interactivos. El transporte de todas las señales y de los múltiples servicios técnicos entre Qatar y Madrid o Barcelona se ha realizado a través de circuitos internacionales redundados de 1 Gbps redundante hasta el POP (Point of Presence) de Londres. Desde allí, por la red FINE de EBU, al nodo que esta organización tiene alojado en Torrespaña. Y ya en Madrid, por los circuitos propios de contribución de

RTVE hasta los estudios de Sant Cugat en Barcelona.

Mediante los mencionados circuitos se han transportado hasta 6 señales HD-SDI entre Doha y España, 6 señales HD-SDI de retorno, señales de audio de comentaristas, ordenes e intercomunicación Artist, servicios de iNews para los programas y servicios ethernet corporativos. Adicionalmente, en los centros de producción se ha contado con conexión FTP al sistema de ingesta de media de HBS para intercambio de los contenidos extra FIFAMAX.

A través del IBC han llegado las señales de personalización de los partidos realizadas por las unidades móviles y las conexiones con el set del campo de entrenamiento de la selección. Los 8 equipos de reporte-

PRODUCCIÓN TÉCNICA 20 RTVE EN QATAR TM Broadcast

ros ENG también han contado con transmisores IP. Los ficheros que han generado, vía FTP, han pasado a estar disponibles de inmediato en los sistemas de las redacciones AVID en España.

En cuanto a la redundancia ante un posible fallo de los circuitos internacionales, señalar que todos los puntos de información han contado con back-up de transmisión bidireccional IP con Madrid mediante mochilas LU800 LiveU conectada a líneas FTTH dedicadas. El back up de recepción de la señal internacional de los partidos se ha implementado a través de los enlaces de satélite disponibles tanto en Torrespaña como en Sant Cugat.

TM Broadcast

21

Set estadio Qatar.

Set en el campo de entrenamiento de la selección

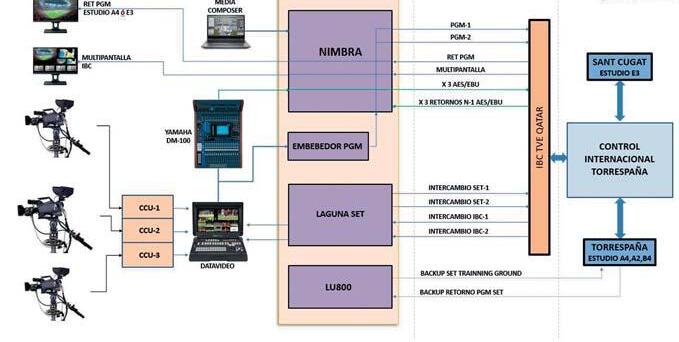

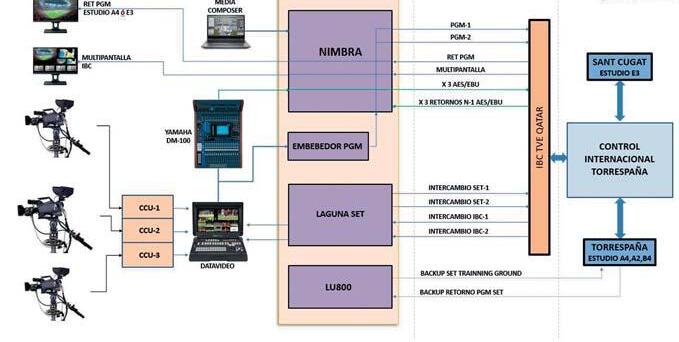

El campo de entrenamiento de nuestra selección de futbol estaba ubicado en la universidad de Doha. En este emplazamiento se ha montado un set de TV con tres cámaras LX92 con ópticas Canon, un mezclador ligero Data Video y una consola de audio Yamaha DM- 1000. El set se ha dotado también con un puesto para periodista con INews y edición AVID Media Composer. Una fibra óptica ha conectado el set del campus de la universidad con el centro

PRODUCCIÓN TÉCNICA 22 RTVE EN QATAR TM Broadcast

Equipo técnico de RTVE y set Skyline de Doha.

Set campo entrenamiento.

de trafico de señales HBS en el IBC. Dicha conexión se ha gestionado mediante un nodo Nimbra el cual para las señales principales de programa se ha equipado con tarjetas MAN en formato J2K a fin de minimizar las latencias en la transmisión y obtención de unas vias de alta calidad. Este sistema se ha encargado de transportar las señales de video y

audio, la conexión de intercom para coordinación y órdenes, el tráfico ethernet corporativo, iNews y las señales correspondientes de retorno. Adicionalmente, para intercambio de señales entre el set y el IBC se han empleado codificadores SAPEC Laguna para optimizar el ancho de banda.

Set de entrevistas "Skyline"

El set instalado en una terraza de uno de los rascacielos de Doha ha llevado el peso de los programas resumen realizados diariamente diariamente, así como conexiones para los Telediarios y diversos programas en directo con unas vistas privilegiadas de la ciudad capital de Qatar. Este Set contaba con tres cámaras LX92, ópticas Canon, un mezclador ligero Data video y una mesa de audio Yamaha DM-1000, microfonía inalámbrica Wisycom y sistema intercom Riedel. La señal allí realizada se ha transportado en IP directamente con Torrespaña y Sant Cugat mediante una mochila LU800 con conexión dedicada a internet.

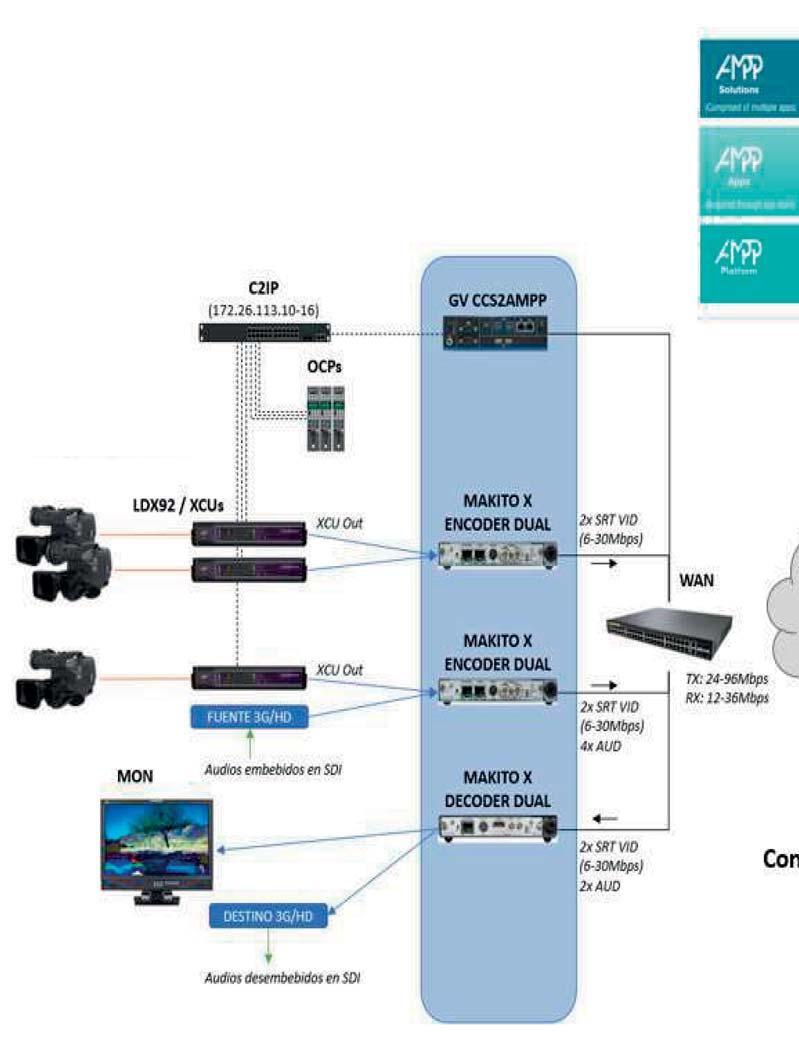

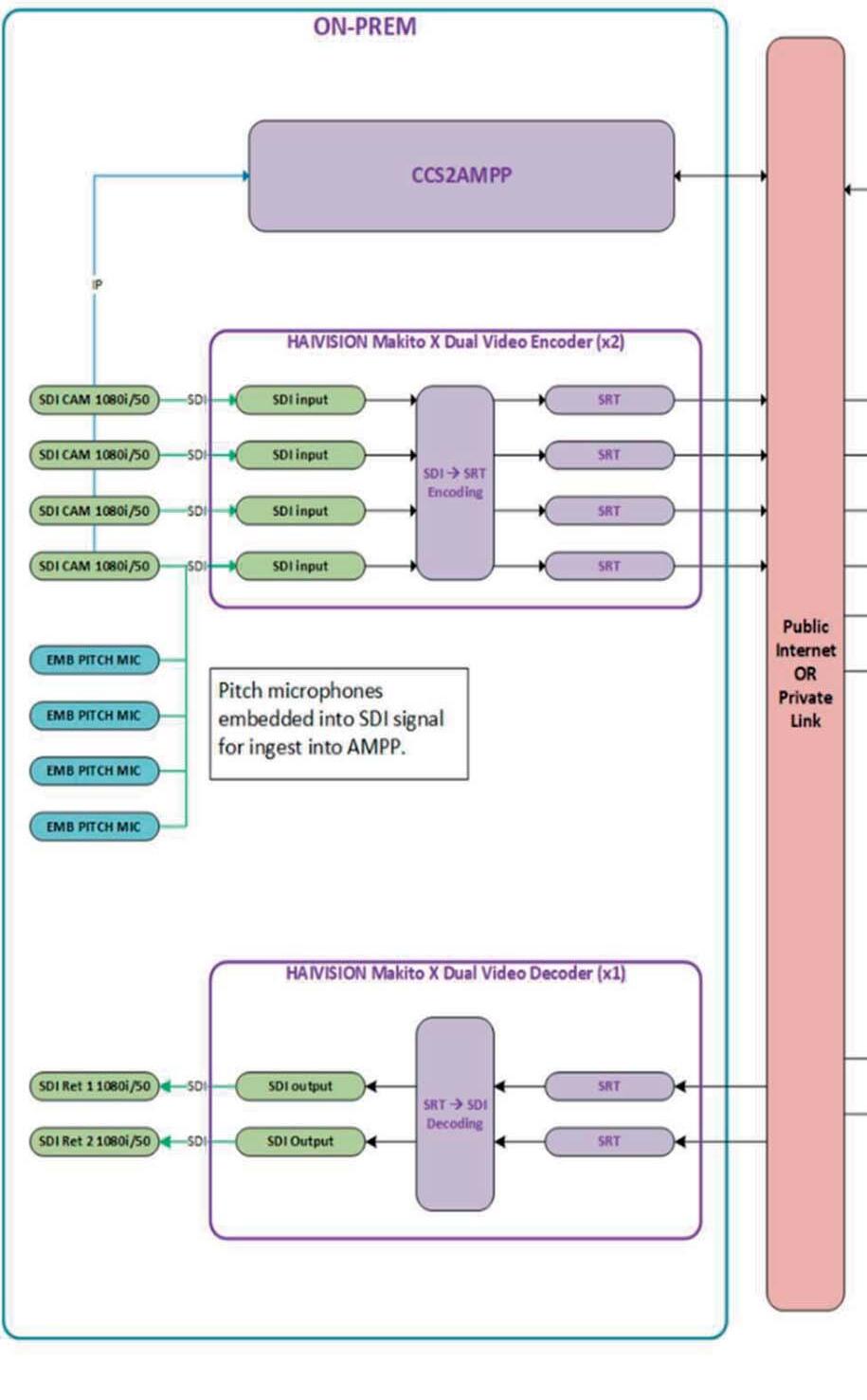

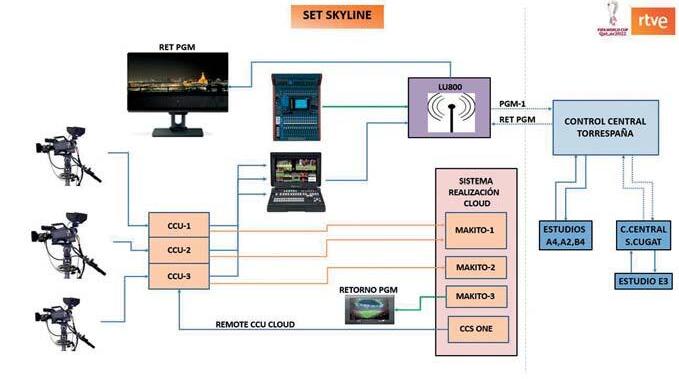

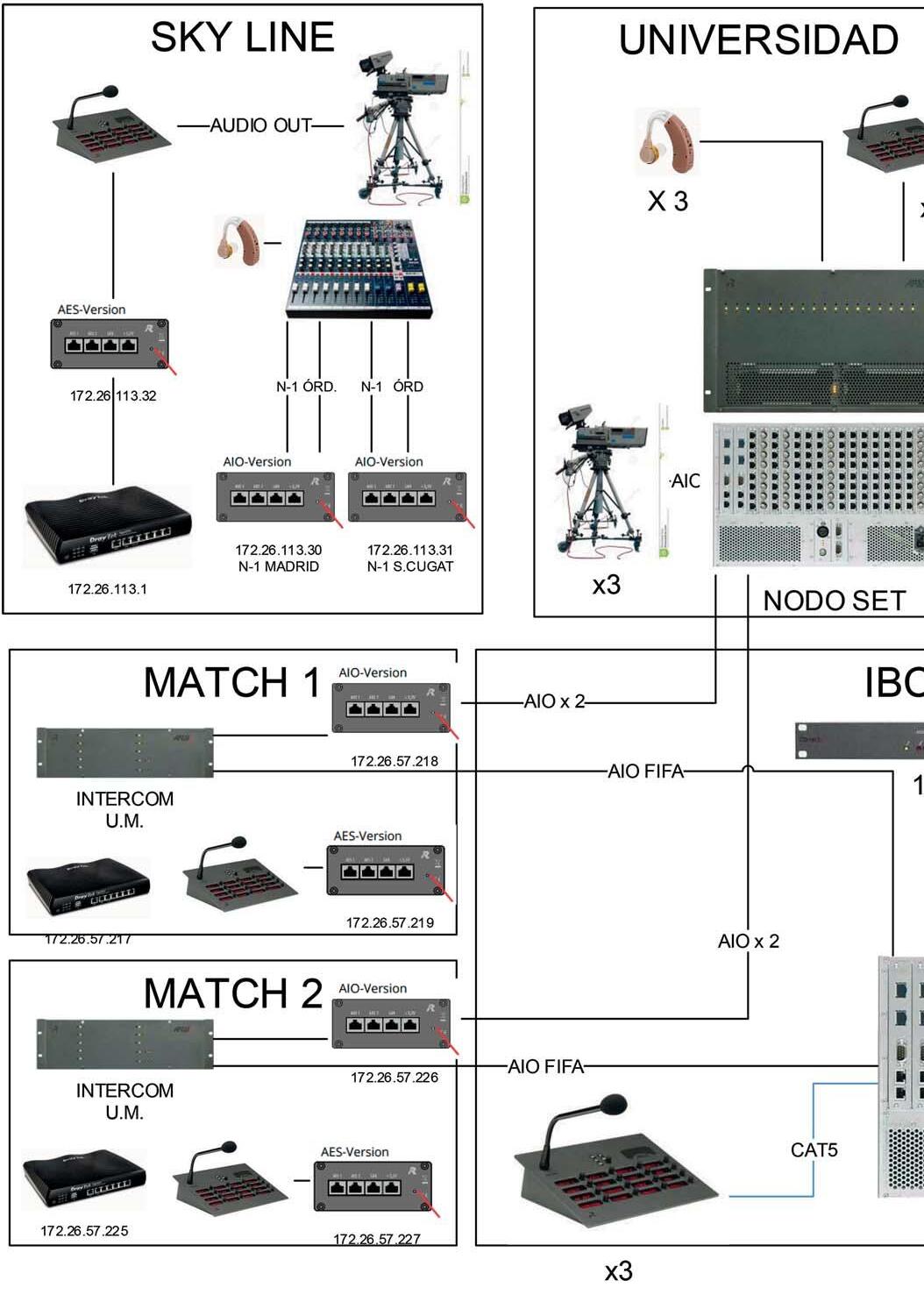

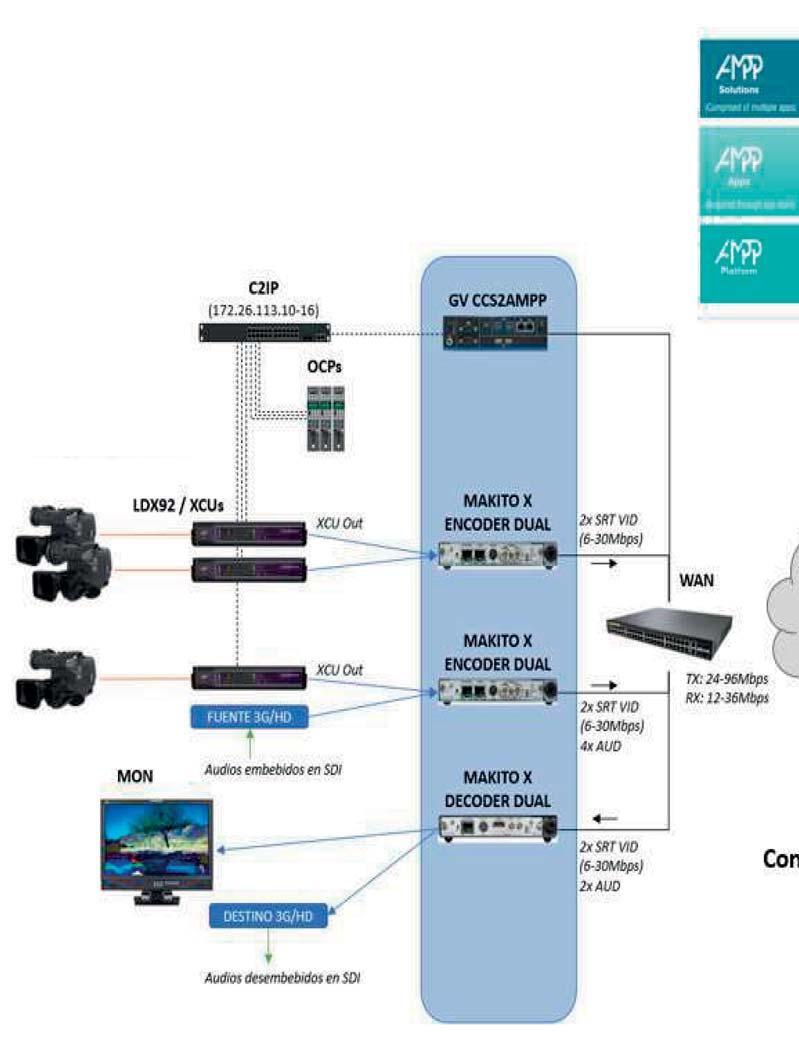

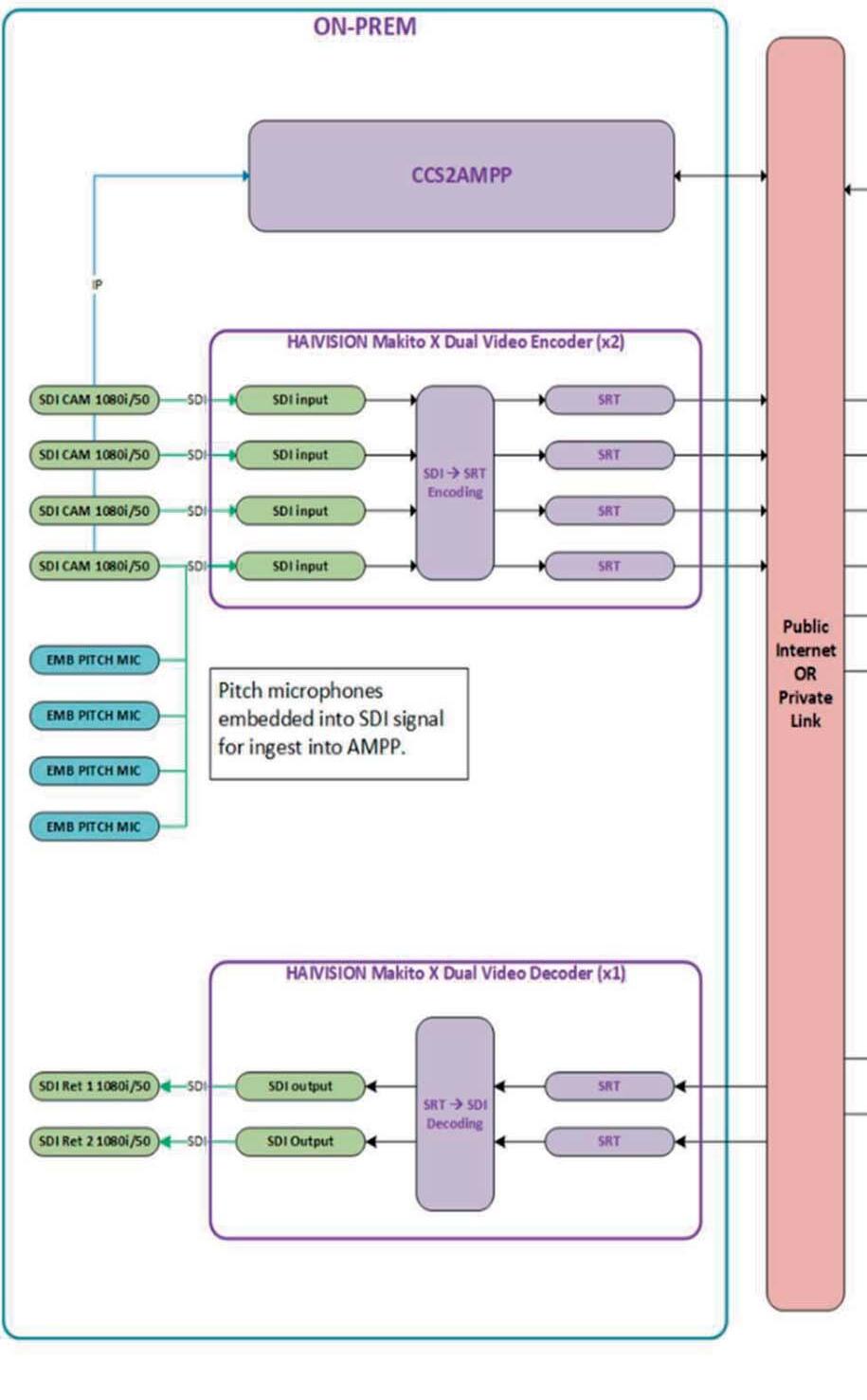

Con las cámaras de este set se ha realizado la prueba de concepto POC de realización en la nube. Para ello, como se puede apreciar en el esquema, también se han instalado

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 23

PRODUCCIÓN TÉCNICA 24 RTVE EN QATAR TM Broadcast

Diagrama bloques Doha

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 25

PRODUCCIÓN TÉCNICA 26 RTVE EN QATAR TM Broadcast

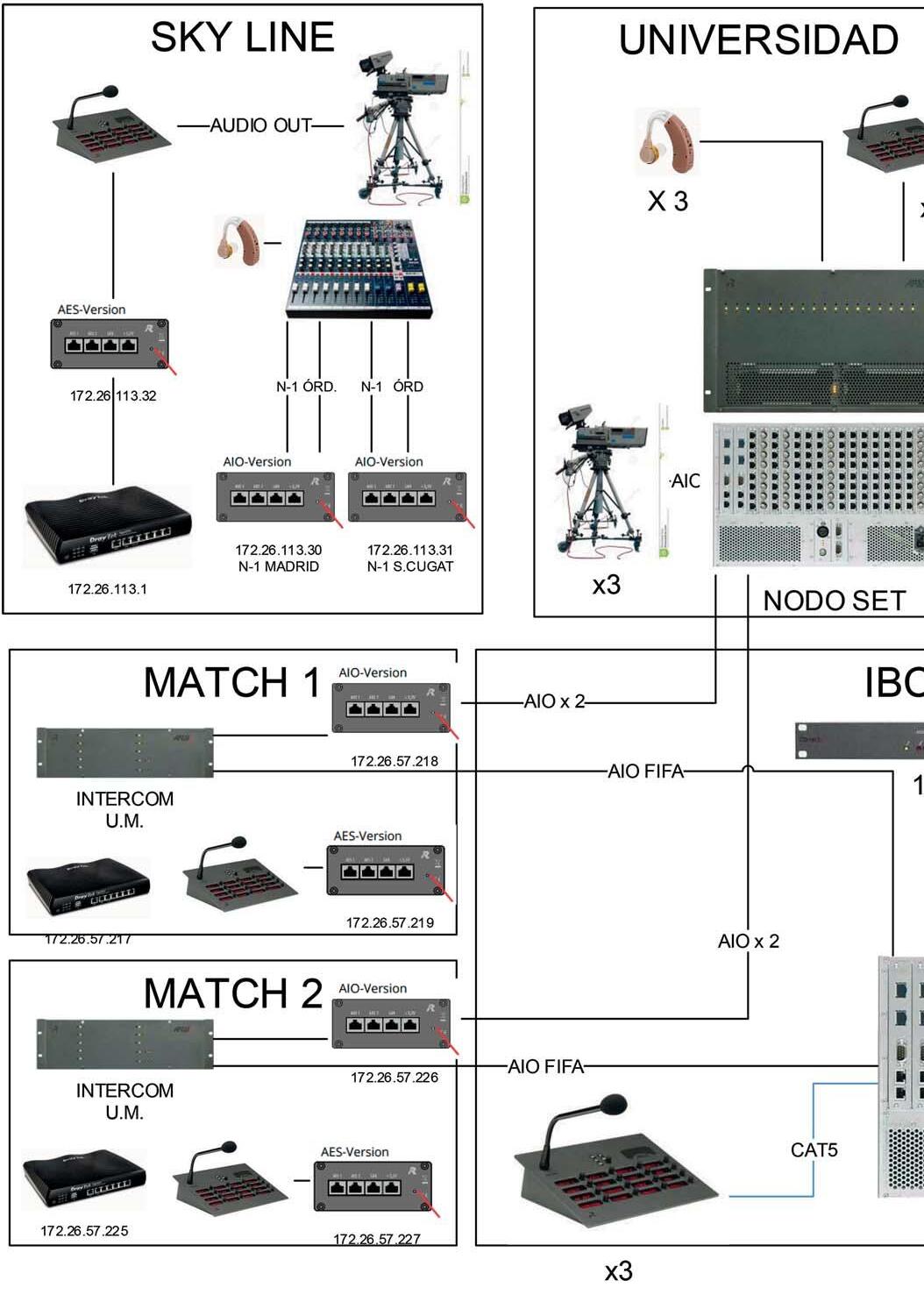

Diagrama Intercom

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 27

algunos equipos Makito Haivision para la codificación y decodificación SRT de las señales de video de subida o de bajada a la nube.

Personalización de los partidos

Durante el mundial, RTVE ha dispuesto de dos unidades móviles para la personalización in situ de los partidos retransmitidos y para la realización de los programas previos correspondientes. Dentro de cada estadio se ha ubicado una plataforma de presentación y diferentes posiciones de cámara, así como una posición de comentarista dedicada. Todo ello empleando el material

técnico de la dotación de dichas unidades. La interconexión de las mismas ha sido mediante los circuitos

proporcionados por la organización del mundial HBS (VandA) entre los estadios y el IBC. Para la señal backup del directo de dicha personalización de la señal con España se ha utilizado una mochila LiveU LU800 con un circuito internet dedicado.

PRUEBA DE CONCEPTO DE REALIZACIÓN EN LA NUBE

Los grandes eventos mundiales suelen ser excelentes oportunidades para poner a prueba soluciones tecnológicas novedosas. Muchas de ellas tienen como objetivo desarrollar y llevar a cabo las producciones de una manera más sostenible y eficiente, reduciendo costes e incrementando las ventajas operativas. La Dirección de Medios y Operaciones de RTVE, como hizo con su pionera transformación a IP del centro de producción de Sant Cugat o con su despliegue de transmisores IP 4G/5G en su infraestructura territorial por toda la geografía nacional ha explorado, en el campeonato mundial de futbol de Qatar 2022, nuevos caminos de innovación con las tecnologías más avanzadas.

PRODUCCIÓN TÉCNICA 28 RTVE EN QATAR TM Broadcast

Control set campo de entrenamiento.

Control set campo de entrenamiento.

En paralelo a su producción habitual RTVE ha llevado a cabo una prueba de concepto POC empleando la solución de Grass Valley-AMPP “Agile Media Processing Platform”. El principal objetivo ha sido probar una producción remota con soluciones broadcast basadas en software y conectadas a través de internet pública con procesamiento en nube pública (la cloud). Los compañeros de viaje del equipo técnico de RTVE comprometidos en esta apuesta tecnológica han sido Grass Valley y Crosspoint. En menos de una semana, se ha montado e instalado un control de operaciones y realización

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast

29

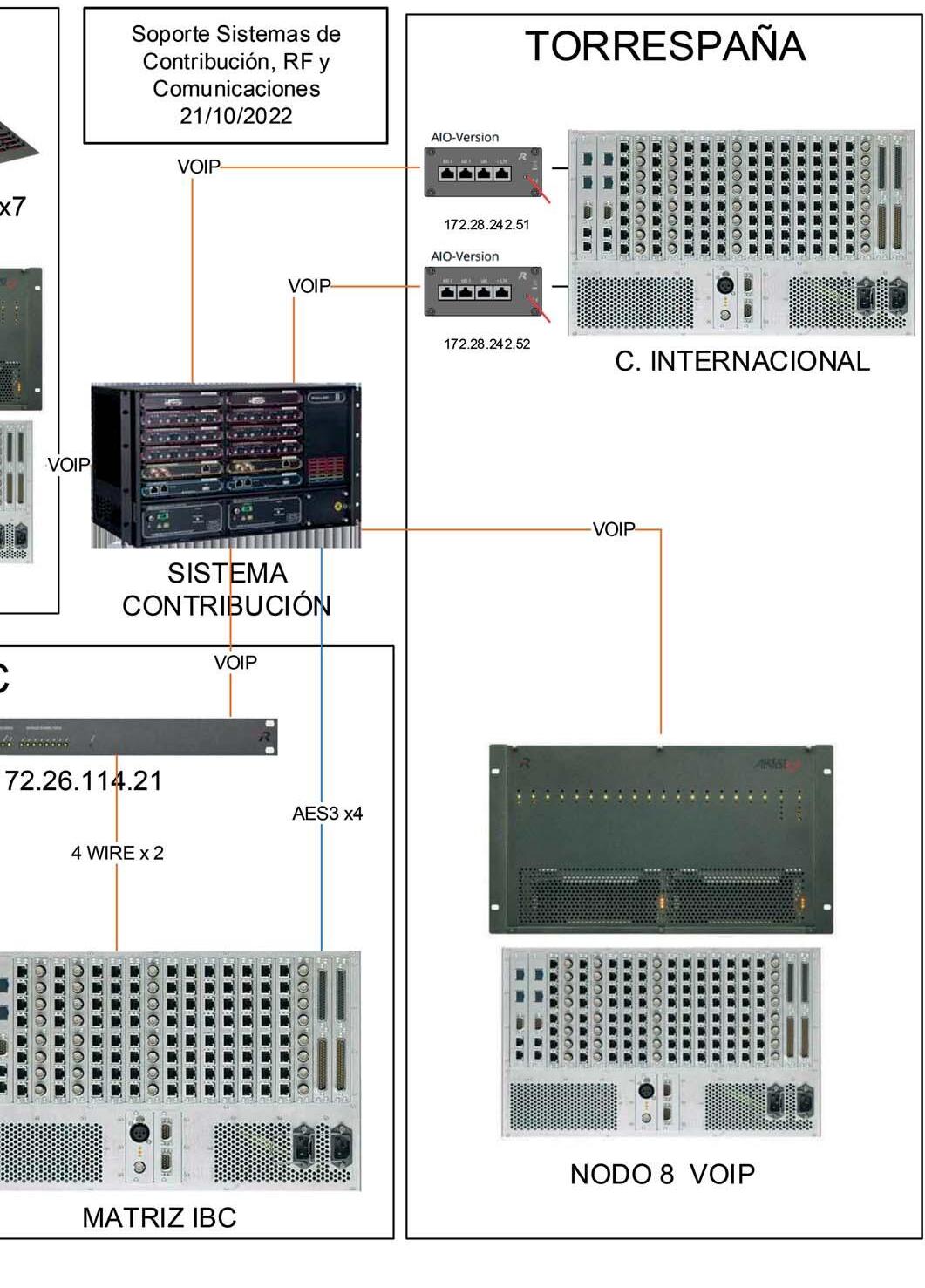

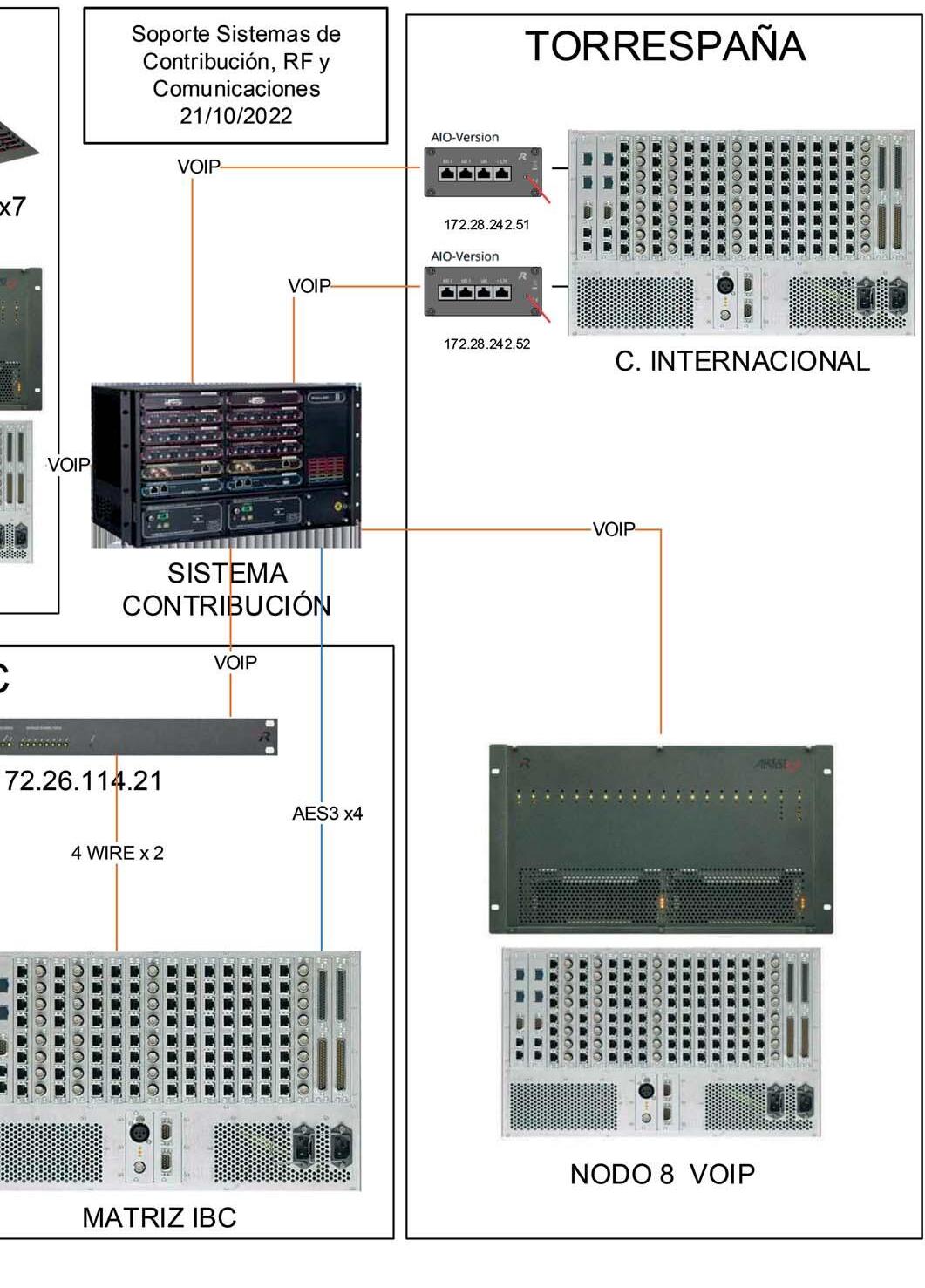

Diagrama Audio Video Set.

Control remoto POC.

en una sala del centro de Torrespaña y un sistema de producción en cloud.

La POC de producción remota ha utilizado el set RTVE Skyline del rascacielos de Doha aprovechando las señales de las cámaras allí emplazadas. Los equipos Makito de Haivision se han dedicado a convertir las señales SDI en streams de video SRT para el intercambio con la nube a través de una conexión FTTH local con una capacidad de unos 100Mbps. El audio de los presentadores y de origen en Doha, se ha embebido en las entradas de las XCU de las cámaras instaladas en el Skyline y se ha transportado hasta la nube en el stream de vídeo SRT, pudiendo ser controlado cada canal de forma individual por la aplicación en la plataforma en la nube.

En Torrespaña, otra FTTH ha dado conexión a paneles de mezclador de vídeo Korona, OCP400/CGP500 para el control remoto de parámetros de las cámaras y un panel de repeticiones de video Live Touch. El resto de funcionalidades necesarias para la

realización y producción técnica como multipantallas, mezclador de audio, control de grafismo, control y gestión del flujo de trabajo, han sido ejecutadas por aplicaciones de la plataforma que se despliegan vía software en ordenadores instalados en la misma sala de control. Todos los procesos y computación necesarios han sido alojados en una instancia configurada al efecto en la nube pública. Las aplicaciones funcionando en cloud no han requerido ningún hardware adicional: ni core de mezclador de vídeo, ni multiviewer, ni servidor de repeticiones.

El control de cámaras y monitorización se ha manejado desde la plataforma en la nube con los servidores CCS-One instalados al efecto en el set de Doha y con la aplicación de grading correspondiente, permitiendo un control de cámara intuitivo de forma remota y la monitorización multicámara conmutada desde los propios paneles de control. La mencionada aplicación también ha atendido la función de Tally, con indicación tanto en los controles de cáma-

ras de Torrespaña, como en la aplicación multipantalla accesible desde cualquier terminal con acceso a internet y, por supuesto, en las propias cadenas de cámaras situadas a más de 5.000 Km de distancia.

Del procesado en la nube pública para la mezcla de vídeo y efectos se ha encargado otra de las aplicaciones del ecosistema que permite utilizar hasta 32 entradas y 16 salidas en formato 1080p con 3 bancos M/E de procesado y 6 keyers por banco; incluyendo memoria para clips almacenados, efectos 2D y multipantallas. La instancia levantada en la cloud se ha controlado desde el panel del mezclador ubicado en la sala de control de Torrespaña. El grafismo, empleando la línea gráfica habitual de RTVE, se ha hecho importando las plantillas gráficas y mediante otra de las aplicaciones se han operado los diferentes rótulos y logos.

La grabación y reproducción de contenidos se ha gestionado también con aplicaciones levantadas en

PRODUCCIÓN TÉCNICA 30 RTVE EN QATAR TM Broadcast

la nube. El sistema de gestión de ingesta y repeticiones empleado ha tenido capacidad para ingesta sincronizada de cuatro fuentes de vídeo y reproducción de dos programas independientes con herramientas de señalización, posicionamiento y control de velocidad de reproducción. El almacenamiento de media también estaba alojado en la cloud y asociado a las instancias de procesa-

do. Y se ha podido controlar bien directamente por software con una de las aplicaciones de la plataforma sistema o mediante el panel físico que se ha equipado en la sala de control, ya que los operadores están muy acostumbrados a su manejo.

Otra aplicación ha realizado en la nube la función de monitoreado y multipantalla. Con ella se han crea-

do varios modelos de pantalla con diferentes tamaños de ventanas y configuraciones según las necesidades y las peticiones de los diferentes profesionales participantes en las pruebas.

Para el intercambio de señales entre el entorno SDI de Torrespaña y los streams SRT de la nube pública se ha instalado un servidor Edge que permitió la conexión de muy baja latencia con la nube. De igual manera, este equipo permitió incorporar a la producción fuentes de vídeo SDI desde el control central de TVE. El empleo del Edge, además, permite el uso de las diversas aplicaciones del ecosistema en el propio servidor de manera local, permitiendo el uso de escenarios híbridos con procesados localizados en diferentes localizaciones físicas o en la cloud.

En este esquema básico de la prueba de concepto de producción remota se muestra que todo el procesamiento se ha implementado en la nube pública, mientras que todos los paneles y aplicaciones de control

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 31

Control remoto POC.

y operación se han instalado en la sala de control de Torrespaña, simulando un proceso operativo similar a los realizados habitualmente:

En cuanto al esquema técnico, se pueden identificar las diferentes zonas, el set de RTVE en Qatar, las aplicaciones de procesamiento desplegadas en la nube pública y todo el despliegue de operación y control en la sala de control de Madrid.

El resultado de esta realización ha sido bueno. RTVE se proponía probarlo en un entorno real antes de su posible implantación en explotación

A pesar de intercambiar fuentes de señal entre orígenes situados a más de 5.000 Km de distancia, la sincronización ha sido buena. Se han logrado latencias de monitoreado y conmutación por debajo de 10 frames trabajando en 1080p. Una latencia similar e incluso inferior a la que se pueda conseguir mediante una conexión vía satélite y con una calidad contrastada en formato 1080p. La plataforma en la nube ha permitido conmutaciones precisas, síncronas, con el audio correctamente alineado con el vídeo, y realizando efectos avanzados y DVE. Como prueba añadida, la cámara de un teléfono móvil situado en Madrid con salida SRT fue conectada como una fuente remota más, pudiendo utilizarla de manera síncrona junto a las fuentes provenientes de Qatar.

Todos los actores involucrados en esta producción hemos aprovechado la oportunidad de manera activa y efectiva. TVE ha podido conocer a fondo esta solución, y por la sala de control instalada en Torrespaña han pasado la mayoría de los ingenieros

y técnicos de la Dirección de Medios y Operaciones de TVE, los cuales han conocido las prestaciones de la solución probada y las características de la computación en la nube. De igual manera, asistieron operadores de diferentes perfiles como mezcladores de vídeo, realizadores, operadores de audio, controles de cámaras y operadores de repeticiones. Desde el punto de vista operacional todos

han podido probar de manera interactiva las características de esta nueva tecnología desde un punto de vista operacional y han aportado información sobre las características y funcionalidades que se requieren en el trabajo y la operación diarios.

Desde RTVE, una vez analizada la producción en la nube empleando conexiones de internet públicas, y

PRODUCCIÓN TÉCNICA 32 RTVE EN QATAR TM Broadcast

Esquema básico de la prueba de concepto de producción remota

viendo la evolución que los diferentes fabricantes están realizando de sus soluciones, creemos que gran parte de la producción en pocos años va a evolucionar en esta dirección.

Por ahora podremos utilizarla para completar eventos donde hay una producción in situ grande y se vea conveniente completarla con

algún control de cámaras más, alguna realización alternativa o algún sistema de repeticiones adicional.

Para producciones pequeñas en las que se utilicen únicamente estos sistemas, se tiene que evolucionar a implantaciones que requieran configuración “cero” y la puesta en marcha sea prácticamente instantánea. Para esto quizá es necesario con

pruebas de concepto como esta, ganar en confianza en la nube y en alguna habilidad “plug & play” especialmente en cuanto a configuración de las conexiones en las redes WAN.

En próximos acontecimientos RTVE continuará explorando las prestaciones, las ventajas y las oportunidades que brindan los sistemas de producción remota en la nube.

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 33

PRODUCCIÓN TÉCNICA 34 RTVE EN QATAR TM Broadcast

Esquema técnico

RTVE EN QATAR PRODUCCIÓN TÉCNICA TM Broadcast 35

PRODUCCIÓN VIRTUAL EN GRUP MEDIAPRO

La revolución del grupo audiovisual en tecnologías de producción virtual

36 TM Broadcast PRODUCCIÓN VIRTUAL TECNOLOGÍA

El uso de la Producción virtual se ha acelerado en los últimos años convirtiéndose en una forma de facilitar las producciones.

Grup Mediapro decidió adoptar esta metodología e incluso ha ido un paso más allá, siendo pioneros en el uso de una tecnología mixta: la combinación de pantallas LED y croma.

Para saber más acerca de este desarrollo propio, su utilización y del despliegue técnico que se realizará en sus estudios, hemos tenido el placer de hablar con Emili Planas, CTO y Operations Manager en el grupo audiovisual.

37 TM Broadcast PRODUCCIÓN VIRTUAL TECNOLOGÍA

Entrevista con Emili Planas

¿Cuál es el despliegue técnico que vais a realizar? ¿Cómo son los estudios de producción virtual que estáis desempeñando?

El aprendizaje que hemos obtenido durante estos dos últimos años ha marcado las líneas que queremos seguir. Tenemos en cuenta que estamos en un momento en el que esta tecnología es lo suficientemente madura como para ponerla en explotación, pero aún está comenzando.

En los últimos dos años hemos visto evoluciones de la tecnología muy rápidas y otras más estables, pero al final montamos los estudios dependiendo del mercado al que nos dirigimos y el país en el que estamos. Los requerimientos para cada tipo de producción son un poco distintos y, para afrontar eso acorde a la forma de trabajar de Mediapro, hemos categorizado todo lo que implica un material técnico de un plató de producción virtual en tres categorías distintas, de modo que cada una de ellas puede dar servicio a las diferentes modalidades de negocio.

Esto nos hace tener una lista de equipamiento que permite estructurar en cada uno de los platós que estamos montando un tipo de tecnología u otra.

¿Qué tecnología habéis desplegado en los diferentes casos de uso?

Trabajamos con distintos fabricantes en cada uno de los campos. Mediapro cubre todas las unidades de negocio de la industria audiovi-

sual, lo cual nos ayuda a que los fabricantes nos vean con buenos ojos cuando aportamos ideas para la mejora de un producto. Es decir, no somos una empresa de ingeniería, una empresa de producción o una empresa de creación de contenidos… somos todo eso y más. Por lo tanto, cuando hablamos con los fabricantes, tenemos la capacidad de mostrarles las necesidades de la industria.

Esto no es una cuestión puramente técnica o de producción, sino que tenemos que ser capaces de ofrecer a la industria algo que permita hacer cualquier tipo de producción a unos precios razonables. Este punto de vista de Mediapro es muy apreciado por los fabricantes y nos permite tenerlos como partners.

¿Los estudios de producción que tenéis planteados van a abarcar todas las unidades de negocio de la industria audiovisual?

A corto plazo no. Obviamente hay centros donde tenemos muchos platós y podríamos tener uno para

publicidad y otro para cine si fuera necesario, pero de momento parece innecesario separar tanto.

En Barcelona, donde está la sede central de Grup Mediapro, hemos hecho un diseño para producción cinematográfica y publicidad, conviven estas dos tecnologías. Lógicamente la producción cinematográfica, que es mucho más exigente, puede tener alguna limitación. Además, la sede de Barcelona tiene que convivir como showroom. Es donde estamos intentando promocionar toda la producción virtual a la industria y estamos invitando a muchas productoras e interesados en producción virtual. Esa convivencia con el showroom hace que sea un laboratorio de validación de nuevos sistemas. Es donde trabajamos, mezclamos la producción con la investigación, la validación, puesta en marcha, test de nueva tecnología, etcétera.

En Madrid será para ficción. Queremos que The Mediapro Studio sea el principal usuario del plató de Madrid, al igual que cualquier otra

TECNOLOGÍA 38 PRODUCCIÓN VIRTUAL TM Broadcast

productora que necesite virtual production para ficción. En Miami estamos trabajando con un partner especializado en producción virtual para publicidad. Este partner es el que ocupará la totalidad del uso del plató. En Nueva York, Manhattan, ahora mismo estamos terminando la configuración del plató que esperamos pueda ser de primer nivel. El mercado norteamericano, y específicamente el de Nueva York, nos está pidiendo máxima calidad y así lo estamos preparando.

¿En qué punto de desarrollo os encontráis?

En este momento tenemos un problema con los plazos de entrega. Tenemos los diseños de todos los platós y estamos acabando de negociar, en alguno de ellos, el proveedor por el tema de los plazos más que por otra cosa.

El de Madrid está en diseño. En el de Barcelona ya tenemos una parte de las pantallas y falta otra. Como he dicho, nos sirve tanto para show-

room como para testear cualquier nueva tecnología. Igualmente ya está habilitado para producción. En un par de semanas tendremos el croma montado.

Hablemos de esa combinación de tecnología LED y tecnología de croma que habéis desarrollado.

Una de las características que tenemos en todos los platós de producción virtual de Grup Mediapro es la combinación de tecnología LED con tecnología de croma en la misma producción e incluso combinadas en el mismo plano. Esta es una de las características que hemos trabajado en los últimos años.

Durante un tiempo surgió el debate que todo el mundo debería tener cuando empieza en virtual production: ¿qué hago, LED o croma? Unos justificaban uno y otros lo contrario, por lo cual decidimos implementar ambos. Había un problema, ¿qué tecnología podríamos implementar para poder usar los dos? O bien no existe o no hay muchas. Decidimos hacerlo nosotros.

La tecnología que tenemos ahora mismo en funcionamiento nos permite rodar en la parte LED, girar la cámara y grabar un plano en la parte croma. O incluso donde acaba el LED empieza el croma y podemos tener en un mismo plano LED y croma si es necesario. Es más, si en un rodaje se cree adecuado poner un panel croma en medio del LED también podemos hacerlo y funciona. Lógicamente con las cámaras trackeadas.

Si el director de fotografía prefiere retocar un plano en postproducción grabamos en croma, si necesita toda la iluminación con la ayuda de la pantalla LED, pues usamos LED. Dentro de las mismas producciones estamos haciendo planos en croma y LED, sin que eso nos implique cambiar de sistema, modificar las calibraciones de cámara, partes de tracking, etcétera. Dentro de una misma producción observamos que hay planos que funcionan mejor en una tecnología y otros que funcionan mejor en la otra. Luego al ver la producción completa no se distingue si ha sido hecho en LED o croma. Es más, hay producciones que por el workflow el croma ofrece muchas ventajas al luego poder modificar las cosas en postproducción.

Lo que si tenemos claro que tanto en LED como en croma trabajamos en tiempo real. El productor ve la escena final en cualquiera de las dos tecnologías. Luego se puede llevar lo rodado en croma a postproducción porque el workflow también lo permite. Generamos todas las señales y la metadata necesaria para realizarlo. Es algo que se escoge dependiendo de la producción. Es importante

PRODUCCIÓN VIRTUAL TECNOLOGÍA TM Broadcast

39

recalcar que el rodaje en croma puede ser distinto en producción virtual que en croma tradicional. La gran diferencia es que la tecnología que estamos usando, como digo, permite tiempo real en croma y en LED. Esto agiliza el rodaje y la calidad final. Los directores de fotografía cuando ven en tiempo real lo que están haciendo en croma con el fondo incorporado y con los movimientos de cámara están encantados. No vuelven atrás.

Finalmente se trata de platós mixtos o híbridos para todo tipo de producción, ¿no? ¿El propio grupo tiene la capacidad para desarrollar todos los elementos necesarios?

Todos los estudios de virtual production son o serán con la combinación de croma y LED. Ha sido una tecnología de desarrollo propio en la que hemos sido pioneros.

Grup Mediapro cubre todas las partes de la producción que se puedan necesitar en un proyecto. Como filosofía, si un cliente tiene a sus propios unreal artist, fondos virtuales y solo necesita el plató para grabar

estupendo, pero no suele ser lo más normal. Lo habitual es que se requieran unas necesidades para producción específicas. Por lo tanto tenemos capacidad para hacer cualquiera de las partes, no solo la parte técnica sino también la creativa.

Tenemos gente que controla el lado creativo y otros el lado técnico, igualmente les formamos y mantenemos al día para que aprendan sobre toda esta nueva forma de trabajo. Les instruimos de manera interna, creando cursos para poder readaptar perfiles que a día de hoy están trabajando en temas similares como la parte de postproducción 3D, por ejemplo. El resto de perfiles que se encargan de la parte de rodaje, plató o iluminación, como ejemplos, también deben readaptarse e ir aprendiendo estos flujos de trabajo.

Es uno de los retos más importantes, que toda esta industria formada por personas entienda como trabajar en este tipo de producción.

¿Está la tecnología totalmente lista?

Ahora mismo está funcionando. Aún no hemos tenido una produc-

ción que haya necesitado hacer la mezcla de croma y LED en el mismo plano, pero lo hemos probado en test y funciona perfectamente. Hemos realizado producciones en las que ponemos el LED en un plano y en el mismo estudio giramos, hacemos el croma y rodamos en croma el siguiente plano. Se realiza con la misma cámara, mismo kit de óptica, mismo tracking, mismos recursos de computación… Obviamente el croma sigue un workflow de señal distinto, pero de cara al rodaje todo el mundo ve a tiempo real la imagen final.

¿También funciona con producciones en directo?

En este caso se abre un campo bastante amplio. ¿Qué se considera producción virtual o realidad aumentada dentro de una producción en directo? Nosotros lo metemos en el mismo saco. Tenemos a gente de producción virtual implicada en distintos proyectos de realidad aumentada.

TECNOLOGÍA 40 PRODUCCIÓN VIRTUAL TM Broadcast

En fútbol, por ejemplo, estamos añadiendo unas tres capas distintas de realidad aumentada. Las técnicas que se usan para esa realidad aumentada en fútbol no son las técnicas que usamos en estudio.

En platós de televisión en directo, donde hacemos desde el sorteo de la once hasta programas postpartido en la Liga TV u otros canales, tenemos producción virtual que sigue tecnologías distintas en cada plató.

Pero sí hacemos directos con producción virtual, eso es esencia de Grup Mediapro, trabajar para el directo. Esa tecnología que usamos en plató para ver en tiempo real también nos sirve para producción en directo. Clasificamos las distintas tecnologías para poder ser optimizadas para un tipo de producción u otra, pero finalmente es el mismo tipo de dinámica o está implicada en los mismos tipos de gente.

Como hemos hablado, el croma es necesario y mejor para algunas cosas, pero algunas voces dicen que el volumen LED evolucionará hasta

acabar supliendo todo lo que aporta el croma y con capacidades extra. ¿Cuál es tu opinión?

Creo que estamos muy cómodos combinando las dos partes. Hay tecnologías muy imaginativas que van apareciendo pero que no acaban de consolidarse, porque son complejas o no aportan demasiado. Seguramente lleguemos a ver alguna que será revolucionaria. Sería bueno que pasara, pero a día de hoy la industria de producción, sobre todo cinematográfica, necesita saber que un largometraje no se le va a ir de presupuesto.

Toda esta gente que es necesaria dentro de la industria y que produce de forma regular, son los primeros que tienen que entender cómo funciona la producción virtual y sentirse seguros rodando así. Para que se sientan seguros rodando en producción virtual las instalaciones donde vayan a rodar tienen que funcionar y en caso de haber limitaciones tienen que estar muy claras. Poder ofrecer esa seguridad y readaptar la cadena

de trabajo llevará tiempo. Se está empezando a hacer y hay mucho feedback positivo, pero hay una gran parte de la industria que tiene que tomárselo como propio.

Aparte de formar a vuestra propia gente, ¿qué opinas del cuerpo de estudiantes o profesionales que salen preparados para afrontar estas tecnologías o dinámicas de trabajo? ¿Se están creando perfiles necesarios?

Además de nuestros cursos internos estamos en contacto con universidades. Primero para detectar talento en formación y para influir mínimamente en aquello que por parte de la industria creemos que se necesita, para que las universidades tengan ese input de lo que se mueve o qué perfiles son más urgentes.

Obviamente estamos en un momento de la producción virtual en el que hay más necesidad que personal y, aunque está empezando, hay falta de personal especializado y con experiencia. Esa poca experiencia que encontramos en el sector

PRODUCCIÓN VIRTUAL TECNOLOGÍA TM Broadcast

41

es la que estamos intentando trabajar internamente, haciendo muchos trabajos, generando trabajo interno para aprendizaje y adquiriendo la experiencia para afrontar cualquier tipo de proyecto.

¿Qué opinas sobre la captación volumétrica? En cuanto a la computación en la nube, ¿cómo afectará a la mejora de esta tecnología? ¿Cómo evolucionará?

Formamos parte de la asociación VFA (Volumetric Format Asociation) desde prácticamente su formación, estamos en contacto constante con distintos centros de formación y empresas que trabajan sobre modelos de captación volumétrica. Trabajamos con diferentes líneas de I+D para la parte de deepfake, metahumans y sistemas basados en inteligencia artificial para generar todo este tipo de imágenes.

Luego está la gestión del archivo de todos los assets que se puedan utilizar en producción virtual. De hecho, en Unreal puedes comprar un objeto y usarlo, replicarlo, modificarlo… es muy útil, flexible y permite ir generando catálogo de assets comercializándolos o usándolos tantas veces como sea necesario.

En cuanto a la nube, tenemos una unidad de negocio muy orientada a soluciones cloud. Esta unidad de negocio forma parte del comité de Virtual Production y estamos usando cloud para cierto tipo de computación. No hay soluciones de virtual production completamente cloud, necesitas ciertas herramientas al lado de la pantalla, pero sí es cierta la gran capacidad de computación que te ofrece. Nos permite trabajar

en captación volumétrica de una forma más económica que si la hiciéramos en casa, o como mínimo con menos tiempo de procesado. Ahora bien, para trabajar a tiempo real necesitamos hardware potente en el plató.

En cuanto a sostenibilidad, ¿cuál es el compromiso de Grup Mediapro?

Se está asociando, y bien hecho, que la producción virtual ayuda a disminuir la huella de carbono. Esto supone una ventaja para el sector impresionante. La energía que consume nuestro centro de producción en Barcelona es 100% de fuentes renovables, por lo tanto el plató que

montamos aquí convierte nuestras producciones virtuales en cero emisiones de CO2. Además, al estar en el centro de Barcelona puedes venir en transporte público, bicicleta, etcétera.

Todo esto para nosotros es muy relevante. Mediapro es sensible a la huella de CO2 y queremos ser mucho más eco y sostenibles. Nuestros modelos de producción remota, producción centralizada y demás, inicialmente se hacían porque era mejor. En producción virtual aún no hemos analizado el ahorro en huella de CO2 pero se estima que dentro de plató es cero y un ahorro por el hecho de no tener que viajar a localizaciones.

TECNOLOGÍA 42 PRODUCCIÓN VIRTUAL TM Broadcast

Desarrollo de negocio

Grup Mediapro quiere ser referente del escenario internacional de la producción virtual. ¿Qué pasos está dando la compañía para alcanzar esta meta?

El primer paso, y más importante, es desarrollar nuestras propias tecnologías. En GRUP MEDIAPRO hemos invertido meses analizando las opciones relacionadas con LED y croma y, al final hemos decidido que la mejor opción... son las dos. Así que trabajaremos con las dos tecnologías al mismo tiempo. Cada una tiene ventajas en determinadas situaciones. El siguiente paso es equipar los centros de producción de GRUP MEDIAPRO con platós para la producción virtual.

Estamos en la fase final en el centro de producción en Barcelona, con un plató de más de 500m2. El paso siguiente será Nueva York y Miami. Calculamos tener equipados todos los centros de producción (Madrid, Buenos Aires, Bilbao, Lisboa, Bogotá, ...) a medio plazo. Paralelamente, estamos formando a profesionales para poder sacar el máximo provecho a esta nueva tecnología. Y seguimos investigando y buscando nuevas formas de innovación. Desde GRUP MEDIAPRO no dejamos de hacerlo nunca, estamos siempre trabajando en cómo mejorar la calidad y las nuevas utilidades de todas las tecnologías que empleamos. Esta es nuestra manera de ser referentes y líderes en el sector audiovisual.

¿Habéis identificado la producción virtual como una tendencia que se acabará imponiendo como modo habitual de producción?

En muchas situaciones sí. Es evidente que algunas escenas o proyectos deberán seguir haciéndose en “escenarios naturales”, pero con la producción virtual se abre un abanico de posibilidades ilimitadas: no solo en ficción, también en programas de entretenimiento, informativos y publicidad. Tenemos la tecnología, ahora debemos empezar a poner en valor y exprimir todas su potencialidad y posibilidades.

¿Qué retos de negocio habéis encontrado? ¿Qué soluciones proponéis para solventarlos?

El principal reto ha sido involucrar a toda la organización: a todas las sedes y a todas las unidades de negocio, desde innovación, servicios audiovisuales hasta The Mediapro Studio. Pocas empresas están en la posición en la que estamos en GRUP MEDIAPRO: controlando toda la cadena de valor de la producción de contenidos audiovisuales. Para desarrollar la tecnología y el workflow necesarios en la producción virtual hemos incorporado el punto de vista de todos los profesionales y procesos implicados, desde la persona que ilumina hasta el director o realizador. Con la experiencia, conocimientos y opinión de todos los implicados hemos desarrollado nuestro propio sistema de producción virtual.

¿Cómo evolucionará esta estrategia a largo plazo?

La tecnología que utilizamos para la producción virtual está avanzando a una velocidad extraordinaria, lo que hace que tengamos que hacer planes a medio plazo. A largo plazo, estamos convencidos del uso masivo de estos modelos de producción virtual. Estamos viendo que cuando productores y técnicos trabajan por primera vez en producción virtual la mayoría se convierten en fans de esta tecnología, lo que nos hace pensar que la producción virtual ha venido para quedarse. Este tipo de producción ofrece, además, grandes ventajas en cuestiones medioambientales, por ejemplo. Reduce muchísimo todos los desplazamientos que antes había que hacer para grabar determinadas imágenes. También favorece el control artístico: el director o realizador ve, en directo y sin tener que esperar a postproducción, cuál será el resultado final de lo que está rodando, pudiendo modificar, en directo, cualquier aspecto de luz, encuadre, posicionamiento ¡Por no hablar de los partes meteorológicos! Con la producción virtual la planificación de un rodaje ya no está supeditada al parte meteorológico. Como decía, la producción virtual ha venido para quedarse. No ha hecho más que empezar y estoy seguro que la implementación de innovaciones técnicas será constante.

PRODUCCIÓN VIRTUAL TECNOLOGÍA TM Broadcast

43

Experiencias de multimedia audiovisual sobre redes 5G

44 TM Broadcast 5G TECNOLOGÍA

Por David Jiménez, profesor ayudante doctor en la Universidad Politécnica de Madrid

El incremento de capacidades ofrecidas por la evolución de las redes de comunicaciones proporciona un conjunto de posibilidades más allá de la explotación directa de las mejoras de ancho de banda, latencia, alta densidad y escalabilidad. Este nuevo horizonte, que se puede caracterizar a muy alto nivel por la integración de inteligencia en la red, incorpora la capacidad de gestionar los recursos de red de forma dinámica, atendiendo a diferentes criterios de servicio, y la maximización del uso de las posibilidades de computación en el Edge y Cloud.

Dentro de las potenciales aplicaciones, las de multimedia audiovisual se encuentran entre las más exigentes, siendo muy demandantes de capacidad de red y de recursos computacionales. Para los servicios de contenidos, la descentralización que permite la flexibilidad de las nue-

vas redes, junto con la potencia de desplegar servicios en el Edge, proporciona la capacidad real de modificar flujos de trabajo clásicos, acercando los procesados ligados a la distribución de contenidos al punto de adquisición de los mismos, dotando, mediante los mecanismos de virtualización, de la capacidad de desplegar de forma dinámica los procesos ligados a los servicios, y finalmente, apoyándose en la programabilidad de las redes, la adecuación de las mismas para satisfacer la demanda concreta derivada de los mismos, pudiendo adaptarse a posibles modificaciones en momentos puntuales e incluso integrar, para garantizar el servicio, de sistemas de control de calidad en tiempo real que permiten anticipar la toma de decisiones sobre la forma en que los servicios son proporcionados, o los recursos asignados a los mismos.

45 TM Broadcast 5G TECNOLOGÍA

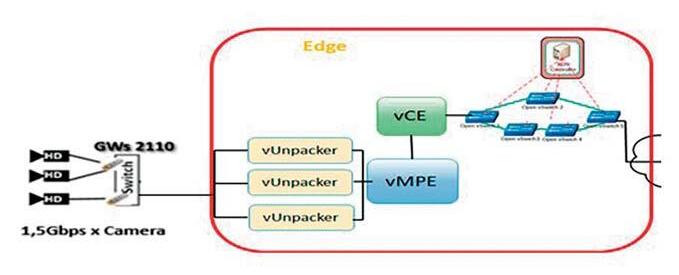

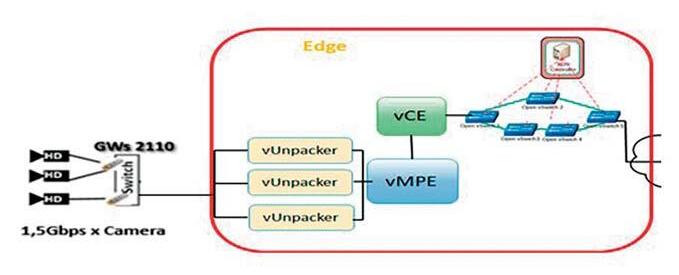

En esta línea, desde el Grupo de Aplicación de Telecomunicaciones Visuales (GATV) de la Universidad Politécnica de Madrid (UPM), se ha trabajado en el despliegue de pruebas de concepto que permitiesen valorar la capacidad real de prestar servicios de contenidos audiovisuales de alto nivel aprovechando el conjunto de capacidades anteriormente mencionado: la virtualización de funciones de red (NFV, Network Function Virtualisation), las redes definidas por software (SDN, Software Defined Networks) y la computación en el extremo de la red de acceso múltiple (MEC, Multiaccess Edge Computing). Sobre esta base se modela la arquitectura y los servicios dentro de la red de comunicaciones. Mediante la virtualización de las funciones de red se implementan diferentes funciones de red por software (VNF, Virtualised Network Functions), típicamente sobre una infraestructura de virtualización de funciones de red (NFVI, Network Function Virtuaization Infrastructure), lo que desacopla las funciones de red del hardware, aumentando la flexibilidad de la infraestructura y reduciendo los gastos de operación y de equipamiento. Adicionalmente, las funciones de red físicas (PNF, Physical Network Functions) son cajas de hardware que brindan una funcionalidad específica.

Por otro lado, las SDN gestionan las funciones de enrutamiento y reenvío en el software de dispositivos de red. El uso de SDN ofrece tres claves importantes: separa el plano de control del plano de datos, proporciona una gestión centralizada y, finalmente, convierte toda la red en una entidad programable. Con SDN y NFV, se reduce la complejidad del diseño de los dispositivos, se logra una configuración de red eficiente y el contexto de trabajo puede reaccionar a los cambios de estado mucho más rápido que con los enfoques convencionales, lo que brinda una gran flexibilidad y rentabilidad en la implementación de los servicios, en este caso, los servicios de distribución de contenidos audiovisuales.

Finalmente, la implementación en el MEC permite la migración de recursos de procesado y de almacenamiento más cerca de los usuarios demandantes, lo que reduce la latencia y la agregación de tráfico requerida por los servicios de multimedia audiovisual. NFV, SDN y MEC son tecnologías complementarias que lideran la evolución de la arquitectura de red, ofreciendo nuevos servicios, en este caso, explotados para la provisión de servicios de contenidos.

TECNOLOGÍA 46 5G TM Broadcast

Uno de estos pilotos, se realizó en el marco del proyecto 5G-Media Programmable edge-tocloud virtualization fabric for the 5G Media industry, que pretendía la creación de un entorno flexible basado en una plataforma de servicio con un kit de desarrollo de software (SDK, Software Development Kit) que facilitase a usuarios agnósticos de la red el despliegue de soluciones, en forma de funciones de red virtualizadas, para la puesta en marcha de servicios de multimedia audiovisual sobre el Edge. El principal objetivo de este piloto fue comprobar la viabilidad de realizar producción remota virtualizada sobre redes 5G en tiempo real, experiencia que se realizó en las naves de Matadero (Madrid), en colaboración con Radio Televisión Española (RTVE) y Telefónica, sobre la emisión de Radio 3 de “La vida es sueño”, mostrando como los avances tecnológicos en el dominio 5G y la computación en el extremo de la red eran capaces de facilitar el potencial suficiente para ofrecer servicios de contenidos audiovisuales de alta calidad a través de una asignación de recursos dinámica y eficiente. Ofreciendo, de esta manera, una alternativa a los problemas asociados a los servicios y aplicaciones de multimedia audiovisual que van más allá de los requisitos de capacidad, latencia y ancho de banda ofrecidos por la red.

Hoy en día, la producción profesional de eventos para su transmisión se caracteriza, mayoritariamente por una gran inversión de recursos: dinero, grandes equipos desplazados, unidades móviles y largos tiempos de preparación y verificación de la instalación. Además, se establecen conexiones dedicadas entre el lugar del evento y el sitio de la emisora para garantizar el alto rendimiento y la calidad de transmisión requeridos, con el consiguiente coste asociado, al ser los requisitos de ancho de banda para una producción de televisión convencional del orden de varios gigabits por segundo. Todo sumado, da un orden de la magnitud de la cobertura de un evento y la inversión asociada a su producción.

5G TECNOLOGÍA TM Broadcast

47

En contraposición con esa aproximación, las tecnologías 5G plantean un nuevo paradigma para la gestión de servicios distribuidos y desplegados en el Edge, garantizando la calidad del servicio, generalmente evaluado como calidad de la experiencia del usuario, incluso para los requisitos de servicios de contenidos en red más estrictos y exigentes.

El piloto de producción remota presentaba como objetivo la producción en vivo de un evento desde una ubicación distinta al mismo. Para ello, se aprovecha la capacidad de la red 5G para hacer llegar las señales de cámara, audio y control a una sala de producción, permitiendo que no se necesite desplazar ese equipamiento durante la realización, ni a las personas encargadas de la misma. La arquitectura empleada se detalla a continuación.